Anthropic hat vor Kurzem Claude Opus 4.5 veröffentlicht, ihr bisher leistungsstärkstes Modell. Dank der neuen Preisstruktur wird High-End-KI (Künstliche Intelligenz) nun zugänglicher.

Doch die tatsächlichen Kosten für die Nutzung eines großen Sprachmodells (Large Language Model) zu ermitteln, ist selten so einfach wie ein Blick auf das Preisschild. Es gibt verschiedene Preismodelle, Optimierungsfunktionen und eine Vielzahl von Konkurrenten, die es zu berücksichtigen gilt. Das kann schnell unübersichtlich werden.

Dieser Leitfaden soll Klarheit schaffen. Wir gehen jedes Detail der Preisgestaltung von Claude Opus 4.5 durch – von den grundlegenden API-Kosten bis hin zu Funktionen wie dem Prompt-Caching (Zwischenspeichern von Prompts), die helfen können, die Kosten zu senken. Wir vergleichen es zudem mit seinen wichtigsten Mitbewerbern und betrachten eine alternative Möglichkeit, KI in Ihr Unternehmen zu integrieren.

Was ist Claude Opus 4.5?

Was genau ist Claude Opus 4.5? Es ist das Spitzenmodell von Anthropic, das für komplexe, mehrstufige Aufgaben entwickelt wurde, die erhebliche Rechenleistung erfordern.

Es erbringt hervorragende Leistungen bei Aufgaben wie Programmierung, der Handhabung komplexer automatisierter Arbeitsabläufe (oft als „agentische“ Aufgaben bezeichnet) und der Nutzung von Computeranwendungen. In einem Programmier-Benchmark erzielte es einen Wert von 80,9 % in einem Coding-Test.

Auf der technischen Seite verfügt es über ein großes Kontextfenster (Context Window) von 200.000 Token. Dies ermöglicht es dem Modell, eine große Menge an Informationen gleichzeitig zu verarbeiten und sich daran zu erinnern, wie zum Beispiel hunderte von Seiten eines Dokuments.

Diese Kombination aus Leistung und Kosten könnte neue Möglichkeiten für Entwickler und Unternehmen eröffnen und die Entwicklung hochentwickelter KI-Tools zugänglicher machen.

Die vollständige Aufschlüsselung der Preise für Claude Opus 4.5

Kommen wir zu den Zahlen. Hier ist ein direkter Überblick darüber, wie Sie für Claude Opus 4.5 bezahlen und es nutzen können, basierend auf den offiziellen Informationen von Anthropic.

Basis-API-Preise

Wenn Sie eine App entwickeln, die Claude nutzt, arbeiten Sie mit der API. Die Preisgestaltung basiert auf „Token“, was kleine Fragmente von Wörtern sind. Ungefähr 1.000 Token entsprechen etwa 750 Wörtern.

Die Standardsätze sind:

-

5 $ pro Million Eingabe-Token (Input Tokens) (die Informationen, die Sie an das Modell senden).

-

25 $ pro Million Ausgabe-Token (Output Tokens) (die Antwort, die das Modell zurückgibt).

Ausgabe-Token sind teurer, da die Generierung von neuem Text eine rechenintensivere Aufgabe für das Modell darstellt.

Hier ist eine kurze Zusammenfassung zur Übersicht:

| Merkmal | Details |

|---|---|

| Eingabe-Token | 5,00 $ pro 1 Million Token |

| Ausgabe-Token | 25,00 $ pro 1 Million Token |

| Kontextfenster | 200.000 Token |

| Maximale Ausgabe | 64.000 Token |

Claude-Modellvergleich

Opus 4.5 ist Teil einer größeren Modellfamilie. Anthropic bietet verschiedene Optionen an, sodass Nutzer eine Balance zwischen Intelligenz, Geschwindigkeit und Kosten für ihre Bedürfnisse wählen können.

Diese Tabelle zeigt, wie Opus 4.5 im Vergleich zu seinen Geschwistern abschneidet, basierend auf Daten direkt von der Pricing-Seite von Anthropic.

| Modell | Eingabe ($/M Token) | Ausgabe ($/M Token) | Ideal für |

|---|---|---|---|

| Claude Opus 4.5 | 5,00 $ | 25,00 $ | Komplexe Logik & Programmierung |

| Claude Opus 4.1 | 15,00 $ | 75,00 $ | (Vorgängermodell) |

| Claude Sonnet 4.5 | 3,00 $ | 15,00 $ | Ausgewogene Leistung & Kosten |

| Claude Haiku 4.5 | 1,00 $ | 5,00 $ | Geschwindigkeit & Aufgaben mit hohem Volumen |

Wie man sieht, ist Opus 4.5 preislich niedriger angesiedelt als sein Vorgänger Opus 4.1, während Sonnet und Haiku Optionen für Aufgaben sind, die nicht das gleiche Maß an Rechenleistung erfordern.

Abonnementpläne für Einzelpersonen und Teams

Für diejenigen, die Claude für den Chat nutzen möchten, ohne eine eigene Anwendung zu entwickeln, bietet Anthropic Abonnementpläne an.

So gliedern sie sich laut der Claude-Preisseite auf:

-

Pro-Plan (20 $/Monat): Dies ist für Einzelpersonen gedacht, die Opus 4.5 über die Chat-Oberfläche claude.ai nutzen möchten. Er bietet deutlich mehr Nutzungskapazität als die kostenlose Version.

-

Max-Plan (ab 100 $/Monat): Richtet sich an Power-User, die noch höhere Nutzungslimits benötigen und frühzeitigen Zugriff auf neue Funktionen wünschen.

-

Team-Pläne (25–150 $/Nutzer/Monat): Konzipiert für Unternehmen, die Tools für die Zusammenarbeit, Administrator-Steuerungen und Single Sign-On (SSO) für ihre Teams benötigen.

Abonnements bieten planbare monatliche Kosten für die konversationelle Nutzung von Claude. Für die Entwicklung eigener KI-Tools ist das API-Preismodell maßgeblich.

Fortgeschrittene Strategien zur Kostenoptimierung

Über die Standardpreise hinaus bietet Anthropic Funktionen an, die helfen sollen, die Kosten zu senken.

Sparen Sie bis zu 90 % mit Prompt-Caching

Prompt-Caching (Zwischenspeichern von Prompts) ist eine Funktion zur Reduzierung der Kosten bei wiederholten Eingabe-Token.

Wenn Sie beispielsweise einen Kundenservice-Bot betreiben, beginnen Sie wahrscheinlich jedes Gespräch mit denselben langwierigen Anweisungen (dem „System-Prompt“). Ohne Caching würden Sie jedes Mal den vollen Preis für diesen Prompt bezahlen.

Durch Prompt-Caching können Sie einen Textblock speichern und darauf verweisen. Nach einer einmaligen Gebühr für das „Schreiben“ in den Cache sind die Kosten für die nachfolgende Nutzung deutlich geringer.

Hier ist die Kostenaufschlüsselung laut Anthropic Pricing:

-

Cache Write (Schreiben): Eine einmalige Gebühr von 6,25 $ pro Million Token, um den Prompt zu speichern.

-

Cache Read (Lesen): Nur 0,50 $ pro Million Token bei jeder weiteren Verwendung.

Dies entspricht einer Ersparnis von 90 % gegenüber dem Standard-Eingabepreis von 5 $ für Opus 4.5. Für Anwendungen, die ein großes Dokument oder einen detaillierten System-Prompt verwenden, illustriert die untenstehende Infografik, wie diese Funktion zu erheblichen Einsparungen führen kann.

Erhalten Sie 50 % Rabatt mit der Batch-API

Ein weiteres Werkzeug zur Kosteneinsparung ist die Batch-API, die für Aufgaben gedacht ist, die keine sofortige Antwort erfordern.

Im Gegenzug erhalten Sie einen Rabatt von 50 %, was umfangreiche Aufgaben erschwinglicher macht.

Dies eignet sich perfekt für:

-

Das Generieren einer Vielzahl von Berichten am Ende des Tages.

-

Das Erstellen großer Mengen an Marketing-Inhalten.

-

Das Analysieren großer Datensätze ohne Zeitdruck.

Wenn Ihre Arbeit nicht zeitkritisch ist, kann die Batch-API Ihre Kosten um die Hälfte reduzieren.

Claude Opus 4.5 im Vergleich zur Konkurrenz

Claude konkurriert mit Modellen von OpenAI und Google. Hier ist ein Vergleich der Preisgestaltung.

Man bekommt, wofür man bezahlt; Opus ist etwa 5-mal teurer

Preisvergleich: Claude Opus 4.5 vs. GPT-5.1 vs. Gemini 3 Pro

Diese Tabelle vergleicht die Spezifikationen und Preise der drei Modelle unter Verwendung öffentlicher Informationen von OpenAI und Google.

| Modell | Eingabe ($/M Token) | Ausgabe ($/M Token) | Kontextfenster | Entscheidendes Differenzierungsmerkmal |

|---|---|---|---|---|

| Claude Opus 4.5 | 5,00 $ | 25,00 $ | 200K | Erstklassige Programmierleistung, Ersparnis durch Prompt-Caching |

| GPT-5.1 (Standard) | 1,25 $ | 10,00 $ | 128K | Niedrigster roher Preis pro Token in diesem Vergleich |

| Gemini 3 Pro Preview (≤200K) | 2,00 $ | 12,00 $ | Bis zu 1M+ | Gestaffelte Preise für massives Kontextfenster |

Obwohl die Token-Preise für GPT und Gemini niedriger erscheinen mögen, können Claudes kostensparende Funktionen wie Prompt-Caching eine große Wirkung haben. Bei Anwendungen, die wiederholt große Prompts nutzen, kann der 90-prozentige Eingaberabatt die Gesamtkosten massiv beeinflussen.

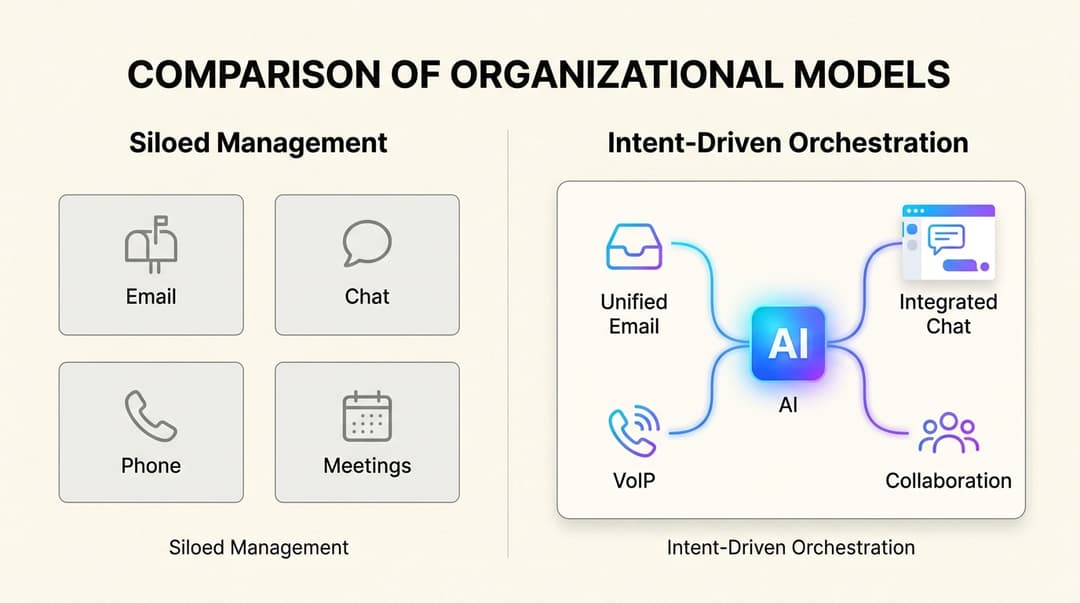

Versteckte Kosten beim Bau mit rohen APIs

Die Preise pro Token sind nur ein Teil der Gesamtkosten. Der Aufbau einer maßgeschneiderten KI-Lösung von Grund auf bringt weitere Ausgaben mit sich.

-

Entwicklungsressourcen: Das Erstellen, Integrieren und Warten der Anwendung erfordert qualifizierte KI-Ingenieure, deren Gehälter einen erheblichen Kostenfaktor darstellen können.

-

Kostenmanagement: Die Budgetierung auf Basis der Token-Nutzung kann komplex sein. Es kann schwierig sein, Ausgaben vorherzusagen, zu verfolgen und zu verwalten, insbesondere bei Skalierung.

-

Entwicklungszeit: Der Zeitraum vom Erhalt eines API-Schlüssels bis hin zu einem einsatzbereiten KI-Agenten kann langwierig sein.

-

Laufende Wartung: Maßgeschneiderte Lösungen erfordern kontinuierliche Wartung, einschließlich Anpassungen der Prompts, Modell-Updates und Fehlerbehebungen, was alles Engineering-Zeit beansprucht.

Wenn man alle Faktoren berücksichtigt, machen die API-Kosten oft nur einen kleinen Teil der Gesamtausgaben aus.

Das Modell „KI-Teamkollege“: Eine einfachere Alternative

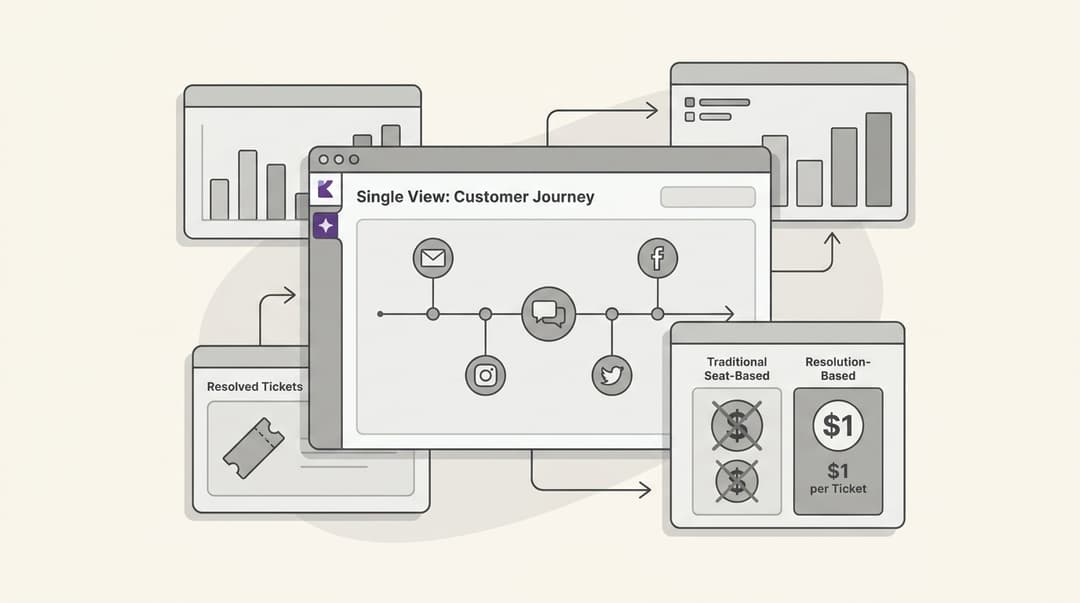

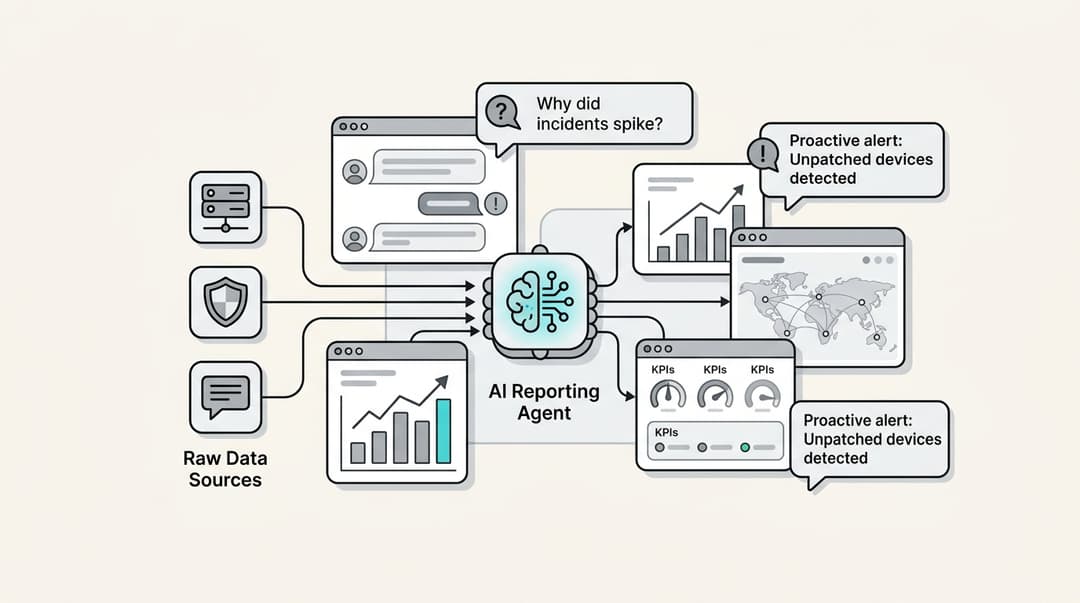

Eine Alternative zum Bau einer maßgeschneiderten Lösung ist die Nutzung eines bereits vorgefertigten KI-Teamkollegen (AI Teammate).

Dies ist das Modell, das von Plattformen wie eesel AI verwendet wird. Sie bündeln die Fähigkeiten fortschrittlicher Modelle in einem KI-Teamkollegen, der schnell implementiert werden kann.

Dieser Ansatz adressiert einige der Herausforderungen beim Eigenbau:

-

Planbare Preise: Einige Plattformen rechnen nicht pro Token ab. Ihre Pläne basieren auf monatlichen Interaktionen für kalkulierbare Kosten. Der Team-Plan beginnt bei 239 $/Monat für 1.000 Interaktionen.

-

Vereinfachte Einrichtung: Ein KI-Teamkollege kann eingebunden werden, indem man ihn mit einem Helpdesk wie Zendesk oder Intercom verbindet. Er kann aus vorhandenen Daten wie alten Tickets und Hilfeartikeln lernen, oft ohne dass Engineering-Ressourcen benötigt werden.

-

Integrierte Plattform: Diese Plattformen bieten oft Funktionen wie die autonome Ticketlösung mit einem KI-Agenten oder Antwortunterstützung mit einem KI-Copiloten. Dies ermöglicht den Zugriff auf die Fähigkeiten von Modellen wie Opus 4.5 innerhalb eines integrierten Systems.

-

Anpassbarkeit: Diese Tools bieten oft mehr Anpassungsmöglichkeiten als Standardlösungen. Wie Alton Ong von EntryLevel sagte: „Wir haben versucht, Intercom Fin zu nutzen, konnten es aber nicht anpassen. Jetzt haben wir 3 eesel AI-Agenten in Intercom, die Anfragen triagieren und beantworten.“

Für eine detailliertere Aufschlüsselung, wie die Preisgestaltung und Leistung von Claude Opus 4.5 in realen Anwendungsfällen abschneiden, bietet das folgende Review wertvolle Einblicke.

Ist die Preisgestaltung von Claude Opus 4.5 gerechtfertigt?

Claude Opus 4.5 ist ein leistungsstarkes Modell, und sein Preispunkt macht es zu einer praktikablen Option für viele verschiedene Projekte. Durch die Nutzung von Funktionen wie Prompt-Caching und der Batch-API kann es kosteneffizient sein, insbesondere bei komplexen Aufgaben, bei denen die Leistung des Modells von Vorteil ist.

Für Teams mit den nötigen Engineering-Ressourcen und der Zeit, eine eigene KI-Lösung zu entwickeln, ist Opus 4.5 ein starker Kandidat. Seine Leistung ist bemerkenswert.

Für viele Unternehmen kann der Prozess der Entwicklung eines eigenen KI-Agenten jedoch ressourcenintensiv sein. Die damit verbundenen Kosten für Entwicklung und Wartung sind wichtige Faktoren, die zusätzlich zum Token-Preis berücksichtigt werden müssen.

Für Unternehmen, die KI für den Kundenservice schnell implementieren möchten, bietet eine Plattform wie eesel AI einen direkteren Weg. Sie stellt die Fähigkeiten fortschrittlicher KI-Modelle in einem sofort einsatzbereiten Format zur Verfügung.

Erfahren Sie, wie eesel Ihren Support mit klarer, vorhersehbarer Preisgestaltung automatisieren kann. Starten Sie noch heute Ihre kostenlose Testversion.

Häufig gestellte Fragen

Die Preise für Claude Opus 4.5 sind deutlich niedriger als bei seinem Vorgänger. Zum Beispiel fielen die Preise für Eingabe-Token von 15 $ auf 5 $ pro Million und für Ausgabe-Token von 75 $ auf 25 $ pro Million, was es für komplexe Aufgaben viel erschwinglicher macht.

Prompt-Caching kann Ihre Kosten bei wiederholten Eingaben um bis zu 90 % senken. Sie zahlen eine kleine einmalige Gebühr für das Speichern eines Prompts, und nachfolgende Verwendungen dieses Prompts werden zu einer viel niedrigeren Rate berechnet (0,50 $ pro Million Token statt 5 $). Dies ist ideal für Anwendungen mit wiederkehrenden Anweisungen.

Ja, die Batch-API von Anthropic bietet einen Rabatt von 50 % auf die Standardpreise von Claude Opus 4.5. Sie ist für Aufgaben konzipiert, die keine sofortige Antwort erfordern, sodass Sie die Kosten für umfangreiche, asynchrone Aufträge halbieren können.

Die API-Preisgestaltung ist nutzungsbasiert und berechnet pro Million Eingabe- und Ausgabe-Token, was am besten für die Entwicklung eigener Anwendungen geeignet ist. Abonnementpläne (wie Pro und Team) bieten eine monatliche Pauschalgebühr für den direkten Chat-Zugriff auf das Modell und gewährleisten so planbare Kosten für die rein konversationelle Nutzung.

Nicht immer. Während die Kosten pro Token wichtig sind, stellen die Gesamtkosten des Betriebs (Total Cost of Ownership) einen größeren Faktor dar. Dazu gehören Entwicklungszeit, Ingenieursgehälter und laufende Wartung. Für einige Anwendungsfälle kann eine Plattform mit vorhersehbaren monatlichen Gebühren kosteneffizienter sein, als eine Lösung mit roher API-Anbindung von Grund auf neu zu bauen.

Die Standard-API-Raten betragen 5 $ pro Million Eingabe-Token (die Daten, die Sie an das Modell senden) und 25 $ pro Million Ausgabe-Token (die Daten, die das Modell als Antwort generiert).

Share this article

Article by

Kenneth Pangan

Kenneth Pangan ist seit über zehn Jahren als Autor und Vermarkter tätig. Er teilt seine Zeit zwischen Geschichte, Politik und Kunst auf, unterbrochen von seinen Hunden, die regelmäßig Aufmerksamkeit fordern.