Ich habe 5 Alternativen zu Claude Opus 4.5 getestet: Hier ist die beste KI zum Programmieren im Jahr 2026

Kenneth Pangan

Katelin Teen

Zuletzt bearbeitet January 6, 2026

Claude Opus 4.5 ist ein leistungsstarkes Modell für anspruchsvolle Programmieraufgaben und komplexe, agenten-basierte Tätigkeiten. Diese Fähigkeiten haben jedoch ihren Preis. Bei API-Kosten von 5 $ pro Million Input-Token und 25 $ pro Million Output-Token können sich die Ausgaben schnell summieren. Für Einzelentwickler, kleine Teams oder budgetbewusste Unternehmen können diese Kosten zu einem echten Hindernis werden.

Opus ist jetzt zu teuer, es hätte wirklich nur das 1,6-fache kosten sollen. Nun ja, es war schön, solange es anhielt

Dies hat zur Suche nach praktischen Alternativen geführt, die ein ausgewogenes Verhältnis zwischen Leistung und Kosten bieten. In diesem Artikel bewerten wir fünf führende Konkurrenten anhand von realen Programmier-Herausforderungen – von einfachen Funktionen bis hin zu komplexen Softwareprojekten mit mehreren Dateien.

Wir werden GPT-5.2 Codex, Gemini 3 Pro, Devstral 2, GLM-4.7 und MiniMax M2.1 im Detail analysieren. Dieser Vergleich soll Ihnen helfen, den richtigen KI-Partner für Ihren Workflow und Ihr Budget auszuwählen.

Was ist Claude Opus 4.5 und warum sollte man Alternativen in Betracht ziehen?

Opus 4.5 gilt als ein Spitzenmodell, insbesondere für professionelle Entwickler. Es schneidet in Programmier-Benchmarks hervorragend ab und erreicht beeindruckende 80,9 % bei SWE-bench Verified. Sein massives Kontextfenster (Context Window) von 200.000 Token ermöglicht es ihm, lange, komplexe Aufgaben ohne Leistungseinbußen zu bewältigen. Seine neuen hybriden Reasoning-Fähigkeiten (logisches Schlussfolgern) sind zudem eine große Hilfe bei besonders kniffligen Problemen.

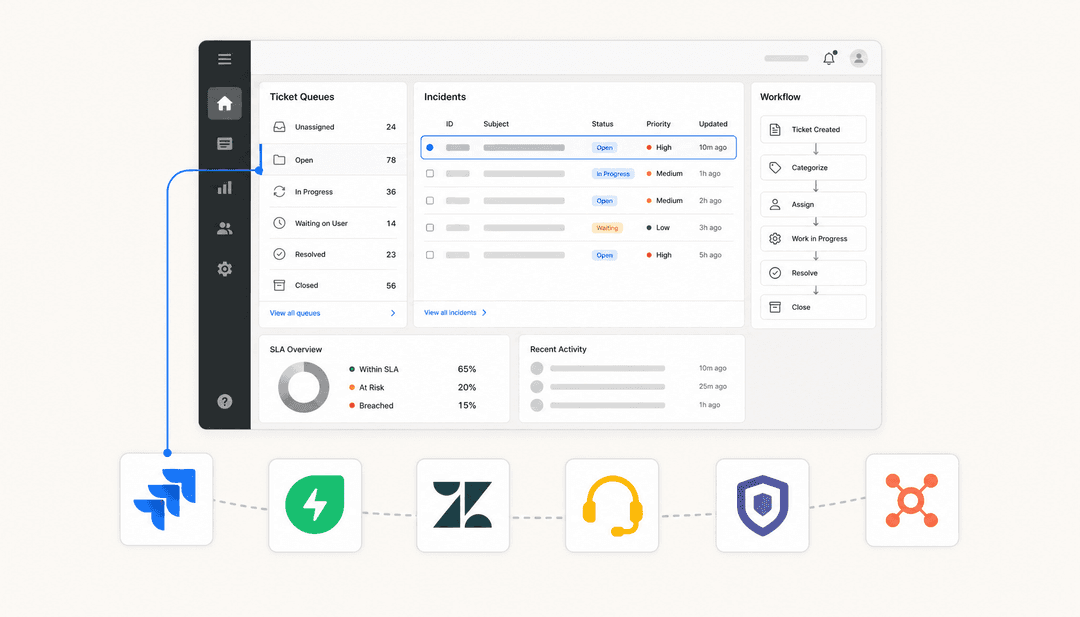

Dies bringt uns zum Hauptgrund, Alternativen in Betracht zu ziehen: die Kosten. Die API-Preise liegen höher als bei vielen Mitbewerbern. Obwohl das Modell leistungsstark ist, können diese Kosten schnell eskalieren, insbesondere wenn Sie viele agenten-basierte Workflows oder Aufgaben mit hohem Volumen ausführen. Diese Preisstruktur ist ein wichtiger Faktor für Teams, die umfangreiche Prozesse automatisieren. Diese Infografik veranschaulicht das Abwägen zwischen den High-End-Fähigkeiten und den Premium-Kosten – ein entscheidender Grund für die Erkundung von Claude Opus 4.5-Alternativen.

Kriterien für die Bewertung von Claude Opus 4.5-Alternativen

Die Auswahl einer geeigneten Alternative erfordert mehr als nur den Blick auf die höchsten Leistungsmetriken. Es bedarf eines Gleichgewichts aus Schlüsselfaktoren, die den täglichen Entwicklungsprozess beeinflussen. Darauf habe ich geachtet:

-

Programmier- & Reasoning-Leistung: Wie gut programmiert die KI tatsächlich? Ich spreche von komplexen Software-Engineering-Aufgaben über mehrere Dateien hinweg. Um objektiv zu bleiben, beziehe ich mich auf Ergebnisse anerkannter Benchmarks wie SWE-bench Verified und Terminal-Bench 2.0.

-

Workflow-Integration: Wie gut fügt sich das Modell in Ihr Setup ein? Lässt es sich reibungslos in eine IDE wie VS Code integrieren oder handelt es sich eher um ein Kommandozeilen-Tool? Je weniger Reibungsverluste, desto besser.

-

Kosteneffizienz: Ich habe die Kosten pro Million Token verglichen, um den Gesamtwert zu beurteilen und wirtschaftliche Lösungen zu identifizieren.

-

Flexibilität & Kontrolle: Unterstützt die Alternative Open-Weight-Modelle, die Sie lokal ausführen können, um besseren Datenschutz, individuelle Anpassungen und mehr Kontrolle zu erhalten?

Ein Vergleich der besten Claude Opus 4.5-Alternativen

Diese Tabelle bietet einen Überblick über die wichtigsten Spezifikationen der einzelnen Modelle.

| Modell | Hauptstärke | SWE-Bench Verified | Kontextfenster | Kosten (Input/Output pro 1 Mio. Token) |

|---|---|---|---|---|

| GPT-5.2 Codex | Agenten-Coding & Cybersicherheit | 80,0 % | 128K | 1,75 $ / 14,00 $ |

| Gemini 3 Pro | Multimodal & langer Kontext | 74,2 % | Bis zu 2M | Über Google AI Studio |

| Devstral 2 | Open-Weight & Fokus auf Agenten | 53,8 % | 32K | Über Mistral Platform |

| GLM-4.7 | „Deep Thinking“ & Kosteneffizienz | 73,8 % | 205K | 0,60 $ / 2,20 $ |

| MiniMax M2.1 | Mehrsprachigkeit & UI-Generierung | 61,0 % (M2) | ~200K | 0,30 $ / 1,20 $ |

Die 5 besten Alternativen zu Claude Opus 4.5 im Jahr 2026

Jedes dieser Modelle hat einzigartige Stärken. Die ideale Wahl hängt von Ihren spezifischen Projektanforderungen und Prioritäten ab.

1. GPT-5.2 Codex

GPT-5.2 Codex ist das Modell von OpenAI, das speziell für professionelles Software-Engineering entwickelt wurde. Es eignet sich für anspruchsvolle Aufgaben wie groß angelegte Refactorings (Code-Überarbeitungen), komplexe Migrationen und präventive Cybersicherheitsaufgaben.

Es erbringt eine extrem hohe Leistung und erreicht beeindruckende 80,0 % bei SWE-bench Verified sowie 64,0 % bei Terminal-Bench 2.0. Seine Vision-Fähigkeiten sind ebenfalls exzellent, was bedeutet, dass es UI-Designs und technische Diagramme mühelos interpretieren kann. Sein Hauptvorteil liegt in der starken logischen Argumentation und Zuverlässigkeit für ausgedehnte professionelle Workflows. Als proprietäres Modell kann es nicht angepasst oder lokal ausgeführt werden. Obwohl es erschwinglicher als Opus 4.5 ist, bleibt es eine Option im Premium-Preissegment.

Gpt4o wirkt manchmal wie betrunken, ignoriert wichtige Details und spuckt einfach irgendeinen Code aus. Ich korrigiere es wieder, und wieder, und wieder – dann haben wir vielleicht eine Lösung.

Preislich ist es über eine API für 1,75 $ pro Million Input-Token und 14,00 $ für Output-Token verfügbar. Das macht es für vergleichbare Aufgaben zu einer kostengünstigeren Option als Claude.

Bestens geeignet für: Professionelle Entwickler und Unternehmensteams, die an großen, geschäftskritischen Codebasen arbeiten und einen zuverlässigen und intelligenten Programmierpartner benötigen.

2. Gemini 3 Pro

Gemini 3 Pro ist Googles Beitrag im Bereich der KI-Programmierung. Die herausragenden Merkmale sind die nativen multimodalen Fähigkeiten und das riesige Kontextfenster.

Dieses Modell kann Videos und Bilder direkt zusammen mit Ihrem Code verstehen, was ein einzigartiges und hilfreiches Feature für bestimmte Entwicklungsarten ist. Es erzielte sehr wettbewerbsfähige 74,2 % bei SWE-bench Verified. Einige Analysen deuten darauf hin, dass es besonders gut für Aufgaben geeignet ist, bei denen das gesamte Projekt im Kontext gehalten werden muss. Seine Hauptstärken sind Geschwindigkeit und visuelles Verständnis, was es zu einer fantastischen Wahl für UI/UX-Arbeiten oder die Analyse visueller Assets macht. Die API-Preise sind in Googles Cloud-Plattformen integriert, was sich von den eigenständigen Preismodellen anderer Anbieter unterscheiden kann.

Sie erhalten Zugriff über Google AI Studio und Vertex AI. Für die individuelle Nutzung ist es über den Gemini Advanced Plan verfügbar.

Bestens geeignet für: Entwickler, die an Multimedia-Apps arbeiten, UI/UX-Designer oder alle, die visuelle Eingaben zusammen mit Code in hoher Geschwindigkeit verarbeiten müssen.

3. Devstral 2

Devstral 2 von Mistral AI ist ein hochmodernes Modell, das speziell für agenten-basiertes Software-Engineering entwickelt wurde, mit einem klaren Fokus auf Open-Source-Prinzipien.

Es wurde für Programmier-Agenten (Coding Agents) konzipiert und liefert für ein Open-Weight-Modell eine gute Leistung mit 53,8 % bei SWE-bench Verified. Es lässt sich zudem in gängige IDEs wie VSCode und JetBrains integrieren und passt somit direkt in bestehende Arbeitsabläufe. Ein entscheidender Vorteil ist seine offene und anpassbare Natur. Sie haben mehr Kontrolle und können es aus Datenschutz- oder Performance-Gründen sogar selbst hosten. Als spezialisiertes Werkzeug ist sein Ökosystem weniger ausgereift als das größerer Anbieter, und seine Benchmark-Ergebnisse liegen derzeit unter denen einiger führender proprietärer Modelle.

Es ist als Open-Weight-Modell zum Selbst-Hosten verfügbar oder kann über die Mistral-Plattform sowie Partner wie AWS, Azure und Google Cloud genutzt werden.

Bestens geeignet für: Entwickler, die die Kommandozeile lieben, einen Open-Source-KI-Agenten suchen oder ein leistungsstarkes Modell lokal ausführen möchten, um Datenschutz und volle Kontrolle zu gewährleisten.

4. GLM-4.7

GLM-4.7 von Zhipu AI lässt sich am besten als „denkendes“ Modell beschreiben. Es verfügt über eine Funktion, die es ihm ermöglicht, ein Problem zu durchdenken, bevor es eine Lösung generiert, was zu robusterem und logischerem Code führen kann.

Sein „Deep Thinking“-Modus kann in der API aktiviert werden, um die Stabilität bei langwierigen Aufgaben zu verbessern. Mit 73,8 % bei SWE-Bench liefert es starke Zahlen und verfügt über ein großzügiges Kontextfenster von 205.000 Token. Es bietet zudem Funktionen, die speziell für die Erstellung sauberer, moderner Benutzeroberflächen (UIs) optimiert sind. Der Hauptvorteil ist dieser explizite Denk-Schritt, der bei komplexen, mehrstufigen Workflows hilft. Dieser Prozess kann die Latenz erhöhen, aber der Denkprozess kann gestreamt werden, um die gefühlte Wartezeit zu verkürzen.

Die Preisgestaltung ist äußerst wettbewerbsfähig. Mit nur 0,60 $ pro Million Input-Token und 2,20 $ für Output ist es sehr kosteneffizient.

Bestens geeignet für: Teams, die komplexe KI-Agenten entwickeln, und Entwickler, die an kniffligen, mehrstufigen Programmierproblemen arbeiten, bei denen logische Kohärenz wichtiger ist als bloße Geschwindigkeit.

5. MiniMax M2.1

MiniMax M2.1 ist ein hocheffizientes Modell. Es glänzt bei der Programmierung in mehreren Sprachen und der UI/UX-Generierung, während es gleichzeitig eine der erschwinglichsten Optionen auf dem Markt ist.

Es bietet eine verbesserte Unterstützung für Sprachen jenseits von Python, einschließlich Rust, Java, Go und C++. Seine „Vibe Coding“-Funktion ist nützlich für die Erstellung hochwertiger Benutzeroberflächen, und es bietet Open-Source-Gewichte für die lokale Bereitstellung an. Es stellt sogar ein kompatibles Anthropic-API-Format zur Verfügung, um die Migration zu vereinfachen. Seine Hauptvorteile sind das hervorragende Preis-Leistungs-Verhältnis und die starke Unterstützung verschiedener Sprachen. Als effizientes MoE-Modell (Mixture of Experts) ist es sehr schnell, erreicht jedoch bei sehr tiefgehenden Einzelthemen möglicherweise nicht die Reasoning-Power größerer Modelle. Bei SWE-bench erreichte es solide 61,0 %.

Die Preise sind mit nur 0,30 $ pro Million Input-Token und 1,20 $ für Output extrem niedrig und bieten beträchtliche Fähigkeiten zu geringeren Kosten als Premium-Modelle.

Bestens geeignet für: Full-Stack-Entwickler, die in mehreren Sprachen arbeiten, Frontend-Ingenieure mit Fokus auf UI/UX und alle Teams, die eine leistungsstarke, kostengünstige und selbst hostbare Lösung suchen.

Für diejenigen, die diese Modelle in Aktion sehen möchten, bietet dieses Video einen praktischen Vergleich und diskutiert, welche Alternativen je nach Ihren spezifischen Programmierbedürfnissen am besten geeignet sein könnten.

So wählen Sie den richtigen KI-Assistenten aus

Es gibt nicht das eine „beste“ Modell für alle Anwendungsfälle. Die richtige Wahl hängt von der spezifischen Aufgabe ab. Für Komplexität auf Unternehmensebene ist GPT-5.2 eine geeignete Wahl. Für Geschwindigkeit und visuelle Workflows ist Gemini eine starke Option. Für Nutzer, die Wert auf Kontrolle und Open-Source-Modelle legen, ist Devstral eine praktikable Lösung, und für budgetbewusste Anwender bieten GLM-4.7 und MiniMax M2.1 ein hervorragendes Preis-Leistungs-Verhältnis.

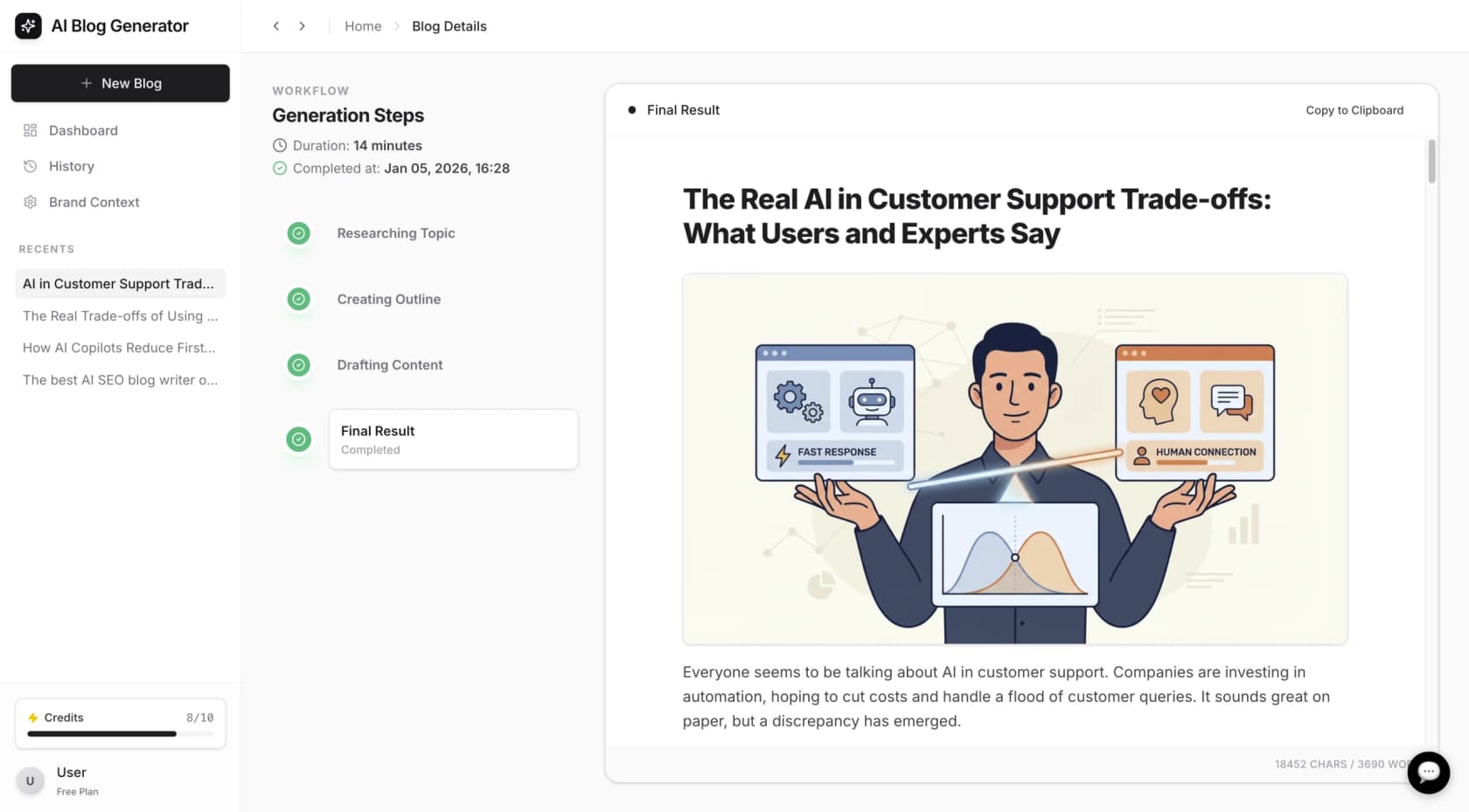

Eine empfohlene Praxis ist es, das richtige Werkzeug für die jeweilige Aufgabe zu verwenden. Diese universellen Programmierassistenten sind effektiv beim Schreiben von Code. Die Arbeit eines Entwicklers geht jedoch über das reine Programmieren hinaus. Sie müssen auch Dokumentationen verfassen, Blog-Beiträge zur Ankündigung neuer Funktionen erstellen und Fragen aus Ihrer Community beantworten. Für inhaltsbezogene Aufgaben kann ein spezialisiertes Tool effektiver sein.

Beispielsweise wird ein KI-Programmierassistent zum Erstellen einer Anwendung verwendet, während ein Tool wie der eesel AI Blog Writer genutzt werden kann, um Launch-Ankündigungen und technische Dokumentationen aus einem einzigen Schlüsselwort zu generieren. Solche Tools sind für die Erstellung von SEO-optimiertem Content konzipiert, sodass Programmierassistenten für ihren eigentlichen Zweck eingesetzt werden können: das Schreiben von Code.

Fazit: Ein hybrider Ansatz für KI-Programmierassistenten

Die KI-Programmierlandschaft im Jahr 2026 ist reichhaltig und vielfältig. Sich auf ein einziges, hochpreisiges Modell wie Claude Opus 4.5 zu verlassen, ist für viele Nutzer weder notwendig noch kosteneffizient.

Ein effektiver Workflow ist oft ein hybrider Ansatz. Dabei wird eine „Modell-Kette“ oder ein Multi-Tool-Ansatz verwendet. Nutzen Sie ein leistungsstarkes Modell wie GPT-5.2 für die Architekturplanung, ein schnelles wie Gemini für die Frontend-Iteration und ein kostengünstiges wie MiniMax für Routineaufgaben.

Ich nehme oft eine Antwort von Opus oder Gemini Advanced und füttere sie dann in GPT 4 ein, mit der Bitte, die Genauigkeit der anderen KI zu bewerten. Dann korrigiert es den Code oder was auch immer, und ich bringe es zurück zu Claude. Claude entschuldigt sich dann oft und behandelt mich wie ein Genie, weil ‚ich‘ einen besseren Weg gefunden habe.

Die Entwicklung von Software erfordert sowohl Programmierung als auch Kommunikation. Während diese KI-Assistenten die Entwicklung verbessern können, unterstützen andere Tools wie eesel AI bei Kommunikationsbedürfnissen. Von der Beantwortung interner Fragen mit unserem AI Internal Chat bis hin zur Erstellung all Ihrer kundenorientierten Inhalte mit unserem AI Blog Writer können Sie alle Bereiche abdecken.

Häufig gestellte Fragen

Für Startups mit begrenztem Budget sind GLM-4.7 und MiniMax M2.1 eine hervorragende Wahl. Sie bieten eine beeindruckende Leistung zu einem Bruchteil der Kosten von Premium-Modellen, mit API-Preisen ab 0,30 $ pro Million Input-Token.

Absolut. Devstral 2 ist ein leistungsstarkes Open-Weight-Modell, das genau für diesen Zweck entwickelt wurde. Sie können es auf Ihrer eigenen Infrastruktur ausführen und haben so die volle Kontrolle über Ihre Daten und Privatsphäre. MiniMax M2.1 bietet ebenfalls Open-Source-Gewichte für die lokale Bereitstellung an.

Wenn die Leistung bei komplexen Aufgaben auf Unternehmensebene Ihre oberste Priorität ist, ist GPT-5.2 Codex sehr stark. Es schneidet bei Benchmarks wie SWE-bench Verified fast so gut ab wie Opus 4.5 und ist für anspruchsvolles Software-Engineering konzipiert.

Ja, Gemini 3 Pro ist hier der Spitzenreiter. Seine nativen multimodalen Fähigkeiten ermöglichen es ihm, Videos und Bilder neben Code zu verarbeiten, was ihn perfekt für UI/UX-Arbeiten oder jede Entwicklung macht, die visuelle Assets einbezieht.

Der beste Ansatz ist, das Werkzeug auf die Aufgabe abzustimmen. Erwägen Sie ein Hybridmodell: Verwenden Sie ein Hochleistungsmodell wie GPT-5.2 für komplexe Architektur, ein schnelles Modell wie Gemini 3 Pro für das Frontend und ein kosteneffizientes Modell wie MiniMax M2.1 für Routine-Codierung.

MiniMax M2.1 ist eine großartige Option, wenn Sie mit mehreren Sprachen arbeiten. Es bietet verbesserte Unterstützung für Sprachen wie Rust, Java, Go und C++ und ist damit eine vielseitige Wahl für Full-Stack-Entwickler.

Share this article

Article by

Kenneth Pangan

Kenneth Pangan ist seit über zehn Jahren als Autor und Marketer tätig. Er teilt seine Zeit zwischen Geschichte, Politik und Kunst auf, wobei er immer wieder von seinen Hunden unterbrochen wird, die Aufmerksamkeit fordern.