Integrações do YouTube Live com GPT-Realtime-Mini

Kenneth Pangan

Stanley Nicholas

Last edited 30 outubro 2025

Expert Verified

A transmissão ao vivo em plataformas como o YouTube Live revolucionou a forma como as marcas se conectam com o seu público. Já não se trata apenas de falar para as pessoas. Agora, é uma via de mão dupla para demonstrações de produtos, workshops e sessões de perguntas e respostas ao vivo. É uma ótima maneira de construir uma comunidade real em torno do que você faz.

Mas, sejamos realistas, organizar um evento ao vivo pode parecer um malabarismo com motosserras. O anfitrião está a falar e, enquanto isso, o chat está a explodir com perguntas, comentários e feedback. Tentar gerir tudo isso manualmente é receita para uma dor de cabeça, mesmo para os moderadores mais experientes. Boas perguntas perdem-se e você perde oportunidades de se conectar com as pessoas devido ao volume.

É aqui que alguns dos modelos de IA mais recentes começam a fazer a diferença. Ferramentas como o "gpt-realtime-mini" da OpenAI são criadas para processar áudio e texto quase instantaneamente, tornando possível o suporte inteligente e em tempo real.

Neste guia, vamos explorar tudo sobre as integrações do YouTube Live com o GPT-Realtime-Mini. Abordaremos as suas principais funcionalidades, como a sua equipa de suporte as pode usar na prática e os obstáculos reais que encontrará se tentar construir uma do zero.

O que são as integrações do YouTube Live com o GPT-Realtime-Mini?

Basicamente, esta integração permite criar um assistente inteligente que pode participar na sua transmissão ao vivo e agir como um moderador humano, só que muito mais rápido e com todo o conhecimento da sua empresa na ponta dos dedos. Para entender, vamos analisar as partes que a compõem.

Componentes principais das integrações do YouTube Live com o GPT-Realtime-Mini

-

YouTube Live: Este é o seu palco. É onde você transmite o seu vídeo e onde o seu público sintoniza para assistir e conversar. Tornou-se o local para tudo, desde eventos de compras ao vivo a encontros comunitários.

-

GPT-Realtime-Mini da OpenAI: Este é o cérebro da operação. É um modelo de IA conversacional projetado para ser incrivelmente rápido. Ao contrário dos modelos mais antigos que precisavam de converter a fala em texto antes de poderem "pensar", este lida diretamente com o áudio. O resultado é uma conversa muito mais fluida e de baixa latência, que parece menos que você está a falar com uma máquina.

-

A Integração: Esta é a cola que une tudo. A integração é a configuração técnica que permite que uma IA alimentada pelo "gpt-realtime-mini" ouça o áudio do anfitrião da transmissão e leia as mensagens digitadas no chat ao vivo. Ao processar ambos ao mesmo tempo, a IA obtém o contexto completo e pode dar respostas que realmente fazem sentido.

Principais funcionalidades e capacidades das integrações do YouTube Live com o GPT-Realtime-Mini

Não estamos a falar apenas de colocar um simples chatbot de texto no chat ao vivo. A tecnologia aqui é muito mais avançada, dando à IA um tipo de consciência que não era possível há pouco tempo.

Transcrição e compreensão em tempo real

A IA faz mais do que apenas ler o chat; ela realmente "ouve" o que o anfitrião está a dizer. Transforma as palavras faladas da transmissão em texto à medida que acontecem, o que significa que compreende todo o contexto do evento.

Por exemplo, se um anfitrião disser: "E este novo modelo tem uma autonomia de bateria de mais de 24 horas", mas não escrever isso em lado nenhum, a IA ainda assim capta a informação. Portanto, quando um espetador pergunta no chat: "Quanto tempo dura a bateria?", a IA pode responder com confiança sem que um humano tenha de repetir a informação.

Respostas de latência ultrabaixa

Numa transmissão ao vivo, o tempo é tudo. "Tempo real" aqui significa que o modelo pode dar uma resposta em milissegundos, geralmente em menos de meio segundo. É rápido o suficiente para parecer uma conversa normal. Você pergunta algo e obtém uma resposta imediatamente. Isso mantém a energia alta e evita aquelas pausas constrangedoras que podem estragar o clima.

Compreensão multimodal

Esse é apenas um termo técnico para uma IA que pode processar diferentes tipos de informação ao mesmo tempo. Por enquanto, isso significa áudio da transmissão e texto do chat. Mas provavelmente consegue ver para onde isto se encaminha. Em breve, estes modelos serão capazes de analisar o próprio feed de vídeo, identificando produtos no ecrã ou entendendo o que o anfitrião está a fazer.

Chamada de função avançada

Esta é a funcionalidade que transforma a IA de um simples bot de perguntas e respostas num assistente genuinamente útil. A chamada de função permite que a IA se conecte a outros sistemas da sua empresa para obter informações ou até mesmo executar tarefas.

Digamos que um espetador pergunta: "Este novo software é compatível com o meu hardware antigo?" Em vez de uma resposta genérica como "depende", a IA pode usar uma chamada de função para verificar as especificações exatas na sua base de conhecimento do Confluence ou na base de dados de produtos e dar uma resposta clara e direta ali mesmo no chat.

Este vídeo da OpenAI demonstra as capacidades de fala conversacional em tempo real dos seus modelos avançados, exibindo as respostas de baixa latência discutidas.

Casos de uso práticos para integrações do YouTube Live com o GPT-Realtime-Mini

Quando combina todas estas funcionalidades, pode transformar uma experiência de visualização passiva numa interativa que ajuda os clientes e pode até mesmo impulsionar as vendas.

-

Moderação e suporte de P&R ao vivo: O benefício mais claro é lidar com o fluxo interminável de perguntas comuns. A IA pode responder instantaneamente a coisas como "Isto vai ser gravado?" ou "Enviam para o Canadá?". Isso liberta os seus moderadores humanos para participarem em conversas mais complexas e de alto valor.

-

Informações de produtos em tempo real e assistência de vendas: Durante uma demonstração de produto ao vivo, a IA pode ser um assistente de vendas incrível que nunca se cansa. Pode obter especificações técnicas, verificar o inventário através da integração com plataformas como o Shopify e até mesmo colocar links de compra no chat no momento certo.

-

Captura e qualificação automatizada de leads: Pode treinar a IA para identificar sinais de compra nos comentários do chat. Quando alguém escreve "Isto parece perfeito para a minha equipa, mas tenho algumas perguntas sobre os preços", a IA pode interagir, fazer algumas perguntas de qualificação e oferecer-se para agendar uma chamada de acompanhamento com um representante de vendas.

-

Geração de conteúdo pós-transmissão: O trabalho não termina quando clica em "Terminar Transmissão". A IA pode criar automaticamente uma transcrição completa com marcações de tempo importantes, um resumo rápido do evento e uma lista das perguntas mais comuns. Isto ajuda a transformar um evento ao vivo único numa peça de conteúdo útil para publicações de blog, FAQs ou guias de formação.

Os desafios de uma abordagem 'faça você mesmo' vs. usar uma plataforma

Ok, então você vê o potencial. A próxima pergunta é: construir isto você mesmo ou usar uma plataforma? A rota do 'faça você mesmo' pode parecer atraente, mas está cheia de dores de cabeça ocultas.

A realidade de uma abordagem 'faça você mesmo'

-

É seriamente complicado: Isto não se trata apenas de fazer uma simples chamada de API. Uma integração pronta para produção exige um conhecimento sério em protocolos de tempo real como o WebRTC, gestão de streams de áudio, tratamento de conexões WebSocket e construção de um sistema que não falhe sob pressão.

-

Sobrecarga de contexto e dados: Como os programadores em fóruns como o Stack Overflow descobriram, uma transmissão ao vivo longa gera uma tonelada de dados de texto e áudio. Uma solução personalizada precisa de uma forma inteligente de gerir todo esse contexto. Se não o fizer, as respostas da IA ficarão lentas, confusas ou simplesmente erradas à medida que a transmissão se prolonga.

-

Manutenção elevada e custos imprevisíveis: Quando você constrói, você é o dono. Isso significa que é responsável pelo tempo de atividade do servidor, correções de segurança e todas as pequenas alterações que a OpenAI faz na sua API. Os custos também são uma grande incógnita. O preço da API Realtime da OpenAI baseia-se no uso de tokens (cerca de $32 por milhão de tokens de entrada e $64 por milhão de tokens de saída para o "gpt-realtime"). A sua conta pode explodir durante uma transmissão popular, tornando difícil fazer um orçamento.

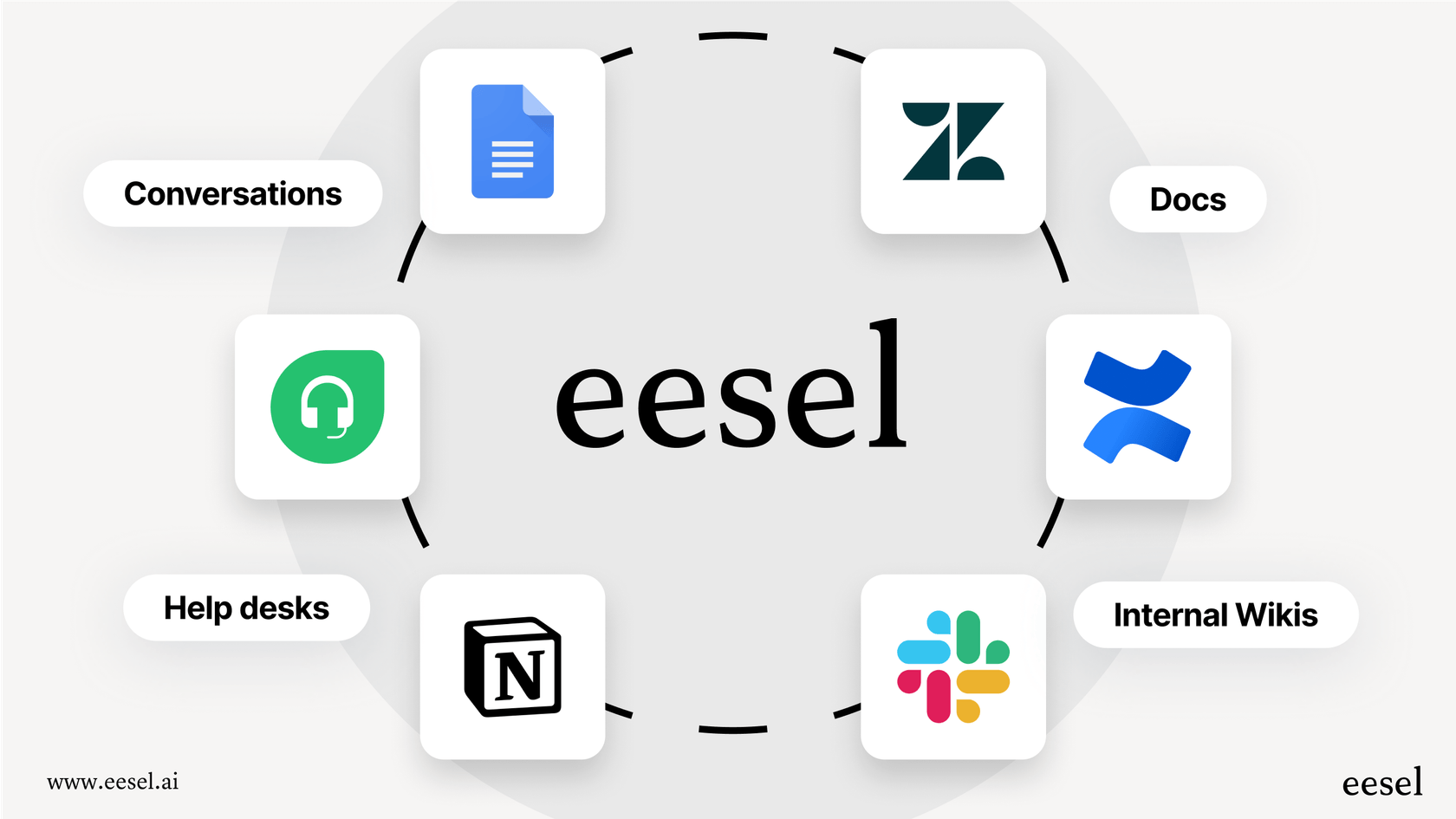

Como a eesel AI oferece um caminho mais simples

-

Comece em minutos, não em meses: Em vez de gastar meses de tempo de engenharia num projeto 'faça você mesmo', a eesel AI foi projetada para ser self-service. Pode conectar as suas fontes de conhecimento, ajustar a personalidade da sua IA e lançar um agente em minutos sem tocar numa única linha de código.

-

Conhecimento unificado e gerido: A eesel AI foi construída para trabalhar com grandes e dispersos conjuntos de informação. Oferece integrações de um clique com todos os locais onde o seu conhecimento já está armazenado, como os seus tickets de help desk, Google Docs e Confluence. Utiliza essa informação para fornecer respostas que são consistentemente alinhadas com a marca e precisas, poupando-lhe o trabalho de construir um pipeline de dados complexo.

-

Controlo total e preços previsíveis: Com a eesel AI, obtém um motor de fluxo de trabalho completo para controlar exatamente como a sua IA se comporta, o que pode responder e quando precisa de passar uma conversa para um humano. Além disso, o preço é simples, uma taxa mensal fixa. Sem contas surpresa, não importa o quão ocupado fique.

| Funcionalidade | Construindo com a API GPT-Realtime-Mini (DIY) | Usando a eesel AI |

|---|---|---|

| Tempo de Configuração | Semanas a meses de trabalho de engenharia | Ao vivo em minutos |

| Conhecimento Técnico | Exige especialistas em IA e streaming | Nenhum necessário, totalmente self-service |

| Gestão de Conhecimento | É preciso construir pipelines de dados personalizados | Integrações de um clique com as suas fontes existentes |

| Manutenção | Gestão contínua de servidores e atualizações de API | Totalmente gerido pela eesel AI |

| Custo | Imprevisível, com base no uso de tokens | Transparente, taxa mensal fixa |

| Escalabilidade | Você tem de construir e gerir a escalabilidade | Escala automaticamente com as suas necessidades |

O futuro do suporte ao vivo com as integrações do YouTube Live com o GPT-Realtime-Mini

As integrações do YouTube Live com o GPT-Realtime-Mini são mais do que apenas uma tecnologia interessante; são um vislumbre do futuro do suporte ao cliente proativo e conversacional. Esta tecnologia permite que as marcas estejam presentes onde os seus clientes estão e ofereçam ajuda real, em tempo real.

Mas o poder desta tecnologia é igualado pela sua complexidade. Construir e manter uma solução personalizada é uma tarefa gigantesca que simplesmente não é prática para a maioria das equipas.

O caminho mais inteligente é usar uma plataforma que trata de todo o trabalho pesado por si. A eesel AI oferece uma forma simples e self-service de lançar poderosos agentes de IA que aprendem com o conhecimento exclusivo da sua empresa, transformando o potencial de vanguarda em algo que pode usar hoje.

Perguntas frequentes

Estas integrações criam um assistente de IA para a sua transmissão ao vivo, processando tanto o áudio falado do anfitrião quanto o chat de texto dos espetadores. Eles atuam como um moderador super-rápido, usando o conhecimento da sua empresa para fornecer suporte instantâneo e contextual, transformando a visualização passiva em envolvimento interativo.

As funcionalidades chave incluem transcrição e compreensão em tempo real do áudio da transmissão ao vivo, respostas de latência ultrabaixa, compreensão multimodal de áudio e texto, e chamada de função avançada. Estas permitem que a IA entenda o contexto completo e interaja com outros sistemas de negócio.

Com certeza. Elas destacam-se na moderação de P&R ao vivo, fornecendo informações de produtos em tempo real, assistência de vendas e captura automatizada de leads durante demonstrações de produtos. Após a transmissão, também podem gerar conteúdo como transcrições e resumos, tornando os eventos ao vivo mais valiosos.

Construir por conta própria é seriamente complicado, exigindo conhecimento em protocolos de tempo real e gestão de API. Você enfrentará problemas de sobrecarga de contexto e dados, alta manutenção e custos imprevisíveis com base no uso de tokens, tornando-se uma tarefa gigantesca para a maioria das equipas.

Através de chamadas de função avançadas e integração com as suas fontes de conhecimento existentes, a IA pode aceder a bases de dados, artigos de ajuda e detalhes de produtos. Isto permite-lhe obter informações específicas instantaneamente e fornecer respostas precisas e alinhadas com a marca às perguntas dos espetadores.

Com uma plataforma dedicada como a eesel AI, você pode conectar as suas fontes de conhecimento e lançar um agente de IA em minutos, em vez de meses. Esta abordagem self-service evita o extenso trabalho de engenharia necessário para uma solução personalizada, permitindo uma implementação rápida.

As soluções 'faça você mesmo' têm custos imprevisíveis, já que a API Realtime da OpenAI é cobrada pelo uso de tokens, que pode disparar durante transmissões populares. Plataformas geridas como a eesel AI oferecem taxas mensais fixas e transparentes, proporcionando um orçamento previsível sem contas surpresa.

Compartilhe esta postagem

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.