API de Asistentes de OpenAI (2026): Baja y alternativas

Kenneth Pangan

Katelin Teen

Última edición October 14, 2025

Cuando OpenAI lanzó por primera vez su API de Asistentes (Assistants API), se sintió como algo bastante importante para los desarrolladores. La idea era bastante simple: darnos una forma de construir agentes de IA con estado inteligentes sin tener que hacer malabarismos con todas las partes complicadas, como el historial de conversaciones. Muchos de nosotros en el mundo del soporte y desarrollo estábamos genuinamente emocionados.

Pero como muchas herramientas nuevas y brillantes, la realidad resultó ser un poco más complicada. Si bien la API ciertamente redujo la barrera de entrada, vino con su propio conjunto de dolores de cabeza, especialmente para cualquiera que intentara construir algo que pudiera manejar el uso en el mundo real. Estamos hablando de costos impredecibles que podrían salirse de control, un rendimiento torpe y la sensación de que realmente no estabas al volante.

Y ahora, hay un nuevo desarrollo: OpenAI está oficialmente dando de baja la API de Asistentes. Está siendo reemplazada por una nueva "API de Responses" (Responses API), y la anterior se apagará para siempre en 2026.

Entonces, ¿qué significa todo esto para ti? En esta guía, repasaremos qué era la API de Asistentes de OpenAI, por qué está en camino de desaparecer, los problemas con los que los desarrolladores seguían encontrándose y qué sigue. Más importante aún, te mostraremos una forma más directa, estable y potente de construir los agentes de IA que tu negocio realmente necesita.

¿Qué era la API de Asistentes de OpenAI?

El punto principal de la API de Asistentes de OpenAI era dar a los desarrolladores un kit de herramientas para construir asistentes de IA directamente en sus propias aplicaciones. Antes de que apareciera, si querías un chatbot que realmente pudiera recordar de lo que acababas de hablar, tenías que construir ese sistema de memoria desde cero. La API de Asistentes prometía encargarse de eso por ti.

Su mayor punto de venta era que era una API "con estado" (stateful). Esto solo significa que gestionaba el historial de conversaciones (que llamaba "hilos" o threads), te daba acceso a herramientas preconstruidas como Code Interpreter y File Search (una versión básica de Generación Aumentada por Recuperación, o RAG), y te permitía llamar a tus propias funciones para conectarte a otras herramientas.

Piénsalo como un kit de inicio para construir un chatbot. Te entregaba algunos componentes clave, como la memoria y las herramientas, para que no tuvieras que empezar desde cero. Esto hizo que fuera increíblemente rápido poner en marcha una prueba de concepto, que es exactamente por lo que recibió tanta atención de los desarrolladores y equipos que buscaban experimentar.

Todo se construyó en torno a tres ideas principales: Asistentes (Assistants), Hilos (Threads) y Ejecuciones (Runs). Profundicemos en qué son y los problemas que crearon.

Los componentes centrales y los desafíos de la API de Asistentes de OpenAI

Para entender realmente por qué se está reemplazando la API, primero tienes que comprender cómo funcionaba y dónde se quedaba corta.

Asistentes, hilos y ejecuciones: Los bloques de construcción de la API de Asistentes de OpenAI

Todo el sistema se basaba en una estructura simple, aunque un poco inflexible:

-

Asistente (Assistant): Este era el cerebro de la IA. Lo configurarías con un modelo específico (como GPT-4o), le darías algunas instrucciones ("Eres un agente de soporte amigable para una empresa de calzado") y le dirías qué herramientas tenía permitido usar.

-

Hilo (Thread): Esta era solo una conversación individual con un usuario. Cada vez que un usuario enviaba un mensaje, lo agregabas al hilo. La API almacenaba todo el intercambio aquí.

-

Ejecución (Run): Esta era la acción de decirle al asistente que leyera el hilo y creara una respuesta. Iniciabas una "ejecución" (run), esperabas a que terminara y luego tomabas el nuevo mensaje del hilo.

Todo esto suena lógico en el papel, pero en la práctica, creó algunos obstáculos serios para cualquiera que construyera una aplicación real.

Los costos ocultos: Cómo el uso de tokens se descontrola

El mayor, y con diferencia el más doloroso, problema con la API de Asistentes de OpenAI fue su precio. Cada vez que un usuario enviaba un mensaje, la API reprocesaba todo el hilo de conversación, incluido el texto completo y sin abreviar de cualquier archivo que hubieras subido.

Hagamos eso real. Imagina que un cliente sube un PDF de 20 páginas para hacer algunas preguntas sobre tu producto. Si hacen cinco preguntas, no solo estás pagando por los tokens en sus cinco preguntas y las cinco respuestas de la IA. Estás pagando para procesar ese PDF completo de 20 páginas cinco veces separadas, además de un historial de conversación que sigue creciendo.

Los desarrolladores descubrieron esto por las malas.

el uso de *tokens* se descontrola muy rápidamente... seguirás pagando por eso con cada pregunta.

Descubrí bastante rápido usando esta API que el costo se descontrola para cualquier cosa que no sea una sesión corta sin documentos.

Esto hizo que fuera casi imposible para las empresas predecir sus costos, convirtiendo lo que debería haber sido una herramienta útil en un juego de adivinanzas financiero. Una forma mucho mejor de hacerlo es una plataforma con costos predecibles. Por ejemplo, una solución como eesel AI ofrece precios transparentes basados en tu uso general. No te golpean con tarifas por resolución que efectivamente te penalizan por tener conversaciones más largas y útiles con tus clientes.

El juego de la espera: Falta de streaming y dependencia del sondeo

El otro gran dolor de cabeza fue el rendimiento. La API de Asistentes no admitía streaming, que es la tecnología que da a los chatbots modernos ese efecto de escritura en vivo, palabra por palabra.

En cambio, los desarrolladores tenían que usar una solución alternativa torpe llamada sondeo. Iniciabas una "ejecución" (run) y luego tenías que hacer ping repetidamente a la API, básicamente preguntando: "¿Ya terminaste? ¿Qué tal ahora?" Solo cuando se generaba la respuesta completa podías finalmente tomarla y mostrarla al usuario.

Para un cliente que espera ayuda, esto se siente lento y roto. Solo están mirando una pantalla en blanco o un icono giratorio, preguntándose si está pasando algo. Está a un mundo de distancia de la sensación instantánea e interactiva de herramientas como ChatGPT. Este era un problema conocido, pero fue un factor decisivo para cualquiera que intentara construir una experiencia de chat de calidad en tiempo real.

Las plataformas modernas de soporte de IA están construidas para el tipo de interacción instantánea que los clientes ahora esperan. Los agentes de IA y los chatbots de eesel AI están diseñados para el streaming desde cero, ocultando todos estos detalles técnicos para que puedas concentrarte en brindar a tus usuarios una gran experiencia.

Un cambio importante: Por qué se está reemplazando la API de Asistentes de OpenAI

Dados todos estos desafíos, no es demasiado sorprendente que OpenAI decidiera volver a la mesa de dibujo. El resultado es una revisión completa y un nuevo camino a seguir para los desarrolladores.

De la API de Asistentes de OpenAI a Responses: ¿Qué está cambiando?

Según la documentación oficial de OpenAI, la API de Asistentes ahora está obsoleta y se cerrará por completo el 26 de agosto de 2026. Está siendo reemplazada por la nueva API de Responses.

Esto es más que solo un cambio de nombre; es una forma completamente diferente de construir. Aquí hay un vistazo rápido a cómo los conceptos antiguos se mapean a los nuevos:

| Antes ("API de Asistentes") | Ahora ("API de Responses") | ¿Por qué el cambio? |

|---|---|---|

| "Asistentes" (Assistants) | "Prompts" | Los prompts son más fáciles de gestionar, controlar las versiones a través de un panel de control y mantenerlos separados del código de tu aplicación. |

| "Hilos" (Threads) | "Conversaciones" (Conversations) | Las conversaciones son más flexibles. Pueden almacenar diferentes tipos de "elementos" como mensajes y llamadas a herramientas, no solo texto plano. |

| "Ejecuciones" (Runs) | "Responses" (Responses) | Esto se mueve a un modelo de solicitud/respuesta mucho más simple. Envías entradas, obtienes salidas y tienes mucho más control. |

Desde el punto de vista de OpenAI, el nuevo modelo es más simple y da a los desarrolladores más flexibilidad. Pero también viene con una trampa bastante grande.

Lo que esto significa para los desarrolladores que construyen en la API de Asistentes de OpenAI

Si bien la nueva API te da más poder, también pone más trabajo en tu plato. La promesa original de la API de Asistentes, de manejar todo el estado de la conversación por ti, se ha ido. Ahora, depende de ti gestionar el historial de conversaciones y orquestar el intercambio para el uso de herramientas.

Esto crea un gran riesgo para cualquier empresa que haya construido un sistema de producción en la API de Asistentes. Ahora están considerando un gran proyecto de migración solo para evitar que su aplicación se rompa. Este tipo de inestabilidad de la plataforma es una gran señal de alerta para cualquier empresa que dependa de una API de terceros para una parte central de su negocio.

Aquí es donde tener una capa de abstracción realmente muestra su valor. Una plataforma como eesel AI actúa como un búfer estable entre tu negocio y el mundo en constante cambio de las API fundacionales. Cuando OpenAI hace un cambio importante como este, eesel AI gestiona el trabajo de migración entre bastidores. Tus agentes de IA siguen funcionando sin problemas sin que tengas que reescribir una línea de código, lo que te da estabilidad sobre una base volátil.

Una mirada más de cerca a los precios y características de la API de Asistentes de OpenAI

Incluso antes de que se anunciara la baja, el costo y las limitaciones de las herramientas integradas eran una fuente común de frustración para los desarrolladores.

Comprender los precios de las herramientas de la API de Asistentes de OpenAI

Además de los costos salvajes de los tokens, la API de Asistentes tenía tarifas separadas para sus herramientas especiales:

-

Code Interpreter: Con un precio de $0.03 por sesión. Una sesión dura una hora, lo que suena simple, pero puede complicarse y ser costoso de gestionar cuando tienes cientos o miles de personas hablando con tu bot a la vez.

-

File Search (Almacenamiento): Con un precio de $0.10 por GB por día, con el primer gigabyte gratis. Este costo es para los datos vectorizados, no para el tamaño del archivo original, lo que lo convierte en otro gasto difícil de predecir.

Cuando agregas estas tarifas a los costos descontrolados de los tokens por reprocesar el historial de conversaciones, terminas con un modelo de precios que era todo menos amigable para los negocios.

Limitaciones de herramientas como File Search

Se suponía que la herramienta File Search era una forma fácil de dar a un asistente conocimiento de tus documentos. En realidad, vino con algunas limitaciones serias:

-

No tenías ningún control sobre cómo se fragmentaban, incrustaban o recuperaban tus documentos.

-

No podía analizar las imágenes dentro de tus documentos.

-

No admitía archivos estructurados como CSVs o JSON.

En la práctica, esto significaba que estabas atrapado con una caja negra. Si la calidad de la recuperación era mala, no había nada que pudieras hacer para solucionarlo. Si el conocimiento de tu empresa estaba en hojas de cálculo, la herramienta era básicamente inútil.

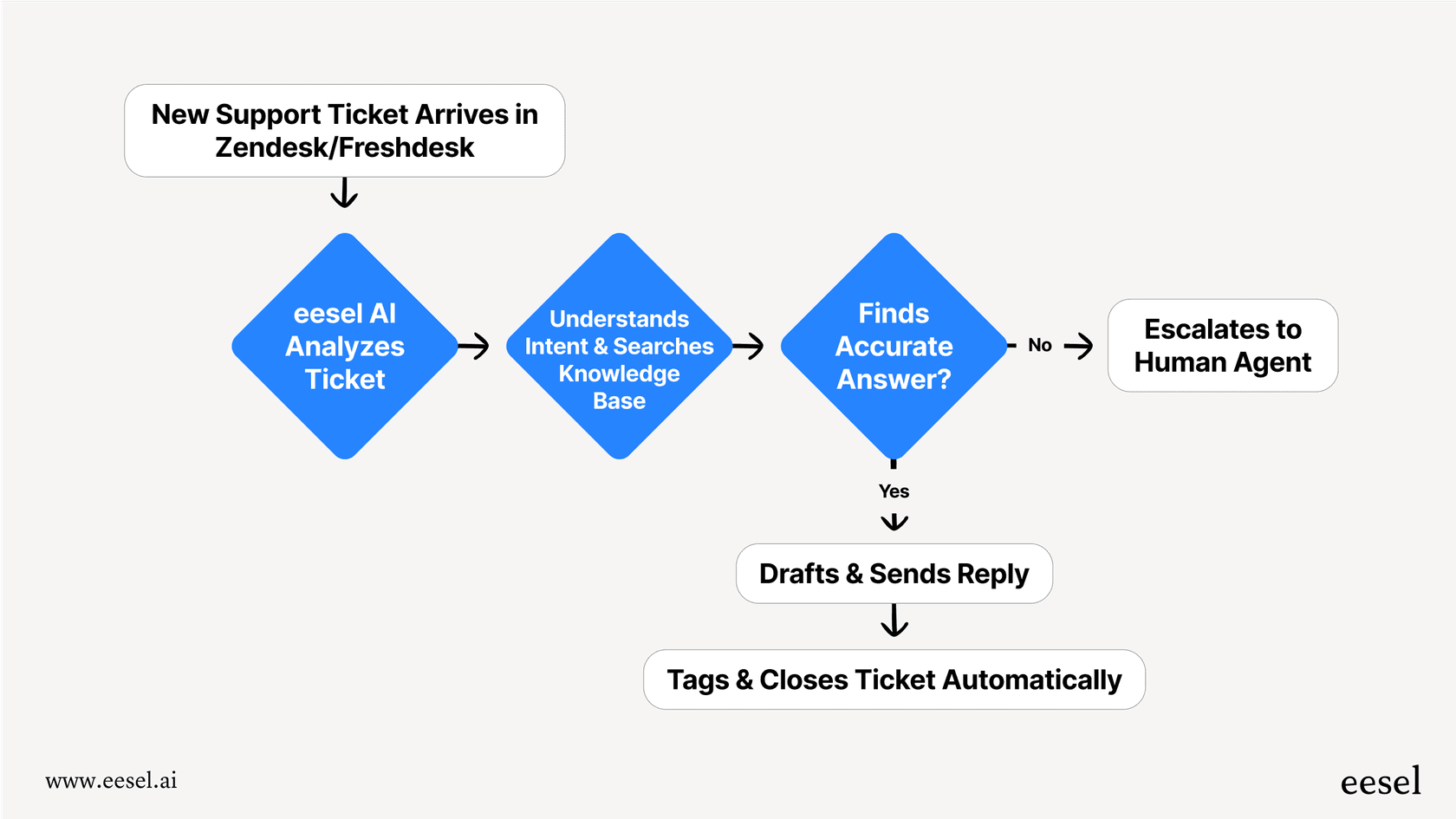

Esto es un gran contraste con una solución construida a propósito. eesel AI está diseñado para manejar la realidad desordenada del conocimiento empresarial. Se puede entrenar directamente en tus tickets de soporte pasados de help desks como Zendesk o Freshdesk. Se conecta sin problemas a tus wikis en Confluence y Google Docs. Incluso puede extraer información de productos de plataformas de comercio electrónico como Shopify, lo que te da una fuente de conocimiento unificada y totalmente controlable para tu IA.

La mejor manera de construir agentes de IA listos para producción más allá de la API de Asistentes de OpenAI

Construir directamente sobre una API de bajo nivel como la de OpenAI es genial para un proyecto de fin de semana o un experimento rápido. Pero cuando estás construyendo un agente de IA para una función empresarial real como el soporte al cliente, necesitas más que eso. Necesitas estabilidad, control y un camino claro para obtener un retorno de tu inversión.

Aquí es donde entra en juego la idea de un "motor de flujo de trabajo de IA". No se trata solo de obtener una respuesta de un modelo; se trata de lo que haces con esa respuesta. La solución correcta debería tener algunas cosas clave a su favor:

-

Debería ser increíblemente simple de configurar. Deberías poder conectarla a tu helpdesk y fuentes de conocimiento en minutos, no en meses, sin necesidad de todo un equipo de desarrolladores.

-

Debería darte un control total del flujo de trabajo. Deberías poder definir exactamente qué tickets gestiona la IA, qué acciones puede tomar (como etiquetar un ticket, actualizar un campo o escalar a un humano) y su tono de voz específico.

-

Debería permitirte implementar sin riesgo. Debe permitirte simular cómo se comportaría la IA en tus datos pasados. Esto te permite ver tu tasa de automatización potencial y generar confianza antes de que hable con un cliente real.

Esta es exactamente la razón por la que construimos eesel AI. Es un potente motor de flujo de trabajo de autoservicio que resuelve estos desafíos. Te permite implementar agentes de IA confiables y personalizados sin quedarte atascado gestionando los cambios de la API, los costos impredecibles y la gestión de estado complicada.

Moviéndose más allá de la API de Asistentes de OpenAI

La API de Asistentes de OpenAI fue un experimento interesante. Apuntaba hacia un futuro donde crear agentes de IA es más accesible, pero sus defectos en el costo, el rendimiento y ahora, su jubilación, realmente resaltan los riesgos de construir herramientas comerciales importantes en un objetivo tan móvil.

El cambio a la nueva API de Responses da a los desarrolladores más poder, pero también les da más responsabilidad. Para la mayoría de las empresas, ese no es un intercambio que valga la pena. El objetivo no es convertirse en un experto en la gestión de las API en constante cambio de OpenAI; es resolver un problema comercial.

Para las empresas que necesitan implementar IA confiable, rentable y altamente personalizada para sus equipos de soporte, una plataforma dedicada que gestione toda la complejidad subyacente es la forma más inteligente y sostenible de hacerlo.

Comienza con un agente de IA listo para producción

¿Listo para superar la complejidad y construir un agente de IA que realmente ofrezca resultados? Con eesel AI, puedes conectar tu helpdesk y fuentes de conocimiento para lanzar un agente de IA totalmente personalizable en solo unos minutos.

Simula su rendimiento en tus propios datos y ve tu tasa de automatización potencial hoy mismo.

Preguntas frecuentes

La API de Asistentes de OpenAI está siendo reemplazada principalmente debido a problemas como costos impredecibles, rendimiento torpe (falta de streaming) y control limitado para los desarrolladores. OpenAI se está moviendo a una nueva "API de Responses" que ofrece más flexibilidad, pero transfiere más responsabilidad de la gestión del estado a los desarrolladores.

La principal preocupación de costos era que la API reprocesaba todo el hilo de conversación, incluido el contenido completo del documento, con cada mensaje del usuario. Esto llevó a que el uso de tokens se escalara rápida e impredeciblemente, lo que dificultó a las empresas la gestión de los costos.

No, la API de Asistentes de OpenAI no admitía streaming en tiempo real. Los desarrolladores tenían que usar un mecanismo de sondeo, preguntando repetidamente a la API por actualizaciones hasta que se generara la respuesta completa, lo que condujo a experiencias de usuario más lentas.

Los desarrolladores deben planificar un proyecto de migración, ya que la API de Asistentes de OpenAI se cerrará por completo el 26 de agosto de 2026. Deberían familiarizarse con la nueva API de Responses y considerar plataformas estables y abstraídas como eesel AI para mitigar futuros cambios en la API.

Sí, la herramienta File Search tenía limitaciones significativas, incluyendo la falta de control sobre la fragmentación o incrustación de documentos, la incapacidad de analizar imágenes y la falta de soporte para archivos estructurados como CSVs. Esto a menudo resultaba en una calidad de recuperación deficiente sin ningún recurso para el desarrollador.

La nueva API de Responses cambia de la gestión con estado a un modelo de solicitud/respuesta más simple. Si bien ofrece más control, los desarrolladores ahora son responsables de [gestionar el historial de conversaciones](https://www.eesel.ai/blog/what-is-conversational-ai) y orquestar el uso de herramientas, lo que la antigua API gestionaba.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.