Parece que cada semana hay un nuevo anuncio de IA que le hace detenerse y mirar, y la revelación de OpenAI de una voz conversacional hiperrealista para ChatGPT fue definitivamente uno de ellos. Las demostraciones fueron bastante asombrosas: una IA que podía charlar, reír e incluso cantar con un nivel casi inquietante de emoción y sincronización humana.

Esta nueva función, parte del gran lanzamiento de voz de ChatGPT, se ejecuta en su último modelo, GPT-4o. Es un salto enorme con respecto a los chats basados en texto a los que todos estamos acostumbrados, llevándonos a un mundo donde hablar con una IA se siente mucho más natural. La buena noticia es que ahora está disponible para cualquier persona que haya iniciado sesión, aunque si usted es un suscriptor de pago, obtendrá límites de uso mucho más altos.

Entonces, ¿a qué se debe tanto entusiasmo? En este artículo, profundizaremos en qué es este nuevo modo de voz, cómo se compara con la versión anterior, qué piensa realmente la gente al respecto y qué significan sus límites para las empresas que desean utilizar la IA conversacional para algo más que un poco de diversión.

¿Qué es el nuevo modo de voz GPT-4o?

En esencia, el nuevo modo de voz es algo completamente diferente. Está impulsado por GPT-4o, que es el primer modelo de OpenAI entrenado de principio a fin en texto, visión y audio. En pocas palabras, no solo procesa palabras; procesa sonido.

Este es un cambio masivo desde un punto de vista técnico. El antiguo modo de voz era un poco tosco, ensamblado a partir de tres modelos distintos: uno para convertir su voz en texto, otro para generar una respuesta y un tercero para convertir ese texto de nuevo en voz. Funcionaba, pero no era precisamente fluido.

GPT-4o lo maneja todo de una vez. Debido a que la IA procesa el audio directamente, puede captar su tono, escuchar a varios interlocutores e incluso notar el ruido de fondo sin distraerse. Este enfoque todo en uno hace que la conversación se sienta mucho más real, con un tiempo de respuesta promedio de solo 320 milisegundos. Eso es básicamente tan rápido como una persona.

Esto es lo que eso significa realmente para usted:

-

Respuestas fluidas en tiempo real: Esas pausas robóticas e incómodas son cosa del pasado. Responde casi instantáneamente, por lo que el chat fluye con naturalidad.

-

Usted puede interrumpirlo: Al igual que al hablar con un amigo, puede intervenir mientras la IA está hablando. Se detendrá, escuchará y ajustará su respuesta sin confundirse.

-

Conciencia emocional y tonal: Esta es la parte realmente genial. GPT-4o puede captar los pequeños detalles en su voz, como el sarcasmo, la emoción o la vacilación, y responder con una amplia gama de sus propias emociones y tonos.

Para ofrecerle algunas opciones, hay nueve voces preestablecidas para elegir: Arbor, Breeze, Cove, Ember, Juniper, Maple, Sol, Spruce y Vale. Puede encontrarlas todas enumeradas en las preguntas frecuentes oficiales.

Por supuesto, el lanzamiento no ha estado exento de problemas. Es posible que haya oído hablar del drama en torno a la voz "Sky". OpenAI tuvo que pausarla después de que Scarlett Johansson expresara su preocupación porque sonaba muy parecida a ella. Un análisis encargado por NPR descubrió más tarde que la voz de Sky era más similar a la de Johansson que la del 98% de las otras actrices que analizaron. Esto solo demuestra lo complicado que se está volviendo este nuevo mundo de interacción con la IA.

Comparación entre los modos de voz antiguo y nuevo

Si bien la tecnología es un gran paso adelante, la experiencia de usuario real ha sido un tema candente. Es más rápida, sin duda, pero ¿es mejor? La respuesta es un poco más compleja de lo que se podría pensar.

Para entender realmente qué ha cambiado, pongamos el antiguo modo de voz frente al nuevo.

| Característica | Voz Estándar (Legacy) | Modo de Voz Avanzado (GPT-4o) |

|---|---|---|

| Modelo Subyacente | Tres modelos distintos para transcripción, inteligencia y síntesis de voz | Un único modelo multimodal de extremo a extremo (GPT-4o) |

| Velocidad de Respuesta | Retraso notable de 2,8 a 5,4 segundos | Casi instantáneo, con un tiempo de respuesta promedio de 320ms |

| Flujo de Conversación | Por turnos; había que esperar a que la IA terminara de hablar | Fluido e interrumpible, permitiendo un ida y vuelta natural |

| Conciencia Tonal | Monótona y robótica; no podía procesar la emoción del usuario desde el audio | Puede detectar la emoción del usuario y responder con entonación variada |

| Percepción del Usuario | A menudo descrita como "reflexiva", "calmada" y "reconfortante" | Percibida por algunos como "apresurada", "superficial" y menos personal |

Esa última fila, "Percepción del Usuario", es donde se pone interesante. A pesar de que la nueva voz es técnicamente mejor en todos los sentidos, una cantidad sorprendente de personas realmente echan de menos la anterior. La voz heredada, con sus pausas lentas y deliberadas, se sentía más reflexiva para algunos. Les daba un segundo para pensar y se sentía como un compañero calmado y paciente.

En contraste, la nueva voz de GPT-4o a veces puede sentirse demasiado ansiosa. Es tan rápida para responder que puede parecer que está tratando de apresurar la conversación. Para preguntas rápidas, es genial. Pero para una lluvia de ideas más profunda (brainstorming) o simplemente para pensar en voz alta, algunos usuarios descubrieron que el ritmo antiguo y más lento era en realidad más útil.

Tampoco se pueden tener discusiones profundas en el modo de voz avanzado como en el estándar, y las respuestas son mucho más superficiales. Esto es inutilizable si estás haciendo una lluvia de ideas para proyectos de escritura creativa, etc.

Cómo acceder y utilizar el nuevo modo de voz

¿Quiere probarlo usted mismo? Empezar es bastante sencillo.

Según las preguntas frecuentes de OpenAI, las conversaciones de voz están disponibles para todos los usuarios que hayan iniciado sesión en las aplicaciones móviles, las aplicaciones de escritorio y la versión web en chatgpt.com. Si es suscriptor de Plus, obtendrá límites de mensajes hasta 5 veces más altos que los usuarios gratuitos, por lo que podrá chatear durante mucho más tiempo.

Aquí le explicamos cómo activarlo:

-

Abra la aplicación ChatGPT en su teléfono o vaya al sitio web.

-

Busque el icono de los auriculares en la esquina inferior derecha y tóquelo.

-

La primera vez que lo use, se le pedirá que elija una de las nueve voces.

-

No se preocupe por cuál elegir. Siempre puede cambiarla más tarde en su configuración.

¡Y eso es todo! Puede empezar a hablar y ver qué le parece.

Respuesta de la comunidad: Una mezcla de opiniones

La reacción inicial fue de puro asombro. Las demostraciones fueron alucinantes, mostrando una IA que podía reaccionar a lo que un usuario estaba viendo a través de la cámara de su teléfono y mantener una conversación que se sentía increíblemente real. Parecía un avance genuino.

Pero a medida que más personas lo probaron, los comentarios se volvieron un poco más complejos. Un vistazo rápido a foros como Reddit muestra una comunidad que está impresionada y, a la vez, un poco decepcionada.

Por un lado, la velocidad y el flujo natural son victorias obvias. Por otro, hay un sentimiento común de que se perdió algo en la actualización.

Muchos usuarios sintieron una extraña sensación de pérdida por la voz antigua. Algunos la describieron como un "amigo reconfortante" cuyo ritmo más lento y comedido era perfecto para intercambiar ideas o trabajar en un problema difícil.

esto va a ser como perder a un querido amigo. La Voz Estándar es reflexiva y tiene una voz y cadencia que son naturales y reconfortantes. Conmovedor.

Otros han señalado que la nueva voz, más rápida, a menudo parece que está tratando de terminar la conversación. Puede darle una respuesta rápida y luego quedarse en silencio, en lugar de entablar el tipo de charla abierta en la que la voz antigua era buena.

Es como si estuviera tratando de cerrar y terminar la conversación con cada mensaje, incluso cuando acabamos de empezar y es claramente el comienzo de una conversación.

Una queja común es que la "personalidad" de la nueva voz se siente un poco genérica y no muy conectada con el potente modelo de texto que hay debajo. Algunos sienten que sus respuestas son más "superficiales", lo cual no es ideal para tareas creativas donde se desea un compañero para el pensamiento profundo.

Es un ejemplo clásico de cómo una mejora técnica no siempre conduce a una mejor experiencia humana para todos. La nueva voz es una pieza de ingeniería increíble, pero parece que no ha capturado del todo la magia que hizo que a algunos usuarios les gustara realmente la versión antigua y más tosca.

Para ver y escuchar la diferencia por usted mismo, eche un vistazo a esta reseña en vídeo que demuestra el nuevo modo de voz en acción. Ofrece una visión de primera mano de la velocidad, el tono y el flujo conversacional de la actualización de GPT-4o.

Consideraciones para aplicaciones empresariales

Si bien chatear con una IA en su teléfono es genial, ¿qué significa todo esto para las empresas? El potencial de la IA conversacional en el servicio al cliente, las ventas y el soporte interno es enorme, pero una herramienta de propósito general como ChatGPT tiene limitaciones específicas en un entorno profesional.

Los comentarios mixtos de los usuarios sobre su personalidad son solo el comienzo. Aquí hay algunas consideraciones para las aplicaciones empresariales:

-

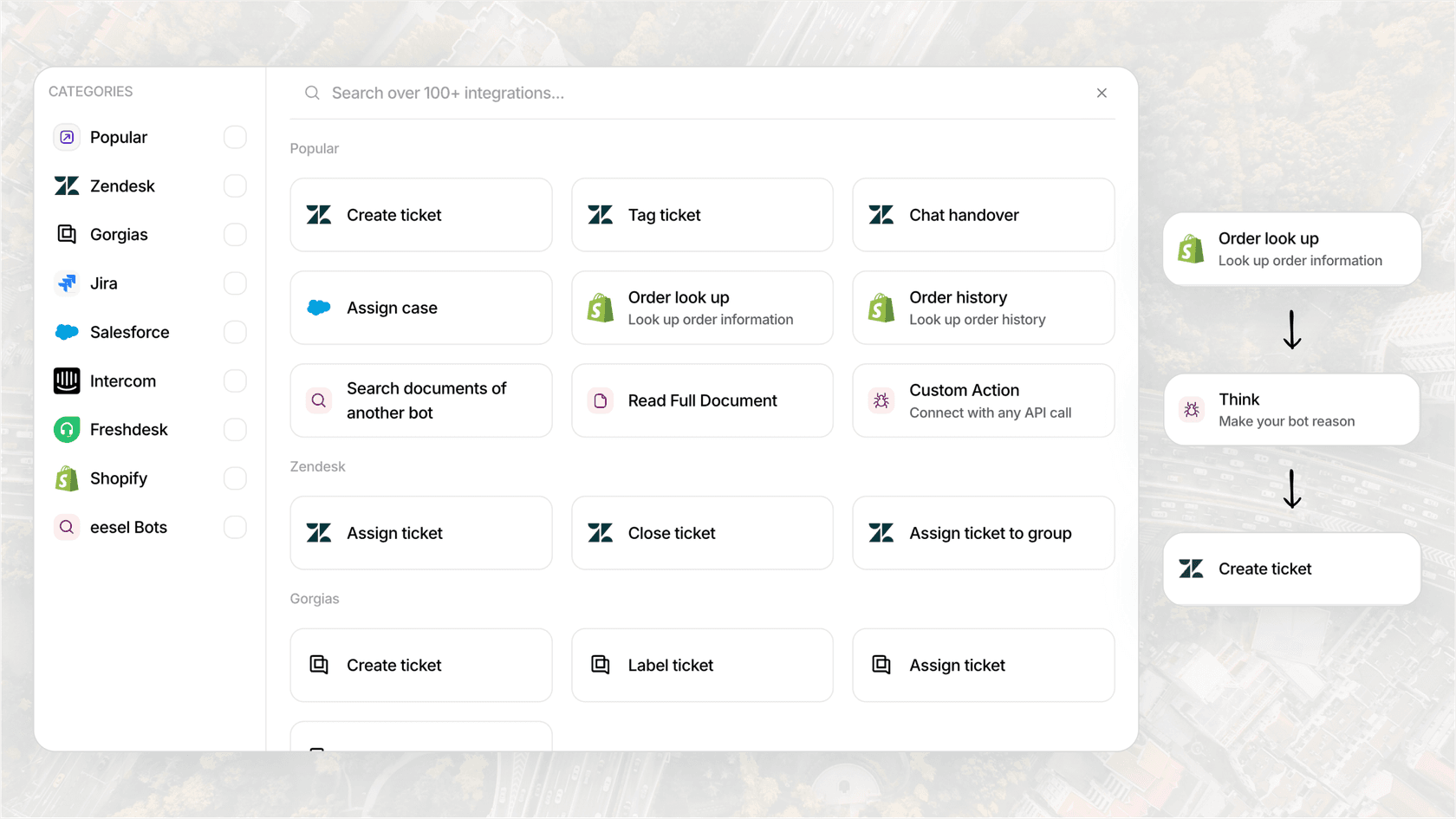

Carece de contexto empresarial: ChatGPT no tiene idea sobre su empresa. No puede consultar los datos de su centro de ayuda en Zendesk, revisar el historial de pedidos de un cliente en Shopify ni encontrar sus políticas internas en Confluence. Sus respuestas siempre serán genéricas.

-

No puede tomar medidas: Un cliente no puede pedirle que procese un reembolso y un empleado no puede pedirle que cree un ticket de soporte en Jira. Es una caja cerrada que solo puede hablar; no puede hacer nada dentro de sus flujos de trabajo existentes.

-

Personalización y controles de seguridad limitados: Para las aplicaciones empresariales, controlar la voz de marca de una IA, garantizar el cumplimiento de las políticas de la empresa y establecer reglas para el traspaso a humanos es crucial. Las herramientas de propósito general pueden no ofrecer un control granular sobre estos aspectos.

Si bien la tecnología es asombrosa para asuntos personales, las empresas necesitan un compañero de IA creado específicamente para ese propósito que esté conectado a sus sistemas y flujos de trabajo existentes.

eesel AI: Una IA especializada para empresas

Aquí es donde las herramientas especializadas como eesel AI pueden ser beneficiosas. Construimos eesel en torno a una idea simple: usted no solo configura una IA, sino que la contrata como un nuevo compañero de equipo. Se pone al día en minutos, no en semanas, conectándose a sus herramientas actuales y aprendiendo de sus datos comerciales específicos, sus tickets pasados, artículos del centro de ayuda y documentos internos. Esto significa que tiene el contexto adecuado desde el primer día.

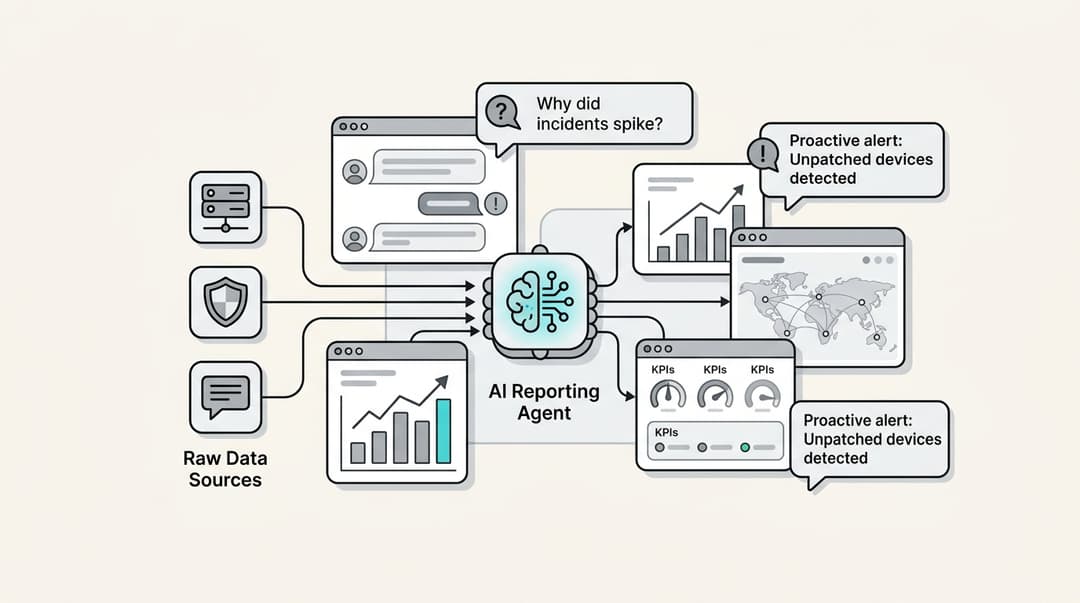

Así es como un compañero de IA como eesel maneja las limitaciones de una herramienta de voz de propósito general:

-

Conciencia del contexto: eesel se conecta directamente a sus fuentes de conocimiento como Confluence y centros de ayuda como Zendesk. No solo da una respuesta genérica; da la respuesta correcta basada en la información real de su empresa.

-

Orientado a la acción: Los Agentes de eesel AI están diseñados para hacer más que simplemente hablar. Pueden configurarse para realizar tareas en otras aplicaciones, como buscar información de pedidos en Shopify, actualizar un campo de un ticket o dirigir solicitudes entrantes al equipo adecuado.

-

Totalmente controlado: Con eesel, usted tiene el mando. Usted define su tono, su base de conocimientos y sus reglas de escalación utilizando un lenguaje sencillo. Puede decirle: "Escala siempre las disputas de facturación a un humano", y lo hará. Esto garantiza que actúe como una extensión fiable de su equipo.

Para las empresas que buscan utilizar una potente IA conversacional internamente, nuestro AI Internal Chat es un ejemplo perfecto. Puede invitarlo a su Slack o Microsoft Teams, donde puede dar respuestas instantáneas y confiables a las preguntas de los empleados, todo basado en la documentación privada de su empresa. Es una forma práctica de reducir las preguntas repetitivas y ayudar a que todos sean más productivos.

Reflexiones finales

No hay duda de que el lanzamiento de voz de ChatGPT es un gran logro tecnológico. Está haciendo que la interacción con la IA sea más natural, accesible y humana que nunca, y es un vistazo fascinante a lo que está por venir.

Los comentarios de los usuarios resaltan una distinción entre la IA de propósito general y la especializada. Si bien una IA de voz de propósito general es eficaz para uso personal y preguntas rápidas, las empresas suelen tener requisitos diferentes. Estos requisitos suelen incluir una integración profunda con los sistemas existentes, la capacidad de realizar acciones específicas y controles de seguridad robustos.

¿Está listo para ver lo que un verdadero compañero de IA puede hacer por su empresa? Explore las soluciones de IA de eesel o comience una prueba gratuita hoy mismo.

Preguntas frecuentes

La mayor diferencia es la tecnología subyacente. La nueva voz utiliza un modelo único de extremo a extremo llamado GPT-4o que procesa el audio directamente. Esto hace que las conversaciones sean mucho más rápidas, naturales y permite que la IA detecte y responda con emociones, a diferencia del sistema antiguo de varios pasos.

Sí, está disponible para todos los usuarios registrados en dispositivos móviles, escritorio y la web. Sin embargo, los suscriptores de pago (como los usuarios de ChatGPT Plus) obtienen límites de mensajes significativamente más altos, lo que permite conversaciones mucho más largas.

Algunos usuarios consideraron que el ritmo más lento y deliberado de la voz anterior era tranquilizador y reflexivo. Sentían que era un mejor compañero para la lluvia de ideas o para trabajar en ideas complejas, mientras que la nueva voz, más rápida, a veces puede sentirse apresurada o superficial.

Para activarlo, abra la aplicación o el sitio web de ChatGPT y busque el icono de los auriculares, generalmente en la esquina inferior derecha. Tóquelo y se le pedirá que elija una voz para comenzar su conversación.

Para las empresas, sus principales limitaciones son la falta de contexto específico (no puede acceder a los datos de su empresa), la incapacidad de realizar acciones en su software empresarial (como procesar un reembolso) y la falta de control sobre su personalidad, tono y protocolos de seguridad.

Hay nueve voces preestablecidas disponibles para elegir. Se llaman Arbor, Breeze, Cove, Ember, Juniper, Maple, Sol, Spruce y Vale. Puede cambiar su voz seleccionada en cualquier momento en la configuración.

Share this article

Article by

Kenneth Pangan

Escritor y comercializador durante más de diez años, Kenneth Pangan divide su tiempo entre la historia, la política y el arte, con frecuentes interrupciones de sus perros que exigen atención.