シスコが最近、Robust Intelligenceを4億ドルと報じられる額で買収したことは、テクノロジー界の中でも急速に表舞台へと進出している「AIセキュリティ」という分野に大きな注目を集めました。長年にわたり、企業はAIの構築と展開を競ってきましたが、これらの強力なシステムを新しく、ほとんど目に見えない脅威からどのように保護するかという議論は、数歩遅れていました。

Robust Intelligenceは、AIシステムを内側から安全にすることに焦点を当てた企業です。しかし、それは具体的に何を意味するのでしょうか?この記事では、Robust Intelligenceが何をしているのか、その使命がAIを利用するあらゆるビジネスにとってなぜ重要なのか、そしてこのトレンドが、顧客サポート、IT、その他あらゆる分野でAIを利用しているあなたにとって何を意味するのかを解説します。

Robust Intelligenceとは?

Robust Intelligenceは、その核心においてAIセキュリティ企業です。彼らは、AIモデルとそれが動作するアプリケーションを、最初のコードの一行から顧客とのあらゆるやり取りに至るまで、ライフサイクル全体を通じて保護するためのプラットフォームを構築しました。

ハーバード大学の元教授であるYaron Singer氏と、当時彼の学生だったKojin Oshiba氏によって設立されたこの会社は、シンプルかつ重要なアイデアに基づいて構築されました。それは、「AIモデルは失敗する可能性があり、そして必ず失敗する」というものです。彼らの仕事は、脆弱性が悪用される前にそれらを嗅ぎ分け、リアルタイムで悪意のある攻撃から保護することによって、それらの失敗を防ぐことです。

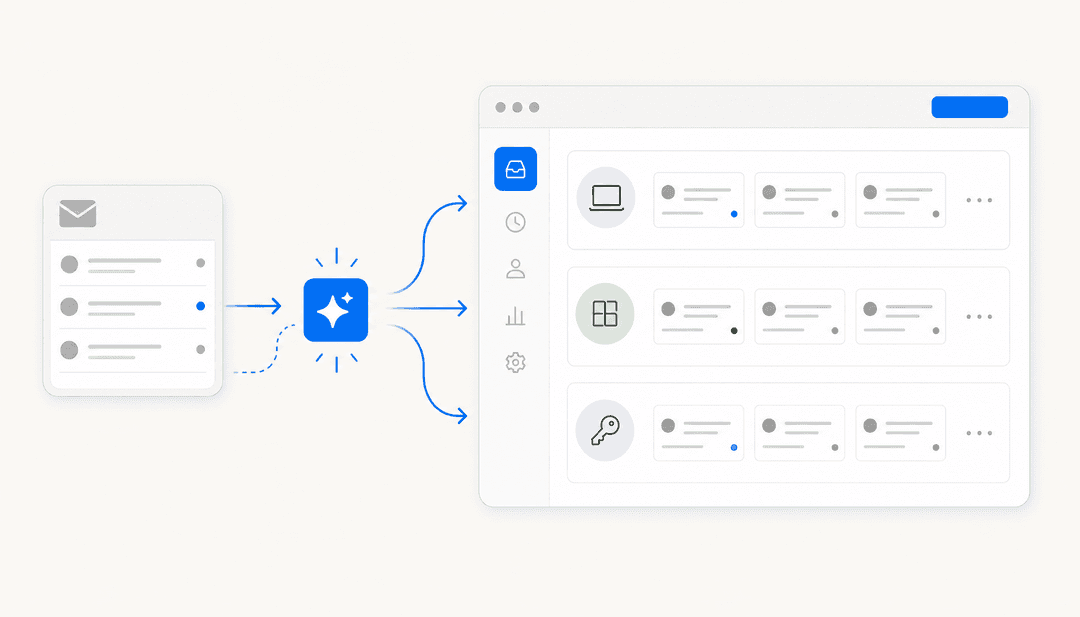

彼らのプラットフォームは、主に2つの部分に分かれています。

-

AI検証(AI Validation): これは事前対策です。AIモデルが世に出る前に、このツールはセキュリティホールや安全性のリスクを自動でテストするプロセスを自動化します。これは、実際の損害を引き起こす前に弱点を見つけ出すストレステストのようなものだと考えてください。

-

AI保護(AIファイアウォール): これはリアルタイムの防御です。モデルが稼働し始めると、AIファイアウォールはガードレールのように機能し、入力と出力を常に監視して、脅威が現れるたびにブロックします。

彼らは基本的に、新世代のテクノロジーのためのセキュリティ免疫システムを構築しているのです。

graph TD; A[AIモデルのライフサイクル] --> B{Robust Intelligenceプラットフォーム}; B --> C[AI検証 - 事前テスト]; B --> D[AI保護 - リアルタイムファイアウォール]; C --> E[自動ストレステスト]; C --> F[セキュリティと安全性のリスクを特定]; D --> G[入力と出力を監視]; D --> H[脅威をリアルタイムでブロック];

解決する核心的な問題:なぜAIモデルのセキュリティがそれほど重要なのか

企業がAIの導入を急ぐ中で、従来のサイバーセキュリティツールでは検知できない新たな種類のリスクにも門戸を開いています。AIモデルは通常のソフトウェアとは異なり、非常に奇妙で巧妙な方法で操作される可能性があります。

Robust Intelligenceは、これらの特有の脅威から防御するために構築されました。以下にその主なものをいくつか挙げます。

-

プロンプトインジェクションとジェイルブレイク: これは基本的にAIに対するソーシャルエンジニアリングです。ボットを騙して、自身の安全ルールを無視させたり、漏洩すべきでない機密情報を吐き出させたりします。例えば、攻撃者は顧客サービスボットを騙して他のユーザーのアカウント詳細を漏洩させたり、有害なコンテンツを生成させたりするプロンプトを作成する可能性があります。

-

データ汚染(Data Poisoning): AIの性能は、学習するデータの質に依存します。データ汚染とは、攻撃者がAIのトレーニング段階で密かに悪質なデータを供給することです。これにより、隠れたバックドアが作られたり、モデルが後々ひどい判断を下す原因となるバイアスが導入されたりする可能性があり、手遅れになるまで誰も気づかないことがあります。

-

モデル回避(Model Evasion): これは、AIを混乱させて間違いを犯させるように特別に設計された入力を作成することです。例えば、攻撃者は人間には見えないように画像を微調整し、AIにそれが何であるかを完全に誤認識させることがあります。

これらは単なる理論上の問題ではありません。研究者たちは、最先端のモデルでさえどれほど脆弱であるかを何度も示してきました。これらを保護することは、もはや「あれば良い」ものではなく、ビジネスを行う上での基本要件になりつつあります。

シスコによるRobust Intelligenceの買収:エンタープライズAIにとっての意味

シスコのような巨大企業が専門のスタートアップに数億ドルを費やすとき、市場が変化していることがわかります。この買収は、AIセキュリティがもはや一部のデータサイエンティストのニッチな懸念事項ではなく、すべての大手企業にとって最優先事項であることを裏付けています。

発表のブログ投稿で、シスコのセキュリティ担当SVPであるトム・ギリス氏は次のように述べています。「シスコとRobust Intelligenceの組み合わせは、既存のデータフローに高度なAIセキュリティ処理をシームレスに提供できることを意味します…」

これは大きな一歩です。AIセキュリティが、ビジネスを支えるインフラストラクチャに直接組み込まれることを意味します。専用のセキュリティなしでAIアプリケーションを立ち上げることは、ファイアウォールなしで企業ネットワークを運用するのと同じくらい考えられないことになりつつあります。これは役員室だけで起きていることではありません。米国がAIの安全性に関する大統領令で推進しているように、世界中の政府がより安全でセキュアなAI開発を求めています。

Robust Intelligenceとモデルセキュリティを超えて:問題のもう半分

Robust Intelligenceのような企業が、車のエンジンに例えられる基盤となるAIモデルの保護に焦点を当てている一方で、AIアプリケーションを使用するビジネスには別の大きな課題があります。エンジンを保護することも一つですが、車が安全に走行し、交通ルールを守り、想定外の行動をしないようにすることも確認しなければなりません。

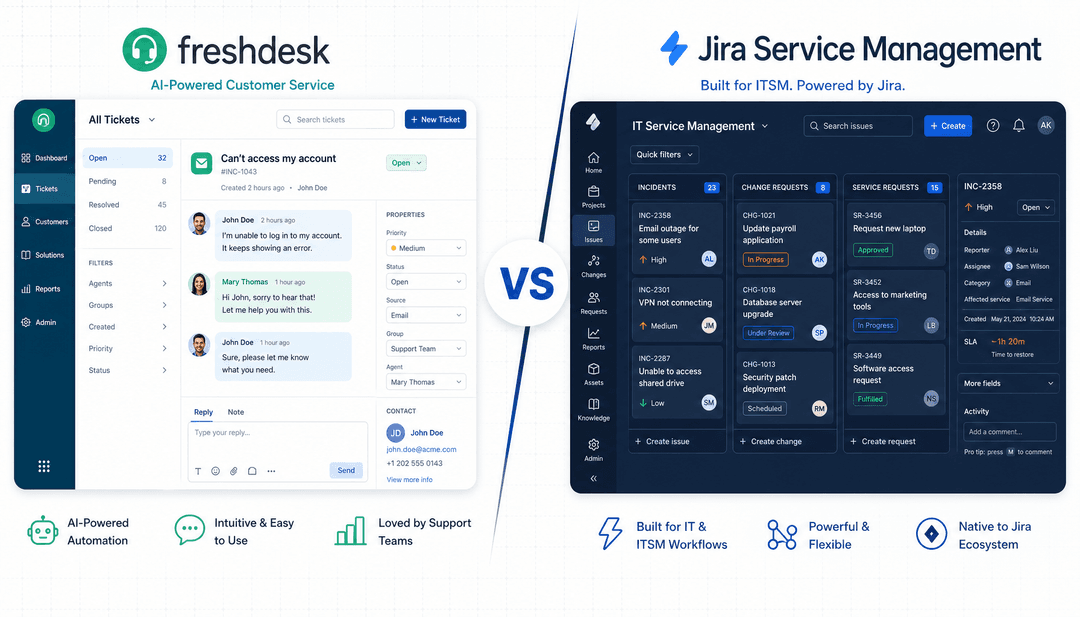

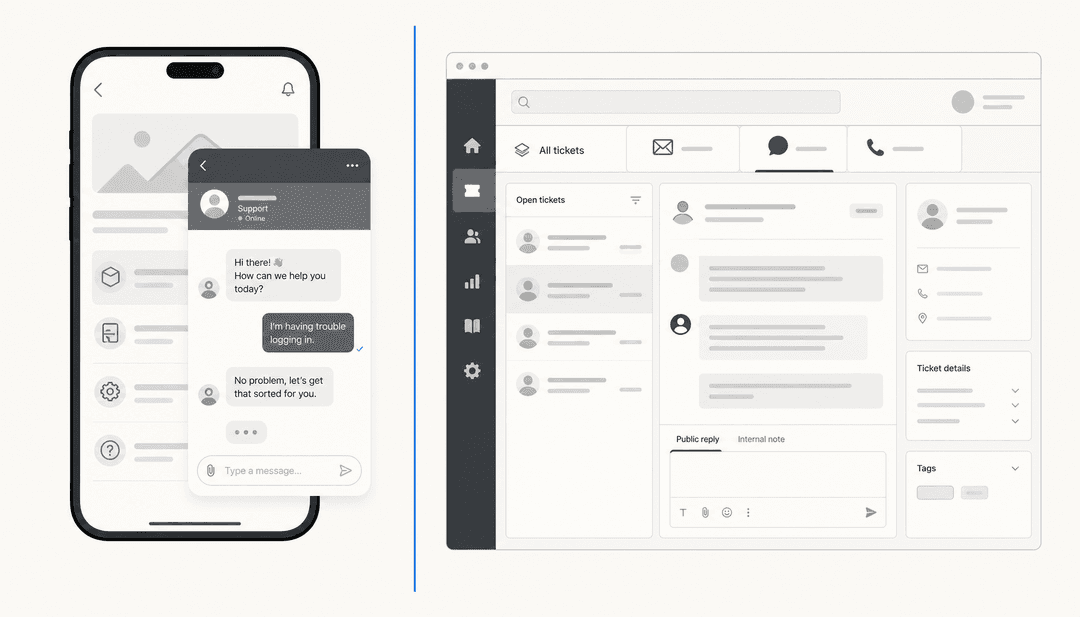

顧客サポート、ITサービス管理、または社内の質問対応にAIを使用しているチームにとって、この「アプリケーション層」の課題が現実のものとなります。ここでのリスクは、ハッカーというよりは、ブランドの評判や顧客の信頼に関わる問題です。AIエージェントが誤った情報を提供したり、奇妙な口調になったり、デリケートな問題を人間にエスカレーションできなかったりすることは、技術的な侵害と同じくらい損害をもたらす可能性があります。

ここで必要となるのは、アプリケーション自体の制御、信頼性、信用に焦点を当てた、別の種類の「ロバスト・インテリジェンス(堅牢な知性)」です。

これは、現代のプラットフォームが解決し始めている問題です。最高のプラットフォームは、いくつかの重要なアイデアに基づいて構築されています。

まず、きめ細かな制御が必要です。スイッチを一つ押すだけでAIを野放しにすることはできません。真の制御とは、AIがどのタイプの質問を自動化するかを正確に選択できることを意味します。例えば、eesel AIのようなツールを使えば、まず単純で反復的なトピックの自動化から小さく始め、それ以外のすべてが人間にエスカレーションされるように設定できます。これにより、サポートのワークフローを完全に管理でき、不快な驚きがなくなります。

次に、リスクのないテストです。顧客と一度も話したことのないAIを、どうやって信頼できるでしょうか?答えはシミュレーションです。自社の過去の何千ものサポートチケットでAIのセットアップをテストできる機能は、大きな利点です。これにより、本番稼働前に、AIがどのように機能し、コスト削減がどの程度になるかを正確に予測できます。この種の強力なシミュレーションは、他の多くの代替製品にはないeesel AIの中核機能です。

最後に、シームレスな統合です。誰もが最も避けたいのは、開発者の時間を何ヶ月も要する、長くて複雑なセットアップです。最高のAIソリューションは、既存のツールを捨てさせることはありません。代わりに、ZendeskやFreshdeskなど、お使いのヘルプデスクにわずか数分で直接接続できるべきです。このシンプルでセルフサービスなアプローチにより、巨大なIT予算を持つ大企業だけでなく、誰もが現代のAIを利用できるようになります。

Robust Intelligenceの価格

大企業向けのソフトウェアに期待されるように、Robust Intelligenceは価格を公表していません。見積もりを取得するには、デモを予約して営業チームと話す必要があります。

このモデルは、彼らのような複雑なソリューションにとっては理にかなっていますが、すぐに始めて何かが機能するかどうかを確認したいチームにとっては障壁となる可能性があります。多くのビジネスにとって、透明で予測可能な価格は、長い販売プロセスに行き詰まることなく計画や予算を立てる上で非常に重要です。

Robust Intelligenceで完全なAI安全計画を構築する

Robust Intelligenceの台頭とシスコによる買収は、一つ確かなことを証明しています。それは、AIセキュリティが今や、現代のあらゆる技術スタックにおいて交渉の余地のない一部となっているということです。それはアドオンではなく、必需品です。

しかし、完全な戦略には実際には2つの部分があります。第一に、Robust Intelligenceのような企業が扱う、技術的な脅威から基盤となるAIモデルを保護する必要があります。第二に、実際に使用するAIアプリケーションが、あらゆるやり取りにおいて制御され、信頼でき、信用できるものであることを保証しなければなりません。ここでeesel AIのようなプラットフォームが登場します。

顧客サポート、IT、または社内業務のチームにとって、真に「ロバスト・インテリジェンス(堅牢な知性)」を持つということは、透明性、きめ細かな制御、および安全に物事をテストし調整する自信を与えてくれるAIツールを使用することを意味します。それは、深層のモデルからエンドカスタマーに至るまで、実際に信頼できるシステムを構築することです。

信頼できるAIを始めよう

リスクなしで顧客サポートにAIを利用したいとお考えなら、eesel AIは数分で設定できるセルフサービスプラットフォームを提供します。自社の過去のチケットでパフォーマンスをシミュレーションし、何を自動化するかを完全に制御できます。ぜひ今日お試しください。

よくある質問

Robust Intelligenceは、AIモデルとアプリケーションをライフサイクル全体を通じて保護するプラットフォームを開発するAIセキュリティ企業です。従来のサイバーセキュリティツールでは検知できない、AIシステム特有の巧妙な脆弱性からシステムを保護するという重要な問題を解決し、AIが安全かつ確実に機能することを保証します。

Robust Intelligenceは2つのアプローチを採用しています。1つは「AI検証(AI Validation)」で、モデルを展開する前にセキュリティ上の欠陥を事前にテストします。もう1つは「AI保護(AI Firewall)」で、モデルが稼働中にリアルタイムで入力と出力を継続的に監視し、脅威をブロックします。

はい、Robust Intelligenceは、AIを騙して不正な振る舞いをさせるプロンプトインジェクションやジェイルブレイク、攻撃者が密かに悪質なデータを供給してモデルの振る舞いに影響を与えるデータ汚染など、高度なAIの脅威に対して防御するように特別に設計されています。また、モデル回避技術からも保護します。

シスコによるRobust Intelligenceの買収は、AIセキュリティがもはやニッチな懸念事項ではなく、主要企業にとって最優先事項であることを浮き彫りにしています。これは、高度なAIセキュリティを企業のインフラストラクチャに直接統合し、AIアプリケーションを展開するための基本要件とする動きを示しています。

Robust Intelligenceが基盤となるAIモデルを保護する一方で、包括的な戦略にはアプリケーション層の管理も必要です。顧客対応シナリオでAIが確実に振る舞うことを保証するためです。これには、eesel AIのようなプラットフォームが提供する、AIの行動に対するきめ細かな制御、リスクのないテスト、既存ツールとのシームレスな統合などが含まれます。

いいえ、Robust Intelligenceは価格を公表していません。関心のある企業はデモを予約し、営業チームと相談して見積もりを取得する必要があります。これは、同社のソリューションが通常、大企業のニーズに合わせて調整されるためです。

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.