Baseten: 機能、料金、主要代替ツール (2026)

Kenneth Pangan

Stanley Nicholas

最終更新 November 14, 2025

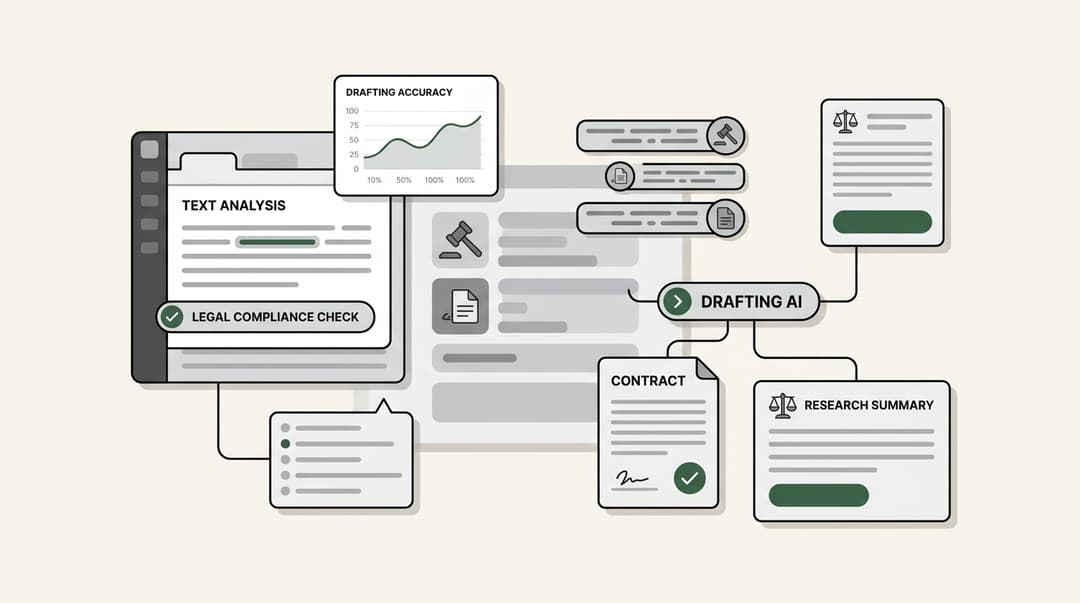

AI業界は活気に満ちています。文章を書き、コードを生成し、何もないところからアートを創り出す華々しいモデルを誰もが目にします。しかし、その裏側には、これらを実際に機能させるためのインフラの世界が広がっています。これらはAI革命を動かすエンジンであり、その文脈で耳にする名前の一つがBasetenです。

Basetenは、AIプロセスの中でも非常に重要でありながら、しばしば地味な部分である「推論(inference)」に焦点を当てています。簡単に言えば、推論とは、学習済みのモデルを実際に実行して答えを得る際に起こることです。本格的なAI戦略を構築しようとする人にとって、Basetenのようなプラットフォームを理解することは必須です。

そこでこの記事では、Basetenの全貌を明らかにします。Basetenとは何か、何をするものか、料金体系はどうなっているのか、そして全体像の中でどのような位置づけにあるのかを見ていきます。また、Basetenのような本格的なインフラツールが適切な選択となるのはどのような場合か、そして特定の課題に特化したツールのほうが良いのはどのような場合かについても、率直に解説します。

Basetenとは?

Basetenは、企業が機械学習モデルを本番環境で稼働させるのを支援するAIインフラプラットフォームです。AIそのものであるというよりは、AIがダウンすることなくその役割を果たせるようにするための、高性能な「配管」のようなものです。

BasetenのCEOがFortune誌の記事で述べたように、彼らはAIモデルのための「つるはしとシャベル」や「線路」を提供しています。モデルが学習された後、推論はそれを実際に予測のために稼働させるステップです。Basetenは、企業が自社のカスタムモデルや人気のオープンソースモデルを、複雑なハードウェアをすべて自前で構築・管理するという大きな頭痛の種なしに実行できる場所を提供します。

そして、彼らは単なるクールなアイデアを持つ小さなスタートアップではありません。1億5,000万ドルの新たな資金調達や、Google CloudやAWSといったクラウド大手との提携により、BasetenはAIを核とした製品を構築する技術チームにとって重要なプレイヤーであることを証明しています。

Basetenの主要な製品と機能

Basetenのツールキットは技術的な層、つまりこの分野に精通したエンジニアを対象としています。これは、スイッチを入れるだけでビジネスチームに渡せるようなプラットフォームではないことを明確にしておく必要があります。うまく使いこなすには、確かな技術力が求められます。

人気のオープンソースモデル向けのBaseten Model API

Basetenが提供するものの大きな部分を占めるのが、DeepSeekやLlamaといった人気のオープンソースモデルに即座にアクセスできるAPI群です。開発者にとって、これは大幅な時間短縮になります。これらの巨大なモデルを自分でダウンロードし、設定し、調整するという手間をかける代わりに、APIを呼び出すだけで済みます。これにより、チームはプロトタイプや新機能をより迅速に構築できます。Basetenによれば、このアプローチはパフォーマンス面でも大きなメリットをもたらし、最新のNVIDIAハードウェアを使用することで225%以上優れたコストパフォーマンスを実現しているとのことです。

カスタムAIモデル向けの専用Basetenデプロイメント

もしあなたの会社がすでに時間と費用をかけて独自のAIモデルを構築している場合、Basetenは専用デプロイメントを提供します。これは基本的に、カスタムモデルを実行するためのプライベートでスケーラブル、かつ安全なプレイグラウンドです。チームはハードウェアを完全に制御でき、特定のNVIDIA GPUを選択し、パフォーマンス要件に合わせてすべてを適切に調整できます。

このレベルの制御は特殊なユースケースには素晴らしいものですが、実際には独自の機械学習オペレーション(MLOps)チームを持つ組織向けに構築されています。単にチケットへの回答を迅速化したいだけのカスタマーサポートのような部門にとって、簡単な解決策ではありません。

Basetenを支えるテクノロジー

Basetenの速度は、最高級のハードウェアと微調整されたソフトウェアの組み合わせによって実現されています。このプラットフォームは、NVIDIA B200やA100シリーズのような非常に強力なGPUへのアクセスをユーザーに提供し、大規模モデルを長い待ち時間なしで実行するために不可欠です。

ソフトウェア側では、大規模言語モデルの実行方法を最適化するオープンソースライブラリであるNVIDIAのTensorRT-LLMなどを使用しています。この技術を利用することで、Basetenは顧客がスループットを2倍に向上させ、最初のトークンまでの時間を半減させるのを支援しました。このような詳細から、このプラットフォームがいかに技術的であり、その能力を最大限に引き出すためにどれほどのエンジニアリングスキルが必要かがわかります。

Basetenの料金体系を詳しく見る

Basetenは、使用したコンピューティングリソースに対して課金される、従量課金制モデルを採用しています。これはインフラプラットフォームではごく一般的で、使用状況を注意深く監視できる技術チームにとってはうまく機能します。しかし、ビジネス部門にとっては、このモデルは予測不可能なコストを生み出す可能性があり、予算編成の悪夢となり得ます。

Baseten Model APIの料金

Basetenのすぐに使えるモデルを使用する場合、処理された100万トークンごとに課金されます(入力と出力の両方)。

| モデル | 入力(100万トークンあたり) | 出力(100万トークンあたり) |

|---|---|---|

| GLM 4.6 | $0.60 | $2.20 |

| GPT OSS 120B | $0.10 | $0.50 |

| DeepSeek V3.1 | $0.50 | $1.50 |

| Kimi K2 0905 | $0.60 | $2.50 |

注:価格は2025年9月時点の公開情報に基づいており、変更される可能性があります。最新の数値については、必ず公式サイトのBaseten料金ページをご確認ください。

Baseten専用デプロイメントの料金

独自のモデルをデプロイする場合、料金は実行しているGPUまたはCPUインスタンスに基づく分単位の請求に切り替わります。

| GPUインスタンス | スペック | 価格(分あたり) |

|---|---|---|

| T4 | 16 GiB VRAM, 4 vCPUs | $0.01052 |

| A10G | 24 GiB VRAM, 4 vCPUs | $0.02012 |

| A100 | 80 GiB VRAM, 12 vCPUs | $0.06667 |

| H100 | 80 GiB VRAM, 26 vCPUs | $0.10833 |

| B200 | 180 GiB VRAM, 28 vCPUs | $0.16633 |

注:価格は2025年9月時点の公開情報に基づいており、変更される可能性があります。繰り返しになりますが、最新の料金についてはBasetenの公式サイトの料金ページをご確認ください。

カスタマーサービスのようなビジネス機能にとって、この分単位のGPUコストは不確定要素です。サポートチケットが突然殺到したと想像してみてください。それはインフラ費用請求額の急増に直結します。ここでeesel AIのようなツールとの大きな違いが見られます。eesel AIは、解決ごとのサプライズ料金がない明確な月額固定料金を提供しています。この予測可能性により、AIの予算を立てやすくなり、コストが制御不能になる心配なくサポートチームを成長させることができます。

Basetenは誰のためのものか?

Basetenが実際に誰のためのものかを理解することが、自分に適しているかどうかを知る鍵となります。ほとんどのビジネスチームにとっては、はるかに実用的な選択肢が他にあります。

Basetenの理想的な顧客

Basetenは、機械学習エンジニア、データサイエンティスト、そしてAIを中心に業務を行う開発者といった、技術的な層を対象としています。独自のAIアプリの構築に全力を注いでいる企業や、オープンソースモデルを強力かつスケーラブルな方法でデプロイする必要がある企業にとって、適切なツールです。

これは、WriterやPatreonといった企業を含む顧客リストからもわかります。これらは、AI製品のための堅牢なバックエンドを必要とする、強力な社内エンジニアリングチームを持つテクノロジーに精通した組織です。

Basetenがほとんどのビジネスチームに向かない理由

Basetenの主な注意点は、完成品ではなくインフラであるということです。サポート責任者がBasetenにログインして、すぐにチケットの自動化を始めることはできません。そこに至るまでの道のりは長く、複雑で、非常に高価なものになるでしょう。

それは次のような流れになります:

-

まず、高額な機械学習エンジニアのチームを雇う必要があります。

-

次に、彼らはカスタマーサポートのニーズに特化したAIモデルの構築やファインチューニングに数ヶ月を費やします。

-

その後、Basetenのようなプラットフォームを使ってそのモデルを稼働させます。

-

最後に、モデルとインフラを監視し続けるための継続的なエンジニアリングリソースが必要になります。

これは簡単に6ヶ月から12ヶ月かかるプロジェクトであり、今すぐ問題を解決する必要があるほとんどのビジネス部門にとっては現実的ではありません。

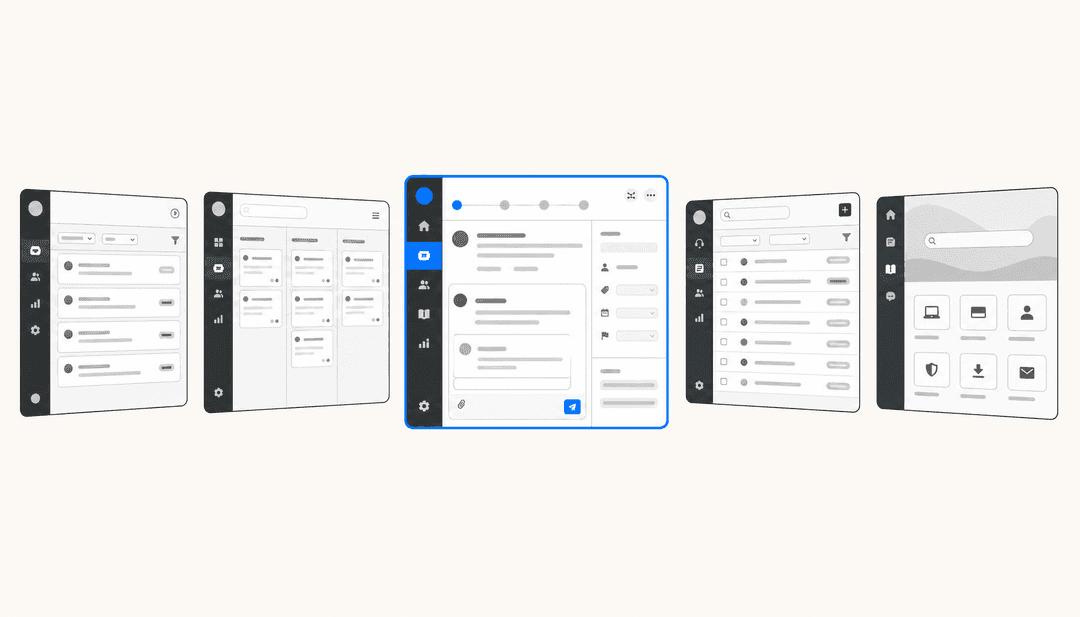

Basetenの代替案:すぐに使えるAIアプリケーション

ビジネスリーダーにとって、より賢明な選択は、その根底にある複雑さをすべて代行してくれる、特定のアプリケーションに特化したAIプラットフォームです。これらのプラットフォームは、カスタマーサポートのような特定の問題を解決するために構築されており、初日からすぐに利用できます。

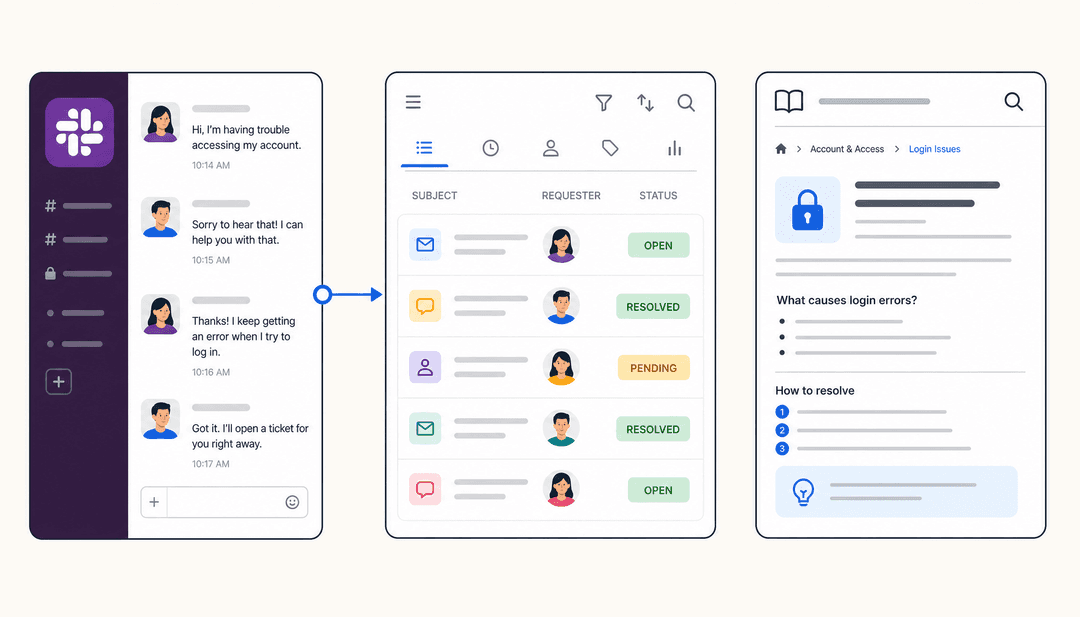

カスタマーサービスや社内ヘルプデスクに最適な例がeesel AIです。Basetenのようなインフラ上でゼロから構築する代わりに、すぐに価値を提供し始めるツールを手に入れることができます。

アプローチの違いは非常に明確です。Basetenでは、リソースを大量に消費する長期的なエンジニアリングプロジェクトに取り組むことになります。eesel AIなら、もっとシンプルです。ナレッジソースを接続し、AIの振る舞いを設定すれば、すぐに利用を開始できます。

eesel AIで実際にできることは以下の通りです:

-

数分で利用開始: ZendeskやConfluenceなどのツールをワンクリックで連携できます。MLOpsチームやカスタムコードは不要です。

-

完全なセルフサービス: 必須のデモに参加したり、長い販売サイクルに対応したりする必要はありません。サインアップ、AIの設定、過去のチケットでのテスト、そして導入まで、すべて自分で行うことができます。

-

管理はあなた自身で: どのチケットを自動化し、AIに何を許可するかを正確に決定できるため、段階的かつ安全に展開できます。

Basetenの結論:インフラか、アプリケーションか

Basetenは、AIの世界の構築者、つまり次世代のAI製品を創造する技術チームにとって、素晴らしく不可欠なプラットフォームです。複雑なモデルを大規模に実行するために必要な、生のパワーと制御を提供します。

しかし、その違いを知ることが重要です。Basetenはエンジンを提供しますが、ほとんどの企業が必要としているのは車そのものです。カスタマーサポートの自動化のような特定の業務には、アプリケーションに特化したソリューションのほうが、より速く、より安く、そしてはるかに実用的です。適切なツールは、あなたの目標次第です。新しいAI製品をゼロから構築しているのか、それとも今日のビジネス課題を解決しようとしているのか?

エンジニアリングの手間をかけずにサポートを自動化しませんか?

既存のナレッジから学習し、数分でヘルプデスクに直接接続できるAIエージェントを導入したいなら、eesel AIをチェックしてみてください。MLOpsの複雑さなしに、強力なサポートオートメーションを実現します。無料トライアルを開始して、ご自身でお確かめください。

よくある質問

Basetenは、AIを扱う企業のために具体的に何をするように設計されていますか?

Basetenは、企業が機械学習モデルを本番環境にデプロイするのを支援するAIインフラプラットフォームです。学習済みAIモデルを実行するための高性能な基盤を提供し、推論段階に焦点を当てて効率的に予測や回答を得ることができます。

Basetenの料金体系は、事前構築済みモデルとカスタムモデルの両方で、通常どのように機能しますか?

Basetenは従量課金制モデルで運営されています。API経由でアクセスする人気のオープンソースモデルについては、処理された100万トークンあたりの料金に基づいています。カスタムモデルのデプロイについては、専用のGPUまたはCPUインスタンスの分単位の使用量によって料金が決まります。

どのようなタイプのチームや組織がBasetenの理想的なユーザーですか?

Basetenは、機械学習エンジニア、データサイエンティスト、開発者など、高度に技術的な層に最も適しています。独自のAIアプリケーションを構築している、または複雑なオープンソースモデルを大規模にデプロイする必要がある、社内にMLOpsチームを持つ企業向けに設計されています。

技術的でないビジネス部門が、カスタマーサポートのようなタスクを自動化するためにBasetenを効果的に使用できますか?

いいえ、Basetenは設定と管理に高度な技術的専門知識を必要とするインフラプラットフォームです。ビジネスチームは高額なMLエンジニアを雇い、長期にわたる開発プロジェクトに着手する必要があるため、専門の技術チームなしで直接的かつ即時のビジネス課題解決に利用するのは非現実的です。