Guía de GLM 5.1: El nuevo rey de la ingeniería de IA de largo alcance

Stevia Putri

Última edición April 21, 2026

{ "title": "Guía de GLM 5.1: El nuevo rey de la ingeniería de IA de largo alcance", "keyword": "GLM 5.1", "slug": "glm-5-1", "description": "Descubre GLM 5.1, el modelo de IA insignia que establece benchmarks SOTA en codificación y tareas de largo alcance. Aprende cómo supera a Claude y GPT-5 en 2026.", "excerpt": "GLM 5.1 está redefiniendo la ingeniería agéntica. Desde un rendimiento de codificación SOTA hasta tareas autónomas de 8 horas, descubre por qué este modelo es el nuevo estándar para los compañeros de equipo de IA.", "categories": ["Blog Writer AI"], "tags": ["GLM 5.1", "Ingeniería Agéntica", "Benchmarks de IA", "IA de codificación", "Z.ai"], "coverImage": "https://cdn-public.eesel.ai/80de425a-0941-4f4b-b432-d96d9b2939f9/c14f474d-6969-45a3-a625-051b49aee7b4/40a2c72989ff40f29d371bea99d0fcc5.png", "bannerUrl": "https://cdn-public.eesel.ai/80de425a-0941-4f4b-b432-d96d9b2939f9/c14f474d-6969-45a3-a625-051b49aee7b4/40a2c72989ff40f29d371bea99d0fcc5.png", "bannerAlt": "Un logotipo futurista de GLM 5.1 con un complejo fondo de interfaz de codificación.", "faqs": [ { "question": "¿Qué es GLM 5.1?", "answer": "GLM 5.1 es un modelo de IA insignia de próxima generación de Z.ai, diseñado específicamente para tareas de ingeniería agéntica de largo alcance." }, { "question": "¿Cómo se desempeña GLM 5.1 en los benchmarks de codificación?", "answer": "GLM 5.1 alcanzó una puntuación SOTA de 58.4 en SWE-Bench Pro, superando a GPT-5.4 y Claude Opus 4.6." }, { "question": "¿Puedo ejecutar GLM 5.1 localmente?", "answer": "Sí, los pesos del modelo GLM 5.1 son de código abierto y compatibles con marcos locales como Ollama, vLLM y SGLang." } ] }

El mundo de la IA avanza rápidamente. Hemos pasado del "vibe coding", donde le pides a una IA un fragmento de código y esperas que funcione, a la "ingeniería agéntica", donde los modelos de IA asumen proyectos complejos de varios pasos de forma independiente. Pero incluso en esta nueva era, la mayoría de los modelos se topan con un muro. Empiezan con fuerza, pero a medida que la tarea se vuelve más compleja y las llamadas a herramientas se acumulan, se estancan. Agotan sus opciones, repiten errores y, finalmente, se rinden.

Aquí entra GLM-5.1. Lanzado a principios de 2026, este modelo insignia de próxima generación de Z.ai no es solo otra actualización incremental. Es un modelo construido específicamente para el "largo alcance", tareas que requieren cientos de rondas de iteración y miles de llamadas a herramientas para alcanzar un resultado óptimo.

Ya sea que estés construyendo un agente de asistencia técnica de IA totalmente autónomo o optimizando kernels de GPU de alto rendimiento, GLM 5.1 está estableciendo un nuevo estándar de lo que significa ser un compañero de equipo de IA "productivo".

Análisis de benchmarks: SOTA en ingeniería

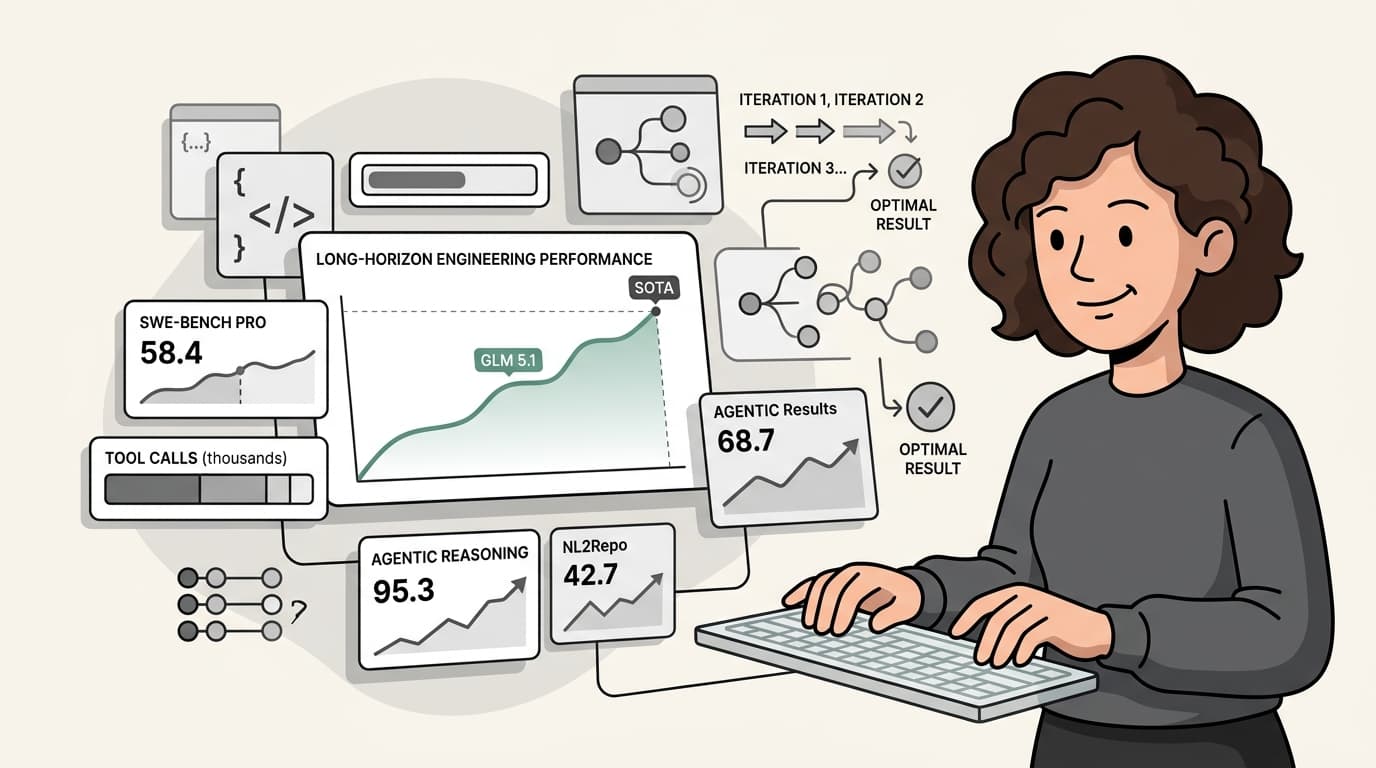

Si quieres saber cómo funciona realmente un modelo de ingeniería, debes observar los benchmarks que simulan el trabajo real. GLM 5.1 no solo participa en estos benchmarks; los lidera.

En SWE-Bench Pro, un benchmark diseñado para probar modelos en tareas complejas de ingeniería de software del mundo real, GLM 5.1 alcanzó una puntuación de vanguardia (SOTA) de 58.4. Para ponerlo en perspectiva, superó a pesos pesados como GPT-5.4 (57.7) y Claude Opus 4.6 (57.3).

Pero no se trata solo de codificación. GLM 5.1 muestra ganancias significativas en todos los ámbitos:

- Terminal-Bench 2.0: Obtuvo una puntuación de 63.5 en el marco Terminus-2, saltando a 69.0 cuando se integró con el arnés de Claude Code. Esto demuestra su increíble competencia para navegar en entornos de terminal del mundo real.

- Razonamiento: Logró un 95.3 en AIME 2026 y un 52.3 en el Humanity’s Last Exam (HLE) con herramientas, lo que demuestra que su razonamiento de alto nivel no se sacrifica por la habilidad técnica.

- Generación de repositorios: En NL2Repo, obtuvo un 42.7, lo que demuestra que puede manejar repositorios completos, no solo archivos aislados.

El patrón de "escalera": cómo GLM 5.1 resuelve problemas difíciles

La mayoría de los LLM siguen un camino predecible: resuelven las partes fáciles de un problema rápidamente y luego su rendimiento se estanca. Darles más tiempo o más llamadas a herramientas no ayuda porque ya han "agotado su repertorio".

GLM 5.1 rompe esta tendencia con lo que Z.ai llama el patrón de optimización de "escalera". En lugar de estancarse, el modelo identifica continuamente los cuellos de botella e implementa cambios estructurales para superarlos.

Tomemos como ejemplo el desafío VectorDBBench. El objetivo era construir una base de datos vectorial de alto rendimiento. Mientras que la mayoría de los modelos podrían alcanzar 3,500 QPS y detenerse, a GLM 5.1 se le permitió ejecutarse durante 600 iteraciones y más de 6,000 llamadas a herramientas.

¿El resultado? Finalmente alcanzó 21.5k QPS, aproximadamente 6 veces el mejor resultado anterior. Durante la ejecución, el modelo no solo ajustó la configuración; cambió de estrategia de forma autónoma. Pasó del escaneo de corpus completo al sondeo de clústeres IVF, y luego introdujo una canalización de dos etapas con pre-puntuación u8. Cada "escalón" en la escalera fue un momento en el que el modelo analizó sus propios registros, identificó un bloqueador y diseñó una solución estructural.

Escenarios de ingeniería agéntica del mundo real

El poder de la IA de largo alcance no es teórico; se está probando en escenarios increíblemente ambiciosos.

1. Optimización de kernels de GPU (KernelBench)

En KernelBench, los modelos tienen la tarea de tomar una implementación de referencia de PyTorch y producir un kernel de GPU más rápido. GLM 5.1 logró una aceleración de 3.6x en problemas de Nivel 3 (que cubren arquitecturas de modelos completos como MobileNet y Mamba). Mantuvo esta optimización mucho después del límite de 1,200 turnos de uso de herramientas, continuando encontrando ganancias donde sus predecesores como GLM-5 se nivelaron.

2. Construcción de un escritorio Linux en 8 horas

Quizás la demostración más impresionante fue una tarea abierta: construir un entorno de escritorio estilo Linux como una aplicación web desde cero. La mayoría de los modelos producen una barra de tareas básica y luego se detienen. GLM 5.1, sin embargo, se ejecutó durante 8 horas continuas. Construyó el explorador de archivos, la terminal, el editor de texto e incluso juegos, todo mientras aseguraba que la interfaz de usuario permaneciera visualmente consistente y las interacciones fueran fluidas.

Primeros pasos: cómo usar GLM 5.1 hoy

Ya sea que desees utilizar GLM 5.1 para tus propios proyectos o verlo en acción a través de un compañero de equipo de IA, hay varias formas de comenzar.

Acceso a la API

Puedes acceder a GLM 5.1 a través de la API oficial de Z.ai o mediante proveedores como OpenRouter. En OpenRouter, el precio es altamente competitivo a $0.698 por millón de tokens de entrada y $4.40 por millón de tokens de salida, con una enorme ventana de contexto de 202,752 tokens.

Implementación local

Para aquellos que prefieren mantener sus datos locales, los pesos del modelo están disponibles públicamente en HuggingFace bajo la Licencia MIT y la Licencia de Modelo Abierto de NVIDIA. Es compatible con los principales marcos de servicio locales, incluyendo:

- vLLM (v0.19.0+)

- SGLang (v0.5.10+)

- Ollama

Integración con eesel AI

En eesel AI, creemos que el futuro del trabajo son compañeros de equipo de IA que se encargan del trabajo pesado. La capacidad de GLM 5.1 para manejar tareas de largo alcance lo convierte en el motor perfecto para generadores de contenido de IA y agentes de soporte que no solo responden preguntas, sino que resuelven problemas complejos a lo largo del tiempo.

Conclusión: El futuro de los compañeros de equipo autónomos

GLM 5.1 representa un cambio fundamental en la capacidad de la IA. Ya no se trata solo de la primera respuesta; se trata de la tenacidad para seguir adelante hasta que el trabajo se haga correctamente. Al dominar las tareas de largo alcance, GLM 5.1 nos acerca a un mundo donde la IA no es solo una herramienta, sino un compañero de equipo verdaderamente autónomo.

A medida que avancemos en 2026, la brecha entre los modelos "suficientemente buenos" y aquellos que pueden mantener la optimización durante miles de pasos solo se ampliará. Si estás construyendo para el futuro de la ingeniería, GLM 5.1 es la frontera.

Preguntas frecuentes

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.