GLM 5.1: ¿El fin del estancamiento de la IA? | eesel AI

Stevia Putri

Última edición April 21, 2026

Si has pasado algo de tiempo trabajando con asistentes de programación basados en IA últimamente, probablemente te hayas topado con el "estancamiento". Empiezas una sesión, el modelo te da unas primeras líneas brillantes y luego... simplemente se rinde. Empieza a repetir el mismo código con errores, ignora tus comentarios o pierde completamente el hilo después de unas cuantas rondas de depuración.

Es frustrante porque sabemos que la inteligencia está ahí, pero la resistencia no.

Llega GLM 5.1.

Lanzado por Z.AI (Zhipu AI) en abril de 2026, GLM 5.1 no es solo otra actualización incremental en la clasificación de LLMs. Es un modelo construido específicamente para abordar lo que los investigadores llaman tareas de "largo alcance" (el tipo de proyectos de ingeniería complejos y de varios pasos que normalmente hacen que la IA se bloquee y falle).

Tanto si eres un líder de desarrollo que busca agentes autónomos más fiables como si eres un ingeniero cansado de supervisar constantemente a tu IA, GLM 5.1 representa un cambio masivo en cómo pensamos sobre la "ingeniería agéntica".

El problema del "estancamiento": Por qué otros modelos fallan en tareas largas

La mayoría de los LLMs (incluso los pesos pesados como GPT-5.4 y Claude 4.6) están optimizados para un rendimiento de "un solo intento" o de sesiones cortas. Están diseñados para darte la respuesta correcta de inmediato. Y para la mayoría de las cosas, eso es genial.

Pero la ingeniería no es un juego de un solo intento. Es un proceso iterativo de experimentación, fracaso y refinamiento. Cuando le pides a un modelo tradicional que resuelva un error complejo a nivel de repositorio, a menudo agota su repertorio pronto. Aplica primero las soluciones más obvias y, si no funcionan, alcanza un techo de rendimiento. Darle más tiempo o más llamadas a herramientas normalmente no ayuda; simplemente se queda dando vueltas.

Este "estancamiento" ocurre porque la mayoría de los modelos carecen del juicio interno para darse cuenta de cuándo una estrategia no está funcionando. No pueden "retroceder" eficazmente o replantearse todo su enfoque. En cambio, siguen cavando el mismo agujero, hundiéndose cada vez más en un callejón sin salida lógico.

Avance: Cómo GLM 5.1 maneja las tareas de largo alcance

GLM 5.1 fue construido con una filosofía diferente: cuanto más tiempo se ejecute, mejor debería ser el resultado.

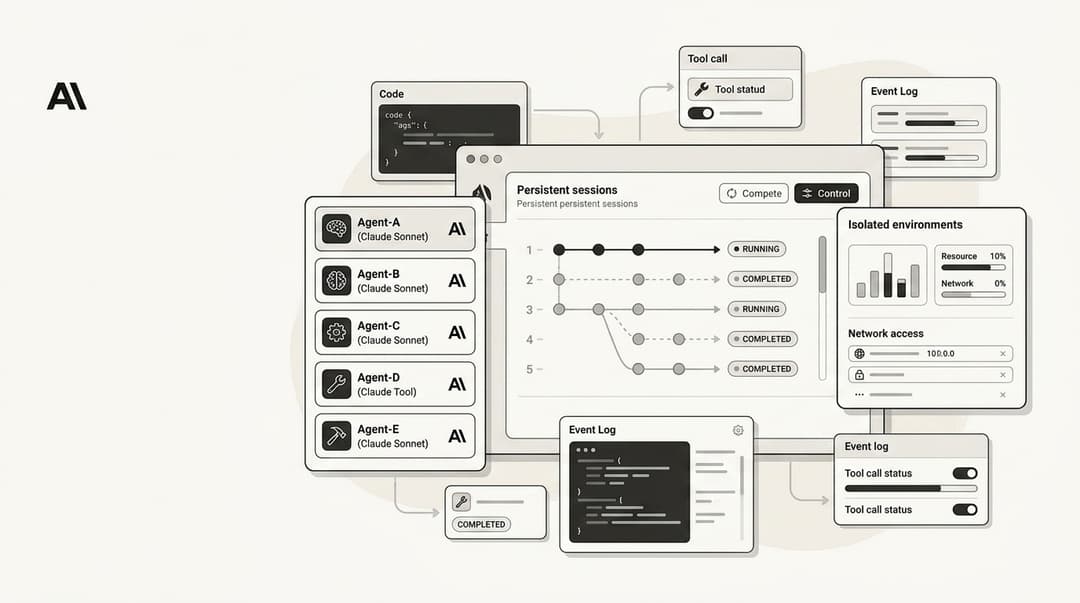

Esto no es solo marketing. Z.AI ha optimizado el modelo para sesiones que duran más de mil llamadas a herramientas. El ingrediente secreto es algo que llaman "Razonamiento basado en reflexión".

En lugar de simplemente avanzar a ciegas, GLM 5.1 utiliza un bucle de reflexión interna para evaluar sus pasos intermedios. Si un comando falla o una suite de pruebas no pasa, el modelo tiene el juicio necesario para decir: "Espera, toda esta estrategia es incorrecta", y retroceder a un punto de decisión anterior.

Esta capacidad de "largo alcance" significa que el modelo puede manejar problemas ambiguos con un juicio mucho mejor. Se mantiene productivo durante sesiones de horas de duración, desglosando problemas complejos, ejecutando experimentos e identificando bloqueos con verdadera precisión. Es la diferencia entre un desarrollador junior que necesita supervisión constante y un desarrollador senior al que se puede dejar solo para resolver un ticket de principio a fin.

Duelo de benchmarks: Liderando las clasificaciones

Los números respaldan el entusiasmo. En SWE-Bench Pro (el estándar de oro para evaluar cómo los agentes de IA resuelven problemas reales de GitHub), GLM 5.1 logró una asombrosa tasa de éxito del 58.4%.

Como contexto, eso supera a GPT-5.4 (57.7%) y a Claude Opus 4.6 (57.3%). Aunque esos márgenes puedan parecer pequeños, en el mundo de los agentes autónomos, cada punto porcentual representa miles de horas humanas ahorradas en la corrección de errores.

Pero no se trata solo de un benchmark. GLM 5.1 también lidera en:

- Terminal-Bench 2.0: Un benchmark para tareas de terminal del mundo real como la configuración de entornos y el análisis de registros.

- NL2Repo: Una prueba para generar repositorios completos y arquitectónicamente consistentes desde cero.

Estas puntuaciones demuestran que GLM 5.1 es más que un simple chatbot; es una potencia para sistemas autónomos.

Guía práctica: Cómo implementar y usar GLM 5.1 hoy mismo

La buena noticia es que no necesitas una granja de servidores masiva para empezar a jugar con esto. GLM 5.1 es sorprendentemente accesible.

Acceso a la API

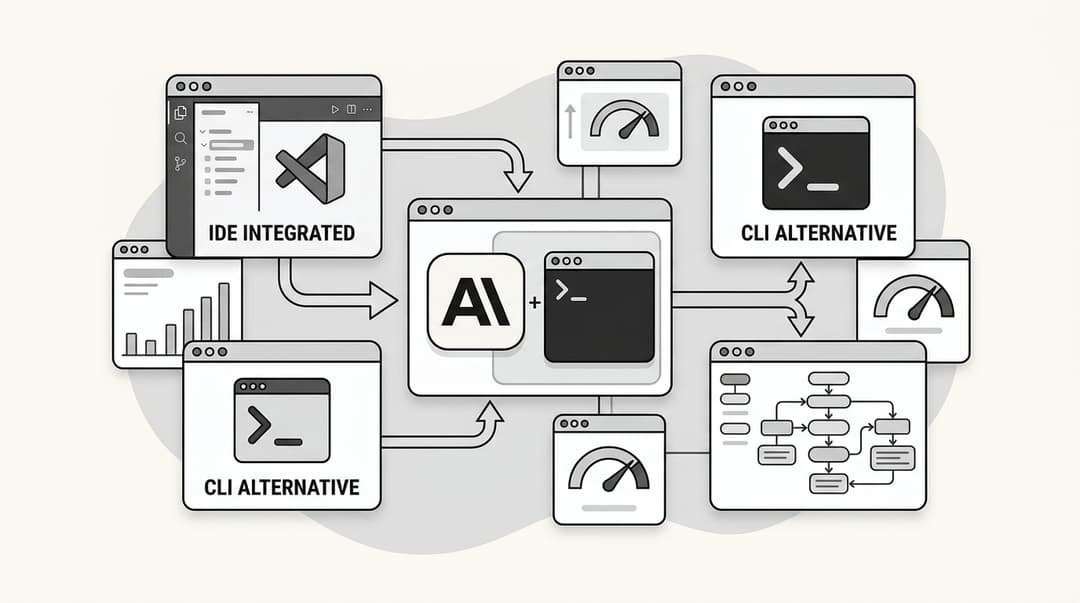

Para la mayoría de los casos de uso en producción, querrás optar por la vía de la API. A fecha de abril de 2026, OpenRouter y NVIDIA Build son los proveedores principales.

- Precios de OpenRouter: Alrededor de $2.00 por cada 1M de tokens de entrada y $6.00 por cada 1M de tokens de salida.

- NVIDIA Build: Ofrece tarifas ligeramente más competitivas y créditos gratuitos para que los desarrolladores prueben el modelo.

Implementación local

Si te preocupa la privacidad o simplemente te gusta ejecutar cosas en tu propio hardware, Ollama ya ha añadido soporte para GLM 5.1. Puedes ejecutarlo localmente en formatos GGUF o FP16, aunque necesitarás una configuración de GPU decente para aprovechar al máximo la versión insignia.

Consejo profesional para prompts

Debido a que GLM 5.1 está construido para la iteración, no tengas miedo de darle tareas complejas y abiertas. En lugar de dividir las cosas en pequeños pasos para el modelo, dale el objetivo y las herramientas, y deja que su bucle de reflexión interna se encargue del trabajo pesado.

La perspectiva de eesel AI: LLMs para soporte autónomo

En eesel AI, buscamos constantemente formas de hacer que nuestros agentes de soporte autónomo sean aún más fiables. Para nosotros, el avance del "largo alcance" es un punto de inflexión.

Los tickets de atención al cliente a menudo requieren una depuración de varios pasos (revisar la cuenta de un cliente, mirar archivos de registro, verificar una integración técnica y luego formular una solución). Si un agente de IA se "estanca" a mitad de ese proceso, el cliente recibe una mala experiencia.

La capacidad de GLM 5.1 para persistir a través de cientos de llamadas a herramientas y autocorregirse cuando llega a un muro es exactamente lo que se necesita para un soporte verdaderamente autónomo. Nos permite ejecutar "modos de simulación" más fiables donde probamos la IA en miles de tickets pasados para asegurar que nunca llegue a un callejón sin salida de razonamiento.

Descubre cómo eesel AI construye agentes autónomos

Conclusión

El lanzamiento de GLM 5.1 marca el fin de la era del "estancamiento de la IA". Nos estamos alejando de los modelos que solo responden preguntas y nos dirigimos hacia compañeros de equipo agénticos que pueden resolver problemas.

La capacidad de seguir intentándolo, de retroceder y de mantener la productividad a lo largo de horizontes largos es lo que definirá a la próxima generación de herramientas de IA. Si aún no lo has probado, GLM 5.1 es un gran lugar para empezar.

Preguntas frecuentes

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.