Frecuentemente se lanzan nuevos modelos de IA, y uno que está ganando una atención significativa es DeepSeek V3.2. Este nuevo modelo de pesos abiertos (open-weight) de DeepSeek AI destaca por su rendimiento, que está siendo comparado con modelos como GPT-5.

Si bien esto representa un paso importante para desarrolladores e investigadores, los detalles técnicos pueden ser complejos. Para las empresas, la pregunta principal gira en torno a sus aplicaciones prácticas. Comprender sus usos, limitaciones y los costos involucrados es clave para aprovechar sus capacidades.

¿Qué es DeepSeek V3.2?

DeepSeek V3.2 es un modelo de lenguaje de gran tamaño (LLM) construido para ser potente y eficiente desde el punto de vista computacional. Es el sucesor oficial del modelo experimental V3.2-Exp y está diseñado para manejar tareas de razonamiento difíciles y actuar como un agente de IA capaz sin necesidad de una supercomputadora para cada trabajo.

Sin embargo, 3.2 Speciale... ¿no es la parte 'Speciale' simplemente para hacerlo mejor en matemáticas? No estoy seguro de si las mejoras de '3.2 Speciale' sobre '3.2' servirán de algo para la escritura. (NO hablo de '3.2 Exp', el que ha estado disponible por un tiempo. Hablo de los dos que salieron hoy: '3.2' vs '3.2 Speciale').

Se presenta en un par de versiones diferentes:

-

DeepSeek V3.2: Esta es la versión principal, disponible a través de una interfaz web, aplicación y API. Piense en ella como la opción versátil y todoterreno, excelente para una amplia gama de tareas y particularmente buena en el uso de herramientas externas para completar trabajos.

-

DeepSeek V3.2-Speciale: Este es un especialista, disponible solo a través de API. Fue entrenado exclusivamente en tareas de razonamiento profundo y sobresale en programación competitiva y matemáticas avanzadas. La desventaja es que no admite llamadas a herramientas (tool-calling), por lo que es menos generalista. Además, solo está disponible por tiempo limitado, a través de un endpoint temporal hasta el 15 de diciembre de 2025.

Lo que hace que esto sea un gran acontecimiento es que se trata de un modelo de "pesos abiertos". Esto significa que los componentes centrales del modelo (sus pesos) están disponibles públicamente en plataformas como Hugging Face, tanto para la versión estándar como para la Speciale. Esto abre la puerta para que investigadores y desarrolladores construyan sobre él, lo personalicen y vean qué es posible.

Características clave de DeepSeek V3.2

El rendimiento del modelo se atribuye a varias innovaciones que mejoran su velocidad, inteligencia y capacidades.

Mayor eficiencia con DeepSeek Sparse Attention (DSA)

Uno de los mayores cuellos de botella para los LLM es la "atención", que es cómo el modelo revisa el contexto de una conversación para generar una respuesta relevante. La atención normal es costosa computacionalmente porque la IA tiene que analizar cada palabra anterior.

DeepSeek V3.2 utiliza un enfoque más inteligente llamado DeepSeek Sparse Attention (DSA). Cuenta con un "indexador relámpago" y un "selector de tókenes" que encuentran y se enfocan rápidamente solo en las partes más relevantes del texto. En lugar de analizarlo todo, selecciona las piezas clave.

Este cambio reduce significativamente la carga computacional, mejorando la velocidad y reduciendo los costos, especialmente para tareas que involucran documentos largos o historiales de chat. Es una innovación que se probó por primera vez en el modelo experimental V3.2-Exp y que ahora ha sido perfeccionada.

Aprendizaje por refuerzo escalable para un razonamiento avanzado

Para llegar a ser realmente bueno en el razonamiento complejo, DeepSeek V3.2 fue entrenado utilizando un método llamado Aprendizaje por Refuerzo con Recompensas Verificables (RLVR). En lugar de solo recibir retroalimentación de humanos, el modelo es recompensado por producir respuestas verificablemente correctas en áreas como matemáticas y programación. Esto es análogo a recompensar a un estudiante por mostrar su procedimiento, no solo por obtener el resultado correcto.

También aprende a verificar su propio trabajo. El modelo puede comprobar sus pasos de razonamiento y refinar sus respuestas, lo que conduce a resultados más confiables. Como señalaron sus creadores, esto es importante porque "las respuestas correctas no garantizan un razonamiento correcto".

El modelo incluso tiene un modo de "Pensamiento" (Thinking), disponible en el modelo de API deepseek-reasoner, que le permite planificar y razonar sobre una tarea antes de generar una respuesta. Este es un gran paso hacia una IA más reflexiva y precisa.

Capacidades de agente e integración de herramientas

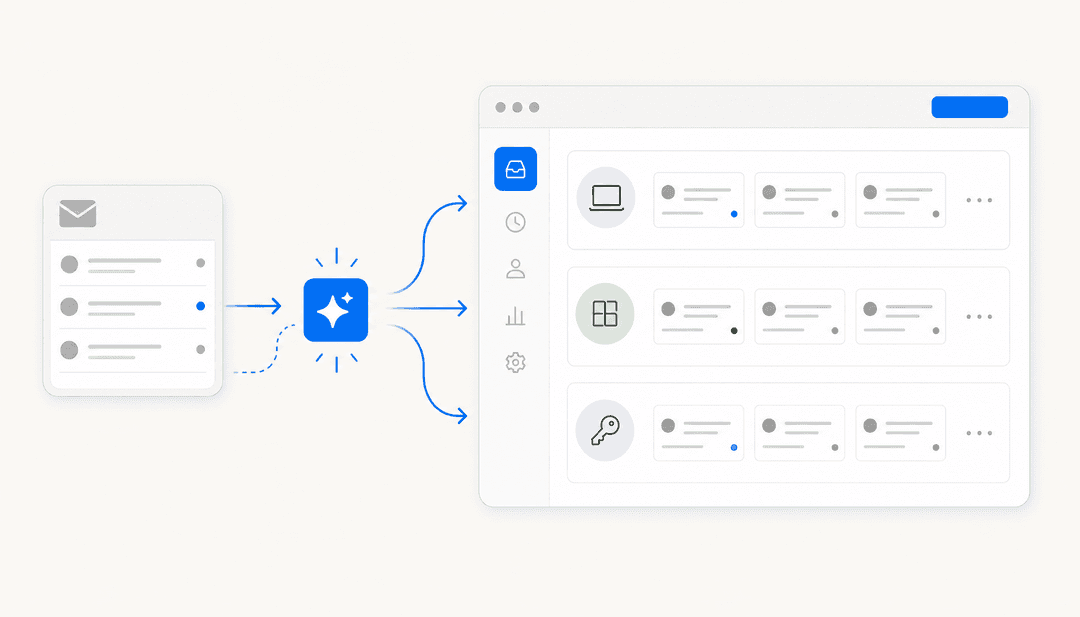

DeepSeek V3.2 no se trata solo de generar texto; está diseñado para ser un "agente" que puede usar herramientas externas para completar tareas. Fue entrenado utilizando un flujo de trabajo con más de 1.800 entornos.

Esto es lo que permite que la IA pase de solo hablar sobre algo a hacerlo realmente, como buscar un pedido o procesar un reembolso. Para las empresas, esta es una capacidad significativa. Sin embargo, construir y gestionar conexiones con sus herramientas comerciales específicas (como Zendesk para tickets de soporte o Shopify para comercio electrónico) es un proyecto de ingeniería considerable si solo se utiliza el modelo base. Es un motor potente, pero usted todavía tiene que construir el coche a su alrededor.

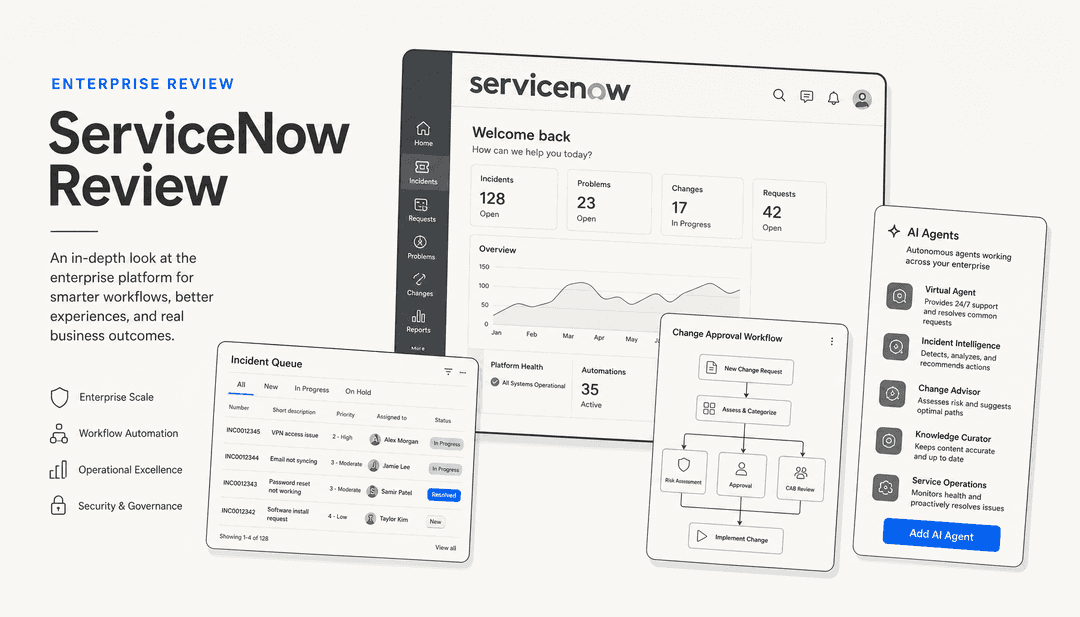

Rendimiento y comparativas (benchmarks) de DeepSeek V3.2

El equipo de DeepSeek AI ha sido transparente, publicando extensas comparativas en su informe técnico. Los resultados muestran que V3.2 no solo está alcanzando a los modelos propietarios; está compitiendo directamente con los mejores del mundo.

Comparación con modelos líderes

El informe técnico oficial muestra que el modelo DeepSeek V3.2 estándar rinde a la par de GPT-5 en comparativas clave. Según se informa, la variante V3.2-Speciale supera a GPT-5 en razonamiento y tiene un rendimiento comparable al de Gemini-3.0-Pro.

Acabo de probarlo en OpenRouter ya que la web de DeepSeek todavía tiene la versión antigua, y luego le hice mis preguntas más difíciles que solo Sonnet 4.5, Opus 4.5 y Gemini 3.0 pueden resolver. Resultados: DeepSeek v3.2 Speciale también las responde correctamente. Es el primer modelo abierto que hace eso, ni siquiera GLM 4.6 pudo.

Aquí hay un vistazo rápido de cómo se comparan los modelos en algunas de las pruebas de evaluación más difíciles:

| Modelo | HLE (Holistic Language Evaluation) | Codeforces (Elo) | MMLU-Pro | GPQA-Diamond |

|---|---|---|---|---|

| DeepSeek V3.2 | 21.7 | 2046 | 85.0 | 80.7 |

| DeepSeek V3.2-Speciale | 25.1 | 2401 | 86.2 | 84.1 |

| GPT-5 | 23.5 | 2355 | 85.8 | 83.0 |

| Gemini-3.0-Pro | 26.3 | 2420 | 86.5 | 84.8 |

Logros en dominios especializados

Más allá de las puntuaciones en las comparativas, el modelo ha demostrado logros notables en el mundo real. El modelo V3.2-Speciale demostró un rendimiento de alto nivel en competencias académicas internacionales.

También superó pruebas en las Finales Mundiales de la ICPC y la Olimpiada Matemática de China. Esto demuestra su capacidad para manejar problemas complejos y especializados, extendiéndose más allá de la simple generación de texto hacia la resolución de problemas de alto nivel.

Consideraciones prácticas para el uso de DeepSeek V3.2

Aunque el poder bruto del modelo es innegable, convertirlo en una herramienta útil para su empresa requiere una planificación práctica. No es exactamente una solución de "conectar y listo".

Ciertamente es bueno escribiendo escenas convincentes y creativas. Sin embargo, parece que es un modelo al que le gusta suplantar identidades y eso es algo inaceptable. Tendré que ver si se le puede guiar para evitar ese error, porque de lo contrario, veo que se convertirá en uno de mis habituales.

Cómo acceder y ejecutar el modelo DeepSeek V3.2

La forma más fácil de comenzar es utilizando la API de la plataforma DeepSeek. Puede registrarse y comenzar a realizar llamadas de inmediato. Recuerde que la variante Speciale, altamente especializada, está en un endpoint temporal que expira el 15 de diciembre de 2025.

Ejecutar el modelo en sus propios servidores es técnicamente posible, pero es una tarea seria. Requiere código personalizado, herramientas especializadas como vLLM y una gran cantidad de hardware de GPU costoso. Para la mayoría de las empresas, esta simplemente no es una opción práctica.

Precios de la API y costo de DeepSeek V3.2

DeepSeek V3.2 tiene un precio por cada millón de tókenes (un tóken es básicamente una palabra o parte de una palabra). El costo es competitivo, pero puede aumentar rápidamente si se utiliza a gran escala. El precio también cambia según si el modelo está en "Modo Pensamiento" y si el texto de entrada ha sido procesado anteriormente (un "cache hit" o acierto de caché).

Aquí está el desglose de su página oficial de precios:

| Versión del modelo | Precio de entrada (1M Tókenes) | Precio de salida (1M Tókenes) |

|---|---|---|

| DeepSeek-V3.2 (Sin pensamiento) | $0.28 (cache miss) / $0.028 (cache hit) | $0.42 |

| DeepSeek-V3.2 (Con pensamiento) | $0.28 (cache miss) / $0.028 (cache hit) | $0.42 |

El modelo V3.2-Speciale se ofrece al mismo precio mientras esté disponible, lo cual es una excelente oferta por su potencia especializada.

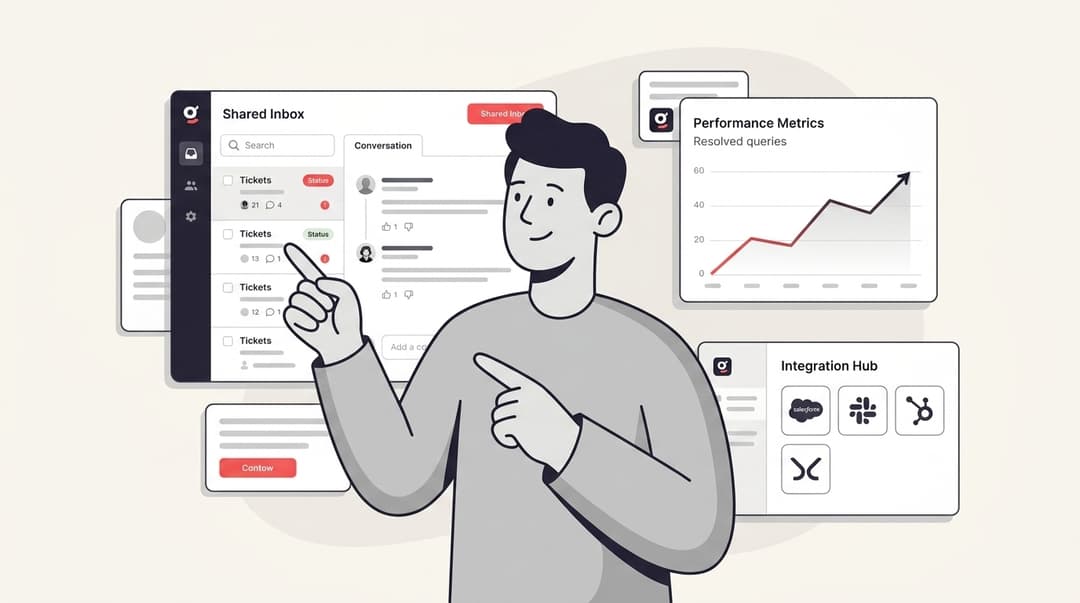

La brecha entre un modelo y una solución empresarial

Una consideración clave es que DeepSeek V3.2 es un motor fundamental. Para una empresa, una solución completa requiere más que el motor por sí solo. Un LLM básico es solo un componente de un sistema más grande.

Esto es lo que falta si solo usa la API:

-

Integraciones: El modelo no puede hablar con su servicio de ayuda, plataforma de comercio electrónico o wiki interna de forma predeterminada. Conectarlo a sus sistemas comerciales como Zendesk, Shopify o Slack requiere una gran cantidad de trabajo de desarrollo personalizado.

-

Capa de aplicación: No hay un panel de control para que lo use su equipo, no hay informes para ver cómo está rindiendo y no hay una forma sencilla de establecer reglas comerciales como: "Escalar siempre las preguntas de facturación a un humano".

-

Ciclo de aprendizaje continuo: El modelo no aprenderá automáticamente de sus últimos tickets de soporte o artículos actualizados de la base de conocimientos. Tendría que construir todo un flujo de datos para mantenerlo al día.

-

Privacidad de datos: La política de privacidad de DeepSeek menciona que los datos del usuario podrían ser utilizados para mejorar sus servicios (aunque puede optar por no participar), y los datos se almacenan en la PRC. Esto puede ser un impedimento para empresas con requisitos estrictos de residencia de datos o privacidad.

Aquí es donde plataformas como eesel AI pueden ser útiles. eesel proporciona una solución de IA para el servicio al cliente que integra modelos potentes. Está diseñada para conectarse a herramientas empresariales, aprender de los datos existentes y permitir pruebas de rendimiento en un entorno seguro antes de la interacción con el cliente. eesel también cuenta con políticas con respecto a la privacidad de datos, como garantizar contractualmente que los datos no se utilicen para entrenamiento y ofrecer residencia de datos en la UE para necesidades de cumplimiento.

Un gran paso para los modelos abiertos

DeepSeek V3.2 representa un logro significativo en los modelos de pesos abiertos, proporcionando a los desarrolladores una nueva y poderosa herramienta. Demuestra que la IA de alto rendimiento se está volviendo más accesible.

Para profundizar en los logros técnicos y lo que hace que este modelo sea un posible nuevo contendiente de vanguardia, este video de bycloud ofrece una excelente explicación visual de sus capacidades.

Los siguientes pasos pueden considerarse desde dos perspectivas:

-

Para desarrolladores: La API de DeepSeek y los modelos en Hugging Face ofrecen una forma directa de explorar las capacidades del modelo.

-

Para líderes empresariales: El creciente poder y accesibilidad de los modelos de IA presentan una elección. Las empresas pueden desarrollar soluciones internas o asociarse con plataformas que se especializan en integrar esta tecnología en herramientas empresariales seguras y confiables.

Para las empresas que buscan aplicar la IA para la automatización del soporte y la eficiencia de los agentes, existen soluciones como eesel AI. eesel está diseñado para integrarse con los sistemas comerciales y aprender de los datos de la empresa para proporcionar resoluciones automatizadas a los clientes, con resultados reportados de hasta un 81% de resolución autónoma.

Preguntas frecuentes

DeepSeek V3.2 destaca por su naturaleza de "pesos abiertos" (open-weight), lo que permite a los desarrolladores construir sobre él, y su uso de DeepSeek Sparse Attention (DSA) para una mayor eficiencia. Esto significa que es potente y, al mismo tiempo, requiere menos recursos computacionales, especialmente para tareas con contextos largos.

Aunque puede acceder a DeepSeek V3.2 a través de su API, utilizarlo de manera efectiva para un negocio requiere un trabajo de desarrollo significativo. Necesitaría crear integraciones con sus herramientas existentes (como Zendesk o Shopify), crear una interfaz de usuario y gestionar los flujos de datos. Plataformas como eesel AI se encargan de esto por usted, proporcionando una solución lista para usar impulsada por modelos como este.

No, DeepSeek V3.2 no es gratuito. Su precio se basa en el uso de tókenes a través de su API. El costo varía dependiendo de si está utilizando el modo estándar o el modo "Thinking" (Pensamiento), y puede acumularse rápidamente a gran escala. Aunque los pesos del modelo están abiertos para investigadores, el uso comercial a través de la API es un servicio de pago.

Según su informe técnico oficial, el modelo DeepSeek V3.2 estándar rinde a la par de GPT-5 en varias comparativas clave. La versión especializada, DeepSeek V3.2-Speciale, incluso supera a GPT-5 en tareas de razonamiento complejo, lo que lo convierte en un competidor de primer nivel en el espacio de la IA.

Las principales limitaciones son de carácter práctico. El modelo base carece de integraciones específicas para empresas, de una capa de aplicación fácil de usar y de un ciclo de aprendizaje automático. Además, su política de privacidad de datos, que señala que los datos se almacenan en la República Popular China (PRC), podría ser una preocupación para empresas con requisitos estrictos de residencia de datos.

El DeepSeek V3.2 estándar es un modelo versátil que admite llamadas a herramientas (tool-calling), lo que lo hace ideal para una amplia gama de tareas de agentes. DeepSeek V3.2-Speciale es una versión altamente especializada entrenada para el razonamiento profundo, destacando en matemáticas y programación, pero no admite llamadas a herramientas y solo está disponible por tiempo limitado.

Share this article

Article by

Stevia Putri

Stevia Putri es generalista de marketing en eesel AI, donde ayuda a convertir potentes herramientas de IA en historias que resuenan. Se mueve por la curiosidad, la claridad y el lado humano de la tecnología.