GLM 5.1: O Fim do Platô da IA? | eesel AI

Stevia Putri

Última edição April 21, 2026

Se você passou algum tempo trabalhando com assistentes de codificação de IA ultimamente, provavelmente atingiu o "platô". Você inicia uma sessão, o modelo lhe dá as primeiras linhas brilhantes e, então... ele simplesmente desiste. Ele começa a repetir o mesmo código com erros, ignora seu feedback ou perde completamente o fio da meada após algumas rodadas de depuração.

É frustrante porque sabemos que a inteligência está lá, mas a resistência não.

Apresentamos o GLM 5.1.

Lançado pela Z.AI (Zhipu AI) em abril de 2026, o GLM 5.1 não é apenas mais uma atualização incremental no ranking de LLMs. É um modelo construído especificamente para lidar com o que os pesquisadores chamam de tarefas de "longo horizonte" (o tipo de projeto de engenharia complexo e de várias etapas que geralmente faz a IA travar e falhar).

Se você é um líder de desenvolvimento em busca de agentes autônomos mais confiáveis ou um engenheiro cansado de supervisionar sua IA, o GLM 5.1 representa uma mudança massiva em como pensamos sobre a "engenharia agêntica".

O Problema do "Platô": Por que outros modelos falham em tarefas longas

A maioria dos LLMs (mesmo os pesos-pesados como GPT-5.4 e Claude 4.6) são otimizados para desempenho de "tiro único" ou sessões curtas. Eles são criados para lhe dar a resposta certa imediatamente. E, para a maioria das coisas, isso é ótimo.

Mas a engenharia não é um jogo de uma única tacada. É um processo iterativo de experimentação, falha e refinamento. Quando você pede a um modelo tradicional para resolver um bug complexo em nível de repositório, ele geralmente esgota seu repertório rapidamente. Ele aplica as correções mais óbvias primeiro e, se elas não funcionarem, atinge um teto de desempenho. Dar a ele mais tempo ou mais chamadas de ferramentas geralmente não ajuda; ele apenas gira em falso.

Esse "platô" acontece porque a maioria dos modelos carece de julgamento interno para perceber quando uma estratégia não está funcionando. Eles não conseguem efetivamente "voltar atrás" ou repensar toda a sua abordagem. Em vez disso, continuam cavando o mesmo buraco, ficando cada vez mais presos em um beco sem saída lógico.

Avanço: Como o GLM 5.1 lida com tarefas de longo horizonte

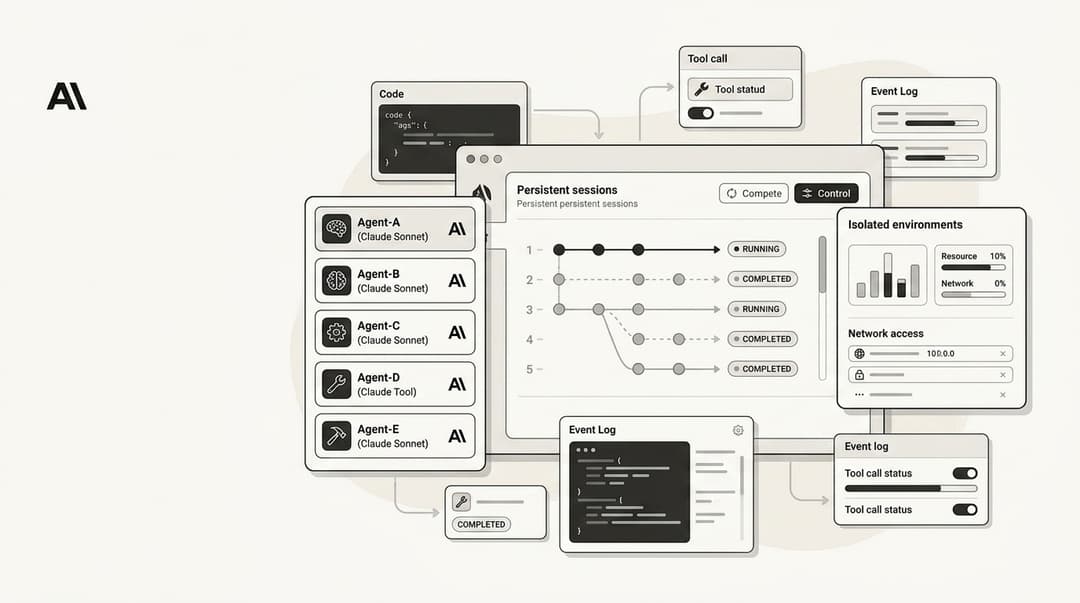

O GLM 5.1 foi construído com uma filosofia diferente: quanto mais tempo ele roda, melhor deve ser o resultado.

Isso não é apenas marketing. A Z.AI otimizou o modelo para sessões que duram mais de mil chamadas de ferramentas. O segredo é algo que eles chamam de "Raciocínio baseado em Reflexão".

Em vez de apenas seguir em frente, o GLM 5.1 usa um loop de reflexão interna para avaliar suas etapas intermediárias. Se um comando falha ou um conjunto de testes não passa, o modelo tem o discernimento para dizer: "Espere, toda essa estratégia está errada" e voltar a um ponto de decisão anterior.

Essa capacidade de "longo horizonte" significa que o modelo pode lidar com problemas ambíguos com muito mais critério. Ele permanece produtivo durante sessões de horas, dividindo problemas complexos, executando experimentos e identificando bloqueadores com precisão real. É a diferença entre um desenvolvedor júnior que precisa de supervisão constante e um desenvolvedor sênior que pode ser deixado sozinho para resolver um ticket do início ao fim.

Confronto de Benchmarks: Liderando os Rankings

Os números confirmam o hype. No SWE-Bench Pro (o padrão ouro para avaliar como agentes de IA resolvem problemas reais do GitHub), o GLM 5.1 alcançou uma impressionante taxa de sucesso de 58,4%.

Para contexto, isso supera o GPT-5.4 (57,7%) e o Claude Opus 4.6 (57,3%). Embora essas margens possam parecer pequenas, no mundo dos agentes autônomos, cada ponto percentual representa milhares de horas humanas economizadas na correção de bugs.

Mas não se trata apenas de um benchmark. O GLM 5.1 também lidera em:

- Terminal-Bench 2.0: Um benchmark para tarefas reais de terminal, como configuração de ambiente e análise de logs.

- NL2Repo: Um teste para gerar repositórios inteiros e arquitetonicamente consistentes do zero.

Essas pontuações provam que o GLM 5.1 é mais do que apenas um chatbot; é uma potência para sistemas autônomos.

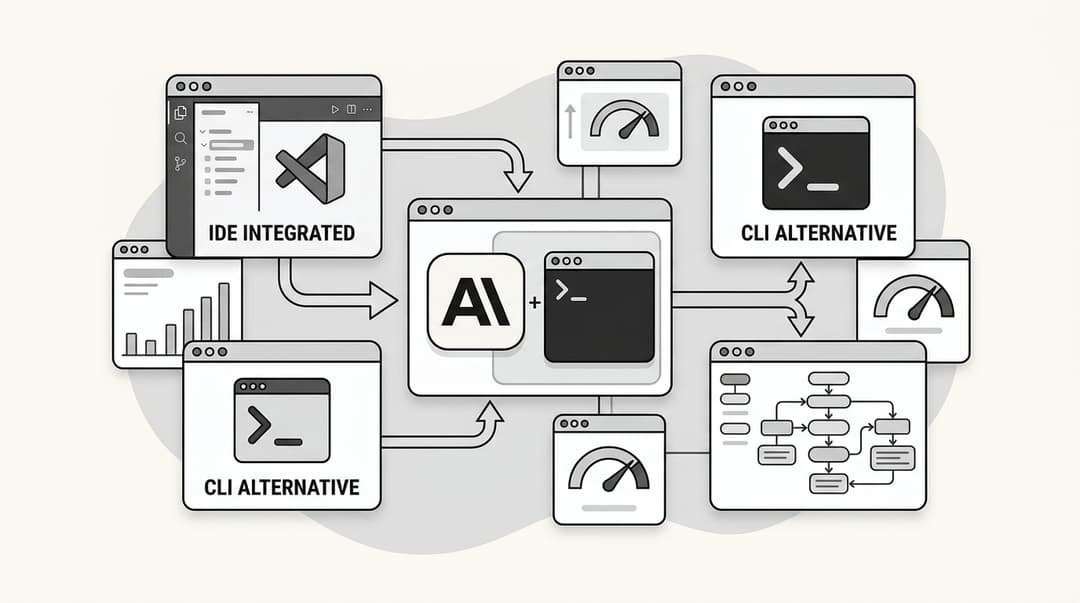

Guia Prático: Como implantar e usar o GLM 5.1 hoje

A boa notícia é que você não precisa de uma enorme fazenda de servidores para começar a brincar com isso. O GLM 5.1 é surpreendentemente acessível.

Acesso à API

Para a maioria dos casos de uso em produção, você vai querer seguir o caminho da API. Em abril de 2026, o OpenRouter e o NVIDIA Build são os principais provedores.

- Preços do OpenRouter: Cerca de US$ 2,00 por 1 milhão de tokens de entrada e US$ 6,00 por 1 milhão de tokens de saída.

- NVIDIA Build: Oferece taxas ligeiramente mais competitivas e créditos gratuitos para desenvolvedores testarem o modelo.

Implantação Local

Se você se preocupa com privacidade ou apenas gosta de rodar as coisas em seu próprio hardware, o Ollama já adicionou suporte para o GLM 5.1. Você pode executá-lo localmente em formatos GGUF ou FP16, embora precise de uma configuração de GPU decente para aproveitar ao máximo a versão principal.

Dica Pro para Prompting

Como o GLM 5.1 foi construído para iteração, não tenha medo de dar a ele tarefas complexas e abertas. Em vez de dividir as coisas em pequenas etapas para o modelo, dê a ele o objetivo e as ferramentas, e deixe que seu loop de reflexão interna cuide do trabalho pesado.

A Perspectiva da eesel AI: LLMs para Suporte Autônomo

Na eesel AI, estamos constantemente procurando maneiras de tornar nossos agentes de suporte autônomos ainda mais confiáveis. Para nós, o avanço do "longo horizonte" é um divisor de águas.

Tickets de suporte ao cliente geralmente exigem depuração de várias etapas (verificar a conta de um cliente, analisar arquivos de log, verificar uma integração técnica e, então, formular uma correção). Se um agente de IA "atinge um platô" no meio desse processo, o cliente tem uma experiência ruim.

A capacidade do GLM 5.1 de persistir através de centenas de chamadas de ferramentas e se autocorrigir quando atinge uma parede é exatamente o que é necessário para um suporte verdadeiramente autônomo. Isso nos permite executar "modos de simulação" mais confiáveis, onde testamos a IA em milhares de tickets passados para garantir que ela nunca atinja um beco sem saída de raciocínio.

Veja como a eesel AI constrói agentes autônomos

Conclusão

O lançamento do GLM 5.1 marca o fim da era do "platô da IA". Estamos nos afastando de modelos que apenas respondem perguntas e caminhando em direção a colegas de equipe agênticos que podem resolver problemas.

A capacidade de continuar tentando, de voltar atrás e de manter a produtividade em longos horizontes é o que definirá a próxima geração de ferramentas de IA. Se você ainda não experimentou, o GLM 5.1 é um ótimo lugar para começar.

Perguntas Frequentes

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.