AIはコンテンツ作成の方法を確実に変えました。わずか数分でブログ記事を生成できるのは、非常に大きな助けになります。しかし、そこには無視できない落とし穴があります。AIモデルは文章の次の単語を予測するように設計されており、その単語が事実として正しいかどうかを理解しているわけではありません。これは、重大な誤り、微妙なバイアス、そして単に奇妙な「ハルシネーション(hallucinations:幻覚)」につながる可能性があります。

リスクは想像以上に高いものです。すでに、AIが捏造した架空の判例を引用して法廷で問題になった弁護士の例もあります。これは決して良い状況ではありません。

なぜAI生成コンテンツのファクトチェック方法を知ることが重要なのか

AIファクトチェックとは、実際には何でしょうか?それは、AIツールが生成したすべての情報が正確で信頼でき、最新であることを人間が検証するプロセスです。自分自身を、AIのアウトプットに対する編集長だと考えてください。

主な問題は、AIモデルがパターンの認識と言語の予測に非常に優れている点です。説得力のある、構成の整った文章を書くことはできますが、組み込みの真実検出器は持っていません。統計に基づいて単語を組み立てるため、確認せずにコピー&ペーストすると大きなリスクが生じます。

- 評判へのダメージ: 読者との信頼関係を築くには何年もかかりますが、不正確な投稿一つでそれを失う可能性があります。間違いだらけのコンテンツを公開し始めれば、人々はあなたを信頼できる情報源とは見なさなくなるでしょう。

- 法的および倫理的リスク: 特定の分野では、誤った情報は単に恥ずかしいだけでなく、危険を伴うこともあります。ChatGPTを法的リサーチに使用した弁護士が、完全に捏造された判例を含む準備書面を提出し、裁判官から厳しい追及を受けた事例があります。

- 検索エンジンによるペナルティ: Googleなどの検索エンジンは、専門性、権威性、信頼性(E-E-A-T)を示すコンテンツを優先するようになっています。低品質で不正確な記事を公開することは、SEOランキングを損なう可能性があります。

評判へのダメージ、法的リスク、SEOペナルティなど、AI生成コンテンツのファクトチェック方法を知らないことのリスクを説明するインフォグラフィック。

AI生成コンテンツをファクトチェックする際に注意すべき一般的な落とし穴

AIの「ハルシネーション(幻覚)」:事実が捏造されるとき

おそらくこの言葉を聞いたことがあるでしょう。AIの「ハルシネーション」は、モデルが完全に信じられるように聞こえ、自信を持って述べられているものの、実際には作り話である情報を生成したときに起こります。人間のように「嘘をついている」わけではなく、知識のギャップを「そこにあるべき」と予測されるもので埋めているだけなのです。

これは些細な問題ではありません。主要なAIカンファレンスであるNeurIPSの研究論文を分析したところ、すでに査読を通過した論文の中に100件以上の捏造された引用が見つかりました。専門家でさえ騙される可能性があるということは、私たち全員が注意深くあるべきだという良い教訓になります。ハルシネーションは、あるトピックに関するモデルの学習データが限られていたり矛盾していたりする場合に、思考を完結させるために即興で作成されることでよく発生します。

古い情報とナレッジカットオフ

多くの人気のあるAIモデルは、インターネットの膨大ですが固定されたスナップショットでトレーニングされています。つまり、彼らの知識には「カットオフ(締め切り)」日があり、その後に起こったことは認識していません。

テクノロジー、市場動向、時事問題など、動きの速いトピックについて書いている場合、これは大きな問題です。1〜2年前には正しかった情報が、今日では完全に間違っている可能性があります。AIは、もはや存在しない製品機能を自信満々に説明したり、2021年の統計を最新の数字であるかのように引用したりすることがあります。

埋め込まれたバイアスと文脈の欠如

大規模言語モデル(LLM)はインターネット上の膨大なテキストから学習しますが、残念ながらそこには人間のあらゆるバイアスが含まれています。詳細なレビューにより、これらのバイアスがAIの文章において性別、人種、文化的ステレオタイプとして現れる可能性があることが示されました。

これを厄介にしているのは、AIのバイアスが特定の文脈に依存することが多いという点です。スタンフォード大学ロースクールの研究では、開発者があらゆるケースに対応する単一の解決策を作成することはほぼ不可能であると指摘されています。つまり、読者を遠ざけたり誤解を与えたりする可能性のある微妙なバイアスがないか、コンテンツをレビューするのはユーザーの責任となります。

「中だるみ(Lost in the middle)」による文脈エラー

これは意外な盲点です。AIモデルは、ソースドキュメント内での情報の位置によって、情報を誤解したり無視したりすることがあります。MITの「位置バイアス」に関する研究では、LLMはドキュメントの最初と最後にある情報に集中しすぎる傾向があることが発見されました。

つまり、記事の中盤に埋もれている重要な詳細やニュアンスが、AIが要約する際に失われてしまう可能性があるということです。統計データは抽出できても、その2段落後に記載されている重要な免責事項を完全に見落としてしまうかもしれません。

AI生成コンテンツをファクトチェックするためのステップバイステップのフレームワーク

それでは、実践的な内容に入りましょう。AIを活用したコンテンツを確実で正確なものにし、公開できる状態にするためのプロセスをご紹介します。

私のワークフローですか?私は常にAIのアウトプットを、徹底的な検証が必要な初稿として扱っています。主張、統計、特定の情報については、手動で元のソースと照らし合わせます。個人的に検証できないことや専門知識がないことについては、含めないか、未検証であることを明記します。時間はかかりますが、間違ったものを公開するよりはマシです。

文脈を理解するAIを使用して、より良い下書きから始める

ファクトチェックは、よくリサーチされた初稿から始めることでずっと楽になります。キーワードだけでテキストを生成するAIツールは、ハルシネーションや情報の浅さにより、広範な検証が必要なコンテンツを作成しがちです。

詳細なリサーチのために構築されたツールを使用することで、このプロセスを効率化できます。eesel AIブログライターはこの目的のために設計されています。あなたのウェブサイトからブランドの文脈を学習し、リサーチを自動化します。

これがファクトチェックに役立つ理由は以下の通りです。

- 引用と外部リンクを自動的に含めるため、情報の出所を正確に確認できます。

- Redditのスレッドから実際の引用を抽出できるため、検証が容易で本物のソーシャルプルーフ(社会的証明)を追加できます。

- 関連するデータテーブルやインフォグラフィックを生成し、情報を構造化されたチェック可能な形式で提示します。

これは人間のレビューの必要性をなくすものではありませんが、あなたの役割を「荒削りな下書きの修正」から「よくリサーチされた記事の磨き上げ」へと変えてくれます。

ステップ1:コンテンツを検証可能な主張に分解する

まず、実際に何をチェックする必要があるのかを把握する必要があります。AIが生成したテキストを読み込み、すべての検証可能な事実を抽出します。これは「分画(fractionation)」と呼ばれることもあります。

リストには以下のようなものが含まれます。

- 統計とデータポイント(例:「顧客の75%が〜を好む」)

- 直接の引用とその発言者

- 歴史的な日付や出来事

- 技術的な詳細や製品機能

- 人物、企業、または研究の名前

最も重要な主張のクイックチェックリストを作成しましょう。特に具体的な数字や直接の引用は、間違いやすく、誤っていた場合のダメージも大きいため、優先的に確認してください。

ステップ2:ラテラル・リーディングで裏付けとなるソースを探す

主張のリストができたら、それらをチェックします。最適な方法は「ラテラル・リーディング(横断的読解)」です。AIのテキストを上から下へ読むだけでなく、新しいブラウザタブをいくつか開き、各主張に対する外部の裏付けを検索します。

最初に見つけたソースを鵜呑みにしないでください。情報を裏付ける、独立した信頼できる複数のソースを探しましょう。以下は、確認に適した場所の例です。

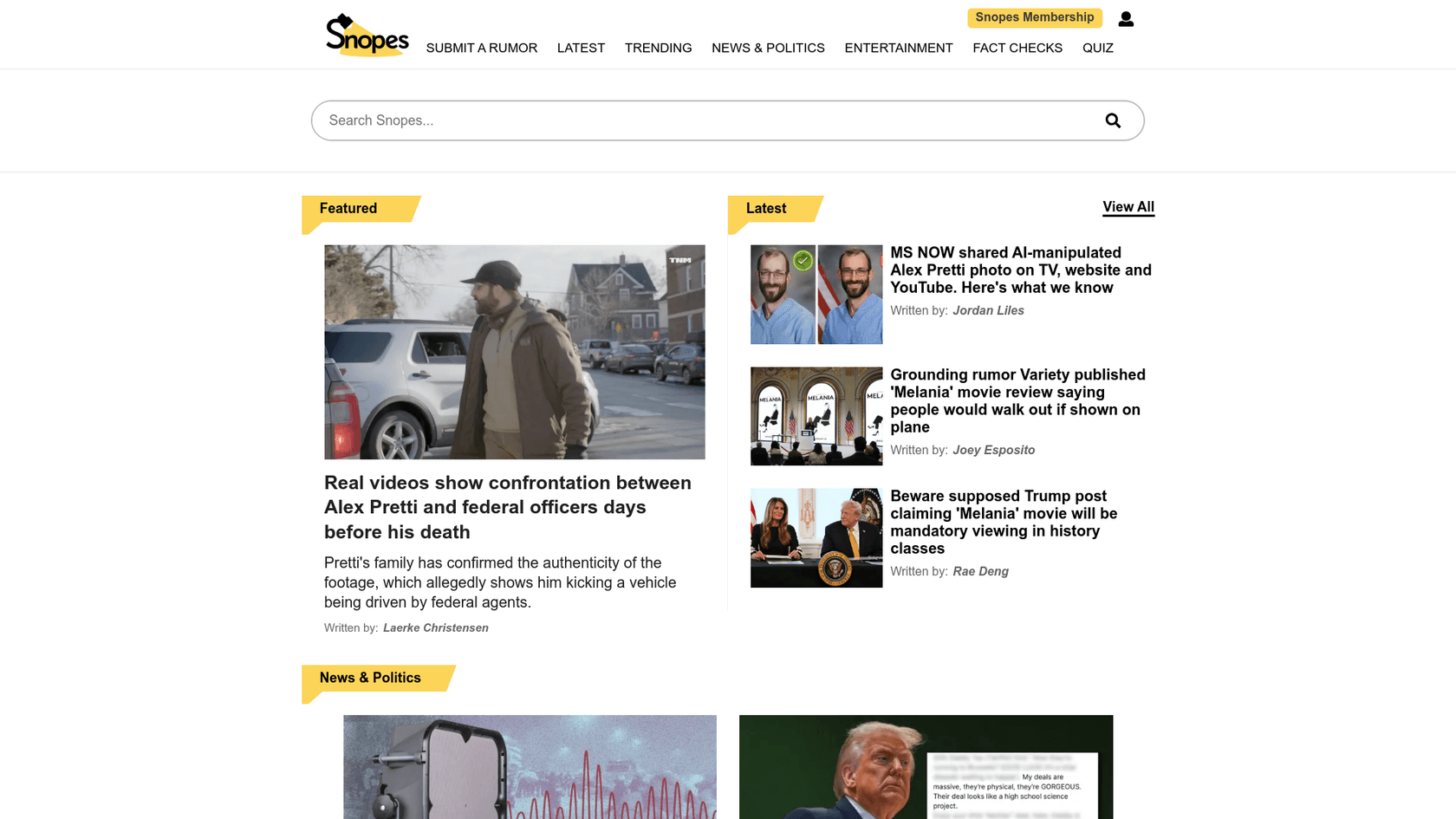

- 一般的な主張: 統計、事実、または話題のニュースについては、Snopesのような確立されたファクトチェックサイトや、主要メディアのアーカイブから始めましょう。

- 学術的・技術的な主張: AIが科学的研究に言及している場合は、Google Scholarなどのデータベースで元のソースを探してください。

ステップ3:すべてのソースと引用を検証する

これは非常に重要です。AIモデルはソースを捏造することで知られています。実在するように聞こえるが存在しない研究を引用したり、引用を間違った人物に帰属させたりすることがあります。

AIツールが提供するすべての引用を検証することが重要です。すべてのリンクをクリックしてください。ソースが言及されているがリンクがない場合は、検索してください。元のドキュメントが見つからない場合や、ドキュメントが実際にはその主張を裏付けていない場合は、その主張を削除してください。偽のソースを載せるくらいなら、ソースがない方がマシです。

ステップ4:適時性と内部の一貫性を確認する

ソースをチェックする際は、公開日を確認してください。その情報は2026年のあなたのトピックに関連していますか?2019年の統計は、現在の市場動向に関するブログ記事には最適な証拠ではないかもしれません。常に、見つけられる最新の信頼できるデータを探してください。

外部の事実をすべて確認したら、記事全体を最後にもう一度読み通してください。AIは、導入部で言ったことと後で言ったことが矛盾するなど、自己矛盾を起こすことがあります。ざっと目を通すだけで、こうした内部の不整合を見つけて修正することができます。

ステップ5:専門家(SME)を関与させる

トピックによっては、一般的なファクトチェックだけでは不十分な場合があります。医療、法律、金融などの高度に専門的な分野のコンテンツを作成している場合、最終ステップは常に専門家(Subject Matter Expert:SME)によるレビューであるべきです。

AI生成コンテンツのファクトチェックに不可欠なツールとテクニック

これらすべての作業を手作業で行う必要はありません。検証プロセスをより迅速かつ確実にするための優れたツールがいくつかあります。

ファクトチェック機関

- Snopes: 元祖ファクトチェックサイトとも呼ばれるSnopesは、都市伝説、インターネット上の噂、話題の主張を調べるのに最適です。BBCはここをファクトチェッカーの「バイブル」と呼んでいます。

- FactCheck.org: これはアネンバーグ公共政策センターによる非営利プロジェクトで、主に米国の政治における主張に焦点を当てていますが、その手法はあらゆるファクトチェックの優れたモデルとなります。

画像とAI生成メディアの検証

- TinEye: 強力な逆画像検索エンジンです。810億枚以上の画像をインデックス化しており、画像が最初にどこに現れたか、加工されているかどうかを確認するのに役立ちます。

- Google's SynthID: AI生成画像に目に見えないデジタルウォーターマークを直接埋め込む興味深い新技術です。Geminiアプリに画像をアップロードして、GoogleのAIによって作成されたものかどうかを尋ねることもできます。

デジタルアーカイブで一次資料を探す

- Google Books: 何百万冊もの本の全文を検索できる素晴らしいリソースです。引用が本からのものであるとされる場合、ここで見つけられることが多いです。

- Internet Archive: Wayback Machineとしても知られるこのデジタルライブラリは、ウェブサイトやドキュメントの古いバージョンを保存しています。オフラインになったソースを探すのに最適です。

これらのツールはテキストや画像に非常に有効ですが、ビデオによる解説がプロセスをさらに明確にしてくれることもあります。以下の動画は、ChatGPTのようなツールで生成されたコンテンツのファクトチェックへのアプローチ方法について、これまで議論してきたテクニックの多くを補強する素晴らしい概要を提供しています。

AIはコンテンツ作成における素晴らしいアシスタントですが、あくまでアシスタントに過ぎません。真実の源ではないのです。最終的に「公開」ボタンを押すのはあなたであり、あなたの信頼性がかかっています。

AIの時代において、人間の監視、批判的思考、そして確実なファクトチェックプロセスは譲れないものです。最善の捉え方は、パートナーシップとして見ることです。AIに重労働を任せ、ドラフトの最初の90%を生成させましょう。しかし、残りの10%、つまり批判的なレビュー、文脈付け、検証こそが、リスクのあるAIのアウトプットを真に価値のあるものへと変えるのです。あなたが編集長であり、最終的な判断は常にあなたに委ねられています。

品質を犠牲にすることなくコンテンツをスケールさせる

目標は、より高品質で信頼できるコンテンツを、より速く作成することです。鍵となるのは、スピードか品質かの選択を迫られるのではなく、その両方を組み合わせたプロセスを構築することです。

eesel AIブログライターは、この問題を解決するために設計されたツールの一つです。これは、私たちがわずか数ヶ月で自社のオーガニックトラフィックを1日700インプレッションから750,000インプレッションに成長させるために使用したのと同じツールです。

このアプローチにより、深くリサーチされ、SEOに最適化され、事実に基づいた、すぐに公開可能なブログを生成することができます。

よくある質問

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.