Si ha estado creando con las herramientas de OpenAI, conoce el ejercicio: justo cuando se siente cómodo, surge algo nuevo y poderoso. Esta vez, es la nueva API de respuestas de OpenAI. Parece que OpenAI está tratando de reunir las mejores partes de las API de finalización de chat y de asistente más antiguas en una forma única y más poderosa de crear agentes de IA.

Pero, ¿qué significa eso realmente para usted como desarrollador? Bueno, es un gran problema. Este cambio afecta a todo, desde cómo gestiona el historial de conversaciones hasta las herramientas que puede dar a su IA.

En esta guía, analizaremos qué es la API de respuestas de OpenAI, sus características clave, cómo se compara con las API que ya podría estar utilizando y algunos de los dolores de cabeza del mundo real con los que podría encontrarse al crearla. Porque si bien es increíblemente potente, construir directamente en la API no siempre es la ruta más rápida, y ayuda saber en qué se está metiendo.

¿Qué es la API de respuestas de OpenAI?

En pocas palabras, la API de respuestas de OpenAI es la nueva forma más avanzada de obtener respuestas de sus modelos. Piense en ello como el motor actualizado para crear aplicaciones que necesitan hacer algo más que responder preguntas puntuales.

La gran idea que la distingue es el "estado". La API de finalización de chat más antigua y muy popular no tiene estado. Cada vez que envía una solicitud, debe incluir todo el historial de conversaciones desde el principio. Es como hablar con alguien sin memoria a corto plazo; tiene que recordarle constantemente lo que acaba de decir. Funciona, pero puede resultar ineficiente y costoso con conversaciones largas.

La API de respuestas cambia eso por completo. Es con estado, lo que significa que OpenAI puede gestionar el historial de conversaciones por usted. En lugar de reenviar todo el registro de chat, simplemente pasa un "previous_response_id". Esto permite que la API realice un seguimiento del contexto por sí sola, lo que puede ahorrarle tokens y mucho esfuerzo de ingeniería. Esta es una señal clara de que OpenAI se centra en facilitar la creación de agentes de IA más complejos y de múltiples turnos.

También está configurado para reemplazar tanto la finalización de chat como la API de asistentes. OpenAI ya ha dicho que planea desaprobar la API de asistentes en la primera mitad de 2026, lo que convierte a la API de respuestas en el camino claro a seguir.

Características clave de la API de respuestas de OpenAI

La API no se trata solo de gestionar el estado; viene con algunas potentes características integradas diseñadas para ayudarle a crear agentes de IA más capaces de inmediato.

Gestión simplificada del estado de la conversación

La característica principal es cómo gestiona las conversaciones. Al utilizar el parámetro "previous_response_id", puede encadenar conversaciones de varios turnos sin tener que agrupar y reenviar manualmente todo el historial de chat. Para configuraciones más complicadas, también hay un objeto "conversation" que le brinda un control más estructurado.

Esto es muy útil, pero hay una trampa que algunos desarrolladores están señalando. Cuando permite que OpenAI gestione el estado en sus servidores, está creando un poco de "dependencia del proveedor". Su historial de conversaciones reside en OpenAI, lo que podría dificultar el cambio a otro proveedor o a un modelo de código abierto en el futuro sin reconstruir su sistema de gestión de estado. Es la clásica compensación entre comodidad y control.

Herramientas integradas para capacidades mejoradas

Una de las partes más interesantes de la API de respuestas es su conjunto de herramientas listas para usar que le dan al modelo habilidades adicionales.

-

Búsqueda web: Esto le da al modelo una conexión en vivo a Internet. En lugar de quedarse atascado con sus datos de entrenamiento, su IA puede buscar eventos actuales, encontrar información reciente y dar respuestas que estén realmente actualizadas.

-

Búsqueda de archivos: Este es un gran problema para la creación de agentes basados en el conocimiento. Permite que el modelo busque en los documentos que ha cargado en un almacén vectorial, para que pueda responder preguntas basadas en los documentos internos de su empresa, los artículos de ayuda o cualquier otro dato privado.

-

Intérprete de código: Esta herramienta proporciona un entorno Python seguro y aislado donde el modelo puede ejecutar código. Es perfecto para tareas como el análisis de datos, la resolución de problemas matemáticos difíciles o incluso la generación de gráficos y archivos sobre la marcha.

Si bien estas herramientas son excelentes, no son exactamente plug-and-play. Todavía tiene que configurarlas en sus llamadas a la API y crear la lógica para gestionar lo que devuelven, lo que añade otra capa a su trabajo de desarrollo.

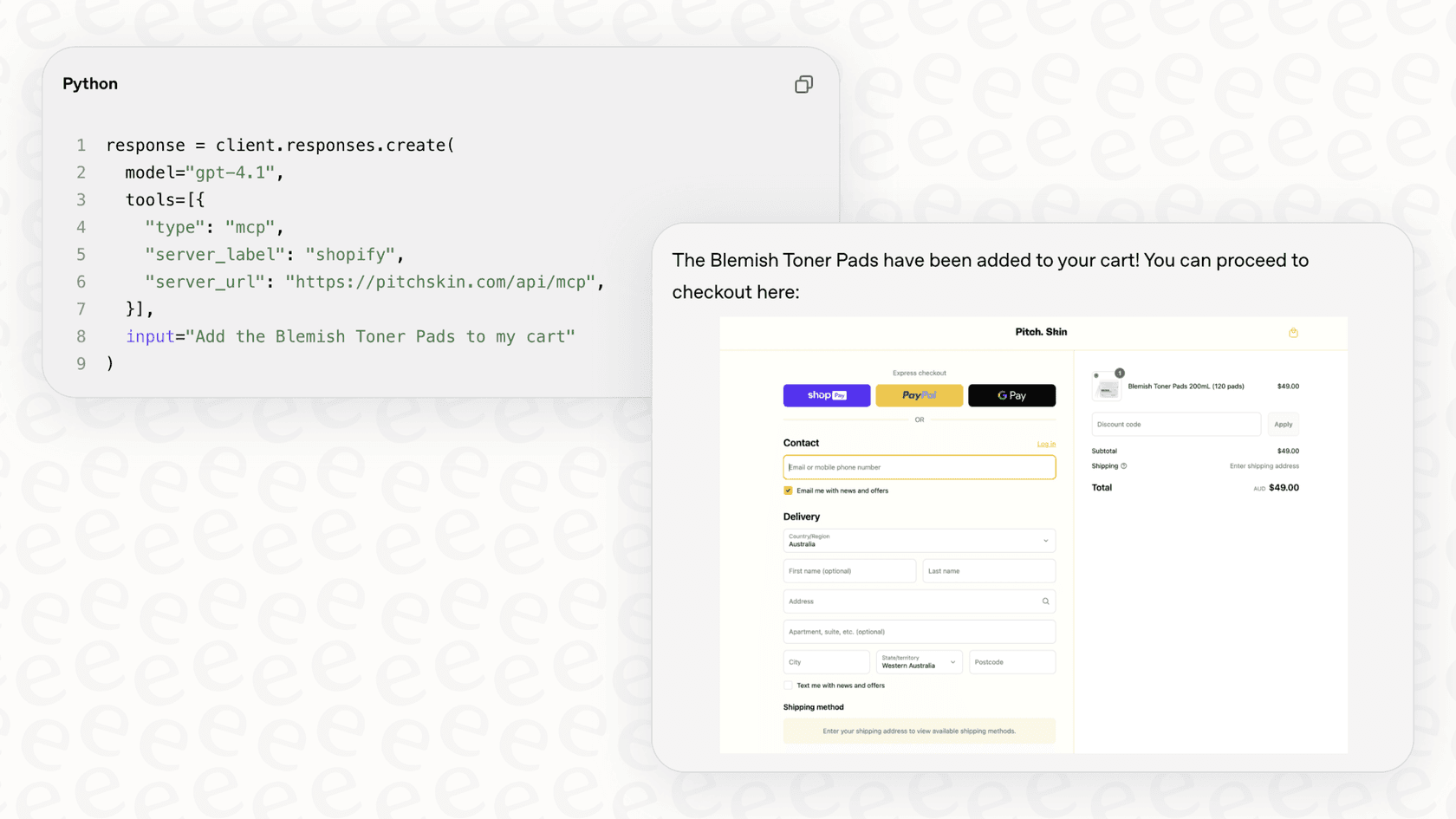

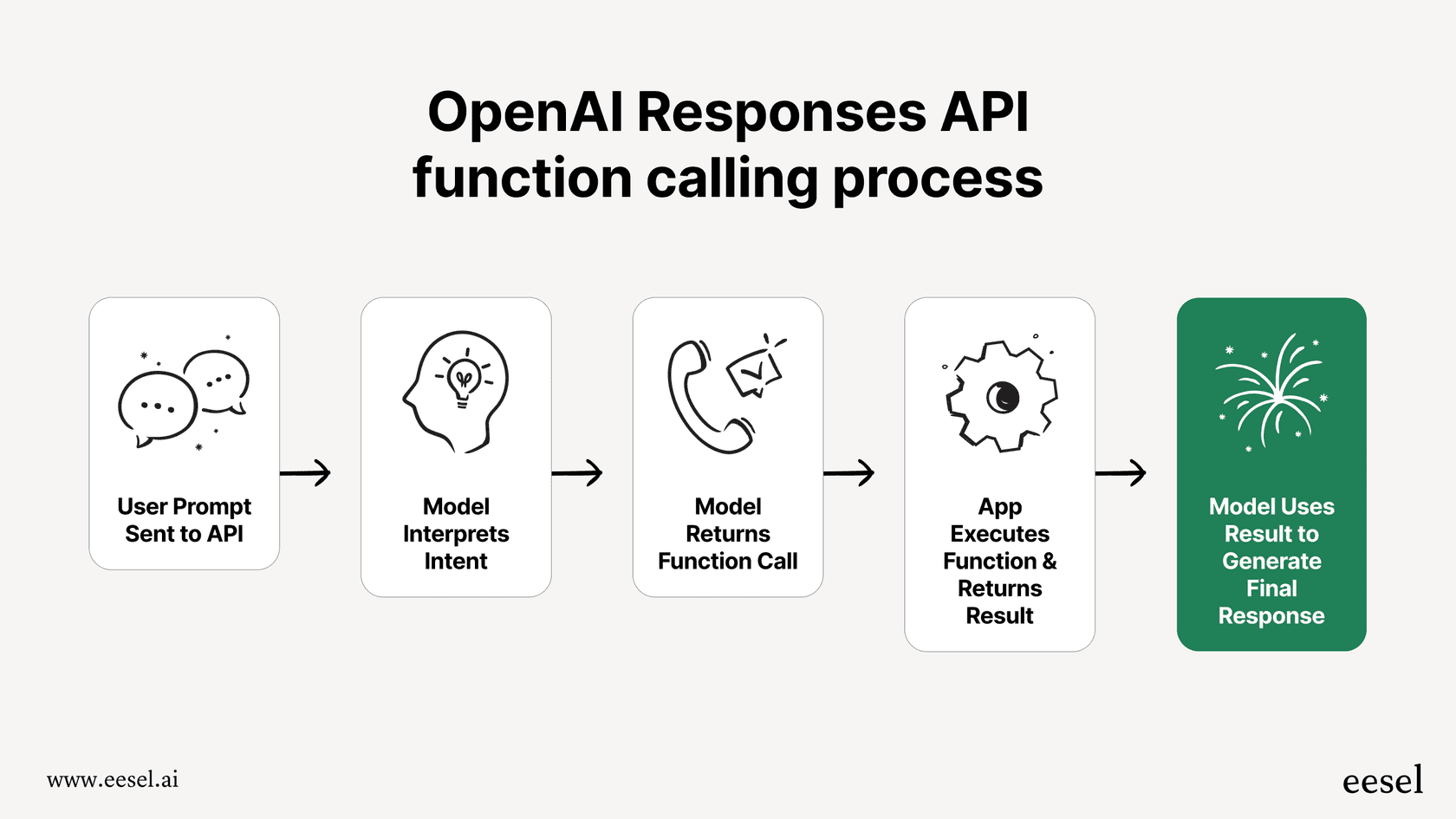

Llamadas a funciones avanzadas y uso de herramientas

Más allá de las opciones integradas, la API le permite definir sus propias herramientas de "función" personalizadas. Aquí es donde realmente puede conectar la IA a sus propias aplicaciones y servicios.

El proceso es bastante simple, pero es increíblemente potente:

-

Su aplicación envía el mensaje de un usuario al modelo, junto con una lista de funciones personalizadas que puede utilizar.

-

El modelo analiza el mensaje y determina si una de sus funciones podría ayudar.

-

Si encuentra una coincidencia, no responde al usuario. En cambio, devuelve un objeto JSON con el nombre de la función a la que se va a llamar y los argumentos correctos.

-

Su aplicación obtiene esto, ejecuta su función real (como llamar a una API interna para obtener los detalles del pedido) y envía el resultado de nuevo al modelo.

-

Finalmente, el modelo utiliza ese resultado para dar al usuario una respuesta completa y útil.

Esto le permite crear agentes que puedan tomar medidas reales, como comprobar el historial de pedidos de un cliente, procesar un reembolso o reservar una cita.

Precios de la API de respuestas de OpenAI

Bien, hablemos de dinero. Una gran parte de la creación con cualquier API es comprender cuánto va a costar. Los precios de OpenAI se basan principalmente en "tokens", que son básicamente fragmentos de palabras. Usted paga por los tokens que envía (entrada) y los tokens que el modelo devuelve (salida).

La API de respuestas utiliza los mismos precios basados en tokens que las otras API, pero el coste exacto depende del modelo que utilice. Aquí tiene un vistazo rápido a algunos de los modelos populares que puede utilizar con la API de respuestas, en función de sus tarifas estándar por millón de tokens.

| Modelo | Entrada (por 1M de tokens) | Salida (por 1M de tokens) |

|---|---|---|

| gpt-4o | $2.50 | $10.00 |

| gpt-4o-mini | $0.15 | $0.60 |

| gpt-5 | $1.25 | $10.00 |

| gpt-5-mini | $0.25 | $2.00 |

Además de los costes de los tokens, algunas de las herramientas integradas tienen sus propias tarifas.

-

Intérprete de código: $0.03 por sesión de contenedor.

-

Almacenamiento de búsqueda de archivos: $0.10 por GB por día (obtiene 1 GB gratis).

-

Búsqueda web: $10.00 por cada 1,000 llamadas.

Si bien la característica con estado de la API de respuestas puede ayudar a reducir los costes de los tokens de entrada, el uso de las herramientas avanzadas aumentará su factura. Es importante pensar tanto en el uso de tokens como en las tarifas de las herramientas al estimar los costes. Siempre puede encontrar los detalles completos en la página oficial de precios de OpenAI.

API de respuestas de OpenAI frente a finalización de chat frente a API de asistentes

Con tres API diferentes sobre la mesa, puede ser difícil averiguar cuál debería estar utilizando. Aquí tiene un desglose simple de cómo se comparan.

-

API de finalización de chat: Este es el caballo de batalla clásico y sin estado. Es simple, rápido y realmente flexible, por lo que se construyen tantas herramientas y bibliotecas de código abierto para él. El principal inconveniente es que tiene que gestionar todo el historial de conversaciones usted mismo. También hay un problema más sutil: no puede preservar los "rastros de razonamiento" de los modelos más nuevos de OpenAI, lo que puede hacer que parezcan menos inteligentes de lo que realmente son.

-

API de asistentes: Este fue el primer intento de OpenAI de una API con estado para la creación de agentes. Introdujo conceptos útiles como Hilos y Ejecuciones para gestionar conversaciones. Sin embargo, la retroalimentación de muchos desarrolladores fue que se sentía lento y un poco torpe. Ahora está en camino de dejar espacio para la API de respuestas más flexible.

-

API de respuestas de OpenAI: Este es el nuevo buque insignia. Está diseñado para brindarle lo mejor de ambos mundos, combinando la gestión de estado de la API de asistentes con una velocidad y flexibilidad más cercanas a la API de finalización de chat, a la vez que agrega esas potentes herramientas integradas nuevas.

Aquí tiene una tabla de comparación rápida:

| Característica | API de finalización de chat | API de asistentes (Legacy) | API de respuestas de OpenAI |

|---|---|---|---|

| Gestión de estado | Sin estado (usted lo gestiona) | Con estado (a través de hilos) | Con estado (a través de "previous_response_id") |

| Velocidad | Rápido | Lento | Rápido |

| Herramientas integradas | No | Intérprete de código, Recuperación | Búsqueda web, Búsqueda de archivos, Intérprete de código |

| Flexibilidad | Alto (estándar abierto) | Más bajo (estructura rígida) | Alto (combina simplicidad y potencia) |

| Historial de conversaciones | Enviado con cada llamada | Gestionado por OpenAI | Gestionado por OpenAI |

| Soporte futuro | Mantenido | Deprecación planificada | Desarrollado activamente |

Los desafíos de construir directamente con la API de respuestas de OpenAI

Si bien la API de respuestas de OpenAI le brinda un conjunto increíble de bloques de construcción, seamos realistas: encadenar algunas llamadas a la API está a un mundo de distancia de tener un bot de soporte en el que realmente pueda confiar con sus clientes.

Complejidad y orquestación La API le proporciona las herramientas, pero tiene que crear toda la lógica que las une. Para un agente de soporte, eso significa crear flujos de trabajo bastante complejos. ¿Cuándo debería intentar responder una pregunta directamente? ¿Cuándo debería utilizar una herramienta para buscar un pedido? Y lo más importante, ¿cuándo debería darse por vencido y entregar la conversación a un humano? Esa capa de orquestación requiere mucho tiempo de ingeniería para construirla y hacerla bien.

Falta de una interfaz fácil de usar Una API es solo una API. Para gestionar realmente un agente de soporte, su equipo necesita un panel de control. Necesitan un lugar para ajustar las indicaciones, gestionar las fuentes de conocimiento, ver los análisis y ver cómo está funcionando el agente. Construir todas esas herramientas internas es como desarrollar un producto completamente independiente solo para gestionar el primero.

Conexión y gestión del conocimiento La herramienta "file_search" es genial, pero significa que tiene que cargar y gestionar todos sus archivos y almacenes de vectores a través de la API. Para la mayoría de los equipos de soporte, el conocimiento se distribuye por todas partes: en Google Docs, Confluence y los tickets anteriores en Zendesk. Intentar recopilar, cargar y sincronizar constantemente todo eso manualmente es un gran dolor de cabeza en la gestión de datos.

Riesgo de prueba e implementación ¿Cómo sabe si su agente de IA está listo para el horario de máxima audiencia? No hay una forma integrada de simular cómo habría gestionado miles de sus tickets de soporte anteriores. Tiene que construir una configuración de prueba complicada desde cero o simplemente cruzar los dedos y arriesgarse a implementar un agente que dé malas respuestas y frustre a sus clientes.

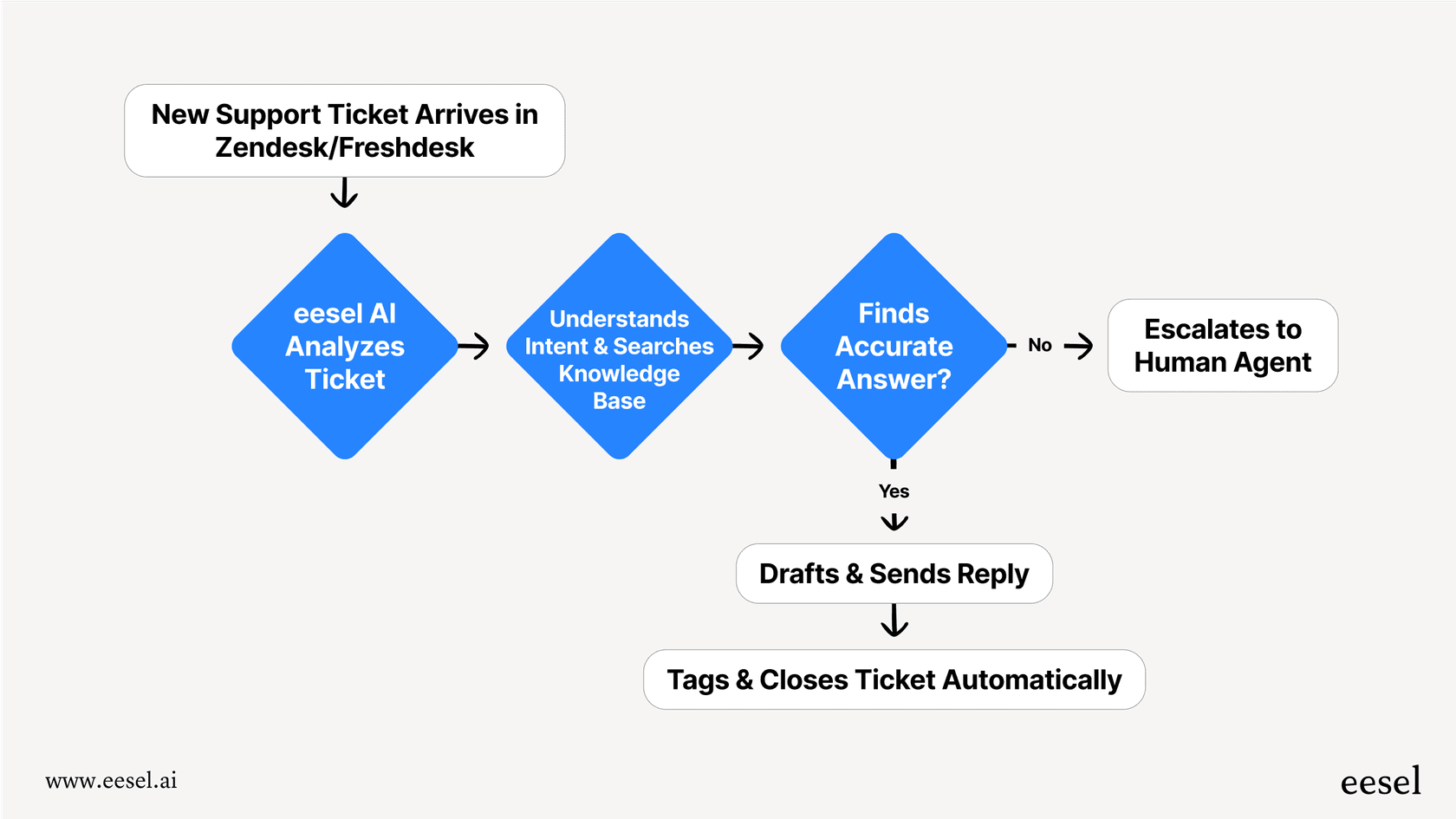

Aquí es donde una plataforma creada específicamente para la automatización del soporte puede marcar una gran diferencia. Por ejemplo, eesel AI utiliza potentes modelos como los de OpenAI bajo el capó, pero le brinda una plataforma de autoservicio que se encarga de toda esta complejidad por usted.

Cómo eesel AI simplifica la creación de potentes agentes de soporte de IA

En lugar de luchar con las API, eesel AI ofrece una ruta mucho más inteligente para crear e implementar agentes de IA para su equipo de soporte. No se trata de reemplazar los modelos potentes, sino de hacer que realmente funcionen para los equipos de soporte sin necesidad de un equipo dedicado de ingenieros de IA.

Aquí tiene cómo eesel AI gestiona los desafíos de la creación desde cero:

-

En lugar de escribir código complejo para la orquestación, eesel AI proporciona un motor de flujo de trabajo visual y totalmente personalizable. Puede configurar reglas y acciones sin escribir una sola línea de código.

-

En lugar de gestionar archivos a través de una API, eesel AI ofrece integraciones de un solo clic. Puede conectar y sincronizar instantáneamente su conocimiento desde centros de ayuda como Zendesk y Freshdesk, wikis como Confluence y herramientas de colaboración como Slack.

-

En lugar de lanzamientos arriesgados y no probados, el modo de simulación de eesel AI le permite probar su agente en miles de sus tickets históricos reales. Puede ver exactamente cómo habría funcionado y obtener una previsión sólida de su tasa de automatización antes de que hable con un solo cliente.

Reflexiones finales sobre la API de respuestas de OpenAI

La API de respuestas de OpenAI es un gran paso adelante. Les da a los desarrolladores un entorno con estado y rico en herramientas para crear la próxima ola de agentes de IA, combinando con éxito los mejores aspectos de las API de finalización de chat y de asistente en uno.

Pero el poder de una API sin procesar conlleva la responsabilidad de construir todo lo demás a su alrededor. Para un trabajo especializado como el soporte al cliente, el viaje desde una simple llamada a la API hasta un agente fiable y listo para la producción está lleno de desafíos en la orquestación, la gestión del conocimiento y las pruebas.

Aquí es donde plataformas como eesel AI ofrecen una ventaja real. Al gestionar la complejidad subyacente, permiten a los equipos implementar agentes de soporte de IA potentes y personalizados en minutos, no en meses.

Comience hoy mismo con la automatización del soporte de IA

La API de respuestas de OpenAI abre un montón de posibilidades. Pero no tiene que construirlo todo desde cero.

Con eesel AI, puede implementar un agente de IA entrenado en el conocimiento de su empresa e integrado con su centro de ayuda en minutos. Incluso puede simular su rendimiento en sus tickets anteriores para ver el ROI potencial antes de comprometerse.

Comience su prueba gratuita hoy mismo o reserve una demostración para ver cómo funciona.

Preguntas frecuentes

La API de respuestas de OpenAI es la nueva [API con estado](https://platform.openai.com/docs/quickstart) avanzada de OpenAI diseñada para crear agentes de IA más complejos y de múltiples turnos. Es importante porque tiene como objetivo reemplazar tanto las API de finalización de chat como las de asistente, convirtiéndose en el estándar para el desarrollo futuro.

La API de respuestas de OpenAI simplifica la gestión del historial al ser "con estado". En lugar de enviar manualmente todo el historial de conversaciones con cada solicitud, puede utilizar un parámetro "previous_response_id", lo que permite a OpenAI realizar un seguimiento del contexto en sus servidores y ahorrarle tokens y esfuerzo de ingeniería.

La API de respuestas de OpenAI ofrece potentes [herramientas integradas](https://learn.microsoft.com/en-us/azure/ai-foundry/openai/how-to/responses), como la búsqueda web para acceso a Internet en vivo, la búsqueda de archivos para buscar documentos privados y un intérprete de código para ejecutar código Python en un entorno de espacio aislado. Estas herramientas mejoran las capacidades del modelo más allá de sus datos de entrenamiento.

El precio de la API de respuestas de OpenAI se basa principalmente en tokens, lo que significa que paga por los tokens de entrada y salida en función del modelo utilizado. Además, ciertas herramientas integradas como el intérprete de código, el almacenamiento de búsqueda de archivos y la búsqueda web tienen tarifas separadas.

La API de respuestas de OpenAI tiene estado y gestiona el historial de conversaciones por usted, mientras que la API de finalización de chat no tiene estado, lo que requiere que usted gestione el historial. La API de respuestas también incluye potentes herramientas integradas y se está desarrollando activamente como la API insignia, mientras que la API de finalización de chat se [mantendrá pero carece de estas funciones avanzadas](https://platform.openai.com/docs/api-reference/introduction).

La creación directamente con la API de respuestas de OpenAI puede presentar desafíos tales como una complejidad significativa en la lógica de orquestación, la necesidad de desarrollar una interfaz de usuario personalizada para la gestión, dificultades para integrar y sincronizar el conocimiento de diversas fuentes y la falta de herramientas integradas de prueba e implementación sólidas.

Plataformas como eesel AI simplifican las complejidades de la API de respuestas de OpenAI al proporcionar [motores de flujo de trabajo visuales](https://www.eesel.ai/blog/how-to-automate-your-customer-support-workflow-using-ai) para la orquestación, integraciones de un clic para la gestión del conocimiento y modos de simulación para probar el rendimiento del agente. Esto permite a los equipos implementar potentes agentes de IA rápidamente sin necesidad de una ingeniería extensa.

Share this article

Article by

Stevia Putri

Stevia Putri es una generalista de marketing en eesel AI, donde ayuda a convertir potentes herramientas de IA en historias que resuenan. Le impulsa la curiosidad, la claridad y el lado humano de la tecnología.