Blog

Consejos, guias e insights sobre companeros de IA, soporte mas inteligente y como construir mejores equipos.

¿Vale la pena Freshdesk? Una reseña 2026 de funciones, precios y opiniones reales de usuarios

Una respuesta directa a si Freshdesk vale la pena en 2026: precios reales, lo que Freddy AI realmente hace y dónde la plataforma decepciona a los equipos que escalan.

Las 6 mejores alternativas a ManageEngine en 2026

ManageEngine ServiceDesk Plus funciona para muchos equipos de TI, pero la configuración compleja y una interfaz anticuada llevan a los equipos a buscar otras opciones. Estas son las 6 mejores alternativas en 2026.

Precios de CapCut 2026: Guía completa de planes gratuitos, estándar y pro

¿Confundido por los cambios recientes en los precios de CapCut? No estás solo. Nuestra guía 2026 desmitifica los planes Gratis, Estándar y Pro, comparando características, costos y lo que realmente obtienes por tu dinero.

Reseña de Zendesk 2026: ¿sigue siendo la opción correcta para tu equipo?

Una reseña honesta de Zendesk en 2026: qué obtienes en cada plan, cuánto cuesta realmente con los complementos, y qué revelan más de 10.000 reseñas sobre la vida en la plataforma.

IA para la productividad de agentes: 7 casos de uso que reducen el tiempo de gestión en 2026

Siete casos de uso de IA que reducen la carga de trabajo de los agentes de soporte en 2026: automatización de tickets de nivel 1, redacción con copiloto, recuperación de conocimiento, simulación previa al despliegue, analítica y más.

Ticketing de TI automatizado en 2026: 6 herramientas que vacían la cola sin trabajo manual

El ticketing de TI automatizado ha ido mucho más allá del enrutamiento basado en reglas. Así es como 6 herramientas -- desde superposiciones de IA ligeras hasta plataformas ITSM completas -- gestionan los tickets desde la creación hasta el cierre.

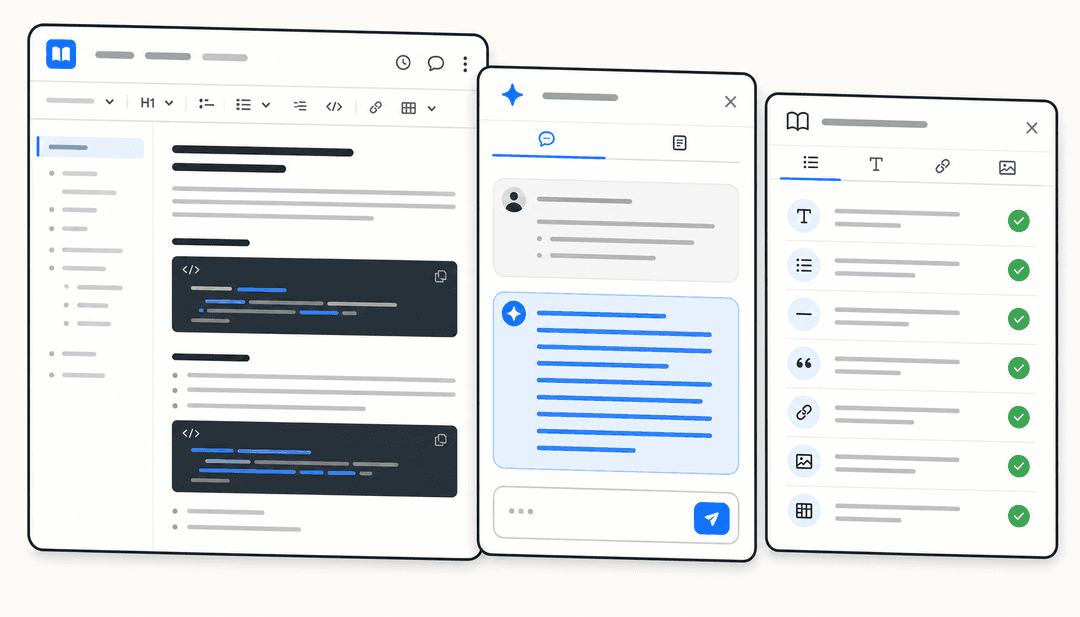

Las 6 mejores herramientas de escritura con IA para redactores técnicos en 2026

Los redactores técnicos necesitan IA que maneje precisión, consistencia y estilo, no solo velocidad. Estas son las 6 mejores herramientas de escritura con IA probadas para equipos de redacción técnica en 2026.

Las 5 mejores alternativas a Jira Service Management en 2026

Cinco alternativas a Jira Service Management para equipos que necesitan una configuración más sencilla, mejor IA, escala empresarial o una herramienta que no requiera estar dentro del ecosistema de Atlassian.

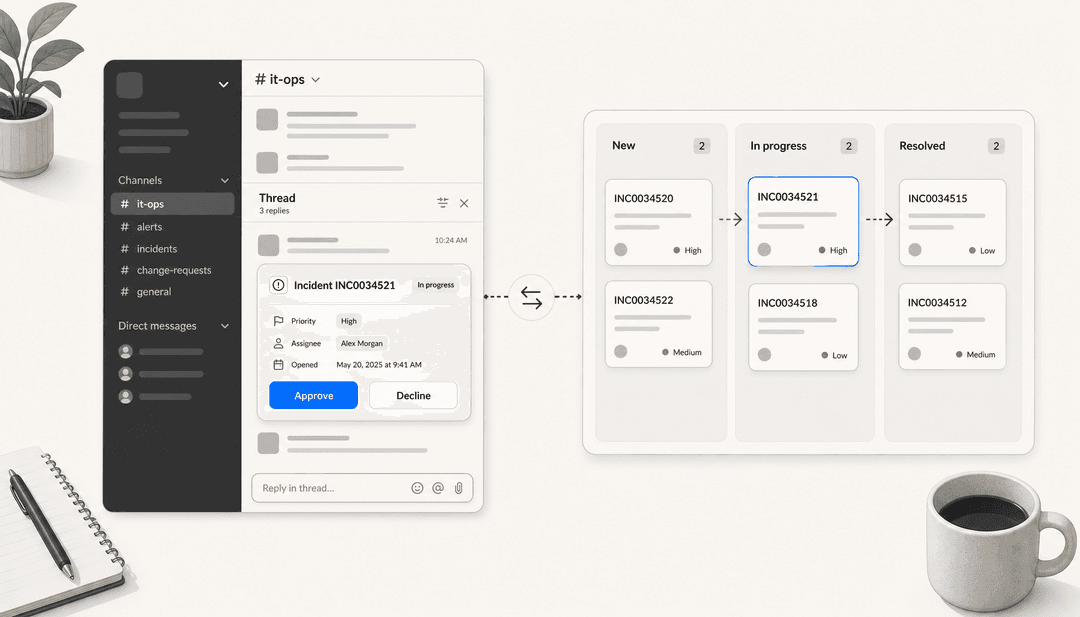

Integración ITSM con Slack: cómo funciona realmente en 2026

Una guía práctica de integración ITSM con Slack en 2026: lo que ServiceNow, Jira Service Management y Freshservice te dan, la capa de agentes de IA que está emergiendo y dónde realmente compensa.

Listo para contratar tu companero de IA?

Configuracion en minutos. Sin tarjeta de credito requerida.