AIワークロードに最適なCoreWeave代替サービス7選(2026年)

Stevia Putri

Katelin Teen

最終更新 October 5, 2025

AIブームが到来し、強力なGPUは、本格的なものを構築する人にとって、なくてはならない新しいツールとなっています。CoreWeaveは、多くのトップAI研究所が頼りにしている種類のGPUパワーを提供することで、名を馳せてきました。しかし、彼らが有名であるからといって、彼らが唯一の存在であるという意味ではありません。

市場には強力な競合他社があふれており、大規模な研究機関に適したものが、スタートアップやエンタープライズチームにとっては過剰になる可能性があります。この記事は、選択肢を整理し、2025年に最適なCoreWeave代替サービスを見つけるのに役立ちます。AIプロジェクトに最適なエンジンを見つけるために、上位候補を見ていきましょう。

CoreWeaveとは?また、CoreWeaveの代替を探す理由とは?

まず、共通認識を持つことから始めましょう。CoreWeaveは、AIと機械学習のために高性能NVIDIA GPUを提供することに特化したクラウドプロバイダーです。彼らはKubernetes上にプラットフォームを構築しており、これにより、コンピューティングリソースを驚くほど高速にスピンアップできるなど、いくつかの優れた利点があります。彼らは最新かつ最高のGPUを手に入れることで知られており、そのためOpenAIやMistral AIのような企業が彼らのサービスを利用しているのを目にするでしょう。

では、それほど優れているのに、なぜCoreWeaveの代替を探す人がいるのでしょうか?それは通常、いくつかの実際的な理由に帰着します。

-

コストが上昇する可能性がある。 彼らの価格設定は競争力がありますが、大規模で長期的なトレーニングジョブの請求額は大きくなる可能性があり、場合によっては予測できません。

-

最新のホットなGPUを手に入れること。 新しい強力なGPUがリリースされると、誰もがそれを欲しがります。その高い需要は、必要な特定のハイエンドチップが、必要なときにすぐには利用できない可能性があることを意味します。

-

少し複雑になる可能性がある。 Kubernetesネイティブのセットアップは、DevOpsのプロにとっては素晴らしいものですが、チームがGPUを搭載したシンプルな仮想マシンを求めているだけの場合、ナイフの戦いにバズーカ砲を持ち込むような気分になる可能性があります。

-

GPU以上のものが必要な場合がある。 AIモデルは、孤立して存在するものではありません。多くのプロジェクトでは、データベース、ストレージ、標準CPUインスタンスなどの他のクラウドサービスと緊密に連携する必要があります。巨大なクラウドプロバイダーは、専門ホストよりも完全なエコシステムを持っていることがよくあります。

最適なCoreWeave代替サービスのための基準

これは、私が適当にまとめたランダムなリストではありません。私は、実際にモデルを構築、トレーニング、デプロイしているAI開発チームの視点からこれらのプラットフォームを検討しました。

私が重点を置いたのは次のとおりです。

-

パフォーマンスとハードウェア。 プロバイダーは、NVIDIAのH100やA100のような最新の強力なGPUを適切に組み合わせて提供しているでしょうか?同様に重要なのは、基盤となるネットワークが、分散モデルトレーニングのようなヘビーデューティなタスクに十分な速度を持っているかどうかです。

-

価格設定と価値。 価格設定はどれくらい明確ですか?データ転送などの隠れた料金なしで、わかりやすいオンデマンド、予約済み、スポットインスタンスモデルを探しました。目標は、絶対的な最低時間料金だけでなく、優れた価値を得ることです。

-

使いやすさ。 サインアップからコードの実行までどれくらい早く実行できますか?シンプルなUIと、クラウドアーキテクチャの修士号を取得しなくても開始できる事前構成済みの環境を備えたプラットフォームに、追加のポイントを与えました。

-

スケーラビリティと信頼性。 プロトタイピング用の単一のGPUから、本番トレーニング実行用の大規模なクラスターに、髪を引っ張ることなく移行できますか?また、必要なときにマシンが利用可能で安定していることを期待できますか?

-

エコシステムと統合。 プラットフォームは、使用している他のツールとどれくらい連携していますか?これには、MLOpsツール、ストレージ、および実際のAIワークフローの一部であるその他のクラウドサービスが含まれます。

主要なCoreWeave代替サービスの比較

主要な選択肢を簡単に比較してみましょう。

| プロバイダー | 最適 | 主な差別化要因 | H100オンデマンド価格(GPUあたり/時間) |

|---|---|---|---|

| RunPod | スタートアップと研究者 | コスト効率の高いスポットおよびサーバーレスGPU | ~$1.99 |

| DigitalOcean | 開発者と中小企業 | シンプルさと統合された開発者向けクラウド | ~$1.99 |

| Lambda Labs | AI研究とMLチーム | ディープラーニングに特化し、事前構成済みの環境 | ~$2.49 |

| Vultr | グローバル展開 | シンプルさと幅広い地理的プレゼンス | ~$2.99 |

| Google Cloud | 大規模AIとトランスフォーマー | TPUとGoogleのAIエコシステムとの深い統合 | カスタム(変動) |

| AWS | エンタープライズと複雑なワークロード | 最も幅広いサービスポートフォリオと成熟したエコシステム | カスタム(変動) |

| Microsoft Azure | エンタープライズとハイブリッドクラウド | Microsoft製品およびエンタープライズコンプライアンスとの強力な統合 | カスタム(変動) |

2025年のAIワークロードに最適なCoreWeave代替サービス7選

1. RunPod

RunPodは、1つの単純な理由で、スタートアップや個々の研究者の間で人気を集めています。それは信じられないほど手頃な価格であるということです。より信頼性の高い「セキュアクラウド」でのオンデマンド作業に加えて、大幅なコスト削減につながる可能性がある「スポットインスタンスを備えたコミュニティクラウド」があります。予算を使い果たしているように感じることなく、実験、モデルの微調整、推論の実行に最適なプラットフォームです。

リストにある理由: RunPodのサーバーレスGPU製品であるFlashBootは、200ミリ秒未満のコールドスタートで、推論にとって大きな意味を持ちます。彼らの全体的な雰囲気は、GPUコンピューティングをアクセス可能にすることであり、実際にそれを実現しています。

価格設定: RunPodには2つの層があります。コミュニティクラウドでは、NVIDIA H100 PCIeなどのGPUを1時間あたり約1.99ドルで見つけることができ、A100は1時間あたり1.19ドルに近いかもしれません。セキュアクラウドインスタンスは少しコストがかかりますが、より安定性があります。

長所と短所:

-

長所: 非常に予算に優しい、推論に最適なサーバーレスオプション、シンプルでクリーンなUI。

-

短所: コミュニティクラウドインスタンスは信頼性が低くなる可能性があり、大規模プロバイダーのすべての派手なエンタープライズ機能がありません。

2. DigitalOcean

開発者にとって、物事を機能させたいだけなら、DigitalOceanがあります。彼らのGradient AI GPU Dropletsは、可能な限り簡単にデプロイおよび管理できます。これは、GPU以上のものを必要とするチームに最適な選択肢であり、マネージドデータベース、オブジェクトストレージ、Kubernetesなど、開発者にとって使いやすいツールのエコシステム全体を、予測可能な価格で提供しています。

リストにある理由: DigitalOceanの強みは、統合されたプラットフォームです。これにより、単にモデルを隔離してトレーニングするのではなく、フルスタックAIアプリケーションの構築がはるかに簡単になります。インフラストラクチャの雑草に迷うことなく、迅速に発送したいチーム向けです。

価格設定: DigitalOceanは、その価格設定で率直かつ競争力があることで知られています。最新の数値に基づくと、NVIDIA H100 GPUは1時間あたり約1.99ドルから始まります。

長所と短所:

-

長所: 非常に使いやすい、予測可能でシンプルな価格設定、完全な開発者向けクラウドエコシステム。

-

短所: よりニッチなプロバイダーほど早く、絶対に最新の最も特殊なGPUを入手できない可能性があります。

3. Lambda Labs

AIと機械学習の世界に深く関わっているなら、Lambda Labsについて聞いたことがあるはずです。これは、ML研究者によってML研究者向けに構築されたプラットフォームです。ディープラーニング用に微調整されたGPUインスタンスとクラスターを提供し、PyTorch、TensorFlow、CUDA、およびすべてのドライバーがすぐに使用できる事前構成済みの環境を備えています。

リストにある理由: 特に大規模なマルチノードトレーニングの実行において、深刻なディープラーニングに最適な選択肢です。彼らの高速インターコネクトと純粋なパフォーマンスへの重点は、数日または数週間大規模なモデルをトレーニングしている場合に、大きな違いをもたらします。

価格設定: Lambdaは、わかりやすい時間料金で物事をシンプルに保ちます。オンデマンドのNVIDIA H100 GPUを1時間あたり2.49ドルで入手できます。

長所と短所:

-

長所: ディープラーニングに高度に最適化、優れたパフォーマンス、スケーリングを容易にする「1クリッククラスター」。

-

短所: 最も人気のあるGPUには順番待ちリストがあり、プラットフォームは広範なクラウドサービススイートよりも生のコンピュートに関するものです。

4. Vultr

Vultrは、大規模なグローバルリーチを備えた高性能インフラストラクチャに重点を置いています。彼らのクラウドGPUプラットフォームはわかりやすく、理解しやすい価格モデルで強力なNVIDIA GPUへのアクセスを提供します。世界中の32のデータセンターの場所があるため、ユーザーの近くにモデルをデプロイするのに最適な選択肢です。

リストにある理由: Vultrは、レイテンシを低く保つために、グローバルに推論エンドポイントをデプロイするための素晴らしいオプションです。DigitalOceanのようなプロバイダーのシンプルさと、エンタープライズグレードのハードウェアと一流のネットワークを組み合わせています。

価格設定: Vultrの価格設定は明確で競争力があります。オンデマンドのNVIDIA HGX H100 GPUは1時間あたり2.99ドルかかります。

長所と短所:

-

長所: 32のグローバルデータセンターの巨大なネットワーク、シンプルで高速なデプロイメント、一貫して高いパフォーマンス。

-

短所: Lambda Labsのようなプラットフォームと比較して、AI固有のツールに特化していません。

5. Google Cloud

ビッグリーグでプレイする準備ができたら、Google Cloudはヘビー級です。NVIDIA GPUだけでなく、その種の作業のために特別に設計された独自のカスタム構築されたTensor Processing Units(TPU)も提供しているため、大規模なトランスフォーマーモデルをトレーニングしている場合は特に強力な選択肢です。

リストにある理由: TPUへのアクセスはユニークな特典であり、Google自身の強力なAI/MLエコシステム(Vertex AIやBigQueryなど)との深い関係により、最先端に取り組んでいる人にとって最高の選択肢となっています。

価格設定: ハイパースケーラーの価格設定のワイルドな世界へようこそ。ここでは単純な時間料金はありません。GoogleのGPU価格設定ページのコストは、地域、インスタンスタイプ、長期使用を約束するかどうかによって大きく異なります。実際の見積もりを取得するには、価格計算ツールを使用する必要があります。これは、予測可能性を求めているだけのチームにとっては面倒です。

長所と短所:

-

長所: TPUへのユニークなアクセス、大規模トレーニングに最適、成熟した強力なAIプラットフォーム。

-

短所: 非常に複雑で高価になる可能性があり、最終的な請求額を推測するのは悪名高いほど困難です。

6. Amazon Web Services(AWS)

AWSは、クラウドコンピューティングルームの800ポンドのゴリラです。利用可能な最も成熟した完全なプラットフォームであり、EC2サービスで最も幅広いGPUインスタンスを提供しています。推論用の小型で安価なチップから、ヘビーデューティートレーニング用の巨大な8x H100クラスターまで、あらゆるものを見つけることができます。

リストにある理由: 多くの企業にとって、AWSはデフォルトの選択肢です。その大規模なサービスエコシステム(ストレージ用のS3、MLOps用のSageMaker、サーバーレス機能用のLambda)とグローバルリーチにより、インフラストラクチャに関するすべての真のワンストップショップとなっています。

価格設定: Googleと同様に、AWSの価格設定は手ごわいです。オンデマンド、スポットインスタンス(より安価ですが、中断される可能性があります)、およびより長い契約のための節約プランに分割されています。信じられないほど強力ですが、月末に恐ろしい「請求ショック」を避けるために、コストを慎重に管理する必要があります。

長所と短所:

-

長所: インスタンスとサービスの最も幅広い選択肢、非常にスケーラブル、堅牢なエンタープライズグレードの機能。

-

短所: 信じられないほど複雑で、価格設定は謎のように感じられ、予期せぬ請求につながる可能性があります。

7. Microsoft Azure

Microsoft Azureは、エンタープライズの世界のハイパースケーラーです。ハイブリッドクラウドソリューションを重視し、大規模なセキュリティおよびコンプライアンス認証のリストを持っています。これは、規制された業界の大規模な組織にとって大きな意味を持ちます。彼らのNCシリーズとNDシリーズの仮想マシンは、強力なNVIDIA GPUへのアクセスを提供します。

リストにある理由: Azureは、すでにMicrosoftエコシステム(Office 365とActive Directoryなど)に深く関わっている大企業にとっては当然のことです。また、厳格なデータガバナンスルールを持つ組織のリーダーでもあります。

価格設定: ハイパースケーラーのトレンドに従って、Azureの価格設定は複雑です。従量課金制、予約済みインスタンス、および節約プランを提供しています。NCシリーズVM上の単一のH100 GPUは、地域と設定に応じて1時間あたり約7ドルで実行できます。これは、より特殊なプロバイダーよりもかなり高くなっています。

長所と短所:

-

長所: Microsoftのエンタープライズ製品との優れた統合、強力なハイブリッドクラウド機能、包括的なコンプライアンスオファリング。

-

短所: 他のプラットフォームよりも開発者向けではないと感じることがあり、ナビゲートが複雑です。

適切なCoreWeave代替サービスを選択する方法

少し圧倒されましたか? 適切なプロバイダーを選択するのに役立つシンプルなチェックリストにまとめてみましょう。

-

ワークロードから始めましょう。 実際に何をしようとしていますか? 強烈な数週間のトレーニングジョブの場合は、Lambda LabsやAWSのような高速接続を備えたプロバイダーが必要です。 推論をすばやくバーストさせている場合は、RunPodやVultrのような手頃な価格のオプションが最適かもしれません。

-

チームについて考えてください。 チームはKubernetesを呼吸していますか、それともシンプルでワンクリックのマシンの方が幸せですか? チームのスキルについて正直になり、一致するプラットフォームを選択してください。 DigitalOceanのようなプロバイダーでシンプルさを選択すると、時間と頭痛の種を大幅に節約できます。

-

隠れたコストを予算に入れましょう。 宣伝されているGPUの1時間あたりの価格だけを見てはいけません。 ストレージ、データ転送(特にデータの送信)、およびGPUをサポートする通常のCPUインスタンスのコストを追加することを忘れないでください。 大規模なクラウドプロバイダーは、特にそのトリッキーな請求で知られています。

Pro tip

上位2〜3の選択肢で小規模なパイロットプロジェクトを実行します。手を汚すことに代わるものはありません。主要なものにコミットする前に、実際のパフォーマンス、開発者のワークフロー、サポートをテストしてください。

AIに電力を供給する適切なCoreWeave代替サービスを見つける

CoreWeave代替サービスの市場は、シンプルで開発者向けのプラットフォームから、強力なエンタープライズクラウドまで、素晴らしいオプションにあふれています。 適切な選択は、全体として「最高の」プロバイダーを見つけることではありません。 プロジェクト、予算、およびチームのスキルに適合するものを見つけることです。

AIモデルを構築して実行するための完璧なエンジンを選択したら、次のステップは、ユーザーが優れたエクスペリエンスを確実に得られるようにすることです。 強力なGPUクラスターは戦いの半分に過ぎません。 スマートでスケーラブルなサポートがなければ、AIの約束を実現することはできません。

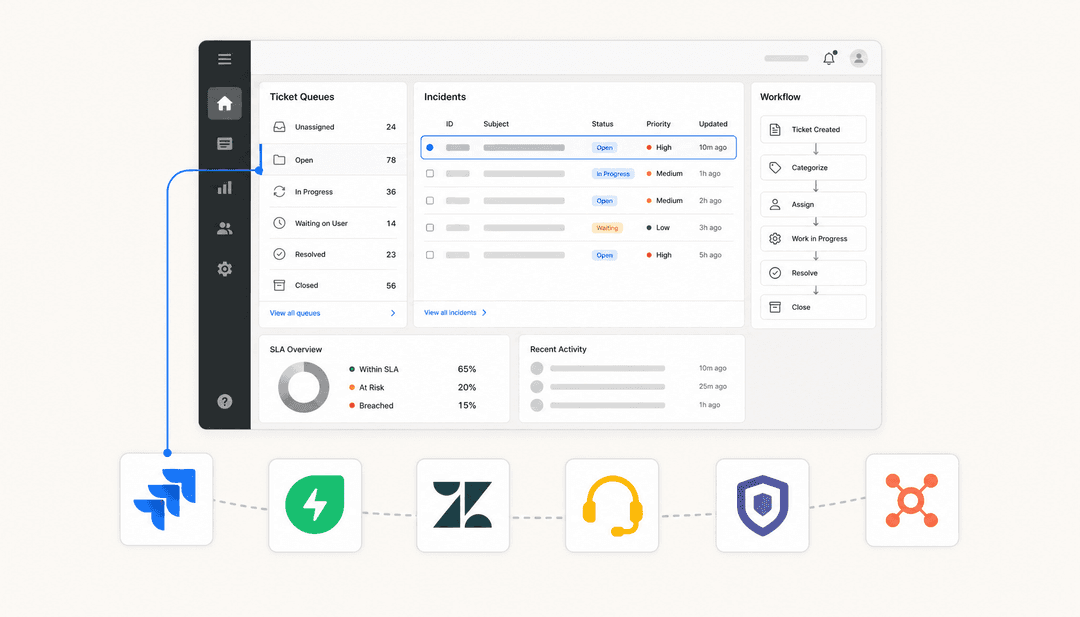

ここでeesel AIが登場します。 ヘルプデスクとナレッジベースに接続して、ユーザーの質問に即座に回答できる自律型AIエージェントを提供します。最前線のサポートを自動化することで、これらのプラットフォーム上に構築した驚くべきAIが実際に顧客を支援していることを確認します。 過去のサポートチケットでのパフォーマンスをシミュレートして、ライブになる前に影響を確認することもできます。

構築したのと同じくらい効果的にAIアプリケーションをサポートする準備はできましたか? eesel AIで無料で使用を開始 すると、数分で起動して実行できます。

よくある質問

Share this article

Article by

Stevia Putri

Stevia Putriはeesel AIのマーケティングジェネラリストで、強力なAIツールを共感を呼ぶストーリーに変える手助けをしています。好奇心、明晰さ、そしてテクノロジーの人間的な側面に意欲をかき立てられています。