Blog

Dicas, guias e insights sobre colegas de IA, suporte mais inteligente e construção de equipes melhores.

7 melhores alternativas ao Tidio Lyro em 2026

O preço por conversa do Lyro acumula rápido, e ele só funciona dentro do Tidio. Aqui estão 7 alternativas que valem a pena experimentar em 2026, desde IA nativa de helpdesk até chat ao vivo gratuito.

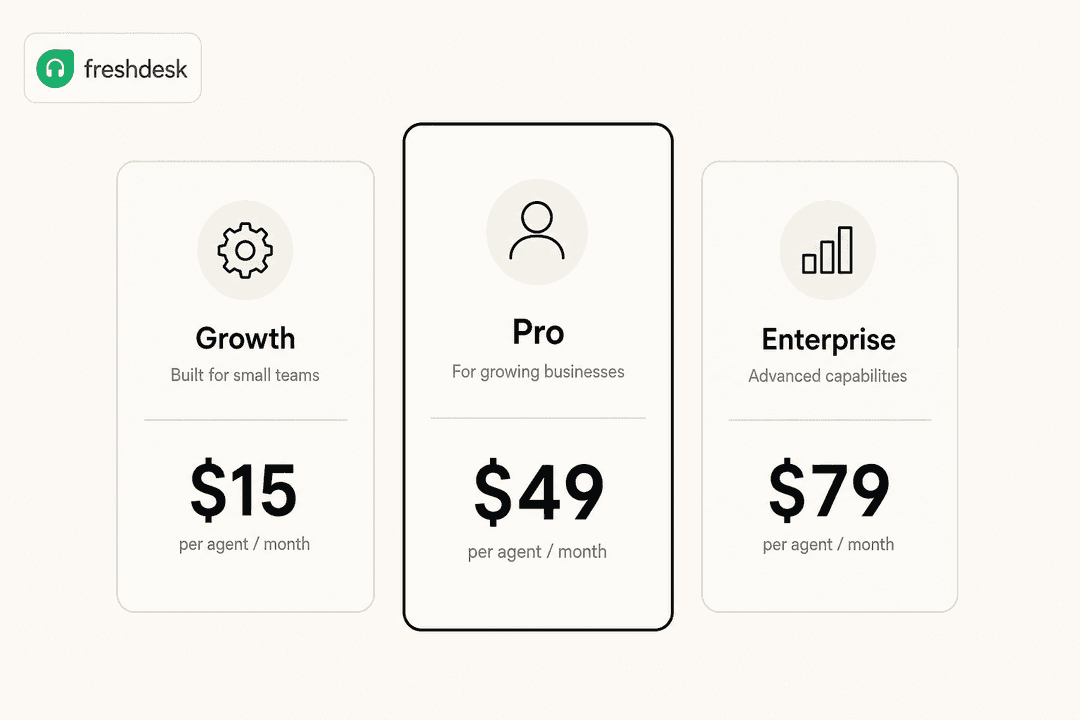

Preços do Freddy AI do Freshdesk explicados: o que você realmente paga em 2026

O Freddy AI são três produtos separados com três preços diferentes. Veja o que cada um custa, o que está incluído no seu plano e onde as equipes costumam ter surpresas.

As 6 melhores alternativas ao Freshdesk Freddy em 2026

As sessões do Freddy AI ficam caras rapidamente. Aqui estão as 6 melhores alternativas ao Freshdesk Freddy - incluindo uma que funciona sobre o Freshdesk sem necessidade de migração.

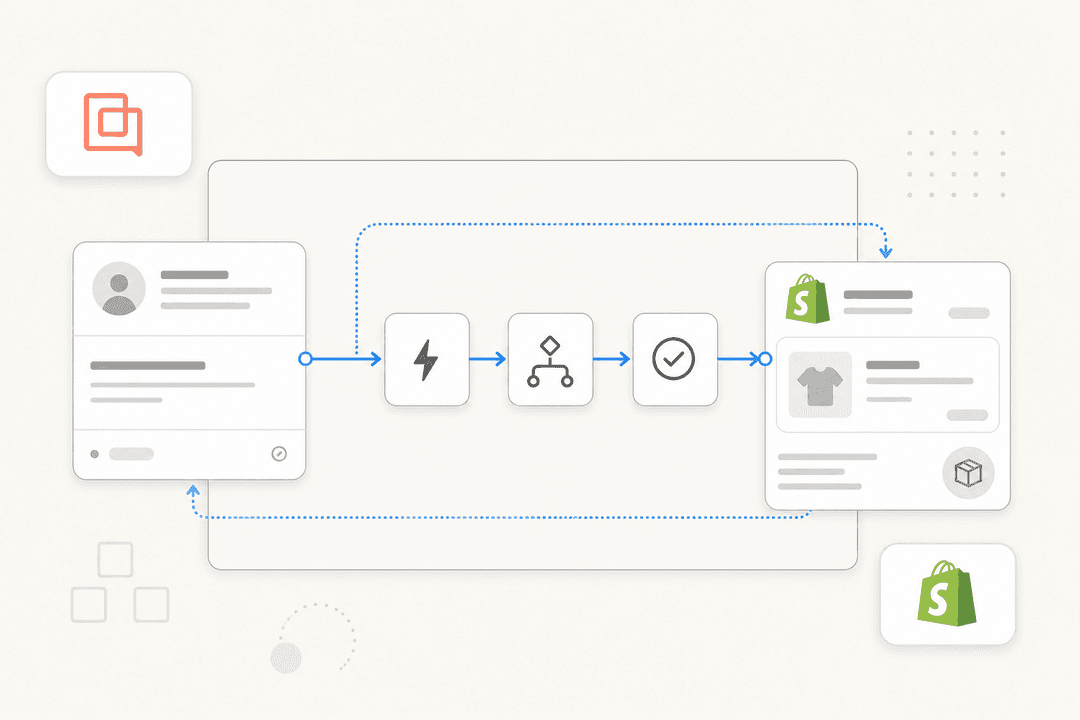

Como configurar a automação Gorgias Shopify (guia completo para 2026)

O Gorgias oferece quatro camadas de automação distintas para lojas Shopify. Veja como cada uma funciona, qual configurar primeiro e onde elas ficam aquém.

O chat bubble do Gorgias para Shopify: guia completo de configuração e personalização (2026)

Tudo o que os comerciantes Shopify precisam saber sobre o chat bubble do Gorgias - como instalá-lo corretamente, personalizá-lo, corrigir problemas quando ele falha e tornar a IA realmente útil.

As 6 melhores alternativas ao ManageEngine em 2026

O ManageEngine ServiceDesk Plus funciona para muitas equipes de TI, mas a configuração complexa e a interface desatualizada levam as equipes a buscar outras opções. Aqui estão as 6 melhores alternativas em 2026.

Preços do CapCut 2026: Um guia completo para planos grátis, padrão e pro

Confuso com as recentes mudanças de preço do CapCut? Você não está sozinho. Nosso guia de 2026 desmistifica os planos Grátis, Padrão e Pro, comparando recursos, custos e o que você realmente obtém pelo seu dinheiro.

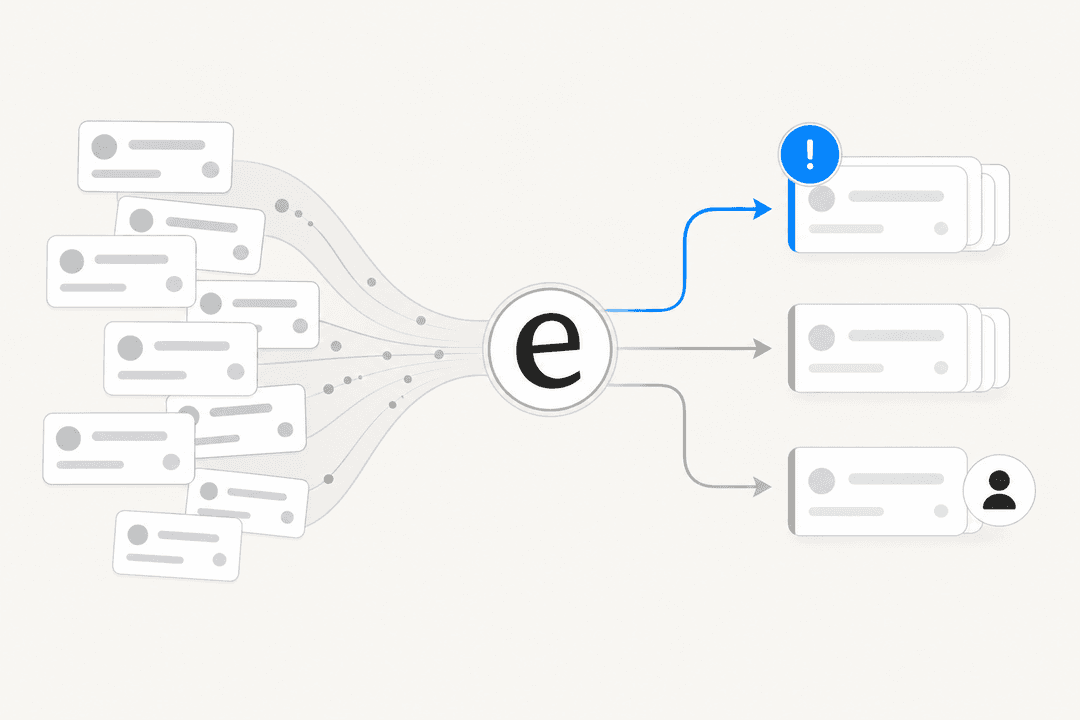

Como automatizar a triagem de tickets: um guia passo a passo para equipes de suporte

A triagem manual de tickets roteia erroneamente 15-25% dos tickets e custa às equipes centenas de milhares por ano. Veja como automatizá-la em 9 passos - com menos reatribuições e resolução mais rápida.

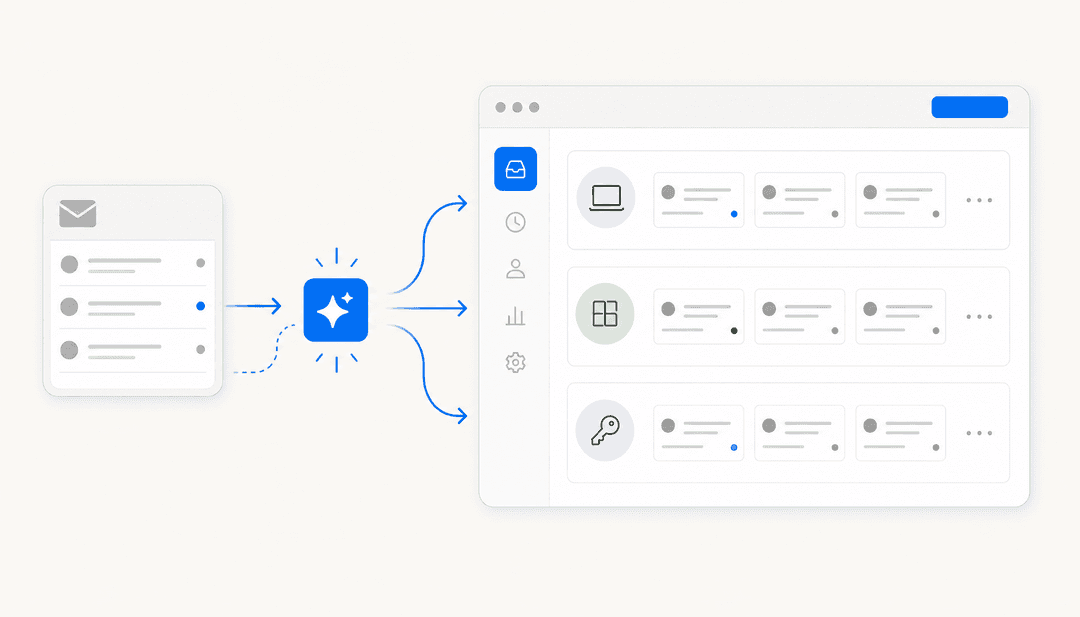

Ticketing de TI automatizado em 2026: 6 ferramentas que esvaziam a fila sem trabalho manual

O ticketing de TI automatizado avançou muito além do roteamento baseado em regras. Veja como 6 ferramentas -- de sobreposições leves de IA a plataformas ITSM completas -- lidam com tickets da criação ao fechamento.

Pronto para contratar seu colega de IA?

Configure em minutos. Sem cartão de crédito necessário.