Digitar perguntas num chatbot já parece bastante normal, não é? Mas a próxima grande novidade em IA não é sobre digitar, é sobre falar. Estamos prestes a ter uma IA de voz conversacional em tempo real que consegue entender-nos, interromper quando necessário e responder tal como outra pessoa faria. É uma mudança que promete uma forma muito mais natural de interagir com a tecnologia.

A impulsionar esta evolução estão ferramentas como a API Realtime da OpenAI, que oferece aos programadores os blocos de construção para estas experiências fluidas e focadas na voz. Mas há um porém: embora a tecnologia em si seja incrível, transformá-la numa ferramenta de negócio refinada e pronta para o mercado é uma história completamente diferente. É uma jornada que geralmente requer conhecimentos técnicos aprofundados, muitas horas de desenvolvimento e uma boa dose de paciência.

Então, vamos desvendar os segredos da API Realtime da OpenAI, ver o que ela pode fazer e falar honestamente sobre o que é preciso para construir com ela.

O que é a API Realtime da OpenAI?

Na sua essência, a API Realtime da OpenAI é uma ferramenta que permite aos programadores criar aplicações com conversas de voz para voz de baixa latência. Se alguma vez usou o Modo de Voz Avançado do ChatGPT, este é o motor que torna esse tipo de interação possível, mas agora está disponível para qualquer pessoa usar.

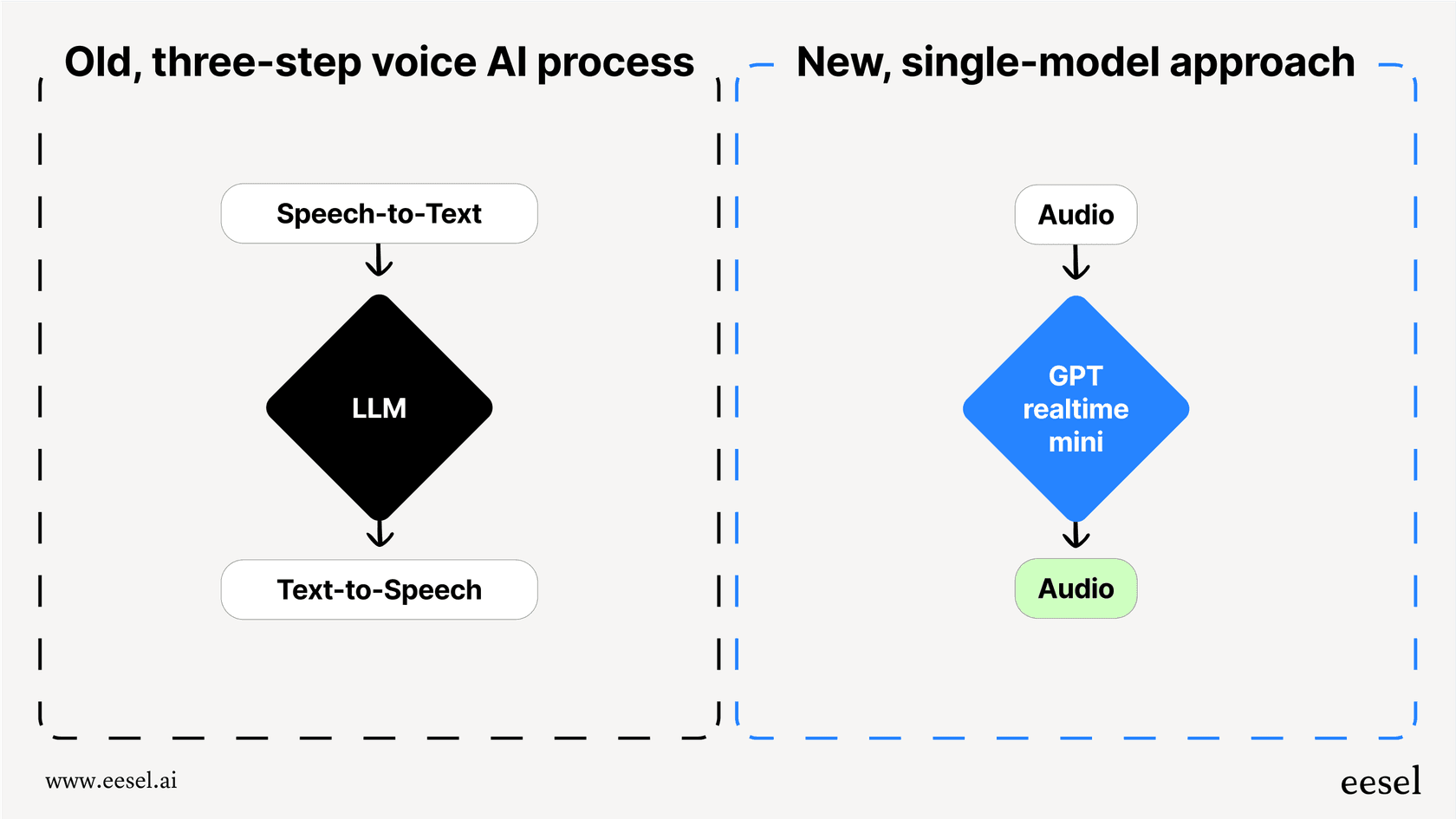

Antes desta API surgir, construir um agente de voz era uma dor de cabeça desajeitada e com várias etapas. Era preciso encadear várias APIs diferentes:

-

Voz para Texto (STT): Primeiro, usaria uma API como o Whisper para transformar as palavras faladas do utilizador em texto.

-

Modelo de Linguagem Grande (LLM): Em seguida, enviaria esse texto para uma API como o GPT-4 para descobrir o que dizer em resposta.

-

Texto para Voz (TTS): Finalmente, usaria outra API para converter a resposta em texto de volta para áudio.

Esta cadeia de eventos funcionava, mas era lenta. Cada transição adicionava um pequeno atraso, criando uma latência constrangedora que tornava as conversas forçadas e pouco naturais. Mais importante ainda, eliminava todas as nuances da fala humana. Aspetos como o tom, a emoção e a ênfase perdiam-se no momento em que o áudio se tornava texto, resultando numa interação monótona e robótica.

A API Realtime muda completamente esta situação ao usar um modelo único e unificado (como o "gpt-realtime") que processa o áudio do início ao fim. Ele ouve o áudio e gera uma resposta em áudio diretamente. Isto reduz drasticamente a latência e preserva a riqueza da fala, abrindo caminho para uma IA mais rápida, expressiva e genuinamente conversacional.

Como funciona a API Realtime da OpenAI

A API não se trata apenas de voz; foi projetada para comunicação multimodal de baixa latência. É uma forma sofisticada de dizer que consegue lidar com diferentes tipos de informação ao mesmo tempo, tornando os agentes que constrói muito mais inteligentes e conscientes do seu ambiente.

Capacidades multimodais da API Realtime da OpenAI

A API Realtime funciona com modelos como o GPT-4o, que são "natively multimodais". Pense nisto da seguinte forma: a IA não foi apenas ensinada a ler texto. Foi treinada desde o primeiro dia para compreender e processar uma combinação de áudio, imagens e texto em conjunto. Isto permite interações muito mais dinâmicas do que um simples agente apenas de voz conseguiria gerir.

Métodos de ligação

Para alcançar essa velocidade em tempo real, precisa de manter uma ligação constante e aberta com a API. A OpenAI oferece alguns métodos de ligação, e a escolha certa depende realmente do que está a construir e da stack tecnológica da sua equipa.

| Método de Ligação | Caso de Uso Ideal | Esforço Técnico |

|---|---|---|

| WebRTC | Aplicações de navegador e do lado do cliente que necessitam da menor latência possível. | Elevado (Envolve a gestão de ligações peer-to-peer e ofertas/respostas SDP). |

| WebSocket | Aplicações do lado do servidor onde a baixa latência ainda é uma prioridade. | Médio (Mais simples que o WebRTC, mas ainda requer a gestão de uma ligação persistente). |

| SIP | Integração com sistemas de telefonia VoIP (como num call center). | Elevado (Requer conhecimento de protocolos de telefonia e infraestrutura). |

A simples escolha e configuração do método de ligação correto não é uma tarefa pequena. Exige um planeamento técnico e um esforço de desenvolvimento consideráveis, e é frequentemente um dos primeiros obstáculos que as equipas enfrentam ao tentar construir um agente de voz personalizado.

Funcionalidades principais da API Realtime da OpenAI

Além do seu design principal, a API Realtime inclui um conjunto de funcionalidades que a tornam um poderoso kit de ferramentas para programadores. Estas são as peças que usará para criar agentes de voz inteligentes e dinâmicos.

Interação de voz para voz

Este é o evento principal. Como um modelo como o "gpt-realtime" trabalha diretamente com áudio, consegue captar pistas subtis que os sistemas baseados em texto sempre perdem, como risos, sarcasmo ou mudanças emocionais. Consegue, então, gerar uma resposta que soa muito mais natural e expressiva. Com o lançamento geral da API, a OpenAI até adicionou duas novas vozes, Marin e Cedar, que estão disponíveis exclusivamente aqui e soam incrivelmente realistas.

Deteção de Atividade de Voz (VAD)

A Deteção de Atividade de Voz é o que faz com que uma conversa de IA pareça menos uma transação e mais um verdadeiro diálogo. É a funcionalidade que permite à IA saber quando alguém começou ou parou de falar. Isto é absolutamente essencial para uma troca de turnos natural. Se um utilizador quiser intervir e mudar de assunto, pode simplesmente começar a falar. O agente irá reconhecer isso e adaptar-se, em vez de continuar ou esperar por uma pausa constrangedora.

Chamada de funções e ferramentas

Um agente de voz só é útil se conseguir realmente fazer coisas. A API Realtime suporta a chamada de funções, o que permite ao agente ligar-se a ferramentas externas e fontes de dados para obter informações ou concluir tarefas. Por exemplo, um agente de suporte poderia usar uma função para consultar o estado do pedido de um cliente no seu sistema ou processar um reembolso no momento. Embora isto seja incrivelmente poderoso, cabe a si, o programador, construir, ligar e manter cada uma destas integrações de ferramentas.

Entradas de imagem e texto

Como a API é multimodal, os utilizadores não estão limitados apenas à sua voz. Podem adicionar outras informações à conversa. Um cliente pode estar numa chamada com um agente de suporte, enviar uma captura de ecrã de uma mensagem de erro e perguntar: "O que estou a ver aqui?" O agente pode ver a imagem, compreender o contexto e dar uma resposta falada útil.

Casos de uso comuns e limitações da API Realtime da OpenAI

O potencial da IA de voz de baixa latência é enorme, mas alguns casos de uso tornaram-se rapidamente os mais populares. Também vale a pena ser realista sobre os obstáculos que enfrentará ao construir estas aplicações de raiz.

Casos de uso

-

Agentes de apoio ao cliente: Atender chamadas recebidas, lidar com perguntas comuns e encaminhar problemas mais complexos para o agente humano correto.

-

Assistentes pessoais: Ajudar no agendamento, definir lembretes e obter informações em modo mãos-livres.

-

Aplicações de aprendizagem de idiomas: Criar parceiros de conversação realistas para ajudar os utilizadores a praticar a fala de um novo idioma.

-

Ferramentas educacionais: Construir tutores interativos que podem explicar verbalmente tópicos complexos e responder a perguntas dos alunos.

Limitações de uma abordagem DIY

Construir um agente de voz com a API pura pode parecer empolgante, mas é um projeto de engenharia massivo que envolve muito mais do que apenas chamar um endpoint.

-

O esforço de desenvolvimento é enorme: Não está apenas a ligar uma API; está a construir uma aplicação inteira. Isto significa gerir a infraestrutura, lidar com o estado da conversa, projetar a lógica e garantir que todo o sistema é fiável e escalável.

-

Nenhum fluxo de trabalho de negócio incluído: A API dá-lhe o motor, mas tem de construir o carro. Toda a lógica específica do negócio para triagem de tickets, encaminhamento para a equipa certa, acompanhamento de interações e elaboração de relatórios sobre o seu desempenho tem de ser construída de raiz.

-

Sem análises ou testes integrados: Como sabe se o seu agente é realmente bom? Sem ferramentas dedicadas, não há uma forma fácil de testar o seu agente em conversas passadas, medir a sua precisão ou descobrir onde a sua base de conhecimento está a falhar.

É aqui que entra o clássico debate de "construir vs. comprar". Para equipas que precisam de uma solução de suporte de IA pronta para produção sem esperar meses pelo desenvolvimento, uma plataforma como a eesel AI oferece um caminho muito mais direto. Ela fornece um motor de fluxo de trabalho no-code, integrações de helpdesk com um clique e ferramentas de simulação poderosas, permitindo-lhe entrar em funcionamento em minutos, não em meses.

Preços da API Realtime da OpenAI

O preço da API é baseado em tokens de áudio, que são calculados de forma diferente dos tokens de texto. É faturado tanto pelo áudio que envia para o modelo (entrada) como pelo áudio que o modelo lhe envia de volta (saída). Isto pode dificultar a previsão dos custos, uma vez que dependem da duração e complexidade de cada conversa.

Aqui está uma visão geral dos preços para o modelo "gpt-realtime" (nível standard), que é 20% mais barato que a versão de pré-visualização:

| Tipo de Token | Preço por 1M de tokens |

|---|---|

| Entrada de Áudio | $32.00 |

| Entrada de Áudio em Cache | $0.40 |

| Saída de Áudio | $64.00 |

(Informações de preços baseadas na página de preços da OpenAI.)

Embora os preços baseados em tokens sejam flexíveis para programadores que estão apenas a experimentar, podem criar faturas imprevisíveis para empresas com canais de suporte de alto volume. Um mês movimentado pode resultar numa fatura surpreendentemente elevada, tornando difícil orçamentar eficazmente.

A alternativa mais simples à API Realtime da OpenAI: agentes de suporte de IA com a eesel AI

Construir diretamente com a API Realtime da OpenAI é uma opção fantástica para programadores que criam aplicações totalmente novas de raiz. No entanto, para empresas que procuram automatizar o apoio ao cliente, melhorar a sua gestão de serviços de TI, ou potenciar sessões de Perguntas e Respostas internas, uma plataforma dedicada é quase sempre a escolha mais rápida, económica e poderosa desde o início.

A eesel AI é uma plataforma completa de suporte com IA que utiliza o poder de modelos avançados como os que estão por trás da API Realtime, mas poupa-o de ter de escrever uma única linha de código para integrações ou gestão de fluxos de trabalho.

Veja como ela aborda os desafios da abordagem DIY:

-

Entre em funcionamento em minutos: Em vez de passar meses a lutar com WebSockets e infraestrutura, pode ligar o seu helpdesk (como Zendesk ou Freshdesk) e fontes de conhecimento com um único clique. O seu agente de IA pode começar a aprender com os seus tickets passados, artigos da central de ajuda e documentos internos imediatamente.

-

Teste com confiança: O modo de simulação da eesel AI permite-lhe testar o seu agente em milhares dos seus tickets históricos reais num ambiente seguro. Pode ver como ele teria respondido, ajustar o seu comportamento e obter previsões precisas sobre taxas de resolução e poupança de custos antes de interagir com um cliente real.

-

Controlo total e personalização: Com um editor de prompts simples e um motor de fluxo de workflow no-code, você decide exatamente quais tickets a sua IA trata e que ações pode tomar. Pode configurar regras para escalar problemas complexos, etiquetar tickets automaticamente ou até chamar APIs externas para obter informações sobre pedidos.

-

Preços previsíveis: Os planos da eesel AI baseiam-se num número fixo de interações mensais de IA, sem taxas surpresa por resolução. Isto torna o seu orçamento simples e transparente, eliminando as incertezas que vêm com um modelo variável baseado em tokens.

Considerações finais sobre a API Realtime da OpenAI

A API Realtime da OpenAI é uma peça de tecnologia genuinamente impressionante. Está a diminuir a distância entre a forma como humanos e máquinas falam, abrindo caminho para um futuro onde a IA focada na voz parece completamente natural. Ela oferece aos programadores um motor incrivelmente poderoso para construir coisas fantásticas.

No entanto, o caminho de uma chave de API para uma ferramenta de negócio fiável e pronta para produção é longo e cheio de desafios técnicos. Para a maioria das empresas, especialmente as focadas em atendimento ao cliente e suporte de TI, uma plataforma construída para esse propósito específico simplesmente entrega valor de forma mais rápida e fiável. Obtém todo o poder da IA subjacente, mas envolvido num conjunto de ferramentas projetadas para o trabalho exato que precisa de ser feito.

Pronto para ver o que um agente de suporte de IA construído para o efeito pode fazer por si? Comece o seu teste gratuito com a eesel AI e automatize o seu suporte de linha da frente em minutos.

Perguntas frequentes

A API Realtime da OpenAI foi projetada para permitir que os programadores criem aplicações que suportam conversas de voz para voz de baixa latência. Utiliza um modelo único e unificado para processar áudio diretamente, permitindo experiências fluidas, naturais e focadas na voz.

Ao contrário das abordagens anteriores de várias etapas, a API Realtime da OpenAI processa o áudio do início ao fim, reduzindo significativamente a latência e preservando pistas subtis como o tom e a emoção. Este processamento unificado leva a interações de IA muito mais naturais e expressivas.

Para garantir a velocidade em tempo real, a API Realtime da OpenAI suporta vários métodos de ligação. Estes incluem WebRTC para aplicações baseadas em navegador, WebSockets para uso do lado do servidor e SIP para integração com sistemas de telefonia VoIP.

Sim, a API Realtime da OpenAI suporta a chamada de funções, o que permite que o agente de IA se ligue a ferramentas externas e fontes de dados. Os programadores são responsáveis por construir, ligar e manter estas integrações para permitir tarefas específicas ou a recuperação de informações.

O preço da API Realtime da OpenAI é baseado em tokens de áudio tanto para entrada como para saída, o que pode tornar a previsão de custos um desafio. Para empresas com alto volume de utilização, este modelo baseado em tokens pode levar a faturas mensais variáveis e potencialmente elevadas.

A API Realtime da OpenAI funciona com modelos nativamente multimodais como o GPT-4o, o que lhe permite processar uma mistura de áudio, imagens e texto. Isto significa que os utilizadores podem fornecer contexto visual, como uma captura de ecrã, juntamente com as suas perguntas faladas para interações mais ricas e abrangentes.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.