Se você está construindo algo com IA, seja um bot de suporte ao cliente ou uma ferramenta interna de P&R, provavelmente já teve este pensamento: "E se alguém disser algo... ruim?"

É uma preocupação válida. Manter sua plataforma segura contra conteúdo nocivo ou inadequado não é apenas algo bom de se ter; é essencial para proteger seus usuários e sua marca.

É exatamente para isso que serve a API de Moderação da OpenAI. É uma ferramenta útil que ajuda a identificar e filtrar uma grande variedade de conteúdos inadequados, tanto em texto quanto em imagens. Neste guia, vamos abordar tudo o que você precisa saber sobre ela, desde suas funcionalidades e preços até suas limitações no mundo real. Também veremos o que é necessário para ir além de apenas sinalizar conteúdo e construir um sistema de moderação completo que realmente funcione.

Recurso 1: [Infográfico] , Um infográfico que explica visualmente a função principal da API de Moderação da OpenAI. Ele deve mostrar texto ou uma imagem entrando na API e a API gerando sinalizações para diferentes categorias, como 'violência' ou 'discurso de ódio'.

O que é a API de Moderação da OpenAI?

Pense na API de Moderação da OpenAI como uma verificação rápida de segurança de conteúdo. Você envia um texto ou uma imagem, e ela informa se o conteúdo é potencialmente prejudicial, sinalizando-o com base nas políticas de uso da OpenAI.

É basicamente sua primeira linha de defesa. O objetivo é capturar conteúdo problemático o mais cedo possível para que você possa decidir o que fazer a seguir, seja filtrar uma mensagem, bloquear um usuário ou encaminhá-lo para um humano para uma análise mais detalhada.

E talvez a melhor parte? É totalmente gratuita. Isso a torna um ponto de partida super acessível para qualquer desenvolvedor que queira adicionar uma camada de segurança ao seu aplicativo sem se preocupar com custos.

Principais funcionalidades da API de Moderação da OpenAI

A API melhorou muito desde seu lançamento, e os modelos mais recentes são mais poderosos e precisos do que nunca. Aqui estão algumas das principais funcionalidades que se destacam.

Classificação multimodal para texto e imagens

Com o novo modelo "omni-moderation-latest", construído com base no GPT-4o, a API de Moderação da OpenAI agora pode analisar tanto texto quanto imagens de uma só vez. Isso é um grande avanço para aplicativos que lidam com mídia mista, como fóruns de comunidade ou chats de suporte onde as pessoas enviam capturas de tela.

Atualmente, essa funcionalidade de texto e imagem funciona para três categorias principais:

-

Violência ("violence" e "violence/graphic")

-

Automutilação ("self-harm", "self-harm/intent" e "self-harm/instruction")

-

Conteúdo sexual ("sexual")

As outras categorias ainda são apenas para texto por enquanto, mas é um grande passo para cobrir todas as suas bases, independentemente do tipo de conteúdo.

Categorias de conteúdo abrangentes

A API não procura apenas um tipo de conteúdo ruim; ela varre um espectro completo de problemas. Os modelos mais recentes até adicionaram classificações mais detalhadas. Aqui está um resumo rápido do que ela pode detectar:

| Categoria | Descrição | Entradas |

|---|---|---|

| "harassment" | Linguagem que expressa, incita ou promove assédio. | Apenas texto |

| "hate" | Conteúdo que promove ódio com base em raça, gênero, etnia, religião, etc. | Apenas texto |

| "self-harm" | Qualquer coisa que incentive ou mostre atos de automutilação, como suicídio ou cortes. | Texto e imagens |

| "sexual" | Conteúdo destinado a ser sexualmente excitante ou que promove serviços sexuais. | Texto e imagens |

| "violence" | Conteúdo que mostra morte, violência ou lesões físicas graves. | Texto e imagens |

| "illicit" | Conteúdo que dá instruções sobre como fazer coisas ilegais (por exemplo, "como furtar uma loja"). | Apenas texto |

Precisão aprimorada e pontuações calibradas

O modelo "omni-moderation-latest" também é muito mais preciso, especialmente com idiomas diferentes do inglês. Os próprios testes da OpenAI mostraram que ele foi 42% melhor em um conjunto de testes multilíngue do que a versão anterior.

Outro toque legal é que as pontuações do modelo agora são "calibradas". Em termos simples, isso significa que a pontuação de confiança que você obtém (um número de 0 a 1) é um reflexo mais realista da probabilidade de o conteúdo estar realmente violando uma política. Isso permite que você defina seus próprios limites de filtragem com muito mais confiança.

Quando você faz uma solicitação, a API retorna um objeto JSON com três campos importantes:

-

"flagged": Um simples "true" ou "false" informando se algo foi sinalizado.

-

"categories": Uma lista das categorias específicas que foram sinalizadas como "true".

-

"category_scores": As pontuações de confiança detalhadas para cada categoria.

Como usar a API de Moderação da OpenAI

Embora a API em si seja poderosa, fazê-la funcionar bem no seu aplicativo exige um pouco de configuração técnica e planejamento. Aqui está uma visão rápida do que está envolvido.

Primeiros passos

Primeiro de tudo, você precisará de uma conta da OpenAI e uma chave de API, que você pode obter na página de configurações da sua organização. A boa notícia é que, ao contrário de algumas outras APIs, você tem acesso ao endpoint de moderação imediatamente. Não é necessário esperar.

Fazendo uma solicitação de moderação

Depois de ter sua chave, você só precisa enviar uma solicitação POST para o endpoint "/v1/moderations". Você realmente só precisa de duas coisas: o "input" (o texto ou URL da imagem que você quer verificar) e o "model" que você quer usar.

curl https://api.openai.com/v1/moderations \

-X POST \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-d '{

"input": "Eu quero matá-los.",

"model": "omni-moderation-latest"

}'

A API retornará um objeto JSON com os resultados. Para uma verificação rápida, você pode apenas olhar o campo "flagged" para ver se é "true" ou "false".

Recurso 2: [Fluxo de Trabalho] , Um gráfico mermaid ilustrando os desafios técnicos de construir um fluxo de trabalho de moderação completo. graph TD A[Usuário Envia Conteúdo] --> B{Chamar API de Moderação da OpenAI}; B --> C{Conteúdo Sinalizado?}; C -- Sim --> D[Lógica de Fluxo de Trabalho Personalizada]; D --> E[Bloquear Usuário]; D --> F[Escalar para Humano]; D --> G[Enviar Aviso]; C -- Não --> H[Conteúdo Aprovado];

subgraph Desafios direction LR I((Latência)) J((Regras Personalizadas)) K((Sobrecarga de Engenharia)) end D --> I; D --> J; D --> K;

Os desafios de construir um fluxo de trabalho de moderação completo

Fazer a chamada à API é fácil. A parte difícil é o que vem a seguir. A API de Moderação da OpenAI informa se o conteúdo é prejudicial, mas não diz o que fazer a respeito. Isso deixa sua equipe com alguns obstáculos a superar.

Você precisa construir a lógica do fluxo de trabalho. Você precisará escrever todo o código que decide o que acontece quando o conteúdo é sinalizado. O usuário deve ser bloqueado? O ticket deve ser escalado para um agente humano? Um aviso automatizado deve ser enviado? Cada uma dessas ações precisa ser construída de forma personalizada.

A latência pode ser um problema. Chamar outra API para cada mensagem pode deixar sua aplicação mais lenta. Para manter a experiência do usuário ágil, você pode precisar construir um sistema assíncrono que execute a verificação de moderação em segundo plano, o que adiciona outra camada de complexidade.

As regras personalizadas são por sua conta. As categorias da API são fixas. Se você precisa filtrar conteúdo com base nas diretrizes da sua própria marca (como evitar conversas políticas, solicitações de reembolso ou menções a concorrentes), você precisa construir um sistema totalmente separado para isso. Isso geralmente significa outra chamada de LLM, o que adiciona mais custo e sobrecarga de engenharia.

Preços da API de Moderação da OpenAI

Esta é a parte fácil. Uma das melhores coisas sobre a API de Moderação da OpenAI é o preço: é gratuita. De acordo com a página de preços oficial da OpenAI, os modelos "omni-moderation" não custam nada para usar.

Isso a torna uma escolha óbvia para projetos de qualquer tamanho, desde startups pequenas até grandes empresas. Embora algumas pessoas em fóruns da comunidade achem que ela deve ser usada em conjunto com outras APIs pagas da OpenAI, isso já cobre praticamente todo mundo que está construindo no ecossistema da OpenAI.

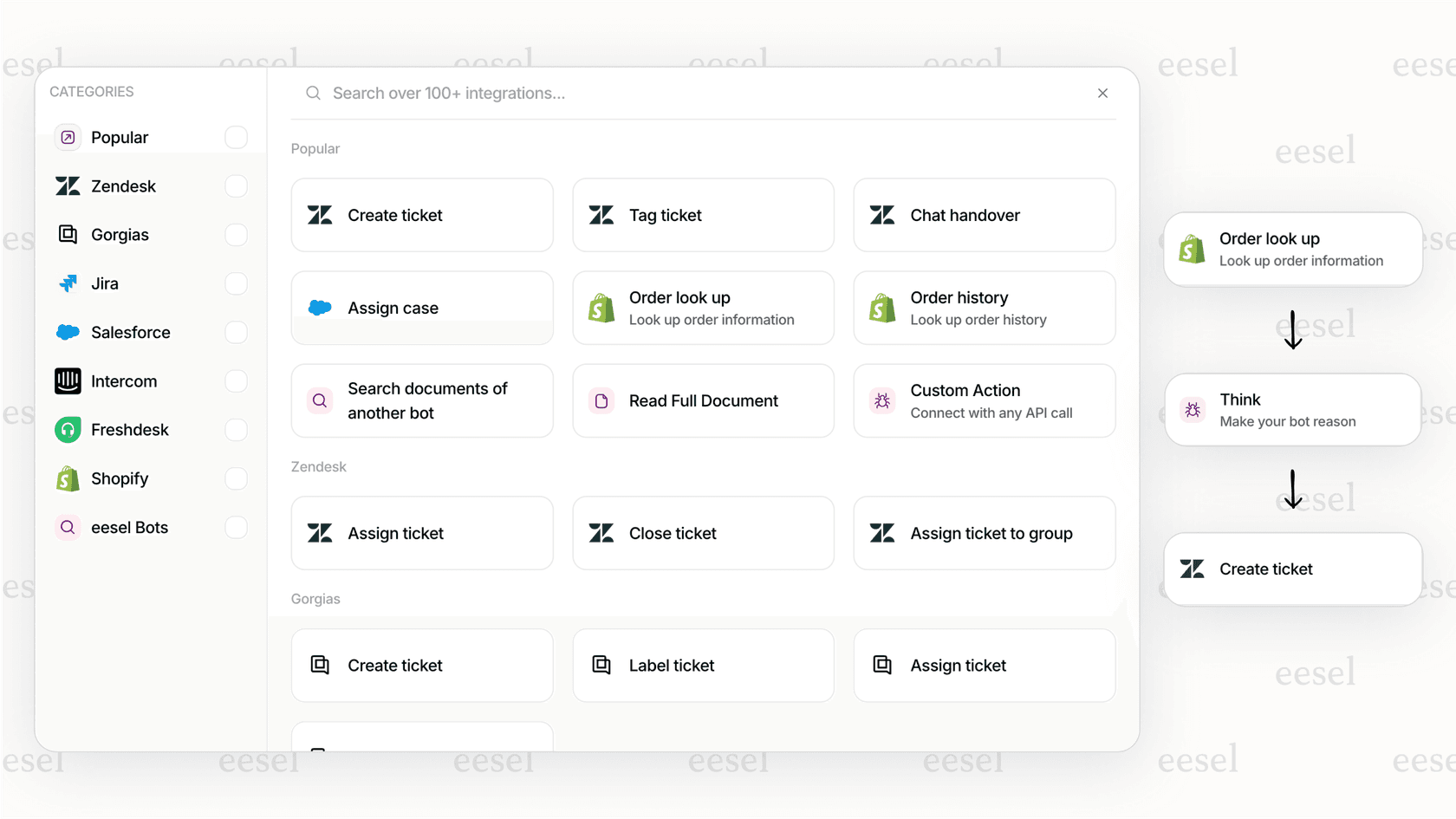

Além da API de Moderação da OpenAI: um fluxo de trabalho integrado de moderação e automação

A API gratuita é um ponto de partida fantástico, mas se você está gerenciando uma operação de suporte ao cliente no mundo real, você precisa de mais do que apenas uma sinalização de conteúdo. Você precisa de um sistema que conecte essa sinalização a uma ação imediata e inteligente. É aqui que uma plataforma dedicada de suporte com IA realmente faz a diferença.

Vá da detecção à resolução em minutos

Com uma abordagem "faça você mesmo", você precisa codificar cada passo do fluxo de trabalho. Uma plataforma como a eesel AI muda o jogo com lógica pré-construída e integrações de helpdesk com um clique para ferramentas que você já usa, como Zendesk ou Freshdesk.

Em vez de apenas identificar um problema, você pode agir instantaneamente. Por exemplo, você poderia configurar um agente da eesel AI para ver uma sinalização de moderação, parar imediatamente sua própria resposta e escalar automaticamente o ticket para um humano com uma tag de "revisão urgente". Você pode construir todo esse fluxo de trabalho em poucos minutos, sem tocar em uma única linha de código.

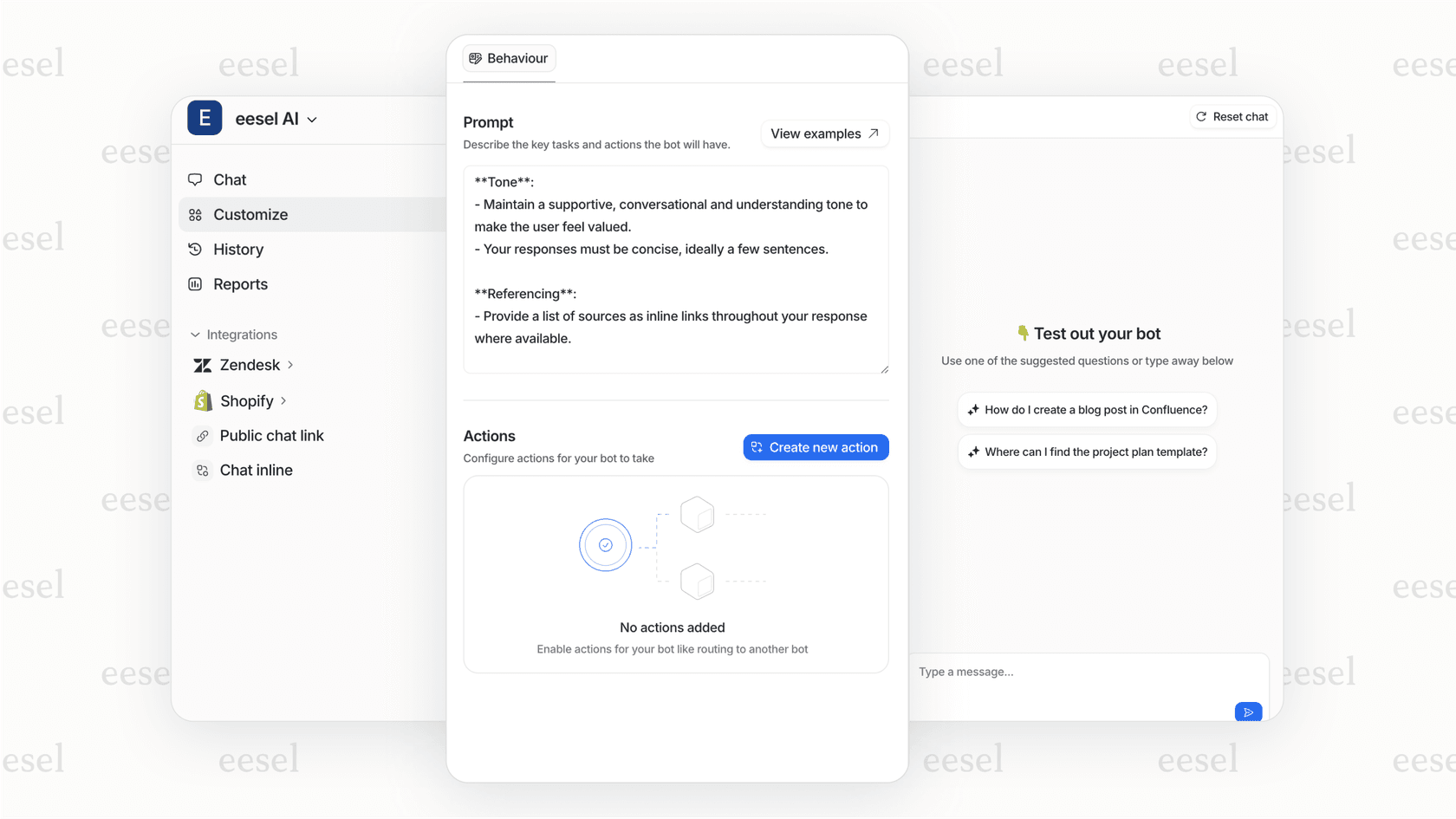

Combine segurança de conteúdo com regras de negócio personalizadas

As categorias fixas da API de Moderação da OpenAI não conseguem lidar com as regras específicas da sua marca. Uma plataforma integrada resolve isso fornecendo um mecanismo de fluxo de trabalho totalmente personalizável. Com o editor de prompts da eesel AI, você pode definir a personalidade da sua IA e adicionar regras de moderação personalizadas que vão muito além da rede de segurança padrão.

Uma marca de e-commerce, por exemplo, poderia usar a API de moderação padrão para bloquear conteúdo nocivo, enquanto também usa as instruções personalizadas da eesel AI para impedir que a IA faça promessas sobre prazos de entrega ou fale sobre concorrentes.

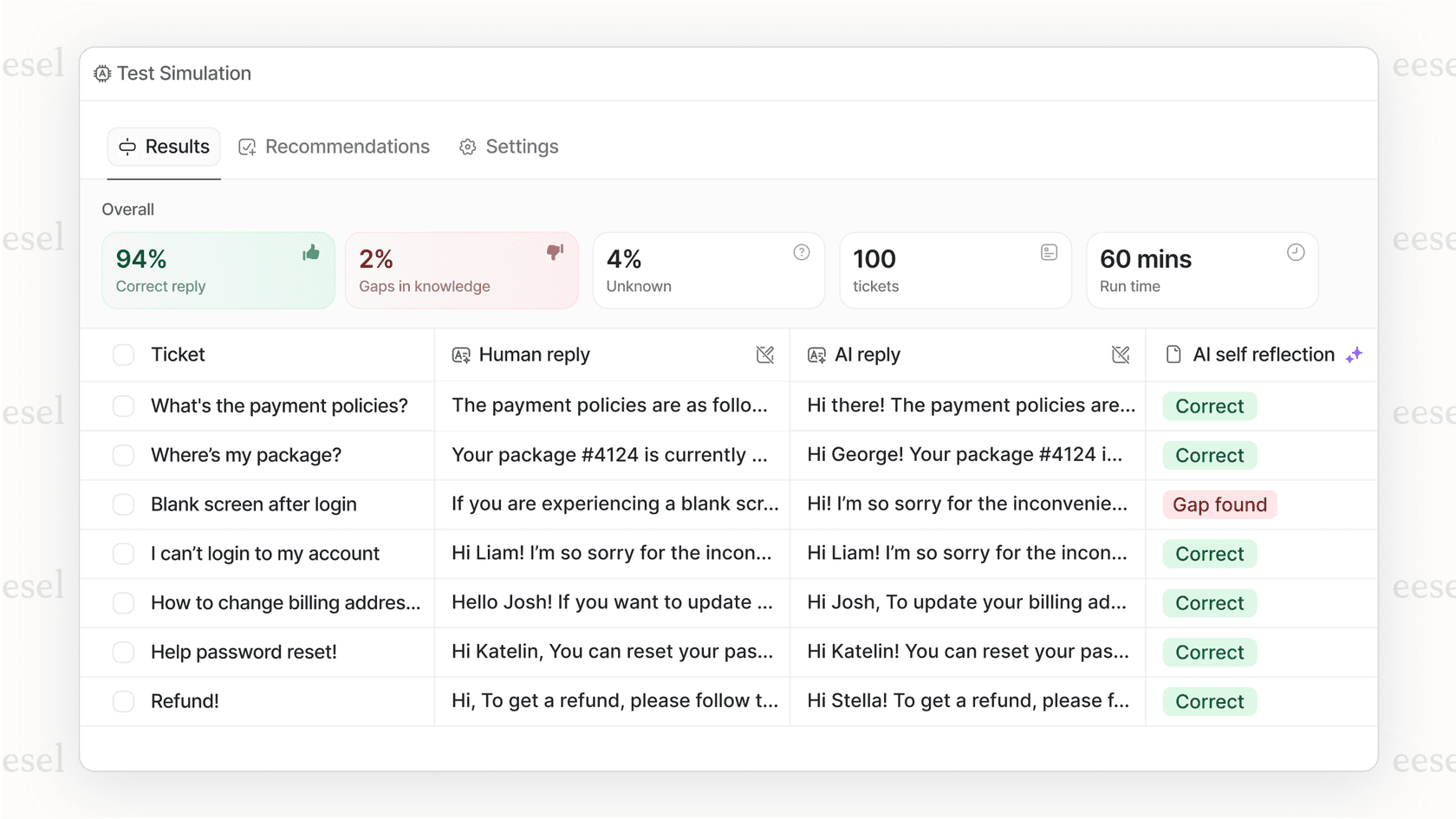

Simule e implante seu fluxo de trabalho com confiança

Lançar um sistema de moderação que você mesmo construiu pode parecer uma aposta. Seus limites são muito rigorosos, levando a falsos alarmes? Ou são muito frouxos, deixando conteúdo ruim passar?

eesel AI elimina as suposições com um poderoso modo de simulação. Antes de ir ao ar, você pode executar toda a sua configuração de automação e moderação em milhares de seus tickets de suporte anteriores. Isso lhe dá uma imagem clara de como sua IA se comportará em produção, para que você possa ajustar suas regras e implantar sabendo que funcionará como esperado.

Considerações finais sobre a API de Moderação da OpenAI

A API de Moderação da OpenAI é uma ferramenta fantástica. É gratuita, poderosa e uma excelente maneira de adicionar uma base de segurança de conteúdo a qualquer aplicativo que você esteja construindo. Com seu novo modelo multimodal, ela é mais útil do que nunca e definitivamente deveria estar no seu kit de ferramentas de desenvolvedor.

Mas sinalizar conteúdo é apenas o primeiro passo. O verdadeiro trabalho é transformar essa sinalização em um processo de negócios suave, confiável e personalizado. Construir esses fluxos de trabalho do zero é um trabalho pesado que requer muito tempo de engenharia, manutenção contínua e testes cuidadosos.

Para equipes que precisam se mover rapidamente sem cortar caminho, uma plataforma integrada como a eesel AI oferece o pacote completo. Ela combina o poder da moderação da OpenAI com um construtor de fluxo de trabalho sem código, integrações profundas e ferramentas de teste sólidas. Permite que você vá da simples detecção à automação completa em minutos, não em meses.

Construa fluxos de trabalho de suporte mais inteligentes e seguros com a eesel AI

Pronto para construir um sistema de suporte que não é apenas seguro, mas também inteligente e eficiente? Experimente a eesel AI gratuitamente e veja como é fácil automatizar seus fluxos de trabalho de suporte em minutos.

Perguntas frequentes

A API de Moderação da OpenAI é totalmente gratuita para uso em qualquer projeto?

Sim, de acordo com a página de preços oficial da OpenAI, os modelos "omni-moderation" são totalmente gratuitos. Isso torna a API de Moderação da OpenAI uma ferramenta altamente acessível para adicionar uma camada básica de segurança de conteúdo a aplicativos de qualquer tamanho.

Que tipos de conteúdo nocivo a API de Moderação da OpenAI pode detectar tanto em texto quanto em imagens?

O modelo "omni-moderation-latest" pode detectar violência, automutilação e conteúdo sexual tanto em texto quanto em imagens. Outras categorias como assédio, ódio e conteúdo ilícito são atualmente suportadas apenas para entradas de texto.

A API de Moderação da OpenAI pode ser usada como uma solução independente para moderação de conteúdo abrangente?

Embora a API de Moderação da OpenAI seja excelente para identificar conteúdo nocivo, ela principalmente sinaliza problemas sem fornecer lógica de fluxo de trabalho. Para um sistema de moderação completo que automatiza respostas ou escalonamentos, ela geralmente precisa ser integrada com soluções personalizadas adicionais ou uma plataforma de suporte com IA dedicada.

Qual é a precisão da API de Moderação da OpenAI, especialmente para conteúdo que não está em inglês?

O modelo "omni-moderation-latest" apresenta precisão aprimorada, incluindo uma melhoria de 42% em conjuntos de testes multilíngues em comparação com versões anteriores. Suas pontuações calibradas também fornecem uma indicação mais confiável de confiança para violações de políticas em diferentes idiomas.

Qual é a configuração inicial necessária para começar a usar a API de Moderação da OpenAI?

Para começar, você precisará de uma conta da OpenAI e de uma chave de API das configurações da sua organização. Com a chave em mãos, você pode enviar solicitações POST para o endpoint "/v1/moderations" com sua entrada de conteúdo e o modelo desejado.

A API de Moderação da OpenAI permite regras de moderação personalizadas adaptadas a necessidades de negócios específicas?

A API de Moderação da OpenAI fornece categorias de conteúdo predefinidas. Ela não suporta nativamente regras personalizadas e específicas da marca (por exemplo, bloquear menções de concorrentes ou políticas de produtos específicas). Integrá-la a uma plataforma que oferece um mecanismo de fluxo de trabalho personalizável, como a eesel AI, é necessário para tais requisitos sob medida.