Já perguntou a um chatbot de suporte uma pergunta simples, apenas para receber uma resposta tão espetacularmente errada que chega a ser engraçada? Talvez você tenha pedido um número de rastreamento e recebeu uma receita de pão de banana em vez disso. Ou tentou redefinir sua senha e o bot começou a escrever um haiku sobre sua própria alma digital. Todos nós já passamos por isso. É frustrante e faz você se perguntar se essa coisa toda de IA está realmente pronta para o horário nobre.

Então, vamos direto ao ponto: A IA pode cometer erros? Sim, absolutamente. Mas isso não é o fim da história. A verdadeira questão não é se a IA erra, mas por que ela erra e, mais importante, o que você pode fazer a respeito. Não se trata de perseguir uma IA "perfeita" que nunca erra. Trata-se de construir um sistema inteligente que espera erros, os lida graciosamente e permite que você automatize seu suporte com confiança.

Este guia irá explicar por que os erros de IA acontecem, o impacto real que eles podem ter no seu negócio e uma maneira prática de gerenciá-los para que você possa obter todos os benefícios da automação sem as dores de cabeça.

Então, a IA pode cometer erros?

Primeiro de tudo, quando uma IA comete um "erro", não é porque ficou preguiçosa ou teve um dia ruim. Modelos de IA, especialmente os grandes modelos de linguagem (LLMs) que alimentam os chatbots modernos, não "pensam" ou "entendem" como nós. Pense neles como máquinas de correspondência de padrões incrivelmente sofisticadas. Eles foram treinados em enormes quantidades de texto e dados, e seu principal trabalho é prever a sequência de palavras estatisticamente mais provável em resposta a um prompt.

Esse processo é o que os torna tão poderosos, mas também é por isso que eles erram. A IA está fazendo um palpite altamente educado, não afirmando um fato que sabe ser verdadeiro. E às vezes, esse palpite está simplesmente fora do alvo.

Os tipos mais comuns de erros de IA

Os erros de IA tendem a aparecer em algumas formas comuns, cada uma com sua própria causa.

- Alucinação de IA: Este é o grande que você provavelmente já ouviu falar. É quando uma IA confiantemente inventa coisas. Porque seu objetivo é fornecer uma resposta que soe plausível, às vezes ela inventa fatos, políticas ou fontes se não tiver a informação certa à mão. Um exemplo agora famoso é o advogado de Nova York que usou o ChatGPT para pesquisa jurídica e submeteu um documento citando casos judiciais completamente inventados. No mundo do suporte, é como o chatbot da Air Canada que inventou uma política de tarifa de luto, que um tribunal mais tarde obrigou a companhia aérea a honrar. Ai.

- Interpretar mal o que o usuário quer: Isso acontece quando a IA entende mal o objetivo real por trás da pergunta de um usuário. A linguagem humana é confusa e cheia de gírias, erros de digitação e ambiguidades. Embora a IA tenha melhorado muito em decifrá-la, ainda pode se confundir e dar uma resposta que é tecnicamente correta, mas totalmente inútil.

- Esquecer o histórico da conversa: Já teve que repetir seu número de pedido três vezes na mesma conversa com um bot? Isso é uma falha de contexto. A IA não está acompanhando a conversa, levando a essas interações desconectadas e repetitivas que fazem os clientes quererem arrancar os cabelos.

- Encontrar lacunas de conhecimento: Uma IA não pode responder a uma pergunta se a informação não estiver em seus dados de treinamento ou nas bases de conhecimento às quais está conectada. Isso pode levar a um direto "Eu não sei", ou pior, desencadear uma alucinação enquanto a IA tenta preencher as lacunas com o que acha que deveria estar lá.

Aqui está um resumo rápido de como esses erros se parecem em um ambiente de suporte:

| Tipo de Erro de IA | Como Parece | Exemplo |

|---|---|---|

| Alucinação | A IA inventa fatos, políticas ou fontes. | "Nosso chatbot disse a um cliente que ele poderia obter um reembolso com base em uma política que não existe." |

| Interpretação Errada | A IA entende errado o objetivo do usuário. | Um usuário pergunta "Posso rastrear meu pacote?" e a IA fornece uma lista de todos os serviços de envio. |

| Falha de Contexto | A IA esquece partes anteriores da conversa. | Usuário: "Preciso de um reembolso para o pedido #123." IA: "Claro, qual é o número do pedido?" |

| Lacuna de Conhecimento | A IA não tem a informação específica necessária. | Um cliente pergunta sobre um recurso novo, mas os documentos de ajuda ainda não foram atualizados. |

O custo real dos erros

Esses deslizes são mais do que apenas pequenos aborrecimentos; eles podem prejudicar seriamente o seu negócio. Quando você deixa os erros de IA correrem soltos, não está apenas arriscando um bate-papo ruim, está arriscando seu resultado final.

- Perda financeira: Como a Air Canada aprendeu da maneira mais difícil, você pode ser responsabilizado legal e financeiramente pelas informações erradas que sua IA fornece. Em um caso mais extremo, o algoritmo de compra e venda de imóveis da Zillow, alimentado por IA, fez a empresa perder mais de 300 milhões de dólares porque não conseguiu prever as oscilações do mercado. Um erro de IA não gerenciado pode custar diretamente dinheiro real.

- Danos à marca e frustração do cliente: Sua marca é construída com base na confiança e em boas experiências. Falhas de IA podem destruir isso em um instante. A empresa de entregas DPD teve que desligar seu chatbot depois que um cliente irritado conseguiu fazer com que ele começasse a xingar e escrever poemas zombando da empresa. Vídeos virais do drive-thru de IA do McDonald's errando pedidos se tornaram um pesadelo de relações públicas. Esses incidentes corroem a confiança do cliente e podem levar as pessoas a irem embora para sempre.

- Matando sua eficiência: O objetivo de automação de suporte é ser mais eficiente, certo? Mas quando uma IA falha, aquele ticket não simplesmente desaparece. Um agente humano tem que intervir, geralmente depois que o cliente já está irritado e o problema está mais complicado. Isso dobra o trabalho, aumenta os custos e derrota todo o propósito de automatizar em primeiro lugar.

Como construir um sistema de suporte resiliente

Você não pode impedir completamente que uma IA cometa um erro, mas pode absolutamente construir um sistema que contenha, gerencie e aprenda com eles. A chave não é uma IA impecável, mas uma configuração mais inteligente baseada em controle, teste e confiança.

O perigo da IA "caixa preta"

Muitas ferramentas de suporte de IA, especialmente aquelas integradas em helpdesks existentes, são rígidas e opacas. Você basicamente liga um interruptor e cruza os dedos. Você tem pouca visão sobre por que a IA faz o que faz e quase nenhuma maneira de testar ou controlar seu comportamento antes que ela comece a falar com seus clientes. Essa abordagem de "caixa preta" é uma grande aposta, e seus clientes são os que pagam o preço quando isso dá errado.

Estratégia 1: Simule antes de automatizar

Você não lançaria um novo produto sem testá-lo, então por que liberaria um agente de IA sem saber como ele irá se comportar? O passo mais importante para prevenir erros de IA é simular seu desempenho em um ambiente seguro e controlado primeiro.

Com um modo de simulação poderoso, como o do eesel AI, você pode testar sua configuração de IA em milhares de seus próprios tickets de suporte históricos. Antes que um único cliente interaja com seu bot, você pode:

- Obter previsões precisas e baseadas em dados sobre quantos tickets ele resolverá e quanto você economizará.

- Ver as respostas exatas que a IA teria dado a perguntas reais de clientes.

- Identificar grandes lacunas em sua base de conhecimento que você precisa preencher.

Ao contrário de ferramentas que apenas oferecem uma demonstração genérica, uma simulação adequada fornece os dados do mundo real que você precisa para lançar com confiança, sabendo exatamente como sua IA irá agir.

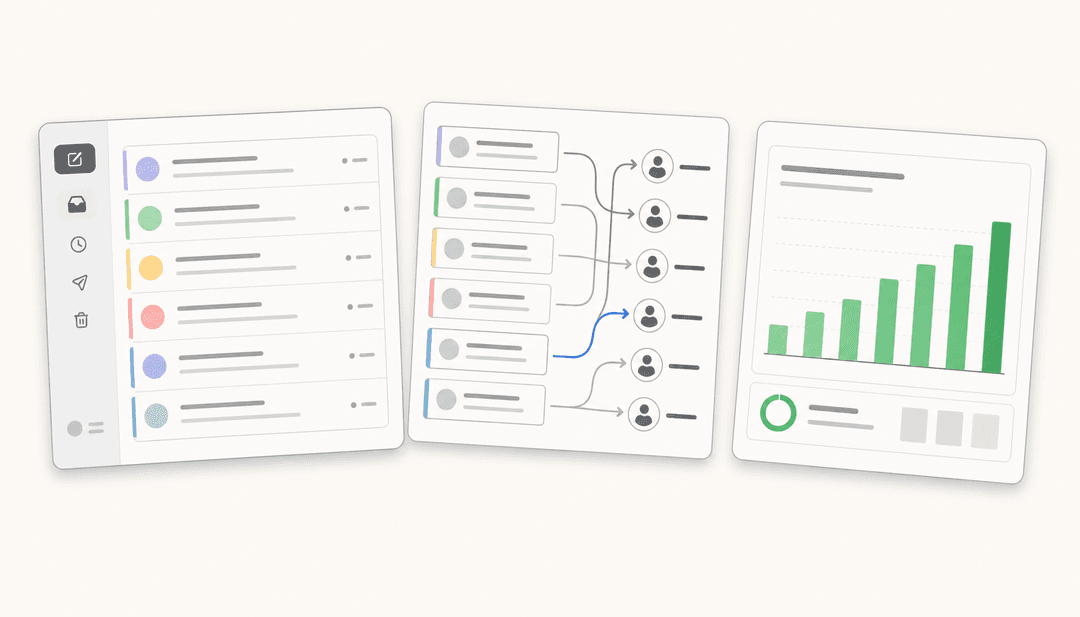

Estratégia 2: Mantenha o controle sobre o que é automatizado

Um dos maiores medos com a IA é que ela "saia do controle" e comece a tentar lidar com coisas para as quais não está pronta. A solução é um sistema que lhe dá controle total sobre o que é automatizado e o que é enviado para um humano.

Uma plataforma de IA com um motor de fluxo de trabalho totalmente personalizável, como o eesel AI, coloca você no controle.

- Seja seletivo com a automação: Você pode escolher exatamente quais tipos de tickets a IA irá lidar. Você pode começar pequeno, automatizando solicitações simples e frequentes como "redefinição de senha" ou "status do pedido", enquanto garante que todas as questões complexas ou sensíveis vão direto para seus especialistas humanos.

- Implemente gradualmente: Você não precisa ir com tudo de uma vez. Você pode ativar a IA para um canal específico, um certo tipo de cliente ou apenas uma pequena porcentagem de tickets. À medida que vê bons resultados e constrói confiança, pode expandir lentamente suas funções.

- Personalize suas ações e prompts: Você pode definir exatamente o que a IA está autorizada a fazer. Vá além de respostas simples, permitindo que ela execute ações como escalar um ticket, adicionar uma tag ou procurar informações de pedido. Você também pode ajustar seu tom e persona para garantir que ela sempre soe como sua marca.

Essa abordagem cuidadosa e passo a passo pode ser visualizada assim:

Estratégia 3: Unifique seu conhecimento para respostas melhores

Lembra do problema das "lacunas de conhecimento"? Uma IA é tão inteligente quanto a informação que pode acessar. Se seu conhecimento for irregular, suas respostas também serão.

Os melhores agentes de IA resolvem isso extraindo de todo o conhecimento da sua empresa, não apenas de um centro de ajuda. É aqui que uma ferramenta como o eesel AI realmente faz a diferença.

- Treine em tickets passados: Seus melhores dados de treinamento são seu próprio histórico de suporte. O eesel AI aprende automaticamente com as melhores respostas da sua equipe em tickets passados, para que entenda o contexto do seu negócio, a voz da sua marca e soluções comprovadas desde o início.

- Conecte todas as suas fontes: Muitas ferramentas de IA são limitadas a um único centro de ajuda, deixando-as cegas para informações importantes armazenadas em outros lugares. Uma IA verdadeiramente útil precisa de acesso a tudo o que seus especialistas humanos usam. O eesel AI se conecta com seu centro de ajuda, mas também com wikis internos como Confluence e Notion, Google Docs compartilhados e até conversas no Slack. Isso cria uma fonte única de verdade, dando à sua IA a visão completa para que possa responder a perguntas com muito mais precisão.

Estratégia 4: Adicione guardrails e alternativas seguras

Mesmo o melhor sistema de IA precisa de uma rede de segurança. Guardrails garantem que sua automação permaneça dentro dos limites e não assuma tarefas para as quais não está pronta. Em vez de deixar a IA adivinhar seu caminho através de uma situação complicada, você quer uma configuração que saiba quando recuar.

Com uma plataforma como o eesel AI, isso se resume a três coisas. Primeiro, a IA pode recuar graciosamente quando não tem a informação certa. Em vez de inventar algo, ela ou entrega a conversa a um agente humano ou responde com um simples "Ainda não tenho essa resposta, mas deixe-me conectá-lo à pessoa certa." Em segundo lugar, você pode criar regras de escalonamento para questões sensíveis. Nem todas as consultas devem ser automatizadas, e tópicos como disputas de folha de pagamento ou qualquer coisa envolvendo dados privados devem sempre ser encaminhados a um especialista humano. Finalmente, o eesel AI mantém a IA contida nas fontes de conhecimento da sua empresa. Como nunca puxa da internet aberta, você evita o risco de respostas alucinadas que vêm de conteúdo não confiável ou não relacionado.

Esses guardrails ajudam a construir confiança. Eles dão aos seus clientes a confiança de que sempre receberão uma resposta segura e precisa, enquanto sua equipe tem a tranquilidade de saber que a IA não sairá dos trilhos.

A IA pode cometer erros? Sim. Aqui está um plano de 4 etapas para lançar um agente à prova de erros

Começar com um agente de IA seguro e confiável não precisa ser um projeto massivo e demorado. Com uma plataforma construída para simplicidade e controle, você pode começar a funcionar com total tranquilidade.

- Conecte suas ferramentas: Use integrações de um clique para vincular seu helpdesk (como Zendesk ou Freshdesk) e bases de conhecimento. Você pode estar pronto para começar em apenas alguns minutos.

- Defina suas regras: Use um construtor de fluxo de trabalho simples e visual para decidir exatamente quais conversas a IA irá lidar e o que está autorizada a fazer.

- Simule e teste: Execute sua configuração contra milhares de seus tickets passados para verificar seu desempenho, ver seu ROI potencial e fazer ajustes antes de entrar em operação.

- Entre em operação com confiança: Ative sua IA em um pequeno lote de tickets. Observe os resultados e, à medida que constrói confiança, pode gradualmente deixá-la lidar com mais.

Abraçando e gerenciando erros de IA

Então, voltando à grande questão: A IA pode cometer erros? Com certeza. É apenas parte de como a tecnologia funciona, é tudo sobre probabilidades, não compreensão genuína.

Mas simplesmente lançar uma IA e torcer pelo melhor é uma receita para o desastre. Você acabará com clientes frustrados, uma marca danificada e mais caos para sua equipe. O segredo para uma ótima automação de suporte não é encontrar uma IA "perfeita" que nunca erra. É escolher uma plataforma que lhe dê as ferramentas para gerenciar e minimizar esses erros desde o primeiro dia.

Testando primeiro, mantendo o controle e dando à sua IA acesso a todo o seu conhecimento, você pode passar de esperar que sua IA funcione para saber que ela funcionará. É assim que as equipes finalmente aproveitam o verdadeiro poder da IA, dando aos clientes respostas mais rápidas e liberando agentes para se concentrarem nos problemas onde são mais necessários.

Pronto para implantar um agente de suporte de IA em que você realmente pode confiar? O eesel AI oferece as ferramentas de simulação e controles detalhados para automatizar com confiança. Comece seu teste gratuito hoje.

Perguntas frequentes

Mesmo com uma base de conhecimento completa, a IA pode cometer erros ao alucinar e inventar políticas?

Sim, isso ainda é possível, pois as alucinações são inerentes ao funcionamento dos LLMs. Você pode reduzir significativamente esse risco usando uma IA que esteja fundamentada em suas fontes de conhecimento específicas e estabelecendo regras rígidas que limitem sua capacidade de ser criativa.

Estou preocupado com o risco financeiro. Se a IA pode cometer erros e prometer algo a um cliente que não podemos cumprir, somos responsáveis?

Sim, você pode ser responsabilizado, como visto no caso da Air Canada. A melhor prevenção é ter controles e fluxos de trabalho rigorosos que impeçam a IA de lidar com tópicos sensíveis como reembolsos ou exceções de política, garantindo que esses sempre sejam direcionados a um humano.

Então, se a IA cometer erros, isso não cria mais trabalho para meus agentes humanos que têm que limpar a bagunça?

Pode acontecer se não for gerenciado adequadamente. Um sistema bem projetado evita isso começando com uma alta taxa de precisão (verificada por simulação) e garantindo que a IA só lide com perguntas sobre as quais está muito confiante, encaminhando tudo o mais para a equipe certa.

Já que sabemos que a IA pode cometer erros, o sistema pelo menos pode aprender com esses erros para melhorar ao longo do tempo?

Absolutamente. Uma boa plataforma de suporte de IA deve incluir ciclos de feedback onde agentes humanos possam corrigir facilmente os erros da IA. Esse feedback é então usado para retreinar o modelo, melhorando sua precisão e evitando que cometa o mesmo erro novamente.

Sabemos que a IA pode cometer erros, mas como podemos prever com que frequência nosso bot específico errará antes de deixá-lo falar com os clientes?

A melhor maneira é usar um recurso de simulação. Testando sua IA em milhares de seus tickets de suporte passados em um ambiente seguro, você pode obter um relatório baseado em dados sobre sua precisão e ver exatamente onde ela pode ter dificuldades antes de entrar em operação.

Dado que a IA pode cometer erros é uma realidade, qual é o passo mais importante para proteger a reputação da nossa marca quando começamos a automatizar?

Comece pequeno e mantenha o controle. Configure sua IA para lidar apenas com um escopo restrito de perguntas simples e repetitivas no início, e estabeleça regras claras para escalar automaticamente questões mais complexas ou sensíveis diretamente para um agente humano.