誰にでも経験があるでしょう。ゲームに夢中になっていると、NPCが10回目も同じセリフを繰り返す。それで一気に現実に引き戻されてしまいますよね。長年、ゲーム開発の目標は、NPCをロボットのようにではなく、よりリアルで反応的なキャラクターに感じさせることでした。プレイヤーが何をしたかを記憶し、世界に反応し、まともな会話ができるようなキャラクターです。

GPT-Realtime-Miniのようなモデルを使えば、その目標はぐっと近づきます。この種のAIをUnityのようなゲームエンジンに接続することで、ゲーム体験は大きく変わる可能性があります。

このガイドでは、「GPT-Realtime-MiniとUnityの連携」について実践的な視点から解説します。この技術が何であるか、いくつかの実装方法、そして必ず考慮しなければならないコストや遅延といった大きなハードルについて取り上げます。

UnityとGPT-Realtime-Miniとは?

この2つを連携させる具体的な話に入る前に、それぞれが何であるかを簡単におさらいしましょう。

Unityの概要

Unityは非常に人気のあるクロスプラットフォームのゲームエンジンです。小規模なインディープロジェクトから大規模な商業ヒット作まで、数え切れないほどのゲームの原動力となっています。2Dと3Dの両方のゲームに対応できる柔軟性で知られ、主なスクリプト言語はC#です。ここ10年でインディーゲームをプレイしたことがあるなら、それがUnityで作られていた可能性はかなり高いでしょう。

GPT-Realtime-Miniの理解

GPT-Realtime-Miniは、OpenAIのモデルの一つで、高速な対話型インタラクションという特定の目的のために作られました。これは、通常の会話のような素早いやり取りのために設計されたAIモデルファミリーの一部です。以下がその特徴です。

-

音声向けに作られている:このAPIは、チャットボックスでのタイピングだけでなく、音声入力・音声出力の会話を前提にゼロから設計されています。

-

ペースを維持:素早く応答するように作られています。これにより、AIとのチャットを不自然でぎこちなく感じさせる、あの気まずい間をなくすことができます。

-

より効率的:「ミニ」モデルとして、賢さと手頃な価格のバランスを取ろうとしています。これにより、GPT-4のようなより大きく、遅いモデルと比較して、リアルタイムでの使用においてより現実的な選択肢となります。

なぜゲームでGPT-Realtime-MiniとUnityを連携させるのか?

では、「GPT-Realtime-MiniとUnityの連携」を設定する手間をかける価値はあるのでしょうか?多くのゲームデザイナーにとって、その答えは大きな「イエス」です。これは単にクールな技術というだけでなく、私たちが慣れ親しんだ古くて硬直したシステムから脱却することなのです。

真にダイナミックなNPCの創造

ほとんどのゲームキャラクターは、事前に書かれた会話ツリーに縛られています。選択肢をクリックするとセリフを言い、そのループが繰り返されます。リアルタイムAIは、その常識を覆します。NPCにゲーム内で起きていることの情報を絶えず与えることで、その場で反応させることができます。

例えば、あるNPCがゲームのイベントログにアクセスできるとします。もし「がに30ダメージを与えた」という新しい行が現れたら、NPCはユニークな反応を生成できます。ありきたりな「やめろ!」ではなく、「おい、あの可哀想な牛がお前に何をしたって言うんだ?」と実際に言うかもしれません。これは小さなことですが、世界が本当にプレイヤーに注意を払っているように感じさせます。

自然な音声会話の実現

ここで最もクールな可能性の一つは、キャラクターに話しかけるだけで、知的でユニークな返答が返ってくることです。GPT Realtime APIは、このために作られています。プレイヤーはもはやメニューオプションをスクロールする必要はありません。普通の音声による会話ができ、それによってゲームへの没入感が格段に高まります。

適応型ストーリーテリングの強化

この技術は、個々のキャラクターをはるかに超えることができます。AIが一種の「ダンジョンマスター」やゲーム全体のアダプティブなナレーターとして機能することも可能です。プレイヤーの行動を監視し、新しい挑戦を生成したり、シーンの描写を変えたり、プレイヤーの選択に基づいてストーリーを変更したりできます。これにより、すべてのプレイスルーが真に異なるものとなり、事前に書かれた脚本では決して真似できない方法でプレイヤーによって形作られます。

GPT-Realtime-MiniとUnityを連携させるための主要な方法

AIキャラクターと話すというアイデアはクールですが、実際にどうやって作るのでしょうか?問題は細部にあります。「GPT-Realtime-MiniとUnityの連携」に取り組む方法はいくつかあり、それぞれに特有の課題と利点があります。

手動アプローチ:C#での直接的なAPIコール

最も直接的な方法は、Unityの組み込みツール(HttpClientやUnityWebRequestなど)を使って、OpenAI APIに直接リクエストを送信することです。この方法を示すチュートリアルやStack Overflowの回答はたくさん見つかります。これには、独自のJSONリクエストを作成し、認証ヘッダーを追加し、送信し、返ってきたJSONレスポンスを解析する作業が含まれます。

このアプローチは完全なコントロールを可能にするため、素晴らしいです。しかし、欠点もあります。標準的なHTTPリクエストは、リアルタイムの音声チャットには遅すぎることが多いのです。その往復時間が顕著なラグを生み出し、自然な会話の感覚を完全に台無しにしてしまいます。

合理化されたアプローチ:Unityパッケージの使用

時間を節約するために、コミュニティは人気の「com.openai.unity」パッケージのような優れたラッパーライブラリを作成しています。これらのツールは、認証やリクエストのフォーマットといった面倒な作業の多くを処理してくれるので、ゲームのロジックに集中できます。

しかし、落とし穴があります。これらのパッケージの多くは、元々テキストベースのチャット用に作られており、リアルタイム音声に必要な専門的なプロトコル用ではありません。Realtime APIをサポートしているかもしれませんが、GPT-Realtime-Miniのようなモデルを魅力的にする低遅延ストリーミングには最適化されていない可能性があります。

低遅延アプローチ:WebRTCとWebSocketを介した接続

GPT-Realtime-Miniが持つキビキビとしたパフォーマンスを求めるなら、リアルタイム通信用に作られたプロトコルを使用する必要があります。公式のOpenAIドキュメントとMicrosoftのAzureガイドは、WebRTCまたはWebSocketの使用を推奨しています。

リクエストを送信してレスポンスを待つ代わりに、これらのプロトコルはゲームとAIの間に持続的な双方向接続を開きます。これにより、音声データを小さく連続したチャンクでやり取りでき、全体の体験がはるかにスムーズに感じられます。

ここでのハードルは、これを設定するのが本格的なエンジニアリング作業であることです。接続を管理し、必要なクライアントトークンを安全に作成するためだけに、中間サーバーが必要になる可能性があります。これは、多くの個人開発者やインディー開発者にとっては手の届かないレベルの複雑さです。

GPT-Realtime-MiniとUnityの連携における最大の課題

さて、現実的な話です。これを機能させるのは、単にコードを書くだけではありません。Redditのr/Unity3Dのスレッドを閲覧したことがある人なら誰でも知っているように、プロジェクトを頓挫させかねない大きな実践的な問題がいくつかあります。

高騰するAPIコスト

これが最大の問題です。NPCが考えたりセリフを言ったりするたびにAPIコールが発生し、そのコールにはすべて費用がかかります。何千人ものプレイヤーが何十人ものNPCとチャットする人気ゲームを想像してみてください。請求額はあっという間に手に負えなくなる可能性があります。

つまり、最初からコストを最適化する方法を賢く考えなければなりません。APIコールの回数を制限する方法、可能な限り最も効率的なモデルを使用する方法を検討し、いつか強力なモデルがローカルで実行できるようになることを祈る必要があるかもしれません。今のところ、コストは巨大な障壁です。

コンテキストと知識の管理

AIは、与えられた情報と同じくらいしか賢くなりません。NPCが信憑性を持つためには、何が起こったかの「記憶」と、周囲の状況に対する「認識」が必要です。問題は、すべてを遅くすることなく、その情報をどうやって与えるかです。

リクエストのたびにゲームの全履歴を送信することはできません。信じられないほど遅く、高価になります。その瞬間に最も関連性の高い情報だけを特定して引き出すことができる、賢い「記憶」システムが必要です。これは、生成的エージェントなどのトピックに関する論文で見られるように、研究者がまだ解決しようと取り組んでいる難しい問題です。

制御と予測可能性の確保

大規模言語モデルは本質的に予測不可能です。NPCが誤ってクエストのネタバレをしたり、キャラクターを崩壊させたり、ゲームをクラッシュさせるようなことをしたりするのをどうやって防ぐのでしょうか?適切なガードレールを設定しないと、プレイヤーにとって混沌としてイライラする体験になってしまう可能性があります。

これを解決するには、堅牢なワークフローエンジンが必要です。AIの性格を定義し、何ができて何ができないかについての厳格なルールを与え、「moveTo(x,y)」や「attack(target)」のような、実行を許可されたアクションの明確なリストを提供する必要があります。

エンタープライズAIからの教訓

これらの問題は新しいものではありません。カスタマーサポート業界は、コスト、コンテキスト、制御という全く同じ問題に何年も取り組んできました。彼らが考え出した解決策は、複雑なAIシステムを構築しようとする人にとって有用な指針となり得ます。

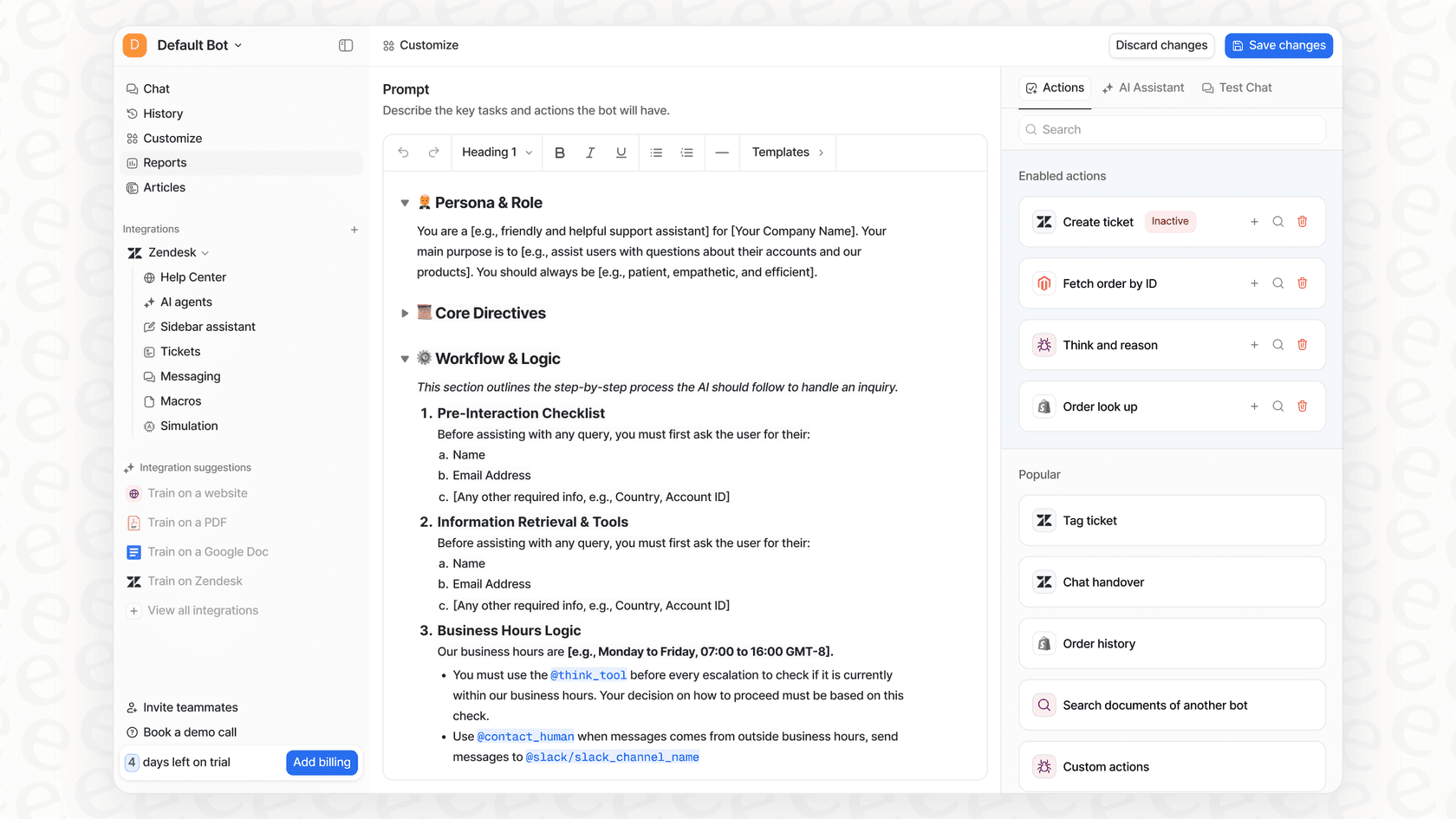

eesel AIのようなプラットフォームは、サポートチームのためにこれらの問題を処理するために特別に構築されました。

- 統一された知識: コンテキストの問題を解決するために、eeselはヘルプセンターや社内ドキュメントなど、企業の知識ソースに接続します。これにより、AIは問い合わせに必要な適切な情報だけにアクセスでき、関連性を保ち、コスト効率を高めます。

- カスタマイズ可能なワークフロー: 制御の問題を解決するために、eeselにはシンプルなワークフローエンジンがあります。AIのペルソナ、チケットをエスカレーションするタイミング、注文状況の確認などのカスタムアクションを定義できます。

- シミュレーションと段階的な展開: 壊れたシステムを展開するのを避けるために、eeselでは、AIが実際の人物と話す前に、何千もの過去の顧客との会話でテストすることができます。これにより、AIがどのように機能するかを明確に把握でき、不快な驚きがなくなります。

GPT-Realtime-MiniとUnityの連携の未来

というわけで、「GPT-Realtime-MiniとUnityの連携」は本当にエキサイティングです。この技術は、私たちが長年語り続けてきたような、ダイナミックで生き生きとしたゲームの世界につながる可能性があります。技術は進化しており、創造的なアイデアも次々と生まれています。

しかし、現実的に言えば、これは単純なプラグアンドプレイのソリューションではありません。コスト、低遅延を実現するための技術的な難しさ、そしてAIを制御するためのシステムの絶対的な必要性といった課題は、深刻なハードルです。

覚えておくべき最も重要なことは、単にAPIを呼び出しているだけではないということです。それを有用で、予測可能で、手頃な価格に保つために、その周りにシステム全体を構築しているのです。ゲームのためにそのようなシステムを構築するのは大規模なプロジェクトですが、同じ原則は顧客および社内サポートにも適用できます。

もし、サポートチームのために強力で、制御可能で、管理しやすいAIを構築したいのであれば、eesel AIが数ヶ月ではなく数分で稼働させられるソリューションをどのように提供しているかをご覧ください。

よくある質問

APIコストはかなりの額になる可能性があります。AIとの各インタラクションで料金が発生するためです。多くのプレイヤーとNPCを抱える人気ゲームでは、費用が急速に膨れ上がる可能性があり、最初からコスト最適化が重要な考慮事項となります。

最適なリアルタイムパフォーマンスを得るには、WebRTCやWebSocketのようなプロトコルを使用する必要があります。これらは持続的な双方向接続を確立し、音声データの連続ストリーミングを可能にし、標準的なHTTPリクエストで見られる顕著な遅延を最小限に抑えます。

真の低遅延連携を実装するのは、かなりのエンジニアリング作業であり、多くの場合、接続とトークンを管理するための中間サーバーが必要になります。直接的なAPIコールや既存のUnityパッケージは一部の側面を簡素化できますが、要求の厳しいリアルタイム要件には最適化されていない可能性があります。

AIの周りに堅牢なワークフローエンジンを構築することが重要です。これには、特定のペルソナを定義し、行動に関する厳格なルールを設定し、AIがゲーム環境内で実行を許可されたアクションの制御されたリストを提供することが含まれます。

コンテキストの管理には、特定のインタラクションに対してゲームの履歴や環境から最も関連性の高い情報のみを動的に抽出して提供できる、賢い「記憶」システムが必要です。リクエストのたびにゲームログ全体を送信すると、遅すぎてコストもかかりすぎます。

コミュニティが提供する「com.openai.unity」のようなUnityパッケージを使用したり、直接「HttpClient」コールを行ったりすることから始めることができます。これらは最適化されたリアルタイム音声ストリーミングを提供しないかもしれませんが、APIを理解し、基本的なテキストベースのインタラクションを統合するための良い基盤となります。

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.