OpenAIのモデルで何かを構築している場合、一度だけ求めていることがあるのではないでしょうか。それは、AIが同じ答えを2回提供することです。予測可能で反復可能な出力を得ることは、テスト、品質管理、そして単に一貫性のないユーザーエクスペリエンスを提供しないために非常に重要です。OpenAIは、より決定論的なAI応答を得る方法を約束し、これを支援するために「シード(seed)」パラメータと「system_fingerprint」を提供しました。

問題は、多くの開発者がこれらのツールが宣伝どおりに機能しないことに気づいていることです。その結果、多くの場合、不満と非常に予測不可能なAIの動作が発生します。このガイドでは、OpenAIシステムフィンガープリントとは何か、なぜそれが重要であると考えられているのか、そしてそれを使用することのフラストレーションの原因となる現実を掘り下げて説明します。さらに重要なことに、その下にあるツールが少し不安定な場合でも、信頼性の高いAIエージェントを構築およびデプロイするためのより良い方法を説明します。

OpenAIシステムフィンガープリントとは?

OpenAIシステムフィンガープリントは、基本的にOpenAIが応答を生成するために使用した特定のバックエンド設定の一意のIDです。モデルのバージョン番号というよりは、その瞬間に実行されているシステム全体のバージョン番号と考えてください。OpenAI自身のドキュメントによると、これは「シード(seed)」パラメータと組み合わせて使用することを目的としています。

基本的な考え方は次のとおりです。

-

プロンプト(Prompt): これは、モデルに与える入力です。

-

シード(Seed): これは、モデルにランダムなプロセスを開始するための開始点を与えるために選択する単なる数値です。理論的には、同じシードを使用すると、毎回同じ場所から開始されるはずです。

-

システムフィンガープリント(System Fingerprint): これは、OpenAIがあなたに送り返すコードです。これは、基盤となるハードウェアおよびソフトウェア構成が変更されていないことを確認することを目的としています。

同じプロンプトと、同じシードでAPI呼び出しを行い、同じシステムフィンガープリントが返された場合、同じ出力が得られるはずです。これが、"再現可能な出力"の背後にあるすべての魔法です。

OpenAIシステムフィンガープリントの約束: 一貫したAI応答が重要な理由

特にカスタマーサポートなど、AIを日常業務に組み込んでいる企業にとって、予測不可能なモデルは単なる奇妙な機能ではありません。それは本当のリスクです。同じ質問に対して同じ答えを得る能力は、いくつかの重要な理由で不可欠です。

確実なテストとQA

AIに顧客と会話させるつもりなら、徹底的にテストできる必要があります。再現可能な出力により、安定したベースラインを設定できます。目にする変更が、モデルが何か違うことを言いたくなったからではなく、あなたの調整(新しいプロンプトや更新されたナレッジソースなど)によるものであることを知って、テストを何度も実行できます。それがなければ、動いているターゲットを攻撃しようとしていることになり、実際に物事を改善しているかどうかを知ることはほとんど不可能です。

一貫した顧客体験

これを想像してみてください。顧客が簡単な質問をし、答えを受け取り、1時間後にまったく同じ質問をすると、完全に異なる回答が得られます。そのようなことは信頼を損ない、混乱を招きます。決定論的なAIは、特定の質問が毎回特定の回答を得ることを保証します。これは、企業の方針、事実情報、またはステップバイステップガイドのようなものにとっては交渉の余地がありません。

より簡単なデバッグと修正

AIが奇妙な、または単に間違った答えを出した場合、あなたのチームは飛び込んでその理由を突き止めなければなりません。問題を再現しようとするたびに出力が変わる場合、デバッグは完全な悪夢になります。毎回同じ間違った答えを得ることができる場合、チームは正確な問題を特定し、出力を分析して、問題の原因となっているプロンプトまたはナレッジベースを修正する方法を理解できます。

現実: OpenAIシステムフィンガープリントが的外れなことが多いのはなぜか

「シード(seed)」と「system_fingerprint」の背後にあるロジックは理にかなっていますが、実際に使用してみると多くの人ががっかりしています。OpenAIコミュニティフォーラムを見て回ると、他のすべての設定がロックダウンされている場合でも、システムフィンガープリントが常に、そして警告なしに変更されることを報告している開発者がたくさんいることがわかります。

あるユーザーは、100回の試行で実験を行い、「gpt-4-turbo」モデルが4つの異なるフィンガープリントを返したことを発見しました。それらのいずれも、大多数の時間に表示されませんでした。

この不安定さは、この機能の目的全体をほとんど打ち負かします。安定した結果を保証することになっているものが不安定である場合、一貫した出力を得るためにそれを本当に当てにすることはできません。

OpenAIシステムフィンガープリントの不安定さの原因は何ですか?

OpenAIは、バックエンドシステムを更新すると、フィンガープリントが変更される可能性があると述べています。それは当然ですが、これらの変更は誰もが予想していたよりもはるかに頻繁に発生しているようです。APIリクエストが異なるサーバー設定に送信されているか、小規模で発表されていない調整が常に展開されている可能性があることを示唆しています。

最終的な結果は、固定シードを使用しても、数分しか離れていない同じプロンプトに対して異なる答えを得ることができるということです。これにより、企業が必要とする種類の信頼性が高く、テスト可能なAIワークフローを構築することが非常に困難になります。揺れ動く砂の上に家を建てないように、予測不可能な基盤の上に堅牢なサポート自動化システムを構築することはできません。

信頼性の低いOpenAIシステムフィンガープリントのビジネスへの影響

OpenAIシステムフィンガープリントが期待どおりに機能しない場合、それは現実世界の結果をもたらします。

-

開発者の時間の浪費: チームは、制御できないバックエンドの変更によって実際に引き起こされる「一貫性のない」AIの動作をデバッグしようとして、何時間も費やす可能性があります。

-

デプロイの信頼性の欠如: 今日テストしたのと同じように明日AIが動作するかどうか確信できない場合、サポートチケットの30%を自動化することにどう満足できますか?

-

歪んだ分析: パフォーマンスの安定したベースラインを確立することさえできない場合、AIのROIや改善の影響を測定することは不可能です。

ここで戦略を変更する必要があります。提供できないツールから完璧な一貫性を求めて戦うのではなく、モデルの自然な変動に対応してテストおよびデプロイできる堅牢なプラットフォームが必要です。

より良いアプローチ: シミュレーションを使用して自信を持ってテスト

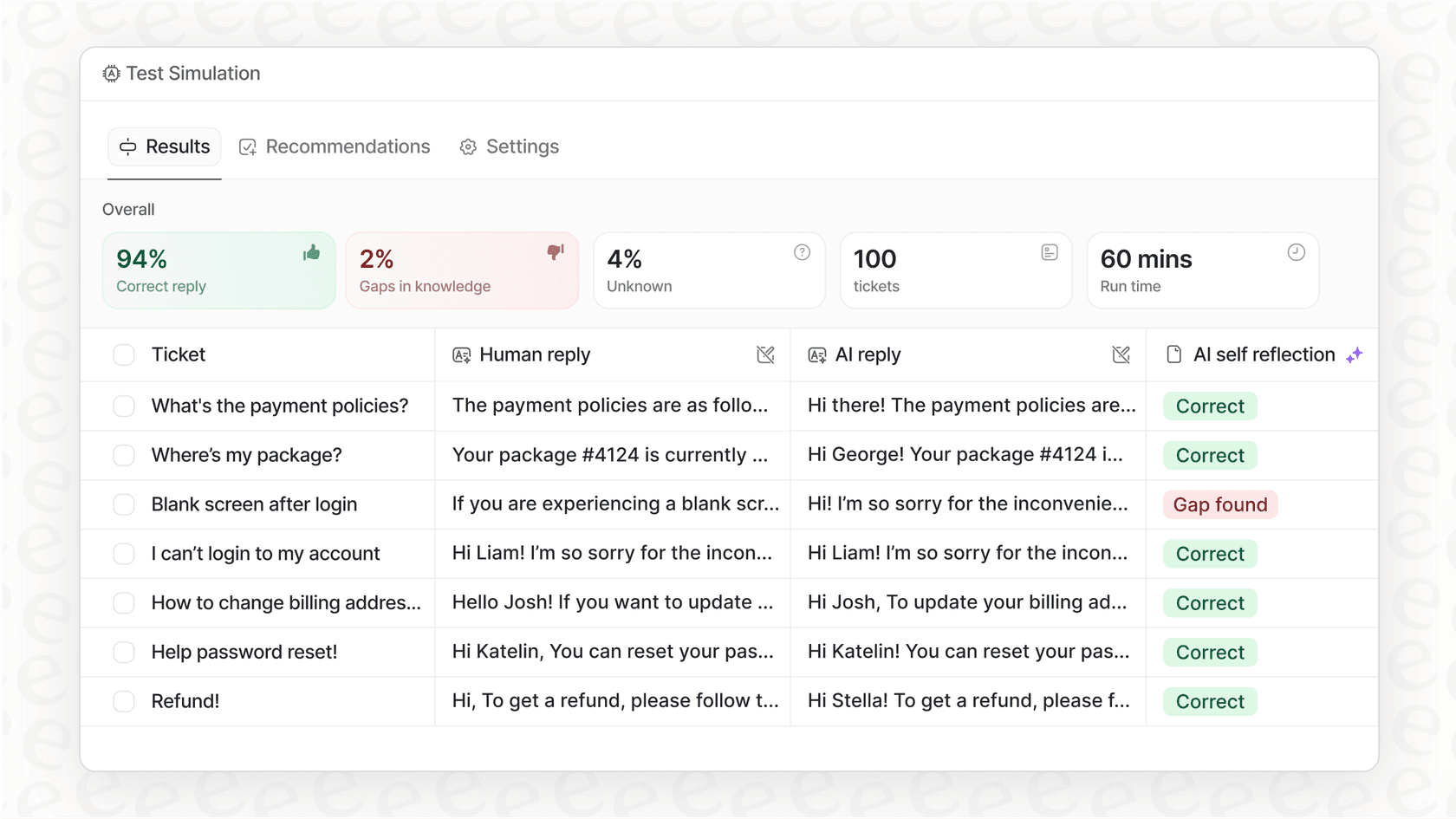

モデルを完全に決定論的にすることはできないため、次善の策は、その動作を予測し、顧客に提示するリスクを軽減するための優れた方法を用意することです。これは、eesel AIのような専用のAIサポートプラットフォームが非常に貴重になる理由です。安定したOpenAIシステムフィンガープリントを期待するのではなく、堅牢なシミュレーションおよびロールアウトエンジンを使用して責任を負うことができます。

アクティブ化する前にシミュレート

予測不可能なAIの最大の懸念は、それが実際の顧客に何を言うかもしれないかということです。eesel AIのシミュレーションモードは、これに正面から取り組みます。安全なオフラインスペースで、実際の過去のチケット数千件でAIエージェントをテストできます。

-

自動化率を予測: AIが単独で解決できたチケットの正確な数を確認できます。

-

すべての応答を確認: AIが生成した応答を調べて、それらが正確であり、会社のトーンと一致していることを確認できます。

-

ナレッジギャップを特定: シミュレーションダッシュボードは、AIがつまずいた質問を指摘し、ナレッジベースが少し愛情を必要とする場所を正確に示します。

この種のリスクのないテストでは、この種の詳細なシミュレーションがない他のプラットフォームでは得られないレベルの自信が得られます。エージェントが単一の顧客と対話する前に、エージェントがどのように動作する可能性が高いかを正確に知ることができます。

ゆっくりと、完全に制御してロールアウト

シミュレーションでの動作に満足したら、スイッチを入れて祈る必要はありません。eesel AIを使用すると、ライブに移行する方法を細かく制御できます。

-

自動化を慎重に選択: AIが特定の種類の単純で反復的な質問のみを処理できるようにすることから始めることができます。

-

その知識を範囲指定: AIを特定の知識ソースに制限して、準備ができていない質問に答えようとしないようにすることができます。

-

明確なエスケープハッチを作成: AIが会話を人間のエージェントに引き継ぐ必要がある場合の簡単なルールを設定します。

この方法により、時間の経過とともに自動化に対する信頼を構築できます。チームが完全に運転席に座っている間、実際のパフォーマンスを確認しながら、その職務を拡大できます。

OpenAIシステムフィンガープリント: API価格の概要

「シード(seed)」パラメータと「system_fingerprint」パラメータは、GPT-3.5 TurboからGPT-4oまでの幅広いOpenAIモデルで利用できます。APIの価格は通常、使用するトークンの数に基づいており、入力(プロンプト)と出力(モデルの完了)でコストが異なります。

| プラン/モデル | 一般的な価格体系 | 開発者向けの主な機能 |

|---|---|---|

| 無料 | 機能を探索するための制限付きアクセス。 | GPT-5、Web検索、カスタムGPTへのアクセス。 |

| Plus/Pro | 月額サブスクリプション ($20-$200/月)。 | 最新モデルへの拡張/無制限アクセス、より高い制限。 |

| ビジネス/エンタープライズ | ユーザーごと、月ごとの料金またはカスタム価格。 | 専用ワークスペース、強化されたセキュリティ、管理制御。 |

注意: 最新の価格情報については、常に公式のChatGPT価格ページを確認することをお勧めします。

ほとんどの有料プランでこの機能にアクセスできますが、その信頼性の低さは、より高価なモデルの料金を支払っても、基盤となる一貫性の問題が解決されないことを意味します。本当のリスクはAPI料金ではなく、完全に信頼できないエージェントを展開するための運用コストにあります。

OpenAIシステムフィンガープリント: 制御できるものに焦点を当てる

大規模言語モデルを100%予測可能にすることは依然として困難な問題であり、OpenAIシステムフィンガープリントは、このジョブにとって完璧とは言えないツールであることが判明しました。一貫性に依存する企業にとって、これは単なる小さな迷惑ではなく、自信を持って自動化するための実際的な障害です。

モデル自体から決定論を強制しようと行き詰まるのではなく、より賢明な動きは、AIを中心に堅牢な運用プロセスを構築することです。強力なシミュレーション、段階的なロールアウトオプション、および詳細な制御を提供するプラットフォームを使用することで、少し予測不可能性に伴うリスクを管理し、役立ち、信頼できるAIエージェントを展開できます。

推測をやめてテストを開始する準備はできましたか?eesel AIを使用すると、独自の履歴データでAIエージェントをシミュレートし、わずか数分でそのパフォーマンスを正確に確認できます。**今すぐ無料トライアルを開始**して、実際に信頼できる基盤の上にサポート自動化を構築してください。

よくある質問

OpenAIシステムフィンガープリントは、各API応答とともに返される一意の識別子であり、その出力を生成するために使用された特定のバックエンド構成を示します。その主な目標は、「シード(seed)」パラメータとともに、同じ入力に対して[再現性のあるAI応答](https://learn.microsoft.com/en-us/azure/ai-foundry/openai/how-to/reproducible-output)を実現することです。

その意図された目的にもかかわらず、OpenAIシステムフィンガープリントは、多くの開発者によって、一貫した入力と「シード(seed)」値を使用した場合でも、[頻繁かつ予測不可能に変化する](https://community.openai.com/t/system-fingerprint-is-different-for-the-same-seed-and-same-model-other-parameters-also-same/693387)と報告されています。この不安定さにより、一貫したAI出力を得るために信頼することが難しくなります。

不安定なOpenAIシステムフィンガープリントは、一貫性のない動作をデバッグするための開発者の時間の浪費、[AIエージェント](https://www.eesel.ai/blog/what-are-autonomous-ai-agents-a-guide-for-businesses)のデプロイに対する信頼性の欠如、およびパフォーマンスの改善を測定しようとしたときに分析が歪められることにつながります。テストのための安定したベースラインを確立する能力を損ないます。

理論的には、OpenAIシステムフィンガープリントが安定していれば、開発者は特定の問題のある出力を再現できるため、デバッグが容易になります。ただし、現在の信頼性の低さにより、この利点を一貫して提供することができず、デバッグがより困難になることがよくあります。

OpenAIは、OpenAIシステムフィンガープリントはバックエンドシステムの更新により変更される可能性があると述べています。開発者は、リクエストが異なるサーバー構成にルーティングされているか、小規模で発表されていない調整が頻繁に展開されている可能性があると疑っており、それが知覚される不安定さにつながっています。

決定論のためにOpenAIシステムフィンガープリントのみに依存するのではなく、より良いアプローチは、専用の[AIサポートプラットフォーム](https://www.eesel.ai/blog/a-practical-guide-to-mastering-ai-and-automation-in-customer-support)を使用することです。これらのプラットフォームは、堅牢なシミュレーション環境と制御されたロールアウト機能を提供し、AIの動作を自信を持って予測および管理できます。

はい、OpenAIシステムフィンガープリントと「シード(seed)」パラメータは、特定の有料APIプランに関係なく、GPT-3.5 TurboやGPT-4oを含む幅広いOpenAIモデルで一般的に利用できます。ただし、その可用性はその信頼性を保証するものではありません。

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.