Tout le monde ne parle que de l'IA générative, mais soyons honnêtes, il y a un problème évident dont personne ne parle : la confiance. Surtout lorsqu'il s'agit des données clients. Comment utiliser ces nouveaux outils puissants sans compromettre la confidentialité ? C'est une préoccupation légitime, et partagée par les clients. En fait, près des trois quarts d'entre eux craignent que les entreprises utilisent l'IA de manière contraire à l'éthique.

Le Salesforce Einstein Trust Layer est la tentative de Salesforce pour résoudre ce problème. Il s'agit d'un cadre conçu pour rendre leurs fonctionnalités d'IA natives suffisamment sûres pour les grandes entreprises, en les enveloppant dans une couche de protection de sécurité et de contrôle des données.

Mais que fait-il concrètement au quotidien ? Et plus important encore, est-ce le bon choix pour toute votre équipe de support ? Ce guide vous présentera le Trust Layer, ce qu'il est, ses principales fonctionnalités, ses limites dans le monde réel et sa tarification confuse. À la fin, vous aurez une vision claire pour vous aider à décider si c'est la solution dont vous avez besoin, ou si vous feriez mieux d'opter pour un outil plus flexible.

Qu'est-ce que le Salesforce Einstein Trust Layer ?

Pour faire simple, le Salesforce Einstein Trust Layer est un filet de sécurité pour tous les outils d'IA intégrés à la plateforme Salesforce. Ce n'est pas un module complémentaire que vous achetez séparément ; c'est l'architecture de fond qui est toujours active lorsque vous utilisez des outils comme Einstein Copilot ou le Générateur de prompts.

Son rôle principal est d'agir comme un intermédiaire sécurisé. Il se situe entre le prompt que vous saisissez et le grand modèle de langage (LLM) qui formule une réponse. Dans cette position, il intercepte vos données, effectue une série de vérifications de sécurité et s'assure que les informations sensibles de votre entreprise et de vos clients ne quittent jamais l'environnement Salesforce. Pensez-y comme un gardien pour votre IA. Il se place entre votre requête et le modèle d'IA, vérifiant l'identité de vos données et s'assurant que rien de sensible ne franchit le cordon de velours.

graph TD A[L'utilisateur saisit un prompt dans Salesforce] --> B{Einstein Trust Layer}; B --> C[1. Récupération sécurisée des données depuis le CRM]; C --> D[2. Masquage des données pour les informations personnelles identificables]; D --> E[3. Défense des prompts et vérification de la toxicité]; E --> F[Partenaire LLM, p. ex. OpenAI]; F --> G{Einstein Trust Layer}; G --> H[4. Vérification de la toxicité de la réponse]; H --> I[5. Démasquage des données]; I --> J[L'utilisateur reçoit une réponse sécurisée et pertinente]; style F fill:#ADD8E6,stroke:#333,stroke-width:2px style B fill:#90EE90,stroke:#333,stroke-width:2px style G fill:#90EE90,stroke:#333,stroke-width:2px

Fonctionnalités clés du Salesforce Einstein Trust Layer

Le Trust Layer n'est pas une seule chose ; c'est un ensemble de composants qui travaillent ensemble pour sécuriser vos interactions avec l'IA. Pour vraiment comprendre ce qu'il fait, il faut examiner chaque élément. Voici une description de ses fonctionnalités les plus importantes.

Récupération sécurisée des données et ancrage dynamique

L'une des plus grandes déceptions lors de l'utilisation d'une IA généraliste comme ChatGPT est qu'elle ne sait absolument rien de votre entreprise. Demandez-lui de rédiger un e-mail client, et vous obtiendrez un modèle qui semble avoir été écrit par un robot. C'est là que l'ancrage dynamique entre en jeu. Le Trust Layer fournit à l'IA un contexte en temps réel à partir de vos données CRM, ce qui rend ses réponses beaucoup plus pertinentes et personnalisées.

Il y parvient grâce à la récupération sécurisée des données. Le Trust Layer vérifie que l'IA n'utilise que des données que l'utilisateur est autorisé à voir. Il respecte automatiquement toutes vos autorisations utilisateur et votre sécurité au niveau des champs existantes dans Salesforce, de sorte qu'un agent ne peut pas utiliser accidentellement des informations d'un dossier auquel il ne devrait pas avoir accès.

Masquage des données pour les informations privées

Ceci est un point crucial. Avant qu'un prompt ne soit envoyé à un LLM externe, la fonction de masquage des données du Trust Layer trouve et cache automatiquement les informations sensibles. Elle recherche des détails tels que les noms, les adresses e-mail, les numéros de téléphone et les informations de carte de crédit et les remplace par des marqueurs génériques.

Elle utilise deux méthodes pour ce faire : la détection basée sur des modèles (pour les éléments ayant un format standard, comme un numéro de téléphone) et la détection basée sur les champs (qui utilise les classifications de données que vous avez déjà configurées dans Salesforce). Une fois que le LLM a renvoyé sa réponse, le Trust Layer démasque les données, remettant les informations réelles en place. L'utilisateur voit les détails corrects, mais le LLM n'a jamais vu les données privées.

Description: L'infographie doit avoir deux côtés.

Côté gauche (Avant) : Montre un prompt utilisateur contenant des données sensibles comme « Le numéro de téléphone de Jean Dupont est le 555-1234 ». Les données sont surlignées en rouge. Une flèche pointe de là vers l'icône de l'Einstein Trust Layer.

Côté droit (Après) : Montre le prompt tel qu'il est envoyé au LLM, avec les données masquées : « Le numéro de téléphone de [NOM] est le [NUMÉRO_DE_TÉLÉPHONE] ». Une flèche pointe du LLM vers le Trust Layer, qui montre ensuite la réponse finale, non masquée, envoyée à l'utilisateur.

Politique de non-conservation des données

Une préoccupation courante avec les modèles d'IA tiers est ce qu'il advient de vos données après leur utilisation. Salesforce aborde ce problème avec sa politique de non-conservation des données. Ils ont des accords avec leurs partenaires LLM, comme OpenAI, pour garantir que vos données ne sont jamais stockées ni utilisées pour entraîner leurs modèles.

Cela signifie qu'après que l'IA vous a donné une réponse, votre prompt et toutes les données qu'il contient sont effacés des serveurs du LLM. Rien n'est conservé pour examen ou entraînement, ce qui est un élément clé pour préserver la confidentialité de vos données.

Détection de la toxicité et défense des prompts

Soyons réalistes, les modèles d'IA peuvent parfois générer des réponses biaisées, inappropriées ou tout simplement étranges (ce que l'on appelle souvent des « hallucinations »). Le Trust Layer dispose d'une détection de la toxicité qui analyse à la fois le prompt de l'utilisateur et la réponse de l'IA pour tout contenu nuisible ou offensant, signalant tout ce qui semble déplacé.

Il utilise également la défense des prompts, qui est essentiellement un ensemble d'instructions qui indiquent au LLM comment se comporter. Ces garde-fous gardent l'IA en laisse, réduisant les risques qu'elle dévie du sujet et la protégeant contre les attaques où quelqu'un essaie de la pousser à enfreindre ses propres règles de sécurité.

Piste d'audit et surveillance

Pour garantir la responsabilisation de tous, le Trust Layer maintient une piste d'audit détaillée. Chaque prompt, chaque réponse et chaque commentaire d'utilisateur est enregistré et stocké de manière sécurisée dans Salesforce Data Cloud. Cela donne aux administrateurs un moyen de voir comment l'IA est utilisée, d'examiner des conversations spécifiques et de s'assurer que tout reste conforme aux politiques de l'entreprise.

Limites du Salesforce Einstein Trust Layer

Bien que le Salesforce Einstein Trust Layer fasse un assez bon travail pour sécuriser les conversations d'IA qui se déroulent à l'intérieur de la plateforme Salesforce, le fait qu'il soit intégré crée de réels problèmes pour la plupart des équipes aujourd'hui.

Le problème : un écosystème fermé

Le plus gros problème est que l'Einstein Trust Layer est uniquement conçu pour protéger les données entrant et sortant de Salesforce. Mais la connaissance de votre entreprise ne réside pas en un seul endroit. La plupart des équipes de support dépendent d'un tas d'outils différents. Vos articles d'aide peuvent se trouver dans un centre d'aide Zendesk, vos documents de processus internes dans Confluence, et les dernières mises à jour de produits dans un tas de Google Docs.

L'IA de Salesforce ne peut pas accéder à cette connaissance externe facilement ou en toute sécurité. Cela crée des silos de connaissances et oblige votre IA à trouver des réponses basées sur une infime partie de la connaissance totale de votre entreprise. Le résultat ? Des réponses incomplètes et des clients mécontents.

Configuration compliquée et lente

Mettre en place Einstein n'est pas aussi simple que d'appuyer sur un interrupteur. Pour être éligible, vous devez déjà avoir l'un des plans les plus chers de Salesforce, puis acheter un module complémentaire coûteux. L'ensemble du processus implique un long cycle de vente et un projet de mise en œuvre interminable.

Cela semble complètement déconnecté de la manière dont les logiciels modernes devraient fonctionner. Les équipes veulent des outils qu'elles peuvent essayer et configurer elles-mêmes, généralement en quelques minutes. Être obligé de « contacter votre responsable de compte Salesforce » juste pour commencer est un obstacle majeur qui ralentit tout et ajoute une couche de bureaucratie frustrante.

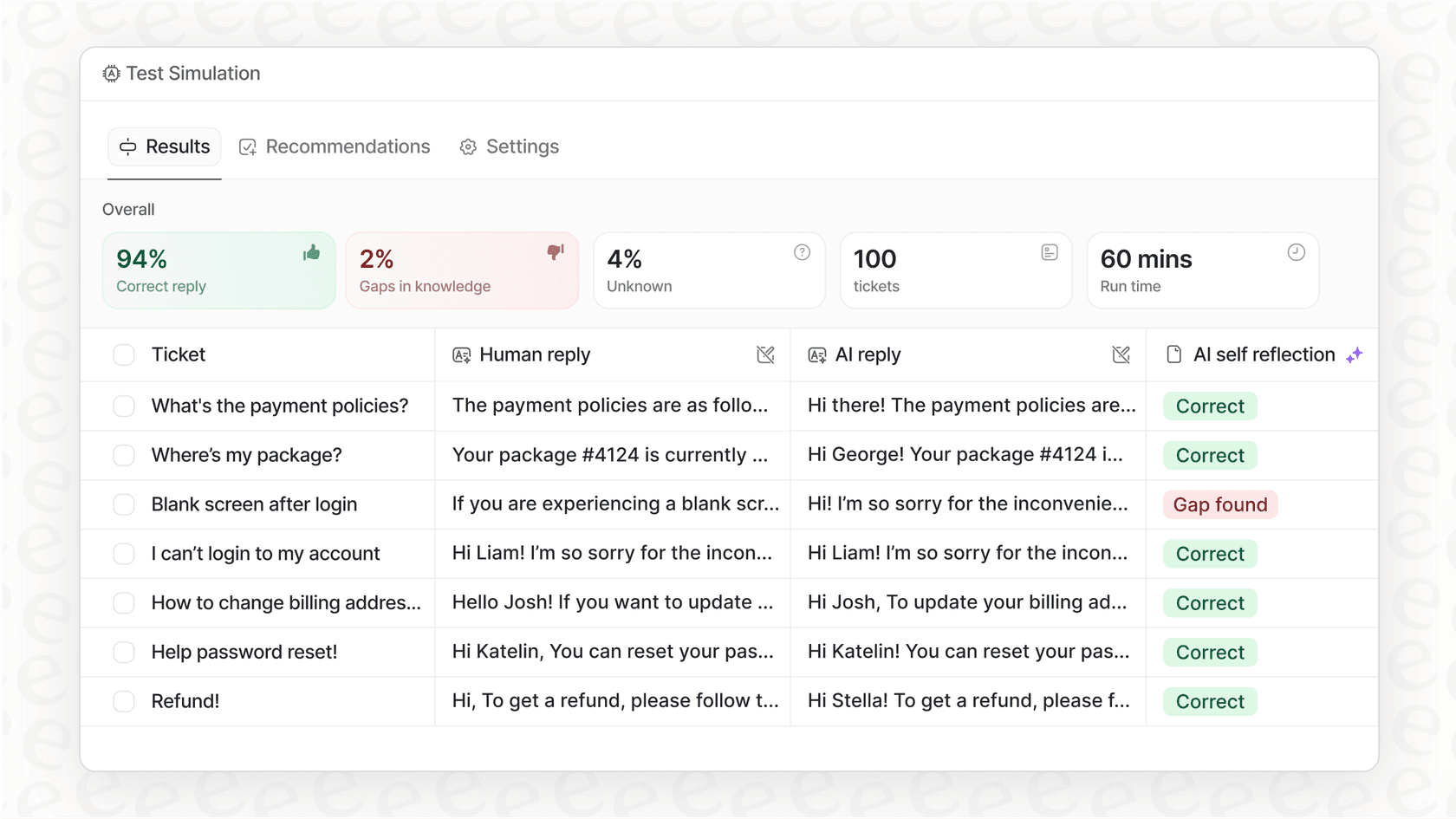

L'anxiété d'un déploiement « big bang »

Tester un nouveau système d'IA sur des conversations client en direct est une idée angoissante. Bien que Salesforce dispose de certains outils pour cela, il n'offre pas de moyen simple de simuler comment l'IA se comporterait sur des milliers de vos tickets passés réels. Sans ce type de test historique, il est presque impossible de savoir comment l'IA s'en sortira ou combien de tickets elle sera réellement capable de résoudre.

Ce manque de bon mode de simulation rend difficile pour les responsables de support de déployer l'automatisation avec confiance. Vous êtes souvent poussé vers un lancement « tout ou rien » qui peut perturber le flux de travail de votre équipe et conduire à une expérience client désastreuse si l'IA n'est pas tout à fait prête à entrer en scène.

Tarification et packaging du Salesforce Einstein Trust Layer

Si vous essayez de trouver un prix simple pour l'IA générative de Salesforce, c'est peine perdue. La tarification est confuse et tout sauf transparente.

Selon la propre documentation de Salesforce, leur IA générative est uniquement disponible si vous êtes sur un plan Enterprise, Performance ou Unlimited. En plus de cela, vous devez acheter l'un de leurs modules complémentaires, comme « Einstein for Service » ou « Einstein 1 Service ». Et combien coûtent-ils ? Vous l'avez deviné : vous devez « contacter votre responsable de compte Salesforce » pour obtenir un devis.

Voici ce que cela signifie vraiment pour vous :

-

Un coût d'entrée élevé : Vous devez déjà payer pour un plan Salesforce haut de gamme avant même de pouvoir envisager leurs outils d'IA.

-

Coûts surprises : Le prix du module complémentaire est un mystère. Cela entraîne des dépenses imprévisibles négociées en privé, rendant impossible toute budgétisation.

-

Dépendance vis-à-vis du fournisseur : Ce modèle de tarification est conçu pour vous attirer plus profondément dans l'univers Salesforce, rendant plus difficile et plus coûteux de passer à d'autres outils si vos besoins changent plus tard.

L'alternative : une couche d'IA flexible pour tous vos outils

Pour les équipes qui ont besoin d'une solution d'IA qui fonctionne avec tous leurs outils, et pas seulement un seul, il existe une meilleure approche. eesel AI a été conçu pour être cette couche d'IA flexible, pensée pour résoudre les problèmes des plateformes fermées comme Salesforce.

Soyez opérationnel en quelques minutes, pas en quelques mois

Oubliez les longs appels commerciaux et les projets de mise en œuvre que Salesforce exige. eesel AI est entièrement en libre-service. Vous pouvez vous inscrire, connecter votre service d'assistance comme Zendesk ou Freshdesk en un seul clic, et avoir un Copilote IA fonctionnel en quelques minutes, sans démo obligatoire ni argumentaire de vente.

Mieux encore, eesel AI dispose d'un puissant mode de simulation qui vous permet de tester votre configuration sur des milliers de vos tickets de support passés. Cela vous donne une prévision solide de votre taux d'automatisation et de vos économies de coûts avant de passer en production, éliminant toute incertitude de votre déploiement.

Connectez toutes vos connaissances, pas seulement les données Salesforce

eesel AI se connecte à toutes vos sources de connaissances, pas seulement à une seule plateforme. Il s'intègre à plus de 100 outils, y compris des wikis comme Confluence et Google Docs, des applications de chat comme Slack, et même des plateformes de e-commerce comme Shopify. En analysant vos tickets passés et vos macros ainsi que vos articles d'aide et vos documents internes, eesel AI construit une base de connaissances vraiment complète. Cela garantit que votre IA donne des réponses précises et contextuelles à chaque fois, peu importe où se trouve l'information.

Contrôle total et tarification claire

Avec eesel AI, vous disposez d'un moteur de flux de travail entièrement personnalisable, ce qui vous permet de décider exactement quels tickets l'IA doit traiter et ce qu'elle peut faire, du simple triage à la recherche d'informations de commande.

Et en ce qui concerne le coût, pas de mauvaises surprises. eesel AI propose des plans tarifaires transparents et prévisibles sans frais par résolution. Vous pouvez commencer avec un plan mensuel flexible et annuler à tout moment, vous donnant la liberté de monter en charge ou de réduire sans être coincé dans un contrat à long terme.

| Fonctionnalité | Salesforce Einstein Trust Layer | eesel AI |

|---|---|---|

| Temps de configuration | De quelques semaines à plusieurs mois ; nécessite l'intervention d'un commercial | Quelques minutes ; entièrement en libre-service |

| Sources de connaissances | Principalement les données Salesforce | Plus de 100 intégrations (Services d'assistance, wikis, etc.) |

| Simulation | Limitée et complexe à configurer | Intégrée ; simulez sur des milliers de tickets passés |

| Modèle de tarification | Opaque ; nécessite des plans entreprise + modules complémentaires | Transparent, forfaits mensuels fixes ; pas de coûts cachés |

| Flexibilité | Vous enferme dans l'écosystème Salesforce | Fonctionne avec vos outils existants |

La confiance dans l'IA va au-delà d'une seule plateforme

Le Salesforce Einstein Trust Layer est un cadre de sécurité solide et nécessaire si votre entreprise vit et respire Salesforce. Il offre des fonctionnalités importantes comme le masquage des données, des politiques de non-conservation et une piste d'audit qui sont des prérequis indispensables pour toute IA de niveau entreprise.

Cependant, sa plus grande force, être profondément ancré dans Salesforce, est aussi sa plus grande faiblesse. Il crée un écosystème fermé qui ne correspond tout simplement pas à la manière dont les équipes modernes travaillent, avec des connaissances réparties sur des dizaines d'outils différents. Dans le monde d'aujourd'hui, une IA digne de confiance doit être plus que simplement sécurisée ; elle doit tout voir.

Pour la plupart des équipes de support, une solution d'IA vraiment utile doit être flexible, facile à mettre en place et capable de connecter toutes vos connaissances, où qu'elles se trouvent. Bâtir une véritable confiance signifie donner à votre équipe une IA qui dispose d'une vue d'ensemble, et non d'une vision partielle.

Prochaines étapes

Si vous recherchez une solution d'IA sécurisée qui fonctionne avec tous les outils que vous possédez déjà, et pas seulement un, alors vous êtes prêt pour une approche plus flexible.

Démarrez gratuitement avec eesel AI et découvrez à quelle vitesse vous pouvez automatiser le support en vous connectant aux outils que votre équipe adore déjà.

Foire aux questions

Le Salesforce Einstein Trust Layer est une architecture de sécurité intégrée aux fonctionnalités d'IA natives de Salesforce. Sa fonction principale est d'agir comme un intermédiaire sécurisé entre les prompts des utilisateurs et les grands modèles de langage, garantissant que les données sensibles de l'entreprise et des clients restent protégées au sein de l'environnement Salesforce.

Une limitation importante est que le Salesforce Einstein Trust Layer est principalement conçu pour protéger et utiliser des données exclusivement au sein de la plateforme Salesforce. Cela signifie qu'il a du mal à accéder ou à sécuriser les connaissances stockées dans d'autres outils comme Zendesk, Confluence ou Google Docs, ce qui entraîne des silos de connaissances et des réponses d'IA potentiellement incomplètes.

L'accès à l'IA générative de Salesforce, qui inclut le Salesforce Einstein Trust Layer, n'est disponible que pour les clients des plans Enterprise, Performance ou Unlimited. De plus, les utilisateurs doivent acheter un module complémentaire distinct, souvent non listé, comme « Einstein for Service », dont le prix spécifique nécessite une consultation directe avec un responsable de compte Salesforce.

Le Salesforce Einstein Trust Layer utilise l'ancrage dynamique pour fournir à l'IA un contexte en temps réel à partir de vos données CRM, rendant les réponses plus pertinentes et personnalisées. Il inclut également des mécanismes de détection de la toxicité et de défense des prompts pour analyser le contenu inapproprié et des garde-fous pour maintenir l'IA sur le sujet, réduisant ainsi la probabilité de résultats non pertinents ou nuisibles.

La mise en place du Salesforce Einstein Trust Layer n'est généralement pas un processus rapide, impliquant souvent un long cycle de vente et un projet de mise en œuvre prolongé. L'éligibilité nécessite d'être sur l'un des plans les plus chers de Salesforce, suivi de l'achat d'un module complémentaire coûteux, ce qui en fait une solution peu axée sur le libre-service.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.

Il utilise une fonctionnalité de masquage des données qui identifie et remplace automatiquement les détails sensibles comme les noms et les informations de carte de crédit par des marqueurs génériques avant d'envoyer le prompt à un LLM externe. Une fois que le LLM a fourni une réponse, le Trust Layer démasque les données. Il emploie également une politique de non-conservation des données, garantissant que vos données ne sont jamais stockées ou utilisées pour entraîner des modèles tiers.