Quand vous pensez à l’IA, les noms OpenAI, Meta et Google vous viennent probablement à l’esprit. Ils ont tendance à accaparer toute l’attention médiatique. Mais une autre entreprise, Alibaba, a développé sa propre famille puissante de grands modèles linguistiques (LLM) appelée Qwen.

Dans cet article, nous allons vous donner un aperçu simple de Qwen. Nous allons éviter les trucs super techniques et nous concentrer sur ce que sont les différents modèles Qwen, ce qu’ils peuvent faire et ce qu’il en coûte réellement de les utiliser. Il est facile de se perdre dans une mer de numéros de version et de modèles spécialisés, alors nous nous concentrerons sur ce qui compte pour les équipes qui envisagent d’utiliser l’IA pour le support client ou de gérer les connaissances internes.

La principale question à laquelle nous voulons répondre est assez simple : Qwen est-il un outil que vous pouvez réellement utiliser aujourd’hui, ou est-ce plutôt un moteur puissant autour duquel vous devez construire une voiture vous-même ?

Que sont les modèles Qwen ?

Qwen, qui se traduit par « mille questions », est une série de modèles linguistiques d’Alibaba Cloud. La première chose que vous devez savoir est que Qwen n’est pas un produit unique que vous pouvez simplement brancher et utiliser. Considérez-le plutôt comme une grande famille de modèles tentaculaire, avec des douzaines de variantes conçues pour des tâches légèrement différentes.

Au fond, tous les modèles Qwen sont construits sur la même technologie de base (une architecture basée sur les transformateurs) qui alimente des modèles comme GPT. Ils sont également connus pour être excellents avec plusieurs langues, en particulier le chinois et l’anglais, ce qui les rend intéressants pour les entreprises mondiales.

Les modèles Qwen se présentent sous deux formes principales : des versions commerciales puissantes auxquelles vous pouvez accéder via une API, et des versions open source que vous pouvez héberger et personnaliser vous-même. De plus, il existe des modèles spécialisés pour des tâches spécifiques comme le codage, la résolution de problèmes mathématiques ou même la compréhension d’images. Cette variété vous offre beaucoup de flexibilité, mais elle soulève également le premier grand défi : déterminer lequel des nombreux modèles est le bon pour vous.

Les familles de modèles Qwen

Le nombre impressionnant de modèles et de versions Qwen peut vous donner le tournis. Essayons de décomposer les principales familles pour obtenir une image plus claire.

Modèles généraux et de chat

Ce sont les modèles de base qui forment l’épine dorsale de la série Qwen. Ils sont conçus pour la plupart des tâches textuelles auxquelles vous pouvez penser, comme la rédaction d’e-mails, la synthèse de longs documents ou l’alimentation d’un chatbot. Les numéros de version (1.5, 2.5, 3) ne font que marquer leur évolution. Chaque nouvelle génération s’améliore, avec des fenêtres de contexte plus grandes (ce qui signifie qu’elle peut se souvenir de plus de conversations) et de meilleures performances. Si vous recherchez un assistant d’IA à usage général, vous commencerez ici.

Modèles spécialisés

C’est là que Qwen devient plus spécifique. Au lieu d’être un touche-à-tout, ces modèles sont affinés pour des tâches particulières :

-

Qwen-VL : Ce sont des modèles Vision-Langage, ce qui signifie qu’ils peuvent voir. Vous pouvez leur montrer une image, un graphique ou un document, et ils peuvent vous dire ce qu’il contient, répondre à des questions et même en extraire du texte.

-

Qwen-Audio : Ces modèles fonctionnent avec l’audio. Ils peuvent transcrire un appel client, identifier différents sons et même détecter le sentiment à partir du ton de la voix d’une personne.

-

Qwen-Coder : Conçus pour les développeurs, ces modèles peuvent écrire du nouveau code, vous aider à trouver des bogues dans le code existant et générer de la documentation.

-

Qwen-Math : Comme son nom l’indique, ces modèles sont entraînés pour comprendre et résoudre des problèmes mathématiques, de l’arithmétique de base à l’algèbre plus complexe.

Modèles de raisonnement

L’une des évolutions les plus intéressantes des derniers modèles Qwen est ce qu’ils appellent le « mode de pensée ». Il est conçu pour gérer des problèmes complexes et à plusieurs étapes qui nécessitent un peu de raisonnement logique. Lorsque vous l’activez, le modèle montre souvent son travail, en présentant un processus de pensée étape par étape avant de donner la réponse finale. C’est idéal pour rendre sa logique transparente, en particulier pour des choses comme les preuves mathématiques ou la planification détaillée. Le hic ? Il est beaucoup plus lent et plus coûteux à exécuter.

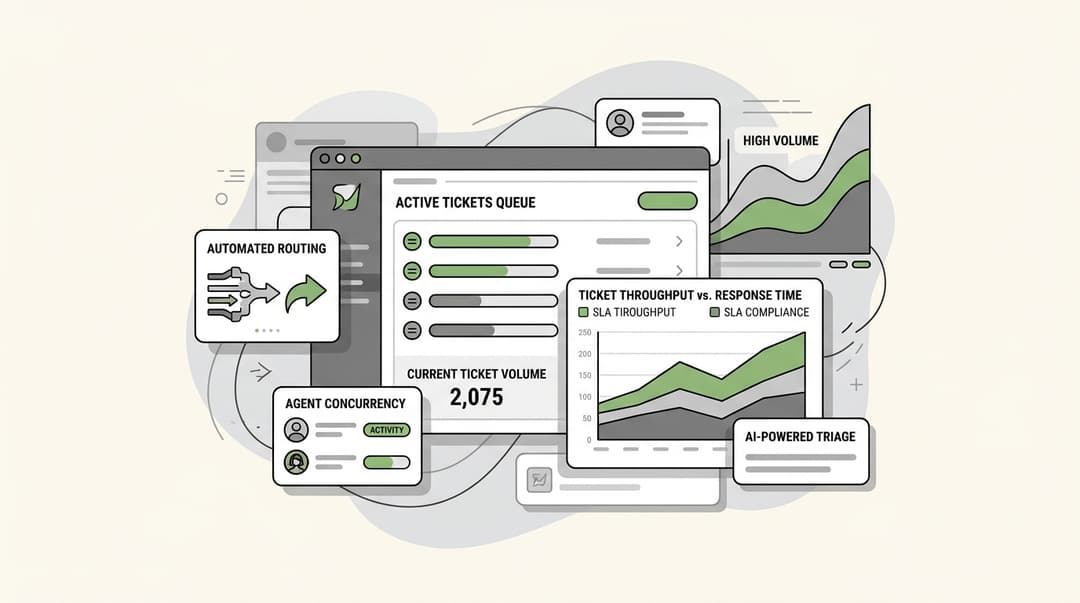

Alors, lequel choisir ? Un modèle général pour les questions simples ? Un modèle de raisonnement pour les questions difficiles ? Un modèle de vision pour les tickets avec des captures d’écran ? Une file d’attente de support réelle reçoit tout ce qui précède. C’est là que les choses se compliquent pour la plupart des équipes, et c’est pourquoi une plateforme comme eesel AI existe. Elle est conçue pour gérer immédiatement le sac mixte d’une file d’attente de support, en utilisant automatiquement la meilleure technologie pour le travail afin que vous puissiez vous concentrer sur l’aide aux clients, et non sur le fait de devenir des chercheurs en IA.

| Famille de modèles | Cas d’utilisation principal | Caractéristique clé |

|---|---|---|

| Qwen (Base) | Texte et chat généraux | Modèles de base pour la conversation et le contenu. |

| Qwen-VL | Vision et compréhension des images | Analyse des images, des graphiques et des documents. |

| Qwen-Audio | Traitement audio | Transcrit la parole, la musique et d’autres sons. |

| Qwen-Coder | Génération et assistance de code | Spécialisé pour les tâches de développement de logiciels. |

| QwQ / Réflexion | Raisonnement complexe et résolution de problèmes | Affiche la logique étape par étape pour les tâches difficiles. |

Principales fonctionnalités et limitations

Maintenant que nous maîtrisons les différents modèles, examinons ce qu’ils peuvent faire et, tout aussi important, leurs lacunes dans la pratique.

Prise en charge multilingue puissante et grandes fenêtres de contexte

Deux des principaux arguments de vente de Qwen sont ses compétences linguistiques et sa mémoire. De nombreux modèles récents peuvent gérer plus de 100 langues et dialectes, ce qui en fait une option très intéressante pour les entreprises mondiales qui prennent en charge des clients dans différentes régions.

De plus, certains modèles Qwen ont des fenêtres de contexte massives, certains étant capables de traiter jusqu’à un million de jetons. En pratique, cela signifie que l’IA peut lire et se souvenir de documents incroyablement longs ou d’historiques de conversations entiers sans se perdre. C’est un énorme avantage pour parcourir de longs fils de discussion d’assistance ou résumer des manuels techniques denses.

Le compromis : Open source vs. commercial

Choisir entre les modèles open source et commerciaux de Qwen implique un compromis classique.

Les modèles open source offrent une tonne de flexibilité. Si vous avez une équipe d’ingénieurs en IA et un budget pour des serveurs robustes, vous pouvez les héberger vous-même, les entraîner sur vos propres données et avoir un contrôle total. L’inconvénient est que cela nécessite beaucoup d’infrastructure et de compétences techniques pour gérer, et les versions open source ne sont généralement pas aussi puissantes que les versions commerciales.

Les modèles commerciaux, que vous utilisez via une API, vous donnent accès à l’IA la plus récente et la plus performante d’Alibaba. Mais cette commodité signifie que vous êtes lié à un seul fournisseur, que vous devez composer avec une structure de tarification déroutante et que vous avez moins de contrôle global.

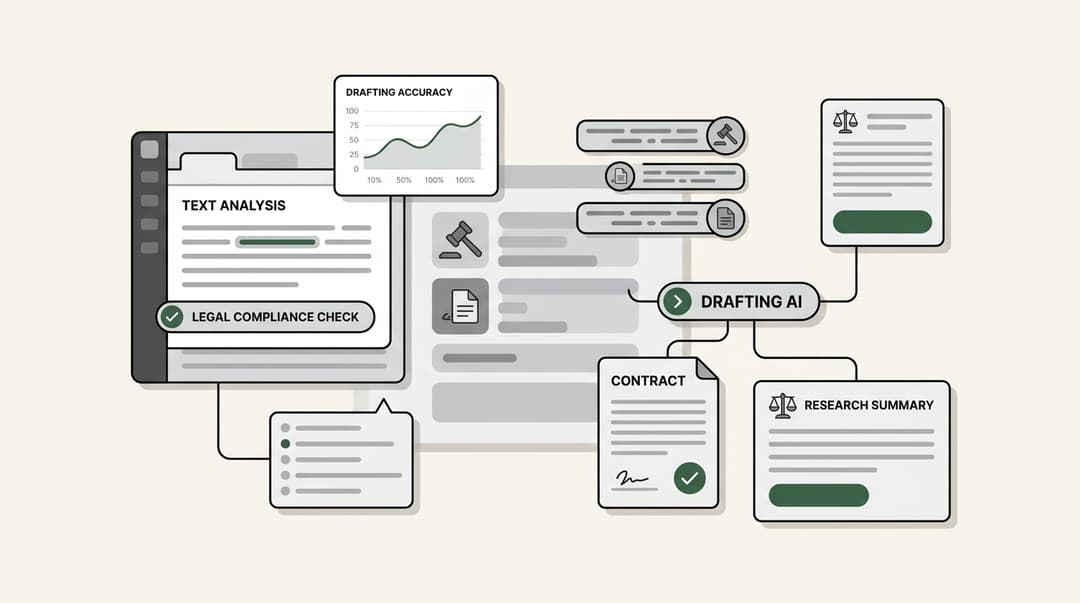

Le fossé de la mise en œuvre : Du modèle à la solution

C’est probablement le plus grand obstacle pour la plupart des entreprises : un LLM brut comme Qwen, qu’il soit open source ou commercial, ne résout pas à lui seul les problèmes commerciaux. C’est juste un moteur. Pour le rendre utile, vous devez construire toute une application autour de lui pour vous connecter à vos connaissances, vous brancher à vos autres outils (comme votre service d’assistance) et donner à votre équipe un moyen de l’utiliser réellement.

C’est là que la plupart des projets sont bloqués. La construction de cette couche d’application est une tâche énorme, longue et coûteuse. C’est précisément le fossé que eesel AI comble. Nous vous fournissons cette couche entière. Elle connecte toutes vos connaissances provenant d’endroits dispersés comme votre centre d’aide, Confluence et Google Docs. Elle se branche directement sur les outils que votre équipe utilise déjà, comme Zendesk ou Slack, en quelques minutes seulement, et vous donne un tableau de bord simple pour tout gérer. Elle transforme le potentiel brut d’un modèle comme Qwen en un outil qui fonctionne dès le premier jour.

Les défis pratiques : Tarification et configuration

Au-delà des spécifications techniques, les coûts réels et les efforts nécessaires pour utiliser Qwen sont des facteurs importants qui sont souvent passés sous silence dans les critiques élogieuses.

Le modèle de tarification complexe

Si vous optez pour les modèles Qwen commerciaux via Alibaba Cloud, vous constaterez que la tarification est tout sauf simple. Le prix que vous payez est très variable, en fonction de quelques éléments :

-

Tarification échelonnée : Le coût par jeton (l’unité de base du texte) peut changer en fonction de la longueur de votre invite. Les entrées plus longues peuvent parfois coûter plus cher par jeton.

-

Jetons d’entrée vs. de sortie : Vous êtes facturé à des tarifs différents, et souvent beaucoup plus élevés, pour le texte que le modèle écrit (sortie) par rapport au texte que vous lui envoyez (entrée).

-

Mode de pensée vs. mode sans réflexion : Comme nous l’avons mentionné, l’activation du « mode de pensée » plus puissant peut rendre une seule réponse de 3 à 10 fois plus chère.

-

Niveaux de modèles : Les différents modèles comme Qwen-Max, Qwen-Plus et Qwen-Flash ont tous leurs propres prix.

Le résultat final est un modèle de tarification complexe qui est vraiment difficile à prévoir. Un afflux soudain de tickets de support complexes pourrait faire monter en flèche votre facture sans prévenir, ce qui rendrait presque impossible l’établissement d’un budget.

| Qwen-Plus (Mode sans réflexion) | Prix d’entrée (par million de jetons) | Prix de sortie (par million de jetons) |

|---|---|---|

| 0, 256 000 jetons | 0,4 $ | 1,2 $ |

| 256 000, 1 million de jetons | 1,2 $ | 3,6 $ |

| Qwen-Plus (Mode de pensée) | 0,4 $ | 4,00 $ |

Remarque : Les prix sont des exemples basés sur des données publiques et sont susceptibles de changer. La sortie en « mode de pensée » coûte plus de 3 fois plus cher.

Les coûts cachés : Mise en œuvre et maintenance

En plus des frais d’utilisation, il y a un énorme coût caché dans le temps d’ingénierie. Pour utiliser l’API de Qwen, votre équipe de développement doit configurer la connexion, gérer les clés de sécurité, créer des intégrations avec votre service d’assistance et vos bases de connaissances, et surveiller les performances du modèle.

Si vous optez pour la voie de l’open source, vous êtes responsable de la configuration, de la gestion et du paiement des serveurs GPU coûteux nécessaires pour exécuter ces modèles, ce qui peut facilement coûter des milliers de dollars par mois.

C’est là qu’une plateforme prête à l’emploi se démarque vraiment. Au lieu de frais imprévisibles par jeton qui vous pénalisent lorsque vous êtes occupé, eesel AI offre une tarification transparente et prévisible sans frais par résolution. Et au lieu d’un projet d’ingénierie de plusieurs mois, les intégrations de service d’assistance en un clic d’eesel AI signifient que vous pouvez être opérationnel en quelques minutes, pas en quelques mois. Vous pouvez même simuler la façon dont l’IA fonctionnera sur des milliers de vos anciens tickets pour obtenir une prévision de ROI réelle avant de dépenser un centime, ce que vous ne pouvez tout simplement pas faire lorsque vous construisez à partir de zéro.

Qwen est-il le bon choix pour votre équipe de support ?

La famille de modèles Qwen est puissante et polyvalente, il n’y a aucun doute à ce sujet. Alibaba a construit un concurrent sérieux dans le domaine de l’IA. Mais il est important de voir Qwen pour ce qu’il est : un ingrédient, pas un repas complet.

Qwen est un excellent choix pour les entreprises qui ont des équipes de développement d’IA dédiées, un budget flexible qui peut gérer les coûts imprévisibles et un plan spécifique pour construire une application d’IA entièrement personnalisée à partir de zéro.

Cependant, pour la plupart des équipes de support, d’informatique et d’exploitation, ce n’est pas le bon outil pour le travail. Ces équipes ont besoin d’une plateforme d’IA fiable, rentable et facile à utiliser qui fonctionne avec leurs outils existants sans avoir besoin d’un projet d’ingénierie massif.

Pour ces équipes, une solution spécialement conçue comme eesel AI offre toute la puissance des modèles de pointe comme Qwen, mais sans la complexité, les coûts surprises et les maux de tête de configuration. C’est la différence entre acheter un moteur haute performance et conduire une voiture entièrement construite directement sur le terrain.

Prêt à voir ce qu’une plateforme d’IA spécialement conçue peut faire pour votre équipe ? Démarrez un essai gratuit avec eesel AI et automatisez vos premiers tickets de support en quelques minutes.

Foire aux questions

Qwen est une famille de puissants grands modèles linguistiques (LLM) développée par Alibaba Cloud, connue pour son architecture basée sur les transformateurs et ses fortes capacités multilingues, en particulier en chinois et en anglais. Il offre à la fois un accès API commercial et des versions open source.

La famille Qwen comprend des modèles de chat à usage général (comme Qwen, Qwen1.5) et des modèles spécialisés tels que Qwen-VL pour la vision, Qwen-Audio pour l'audio, Qwen-Coder pour le codage et Qwen-Math pour la résolution de problèmes. Il existe également des modèles de raisonnement avancés.

Un avantage significatif est la puissante prise en charge multilingue de Qwen, qui gère plus de 100 langues et dialectes, ce qui le rend idéal pour les entreprises mondiales. De plus, certains modèles disposent de fenêtres de contexte massives, leur permettant de traiter et de mémoriser des documents ou des historiques de conversation incroyablement longs.

Les modèles Qwen open source offrent une grande flexibilité et un contrôle élevé aux équipes disposant d'ingénieurs en IA dédiés, mais nécessitent une infrastructure et des compétences techniques importantes. Les modèles commerciaux donnent accès à la dernière IA d'Alibaba via l'API, offrant une commodité mais avec moins de contrôle et une tarification souvent complexe.

Le principal défi est le « fossé de mise en œuvre », où un LLM brut comme Qwen ne résout pas à lui seul les problèmes commerciaux. Il nécessite la construction d'une couche d'application complète, y compris des intégrations avec les outils et les bases de connaissances existants, ce qui représente un effort d'ingénierie important et coûteux.

La tarification des modèles Qwen commerciaux via Alibaba Cloud est complexe et imprévisible. Cela implique une tarification échelonnée basée sur la longueur de l'invite, des tarifs différents pour les jetons d'entrée par rapport aux jetons de sortie, des coûts plus élevés pour le « mode de réflexion » et des prix variables selon les différents niveaux de modèle.

Share this article

Article by

Stevia Putri

Stevia Putri est une généraliste du marketing chez eesel AI, où elle aide à transformer de puissants outils d'IA en histoires qui résonnent. Elle est motivée par la curiosité, la clarté et le côté humain de la technologie.