Depuis un certain temps, l'idée d'avoir un partenaire de codage IA directement dans un notebook Jupyter est considérée comme le Saint Graal pour les data scientists et les développeurs. Lorsque des outils comme GitHub Copilot ont commencé à faire des vagues, cela n'a fait qu'inciter tout le monde à vouloir cette même puissance à l'intérieur de leurs notebooks. Le moteur derrière ces premiers outils était OpenAI Codex, un modèle qui promettait de transformer l'anglais courant en code fonctionnel.

Ce guide vous guidera à travers l'histoire de Codex et son parcours avec Jupyter, examinera les outils modernes qui ont pris sa place et expliquera pourquoi les vrais gains de productivité viennent du fait de regarder au-delà du notebook vers une IA qui comprend l'ensemble de la base de connaissances de votre équipe.

Qu'est-ce qu'OpenAI Codex ?

OpenAI Codex était un système d'IA qui pouvait prendre des invites en langage naturel et produire du code. Il s'agissait d'un spin-off de GPT-3, formé sur une quantité massive de texte et des milliards de lignes de code public. C'est ce qui a alimenté la première version de GitHub Copilot.

Codex était assez polyvalent, gérant plus d'une douzaine de langages comme Python, JavaScript et Ruby. Il faisait plus que de l'autocomplétion ; il pouvait expliquer ce que faisait un bloc de code, traduire du code entre les langages et même aider à refactoriser votre travail.

Mais voici un élément crucial du puzzle : les modèles OpenAI Codex originaux ont été officiellement retirés en mars 2023. Bien que la technologie sous-jacente ait évolué et que ses successeurs soient désormais intégrés aux modèles les plus récents d'OpenAI, l'API Codex spécifique sur laquelle toutes les premières intégrations étaient basées a disparu. Ce seul changement a pratiquement remodelé l'ensemble du paysage des outils d'IA dans Jupyter.

La volonté de la communauté d'OpenAI Codex dans Jupyter

Avant l'arrivée d'outils officiels, la communauté des développeurs travaillait déjà dur pour intégrer l'IA à son environnement de notebook préféré. De nombreux data scientists et ingénieurs en ML vivent dans Jupyter, et le flux de travail itératif, cellule par cellule, est exactement leur façon de penser. Devoir passer à VS Code juste pour utiliser Copilot était perçu comme une interruption « lourde » et maladroite.

Premières solutions construites par la communauté

Cette frustration a suscité de nombreux projets open source. Des outils comme « gpt-jupyterlab » et « jupyterlab-codex » ont fait leur apparition, permettant aux développeurs d'envoyer le contenu d'une cellule de notebook à l'API OpenAI. La configuration était généralement assez simple : « pip install » un package, déposez votre clé API OpenAI dans les paramètres de JupyterLab, et vous obtiendrez un nouveau bouton pour générer du code. Ces outils sont un excellent exemple de la communauté construisant ce dont elle avait besoin.

Défis et limites des premières intégrations

Aussi prometteuses qu'elles soient, ces premières intégrations avaient leur lot de maux de tête qui les rendaient difficiles à utiliser à long terme :

-

Les maux de tête de la configuration : Les utilisateurs rencontraient fréquemment des blocages lors de l'installation, en particulier sur les serveurs distants. Beaucoup de ces plugins nécessitaient un redémarrage complet du serveur JupyterLab pour fonctionner, et déterminer pourquoi votre configuration ne fonctionnait pas pouvait prendre une bonne partie de votre après-midi.

-

Modèles obsolètes : La plupart de ces outils ont été conçus spécifiquement pour les modèles Codex originaux. Une fois ceux-ci retirés, les extensions ont pratiquement cessé de fonctionner à moins d'être complètement remaniées pour utiliser des modèles OpenAI plus récents (et à des prix différents).

-

Le plus gros angle mort : pas de contexte : Le problème le plus fondamental était que ces outils fonctionnaient dans le vide. Ils pouvaient voir le code dans une cellule, mais ils n'avaient aucun accès à la documentation du projet dans Confluence, aux spécifications dans Google Docs, ou à cette clarification clé que votre responsable a publiée dans Slack. L'IA pouvait écrire du code, mais elle ne savait pas pourquoi elle l'écrivait.

Le paysage moderne

Les choses ont définitivement évolué depuis l'époque des simples plugins Codex. L'accent est passé des hacks à modèle unique à des frameworks plus solides et flexibles qui peuvent se connecter à un ensemble de fournisseurs d'IA différents.

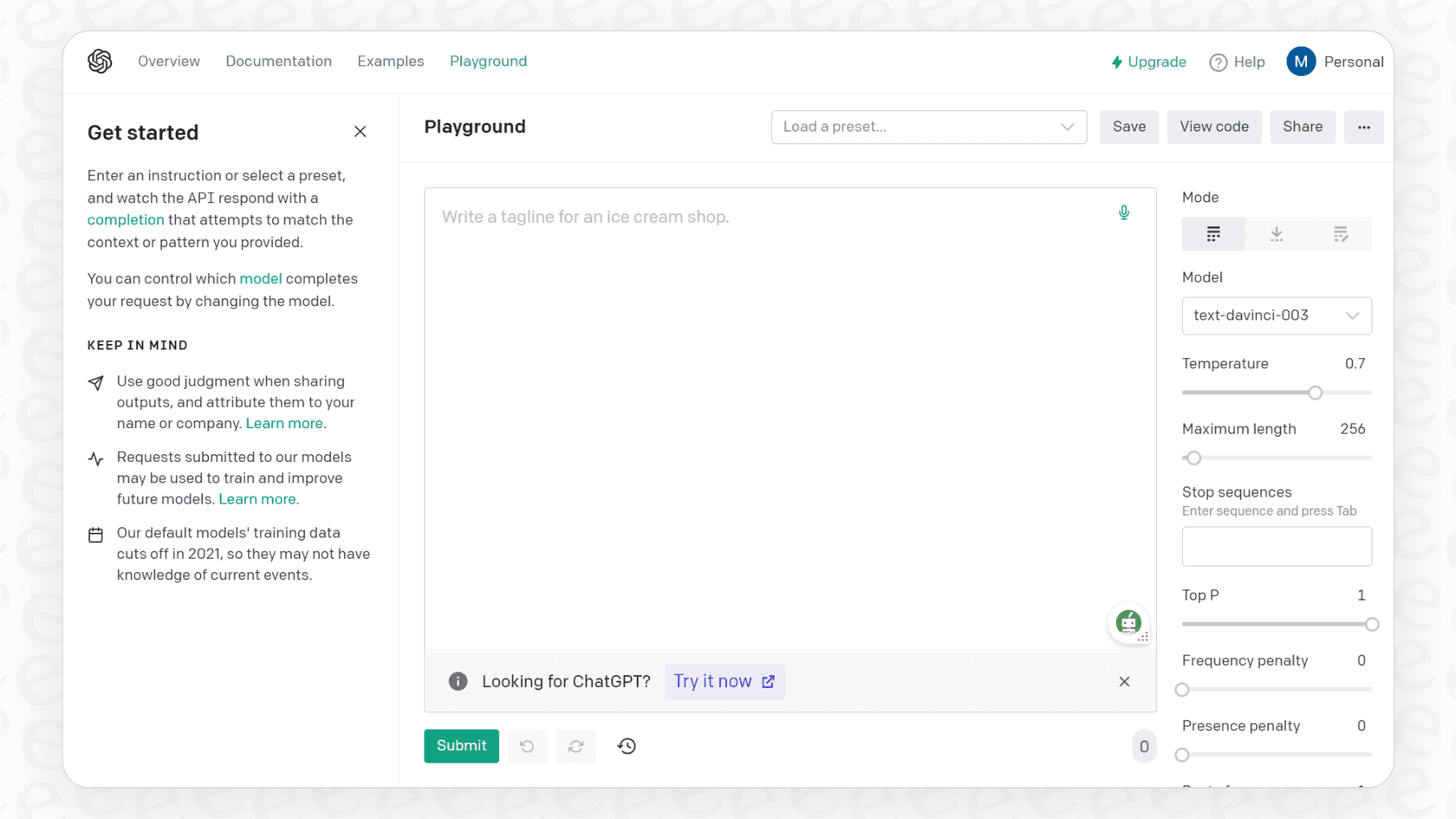

L'essor de « jupyter-ai »

Le principal acteur aujourd'hui est « jupyter-ai », un projet officiel de l'équipe Jupyter. Il intègre l'IA générative directement dans JupyterLab et les notebooks Jupyter. Au lieu d'être verrouillé dans un ancien modèle, « jupyter-ai » est plutôt un adaptateur universel, toute une gamme de modèles modernes de fournisseurs comme OpenAI, Anthropic, Cohere et même des modèles open source de Hugging Face.

Il est livré avec une interface utilisateur de chat intégrée où vous pouvez poser des questions sur votre code, ainsi que des « commandes magiques » « %%ai » pratiques. Celles-ci vous permettent de générer du code, de corriger des erreurs ou même de créer des fonctions entières à partir d'une simple invite à l'intérieur d'une cellule de notebook.

Considérations relatives à la tarification et à la configuration

Bien que « jupyter-ai » soit open source, les modèles puissants auxquels il se connecte ne sont pas gratuits. Vous aurez besoin d'une clé API d'un fournisseur comme OpenAI ou Anthropic, et vous serez facturé pour ce que vous utilisez, généralement en fonction des « jetons » (les éléments de mots que l'IA mâche). L'époque des versions bêta gratuites est révolue ; avoir accès à des modèles suffisamment bons pour le codage est désormais un service payant. Par exemple, les derniers modèles d'OpenAI sont disponibles via leur API ou dans le cadre de plans tels que ChatGPT Team ou Enterprise.

| Fournisseur | Exemples de modèles | Idéal pour |

|---|---|---|

| OpenAI | « gpt-4o », « gpt-3.5-turbo » | Génération de code à usage général, explication |

| Anthropic | « claude-3-sonnet » | Raisonnement complexe, gestion de contextes importants |

| Hugging Face | Divers modèles open source | Tâches spécialisées, exécution sur sa propre infrastructure |

Au-delà de la saisie semi-automatique du code : les limites de l'IA dans les notebooks

Même avec un outil astucieux comme « jupyter-ai », il existe toujours une grande limitation : l'IA est bloquée à l'intérieur de l'environnement de codage du développeur. Un bon développeur fait plus que simplement écrire du code. Il doit comprendre les objectifs commerciaux, lire les spécifications techniques et parler avec son équipe. Un assistant IA qui ne peut voir aucune de ces informations ne résout que la moitié du problème.

Pensez au temps qu'un développeur passe à changer de contexte. Vous êtes plongé dans un notebook, puis vous devez vous arrêter, ouvrir un nouvel onglet, rechercher Confluence pour la documentation de l'API, faire défiler un canal Slack pour trouver une décision que quelqu'un a prise, ou ouvrir un Google Doc pour vérifier une conception. Chacune de ces petites interruptions brise votre concentration et vous ralentit.

Unifier vos outils avec un assistant IA interne

C'est là que nous devons penser plus grand qu'un simple assistant de codage et commencer à penser à une plateforme d'IA consciente des connaissances. Alors que « jupyter-ai » apporte un modèle dans votre notebook, un outil comme eesel AI apporte toutes les connaissances dispersées de votre entreprise à l'IA.

Avec le chat interne d'eesel AI, vous pouvez configurer un assistant formé sur les propres données de votre organisation. Il se connecte directement aux outils sur lesquels votre équipe s'appuie déjà, comme Notion, SharePoint et Microsoft Teams.

Imaginez qu'un développeur travaille dans Jupyter et a une question sur un schéma de données. Au lieu de tout laisser tomber pour aller fouiller dans la documentation, il peut simplement demander au bot eesel AI dans Slack : « Quels sont les champs obligatoires pour la table « user_profiles » ? » Le bot lui donne une réponse instantanée et précise tirée directement de la documentation officielle de l'équipe. C'est ce que fait l'unification de vos connaissances, elle réduit les changements de contexte constants et permet aux développeurs de se remettre au travail.

Démarrer : passer à un flux de travail conscient des connaissances

Le chemin parcouru depuis les premières intégrations d'OpenAI Codex avec Jupyter jusqu'à aujourd'hui montre un schéma clair. Nous sommes passés de plugins de base à des assistants flexibles dans les notebooks. La prochaine étape logique est un flux de travail d'IA entièrement connecté et conscient des connaissances. L'avenir de la productivité des développeurs ne consiste pas seulement à produire du code plus rapidement ; il s'agit d'aider les développeurs à prendre de meilleures décisions avec moins de tracas.

Et vous n'avez pas besoin d'un projet massif de plusieurs mois pour y parvenir. Avec une plateforme conçue pour être simple, vous pouvez démarrer rapidement. Par exemple, eesel AI est conçu pour être radicalement en libre-service, ce qui signifie que vous pouvez être opérationnel en quelques minutes, pas en quelques mois. Vous pouvez connecter vos sources de connaissances et déployer un assistant IA interne pour votre équipe sans assister à des démos interminables ou à des projets de mise en œuvre personnalisés.

Construire plus intelligemment, pas seulement plus vite

La saisie semi-automatique du code alimentée par l'IA dans Jupyter est un outil fantastique qui a changé la façon dont beaucoup d'entre nous travaillent. Mais il brille vraiment lorsque l'IA a une vue d'ensemble, le contexte de la documentation, des conversations et des objectifs commerciaux de votre équipe. En connectant toutes vos connaissances internes, vous pouvez créer un assistant qui ne se contente pas d'écrire du code, mais qui aide vos développeurs à construire le bon code, plus rapidement.

Prêt à donner à vos développeurs une IA qui comprend réellement votre entreprise ? Essayez eesel AI pour unifier vos connaissances et donner un véritable coup de pouce à la productivité de votre équipe.

Foire aux questions

Les modèles OpenAI Codex originaux, qui alimentaient les premières intégrations, ont été officiellement retirés en mars 2023. Bien que leur technologie sous-jacente ait évolué vers des modèles OpenAI plus récents, l'API Codex spécifique n'est plus disponible, ce qui rend les « intégrations d'OpenAI Codex avec Jupyter » directes obsolètes pour les nouveaux projets.

La principale alternative moderne est « jupyter-ai ». Ce projet Jupyter officiel sert d'adaptateur universel, connectant JupyterLab et les notebooks Jupyter à une gamme de modèles d'IA générative actuels de fournisseurs comme OpenAI, Anthropic et Hugging Face.

Les premières intégrations souffraient souvent de la complexité de la configuration, devenaient rapidement obsolètes lorsque les modèles Codex étaient retirés et, surtout, n'avaient pas accès à un contexte de projet plus large, comme la documentation ou les discussions d'équipe, fonctionnant dans un vide de connaissances.

Oui, bien que « jupyter-ai » lui-même soit open source, les puissants modèles d'IA auxquels il se connecte nécessitent généralement une clé API d'un fournisseur (par exemple, OpenAI, Anthropic) et entraînent des coûts basés sur l'utilisation, généralement facturés par « jetons ».

Le passage à un flux de travail d'IA conscient des connaissances réduit considérablement les changements de contexte, aide les développeurs à prendre de meilleures décisions en fournissant un accès instantané aux connaissances de l'organisation et augmente finalement la productivité globale au-delà de la simple génération de code plus rapide.

Share this article

Article by

Stevia Putri

Stevia Putri est une généraliste du marketing chez eesel AI, où elle aide à transformer de puissants outils d'IA en histoires qui résonnent. Elle est motivée par la curiosité, la clarté et le côté humain de la technologie.

Pour surmonter les limitations de contexte, vous avez besoin d'une plateforme d'IA consciente des connaissances qui unifie toutes les informations dispersées de votre équipe provenant d'outils comme Confluence, Slack et Google Docs. Cela permet à l'IA de fournir des réponses et une assistance basées sur la base de connaissances entière de votre organisation, s'étendant au-delà du simple code dans un notebook.