J'ai essayé les 5 meilleures alternatives à AWS Lambda : Voici mon guide définitif pour 2025

Stevia Putri

Katelin Teen

Dernière modification November 14, 2025

Si vous vous êtes déjà retrouvé à parcourir un fil de discussion Reddit, hochant la tête en lisant les plaintes sur les démarrages à froid d'AWS Lambda, ou en essayant de comprendre pourquoi votre facture a soudainement explosé, vous n'êtes pas seul.

L'informatique sans serveur, ou Functions-as-a-Service (FaaS), nous a été vendue comme un rêve : écrivez simplement votre code, et laissez le cloud s'occuper de tout le reste. Pas de serveurs, pas de tracas, juste du code propre et événementiel.

Pour la plupart d'entre nous, AWS Lambda a été notre premier aperçu de ce rêve. Mais aussi puissant soit-il, ce n'est pas toujours l'outil parfait pour le travail. Ce guide s'adresse à tous ceux qui ont atteint les limites de Lambda et ont commencé à se demander : « qu'est-ce qui existe d'autre ? » Nous allons examiner les meilleures alternatives à Lambda de 2025 et analyser quelle plateforme pourrait être la mieux adaptée pour vous, en fonction de ce que vous valorisez le plus, que ce soit la performance, le coût, ou simplement un processus de développement plus fluide.

Qu'est-ce qu'AWS Lambda, et pourquoi cherche-t-on des alternatives ?

AWS Lambda est en quelque sorte la plateforme FaaS originale. C'est un service sans serveur, piloté par les événements, qui vous permet d'exécuter du code pour à peu près n'importe quoi sans avoir à vous soucier des serveurs. Vous téléchargez votre fonction, et Lambda s'occupe de la mise à l'échelle et de la disponibilité. Il est célèbre pour son intégration étroite avec le reste du monde AWS et son modèle de « paiement à l'usage ».

Mais comme tout outil qui se veut une solution universelle, il a ses défauts. Au fil des ans, quelques frustrations courantes ont poussé les développeurs à chercher des alternatives à Lambda :

-

Ce délai de 15 minutes. Les fonctions Lambda ne peuvent s'exécuter que pendant un maximum de 15 minutes. Si vous essayez de traiter un grand ensemble de données, d'exécuter une tâche ETL complexe ou d'entraîner un modèle d'apprentissage automatique, c'est une limite stricte qui peut tuer votre flux de travail.

-

Le redoutable démarrage à froid. Si votre fonction n'a pas été appelée depuis un certain temps, il peut lui falloir quelques secondes pour « se réveiller » avant de s'exécuter. Ce délai, le démarrage à froid, est un énorme problème pour les applications destinées aux utilisateurs où vous avez besoin d'une réponse instantanée.

-

Les factures déroutantes. La tarification de Lambda est basée sur une métrique appelée Go-secondes, plus le nombre de requêtes, et des frais supplémentaires pour d'autres services comme API Gateway. Cela rend la prévision de vos coûts très difficile, et de nombreuses équipes ont été surprises par une facture bien plus élevée que prévu à la fin du mois.

-

Le sentiment d'être enfermé. Lambda est conçu pour fonctionner à merveille avec les autres services AWS. C'est génial, jusqu'à ce que vous vouliez passer à un autre fournisseur de cloud ou essayer une configuration multi-cloud. C'est alors que vous réalisez à quel point vous êtes empêtré dans l'écosystème AWS.

-

L'expérience développeur peut être laborieuse. Soyons honnêtes, les tests et les déploiements en local ne sont pas toujours fluides. On se retrouve souvent à jongler avec des outils complexes comme Terraform ou AWS SAM, ce qui ajoute une couche de travail opérationnel que le serverless était censé éliminer.

Comment nous avons choisi les meilleures alternatives à Lambda

Pour déterminer ce qui vaut vraiment votre temps, j'ai examiné chaque plateforme du point de vue d'un développeur. Il ne s'agit pas seulement de ce qui est beau sur une liste de fonctionnalités ; il s'agit de ce que l'on ressent en construisant et en livrant réellement du code.

-

Expérience développeur : À quelle vitesse pouvez-vous passer d'une nouvelle idée à une fonction déployée ? Les tests en local sont-ils simples, ou donnent-ils envie de s'arracher les cheveux ?

-

Performance : Comment gère-t-elle réellement les démarrages à froid et la latence ?

-

Modèle de tarification : La tarification est-elle facile à comprendre ? Pouvez-vous monter en charge sans vous soucier d'une facture surprise ?

-

Flexibilité et cas d'utilisation : Peut-elle gérer des conteneurs ? Qu'en est-il des tâches plus longues ou des tâches spécifiques comme les charges de travail d'IA ?

Une comparaison rapide des meilleures alternatives à Lambda en 2025

| Caractéristique | Google Cloud Functions | Azure Functions | Cloudflare Workers | Google Cloud Run | OpenFaaS (Auto-hébergé) |

|---|---|---|---|---|---|

| Idéal pour | Tâches générales | Équipes dans l'écosystème Azure | Logique en périphérie à très faible latence | Applications conteneurisées | Contrôle total et flexibilité |

| Délai max. | 9 minutes | 10 minutes (plan Consommation) | 10ms - 30s | 60 minutes | Illimité |

| Démarrages à froid | Modérés | Modérés à élevés | Pratiquement nuls | Faibles (avec instances min.) | Dépend de la configuration |

| Modèle de tarification | Par invocation et calcul | Par invocation et calcul | Par requête | Par vCPU-seconde et mémoire | Coût de votre infrastructure |

| Support des conteneurs | Gen 2 uniquement | Oui | Non (basé sur WASM) | Oui (Principal) | Oui (Principal) |

Les 5 meilleures alternatives à AWS Lambda pour les développeurs en 2025

Après avoir passé du temps avec chacune de ces plateformes, voici mon avis sur les meilleures options serverless disponibles aujourd'hui.

1. Google Cloud Functions

Google Cloud Functions est le concurrent direct d'AWS Lambda chez Google. C'est une plateforme FaaS sans fioritures qui vous permet d'exécuter votre code en fonction d'événements sans vous soucier des serveurs. Dernièrement, Google l'a davantage intégrée à Cloud Run, ce qui rend leur offre serverless globale plus connectée et puissante.

Pourquoi c'est une bonne alternative : D'emblée, son niveau gratuit est bien plus généreux que celui de Lambda, vous offrant 2 millions d'invocations gratuites par mois. La configuration d'un simple déclencheur HTTP semble également beaucoup plus simple que de se battre avec l'API Gateway d'AWS. Si vous utilisez déjà des services Google Cloud comme Pub/Sub ou Firestore, c'est un choix naturel.

Avantages et inconvénients :

-

Avantages : Un excellent niveau gratuit, fonctionne de manière transparente avec d'autres services GCP, et la configuration des points de terminaison HTTP est simple.

-

Inconvénients : Le délai d'exécution maximal est un peu plus court que celui de Lambda, à 9 minutes, et vous devez toujours faire face aux démarrages à froid, bien que Google y ait travaillé.

Tarification : Google Cloud Functions vous offre un niveau gratuit perpétuel avec 2 millions d'invocations, 400 000 Go-secondes de mémoire et 200 000 GHz-secondes de temps de calcul par mois. Une fois que vous dépassez cela, vous payez pour ce que vous utilisez en fonction des invocations, du temps de calcul, de la mémoire et des données sortantes.

2. Azure Functions

Azure Functions est l'acteur de Microsoft dans le domaine du serverless. C'est un choix vraiment solide et flexible, surtout si votre équipe vit déjà dans le monde de Microsoft et Azure. Il a une approche très orientée développeur d'entreprise, avec d'excellents outils dans Visual Studio.

Pourquoi c'est une bonne alternative : La fonctionnalité phare est ce qu'on appelle les « Durable Functions ». Cette extension vous permet d'écrire des fonctions avec état (stateful) de manière serverless, ce qui est fantastique pour coordonner des processus complexes et de longue durée sans avoir à gérer l'état vous-même. Il propose également différents plans d'hébergement, y compris un plan Premium qui maintient les instances « chaudes » pour éliminer complètement les démarrages à froid.

Avantages et inconvénients :

-

Avantages : Un support unique pour les flux de travail avec état grâce aux « Durable Functions », des plans flexibles pour éliminer les démarrages à froid, et des outils incroyables pour les développeurs C# et .NET.

-

Inconvénients : La plateforme peut sembler un peu compliquée si vous n'êtes pas déjà un expert d'Azure. Le plan de base « Consommation » peut avoir des délais de démarrage à froid assez notables.

Tarification : Azure Functions inclut un crédit gratuit de 1 million de requêtes et 400 000 Go-secondes d'utilisation des ressources chaque mois. Il dispose de trois plans principaux :

-

Plan Consommation : Le modèle standard de paiement à l'usage qui se met à l'échelle automatiquement.

-

Plan Premium : Vous offre des instances pré-chauffées pour éviter les démarrages à froid et un meilleur matériel, mais vous payez pour les instances actives.

-

Plan Dédié (App Service) : Exécute vos fonctions sur des machines dédiées, ce qui est bon pour les charges de travail lourdes et prévisibles.

3. Cloudflare Workers

Cloudflare Workers est un outil totalement différent. Au lieu de s'exécuter dans un grand centre de données, votre code s'exécute sur le vaste réseau mondial de points de présence (edge) de Cloudflare, il est donc physiquement plus proche de vos utilisateurs. Il n'utilise pas de conteneurs ou de VM ; il utilise des V8 Isolates (la technologie derrière le navigateur Chrome), ce qui signifie que les démarrages à froid sont presque inexistants.

Pourquoi c'est une bonne alternative : Si la latence est votre ennemie, Workers est votre meilleur ami. C'est parfait pour les choses où la vitesse est primordiale, comme les tests A/B, les middlewares d'API ou la gestion de l'authentification. Comme il s'exécute en périphérie, vous pouvez intercepter et modifier les requêtes avant même qu'elles n'atteignent votre serveur principal, ce qui est incroyablement puissant.

Avantages et inconvénients :

-

Avantages : Les démarrages à froid ne sont pas un problème, votre code est automatiquement distribué dans le monde entier pour une faible latence, et la tarification est simple et basée sur les requêtes.

-

Inconvénients : Le temps d'exécution est très court (pensez en millisecondes de temps CPU, pas en secondes), donc ce n'est pas pour les tâches lourdes. Il est également principalement axé sur JavaScript/TypeScript et WebAssembly (WASM).

Tarification : Cloudflare propose un plan gratuit vraiment généreux avec 100 000 requêtes par jour. Le plan payant est super simple :

-

Requêtes : 0,30 $ par million de requêtes.

-

Temps CPU : 0,02 $ par million de millisecondes CPU.

Il n'y a pas de calculs étranges en Go-secondes ou de frais supplémentaires pour une passerelle API, donc vos coûts sont très faciles à prévoir.

4. Google Cloud Run

Alors que Google Cloud Functions est pour les extraits de code, Google Cloud Run est pour les conteneurs. Cette seule différence en fait l'une des plateformes serverless les plus flexibles du marché. Vous pouvez empaqueter n'importe quelle application, dans n'importe quel langage, avec n'importe quelles dépendances dans un conteneur Docker, et Cloud Run se chargera de l'exécuter et de la mettre à l'échelle, y compris jusqu'à zéro.

Pourquoi c'est une bonne alternative : Cloud Run résout deux des plus gros maux de tête de Lambda. Premièrement, le délai d'expiration maximal des requêtes est de 60 minutes complètes, il est donc idéal pour les tâches plus longues. Deuxièmement, puisque vous apportez votre propre conteneur, vous n'êtes pas limité par les environnements d'exécution pris en charge par une plateforme FaaS. Vous pouvez exécuter un serveur web complet, un script de traitement de données, tout ce que vous pouvez mettre dans un conteneur.

Avantages et inconvénients :

-

Avantages : Super flexible car vous pouvez utiliser des conteneurs personnalisés, un délai d'exécution beaucoup plus long de 60 minutes, une mise à l'échelle jusqu'à zéro pour économiser de l'argent, et peut être configuré avec des instances minimales pour n'avoir aucun démarrage à froid.

-

Inconvénients : Vous devez être à l'aise avec Docker et les conteneurs. Cela peut aussi être un peu plus cher que le FaaS si vous ne le configurez pas soigneusement.

Tarification : La tarification de Cloud Run est basée sur le vCPU et la mémoire que votre conteneur utilise chaque seconde. Il y a un solide niveau gratuit chaque mois qui comprend 180 000 vCPU-secondes et 360 000 Gio-secondes de mémoire. Au-delà, vous êtes facturé pour les ressources exactes que vous utilisez, à la centaine de millisecondes près.

5. OpenFaaS (Auto-hébergé)

Pour tous ceux qui veulent échapper complètement au verrouillage propriétaire, OpenFaaS est le principal framework open-source pour exécuter du serverless sur votre propre matériel. Vous le déployez sur un cluster Kubernetes, que ce soit dans votre propre centre de données ou chez un fournisseur de cloud, vous donnant un contrôle total.

Pourquoi c'est une bonne alternative : Avec OpenFaaS, vous bénéficiez des avantages du serverless sans être coincé avec une seule entreprise de cloud. Cela peut être l'option la moins chère si vous opérez à grande échelle, car vous ne payez que pour votre propre infrastructure. Vous décidez de tout en ce qui concerne les délais d'exécution, les environnements d'exécution et la sécurité.

Avantages et inconvénients :

-

Avantages : Pas de verrouillage propriétaire, fonctionne partout où vous avez Kubernetes, il est très personnalisable et peut être l'option la moins chère à grande échelle.

-

Inconvénients : Le gros inconvénient est le travail que cela implique. Vous êtes responsable de la gestion, de la sécurisation et de la mise à l'échelle du cluster Kubernetes sous-jacent, et c'est un travail d'ingénierie sérieux.

Tarification : Le framework OpenFaaS lui-même est gratuit. Votre coût est ce que vous payez pour l'infrastructure sur laquelle il fonctionne. Pour les entreprises qui ont besoin de fonctionnalités supplémentaires et de support, il existe une version commerciale appelée OpenFaaS Pro.

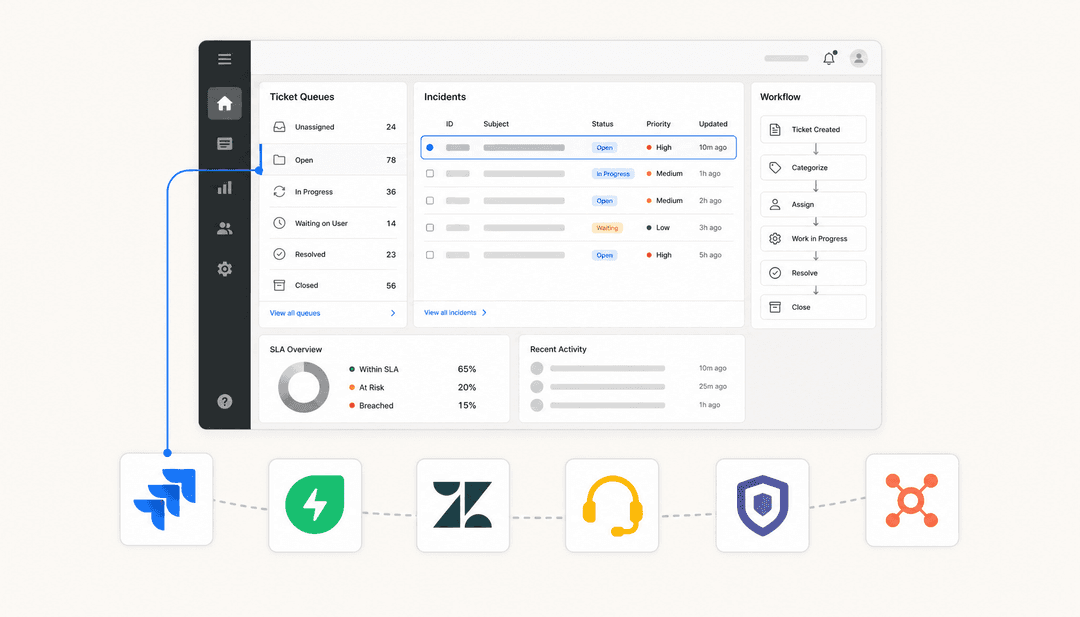

Vous construisez un bot de support IA ? Considérez l'alternative « acheter vs construire »

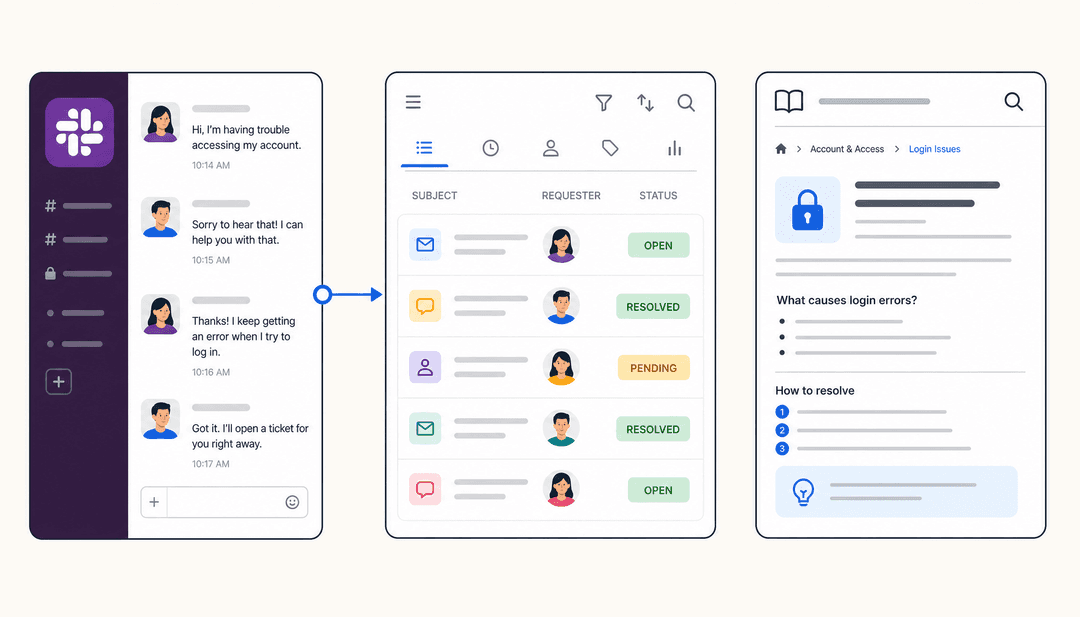

Beaucoup d'entre nous se tournent vers les plateformes serverless pour construire des outils internes, comme un bot IA qui peut aider avec les tickets de support client. Les plateformes que nous venons de couvrir en sont tout à fait capables. Mais cela soulève une grande question : devriez-vous vraiment le construire à partir de zéro ?

Vous pourriez le construire vous-même. Cela signifie écrire des fonctions, mettre en place des pipelines de données vers vos bases de connaissances, créer des déclencheurs depuis votre centre d'assistance et peaufiner les prompts de l'IA. C'est un projet assez important qui nécessite beaucoup de connaissances sur les systèmes serverless, l'intégration de données et l'IA, sans parler de tout le travail pour le maintenir en fonctionnement.

Ou, vous pourriez acheter une solution déjà conçue pour ce problème exact. C'est là qu'une plateforme spécialisée peut vous faire économiser énormément de temps et de maux de tête.

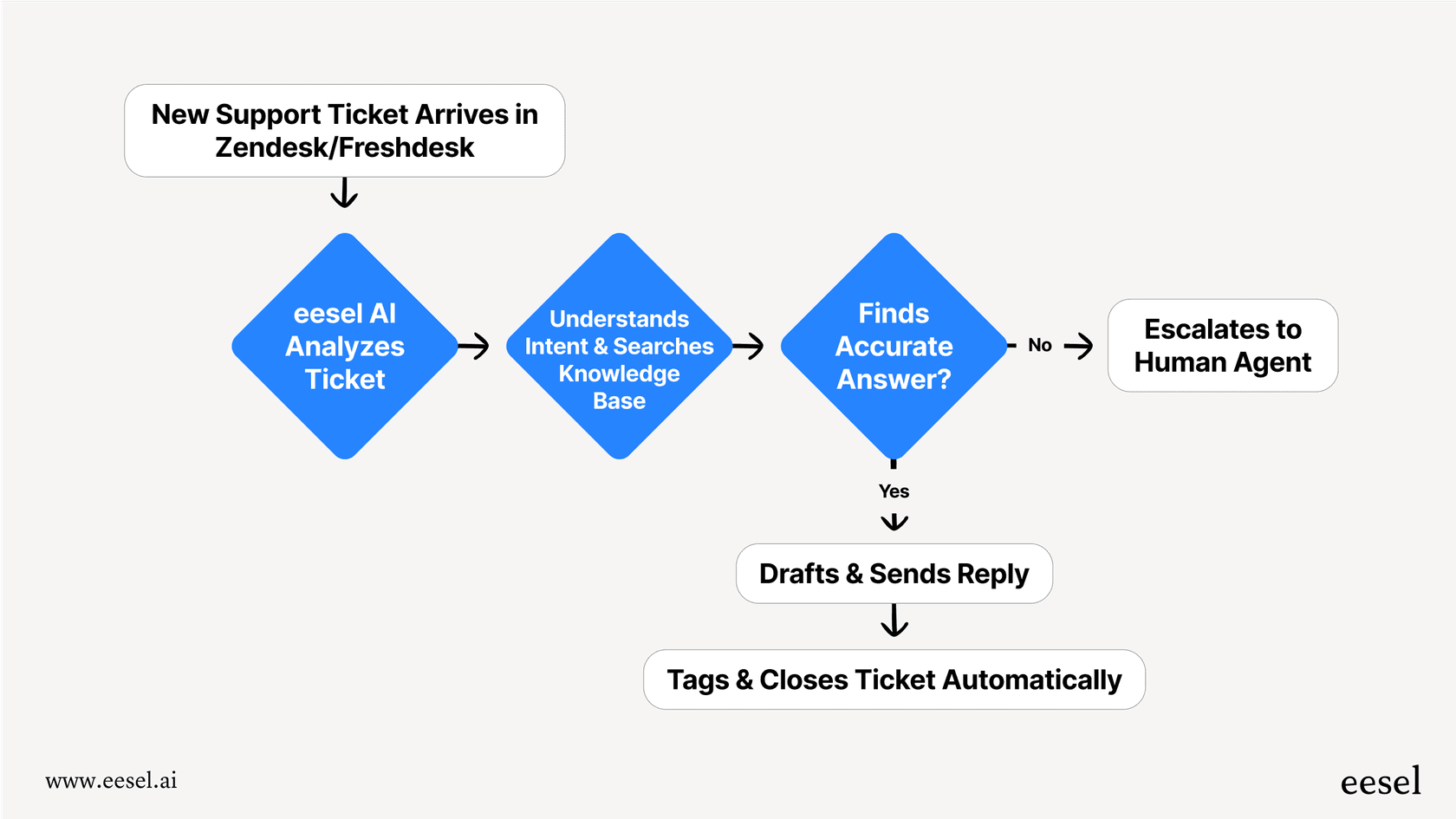

Au lieu de passer des mois à configurer des fonctions serverless et des pipelines de données, des outils comme eesel AI peuvent vous rendre opérationnel en quelques minutes. Il se connecte directement à votre centre d'assistance existant, comme Zendesk ou Freshdesk, et se connecte à vos sources de connaissances en quelques clics.

Plutôt que de coder des actions personnalisées, vous disposez d'un puissant constructeur de flux de travail sans code pour dire à votre agent IA exactement quoi faire, de la recherche d'une commande dans Shopify à la création d'un nouveau ticket dans Jira.

Le meilleur de tout, c'est que vous pouvez tester comment l'IA se comportera sur des milliers de vos anciens tickets avant qu'elle n'interagisse avec un vrai client, afin que vous puissiez être confiant lors du lancement.

Quelques conseils pour choisir les bonnes alternatives à Lambda

Choisir la bonne plateforme dépend vraiment de ce que vous construisez et de qui fait partie de votre équipe. Voici quelques dernières réflexions :

-

Pro tip

N'utilisez pas un marteau pour casser une noix. Pour des tâches rapides et à faible latence en périphérie, Cloudflare Workers est difficile à battre. Pour une application web complexe que vous souhaitez conteneuriser, Google Cloud Run est un choix parfait.

-

Pensez à votre stack technologique actuelle. Si votre équipe est déjà entièrement investie dans Google Cloud ou Azure, utiliser leurs outils serverless natifs est généralement la voie la plus simple. Les intégrations sont déjà là, et votre équipe n'aura pas à apprendre un tout nouvel environnement.

-

N'oubliez pas les coûts cachés du « gratuit ». Un outil auto-hébergé comme OpenFaaS n'a peut-être pas de frais de licence, mais les heures d'ingénierie que vous passerez à gérer un cluster Kubernetes sont un coût très réel.

-

Réfléchissez bien à la question « acheter vs construire ». Pour des problèmes courants comme l'automatisation du support client, un outil spécialisé vous permet souvent d'atteindre votre objectif plus rapidement et avec moins de problèmes que de construire quelque chose de personnalisé à partir de zéro.

Le monde du serverless regorge d'excellentes alternatives à Lambda

Bien qu'AWS Lambda ait sans conteste lancé la révolution du serverless et reste un géant, le monde regorge désormais d'alternatives étonnantes à Lambda qui sont souvent bien mieux adaptées à certains types de projets. Que vous ayez besoin d'un temps de réponse instantané en périphérie, de la flexibilité des conteneurs ou de la liberté totale de l'auto-hébergement, il existe un outil qui vous convient.

La meilleure plateforme est celle qui vous aide à livrer du code plus rapidement et de manière plus fiable. Pour le développement à usage général, les plateformes ci-dessus sont d'excellents points de départ. Mais si votre objectif est de construire un système de support IA exceptionnel sans toute la charge de développement, découvrez comment eesel AI peut vous aider à y parvenir en quelques minutes.

Foire aux questions

Les développeurs cherchent souvent des alternatives à Lambda en raison de problèmes tels que des démarrages à froid importants, des limites d'exécution strictes de 15 minutes, des structures de coûts déroutantes et des préoccupations concernant la dépendance vis-à-vis du fournisseur au sein de l'écosystème AWS. Ces frustrations peuvent avoir un impact sur les performances, la prévisibilité et l'efficacité globale du développement.

Lors de l'évaluation des alternatives à Lambda, privilégiez l'expérience développeur pour la facilité d'utilisation et les tests locaux, ainsi que les performances en ce qui concerne les démarrages à froid et la latence. Examinez également attentivement le modèle de tarification pour sa prévisibilité et sa transparence, ainsi que la flexibilité de la plateforme pour vos cas d'utilisation spécifiques, tels que le support des conteneurs ou l'exécution de tâches plus longues.

Pour les applications nécessitant une latence extrêmement faible et du edge computing, Cloudflare Workers est un choix exceptionnel parmi les alternatives à Lambda. Son architecture unique basée sur V8 Isolate garantit des démarrages à froid quasi nuls et distribue votre code à l'échelle mondiale pour une proximité optimale avec l'utilisateur.

Si votre projet nécessite des temps d'exécution plus longs ou la flexibilité des conteneurs, Google Cloud Run et Azure Functions (avec support des conteneurs) sont de solides alternatives à Lambda. Cloud Run permet d'utiliser des conteneurs personnalisés avec un délai d'exécution allant jusqu'à 60 minutes, tandis qu'Azure Functions prend en charge les conteneurs et les flux de travail avec état. OpenFaaS offre également des délais d'exécution illimités et un support des conteneurs pour les solutions auto-hébergées.

Les modèles de tarification des alternatives à Lambda varient, certains visant une plus grande prévisibilité que les Go-secondes de Lambda. Cloudflare Workers utilise une facturation simple basée sur les requêtes et le temps CPU, tandis que Google Cloud Run facture par vCPU-seconde et utilisation de la mémoire. Azure Functions propose divers plans, y compris des options de consommation et premium, chacun avec des implications de coût différentes.

Pour éviter la dépendance vis-à-vis d'un fournisseur ou obtenir un contrôle total, OpenFaaS (Auto-hébergé) est une option open-source de premier choix parmi les alternatives à Lambda, vous permettant de déployer sur n'importe quel cluster Kubernetes. Google Cloud Run offre également une flexibilité significative en vous laissant apporter vos propres conteneurs Docker personnalisés, réduisant ainsi la dépendance à des environnements d'exécution FaaS spécifiques.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.