Alors, le GPT-5 Pro d'OpenAI est arrivé, et on dirait que tout le monde en parle. Il est présenté comme le modèle le plus puissant, de « qualité recherche » du marché, promettant de repousser les limites du raisonnement et de la précision de l'IA pour les développeurs et les entreprises.

Mais qu'est-ce que cela signifie vraiment pour vous ? Cet article examine sans détour ce que GPT-5 Pro peut faire lorsque vous l'utilisez via l'API. Nous allons dépasser le battage marketing pour analyser ses performances réelles, décortiquer ses coûts étonnamment élevés et déterminer dans quels cas son utilisation est judicieuse (et dans quels cas elle ne l'est pas).

Tout se résume à une seule question : ce nouvel outil puissant est-il le bon choix pour votre entreprise ? Ou est-ce un moteur coûteux et tout simplement trop compliqué à intégrer ? Penchons-nous sur les derniers avis concernant l'API de GPT-5 Pro pour le découvrir.

Qu'est-ce que GPT-5 Pro ?

Allons droit au but : GPT-5 Pro est le modèle poids lourd d'OpenAI. Il est conçu pour les tâches où la justesse est primordiale, exigeant le plus haut niveau de précision et de pensée logique.

Le « Pro » n'est pas juste une étiquette ; cela signifie que le modèle utilise beaucoup plus de puissance de calcul pour « réfléchir » à une requête avant de vous donner une réponse.

Le compromis ? Il coûte plus cher et est nettement plus lent que des modèles comme GPT-4o.D'après ce que disent les utilisateurs dans les avis sur des [forums comme Reddit](https://www.reddit.com/r/ChatGPTPro/comments/1mzcboj/how_good_is_the_chatgpt_5pro_model_the_one_with/), cela conduit à des réponses plus précises.

Il est clairement conçu pour les travaux à forts enjeux. Avec une fenêtre de contexte massive de 400 000 tokens, vous pouvez y accéder via un abonnement ChatGPT Pro à 200 $/mois pour un usage individuel. Plus important encore pour les entreprises, il est disponible en tant que modèle de paiement à l'utilisation dans l'API.

-

Idéal pour : Les secteurs à enjeux élevés comme la finance, le droit et la santé, ainsi que le développement de logiciels complexes et la recherche approfondie.

-

Caractéristiques clés : Raisonnement avancé, un risque beaucoup plus faible d'inventer des informations (hallucinations) et une excellente capacité à suivre les instructions.

-

Accès : Disponible dans l'interface ChatGPT Pro pour l'expérimentation, et directement via l'API d'OpenAI pour l'intégrer dans vos propres outils.

Performances et benchmarks

J'ai vu certains avis décrire les performances de GPT-5 Pro comme étant « en dents de scie », et cela me semble assez juste. Bien qu'il batte des records dans de nombreux tests académiques, il n'est pas automatiquement « meilleur » en tout. C'est un outil spécialisé, brillant pour le travail d'analyse approfondi, mais souvent excessif pour des conversations plus simples où un modèle plus rapide et moins cher ferait parfaitement l'affaire.

Voyons ce que ces scores de benchmark signifient réellement pour votre entreprise.

Avancées en matière de raisonnement et de mathématiques

Si vous avez besoin d'une IA douée pour les chiffres et la logique, c'est probablement celle-ci. Elle obtient des scores quasi parfaits sur des benchmarks de mathématiques avancées comme AIME et HMMT. Par exemple, des benchmarks récents de Vellum.ai montrent qu'elle atteint un score parfait de 100 % au test AIME 2025 lorsqu'elle est autorisée à utiliser des outils Python.

Pour vous, cela signifie que vous pouvez vous appuyer davantage sur elle pour des tâches comme l'analyse financière, la modélisation de données et la recherche scientifique. Ses performances sur des tests de raisonnement comme GPQA, qui utilise des questions de niveau doctorat, montrent qu'elle commet moins d'erreurs logiques lorsque vous lui demandez de résumer des documents techniques denses.

Capacités de codage de pointe

Pour quiconque écrit du code, GPT-5 Pro semble assez impressionnant. Il est en tête des benchmarks de codage comme SWE-bench, qui teste la capacité d'une IA à résoudre des problèmes concrets de GitHub. Les utilisateurs rapportent qu'il écrit un code plus cohérent, produit moins de bugs du premier coup et peut s'attaquer à des requêtes complexes d'architecture logicielle que les anciens modèles ne sauraient pas gérer.

Mais tout n'est pas rose. Les développeurs sur les fils de discussion Reddit sont prompts à souligner une limite assez importante : l'API a une limite de 49 000 tokens par message. Si vous travaillez avec une grande base de code, c'est un vrai casse-tête. Vous ne pouvez pas simplement lui fournir un dépôt entier pour analyse. Vous êtes donc obligé d'utiliser des solutions de contournement comme la Génération Augmentée par Récupération (RAG), ce qui peut parfois compromettre les performances mêmes pour lesquelles vous payez un supplément.

Fiabilité et sécurité : une nouvelle norme

Ce qui fait vraiment tourner les têtes, c'est la fiabilité de GPT-5 Pro. Il a un taux considérablement plus faible d'invention d'informations ou d'erreurs factuelles, en particulier sur des sujets sensibles. Sur HealthBench, un benchmark pour les questions médicales, son taux d'erreur n'est qu'une fraction de ce que nous avons vu avec les modèles précédents.

Mais avoir un modèle plus intelligent ne résout pas tout comme par magie. Comment vous assurer que cette précision est utilisée en toute sécurité, reste fidèle à la voix de votre marque et est adaptée aux connaissances spécifiques de votre entreprise ? Vous avez toujours besoin d'une manière intelligente d'appliquer cette précision.

Le coût réel : ce que disent les avis

La plupart des avis sur l'API de GPT-5 Pro mentionnent le prix, et oui, c'est une petite douche froide. Sa puissance a un coût qui vous fait réfléchir à deux fois, pas seulement mettre à niveau sans y penser.

Vous pouvez y accéder de deux manières, chacune avec son propre modèle de coût.

L'abonnement ChatGPT Pro

Pour les particuliers ou les petites équipes, l'abonnement à 200 $/mois par utilisateur vous donne un accès interactif. C'est parfait pour des tâches ponctuelles à haute valeur ajoutée comme la recherche approfondie ou la création de contenu détaillé. Mais il n'a pas été conçu pour être intégré dans des applications, et payer par utilisateur devient incroyablement cher si vous voulez le déployer à une équipe, par exemple pour le support client.

Tarification de l'API et coûts cachés

Si vous développez des applications, vous utiliserez l'API, et c'est là que les coûts peuvent devenir un peu fous. Selon les données de OpenRouter, la tarification représente un bond énorme par rapport aux anciens modèles : 15 $ pour chaque million de tokens d'entrée et un énorme 120 $ pour chaque million de tokens de sortie.

Voici une comparaison rapide avec d'autres modèles populaires :

| Modèle | Coût d'entrée / 1M de tokens | Coût de sortie / 1M de tokens |

|---|---|---|

| GPT-5 Pro | 15,00 $ | 120,00 $ |

| GPT-4o | 2,50 $ | 10,00 $ |

| Claude 4.1 Opus | 15,00 $ | 75,00 $ |

Cependant, voici le hic : ce coût par token n'est que le début. Pour construire une application réelle et fonctionnelle avec l'API GPT-5 Pro, vous devez également prendre en compte le coût du temps d'ingénierie pour la conception des prompts, la logique des flux de travail, l'intégration des connaissances et les tests interminables.

C'est pourquoi penser au coût différemment peut faire une grande différence. Au lieu de payer par token, des plateformes comme eesel AI proposent des plans clairs et prévisibles qui ne vous facturent pas pour chaque résolution. C'est une bouée de sauvetage pour les équipes de support client, où le nombre de tickets peut varier considérablement d'un jour à l'autre. Vous bénéficiez des avantages d'un modèle de premier ordre sans craindre une facture surprise exorbitante.

Cas d'utilisation pratiques et défis

La puissance brute de GPT-5 Pro est excellente pour certaines tâches où la précision est primordiale et où le coût élevé en vaut la peine : recherche approfondie, modélisation financière, analyse de documents juridiques et génération de code complexe.

Mais pour quelque chose de rapide et dynamique comme le support client, utiliser l'API brute, c'est comme recevoir un moteur de Formule 1 sur le pas de votre porte avec une note disant « bonne chance ». Le moteur est incroyable, mais il vous reste à construire le châssis, la direction et à trouver un pilote qui sait ce qu'il fait. Et c'est généralement là que les choses se compliquent.

Défis de mise en œuvre

- Connecter vos connaissances : GPT-5 Pro part d'une page blanche. Il ne connaît rien à la politique de retour de votre entreprise, à la manière de dépanner votre produit ou à ce qu'un client a dit la semaine dernière. Obtenir ces informations depuis des sources comme Confluence, Google Docs ou votre historique Zendesk signifie construire et maintenir vos propres systèmes RAG complexes.

- Définir ce qu'il peut faire : Le modèle est excellent pour écrire du texte, mais il ne peut pas trier un ticket, ajouter les bonnes étiquettes ou rechercher une commande dans Shopify tout seul. Chacune de ces « actions » doit être codée, testée et gérée par votre équipe d'ingénieurs.

- Tester le tout en toute sécurité : Comment tester une IA puissante et coûteuse sur des conversations client en direct sans provoquer le chaos ? Avec l'API brute, il n'y a pas de « mode d'entraînement ». Vous testez pratiquement dans un environnement en direct, ce qui est à la fois risqué et coûteux.

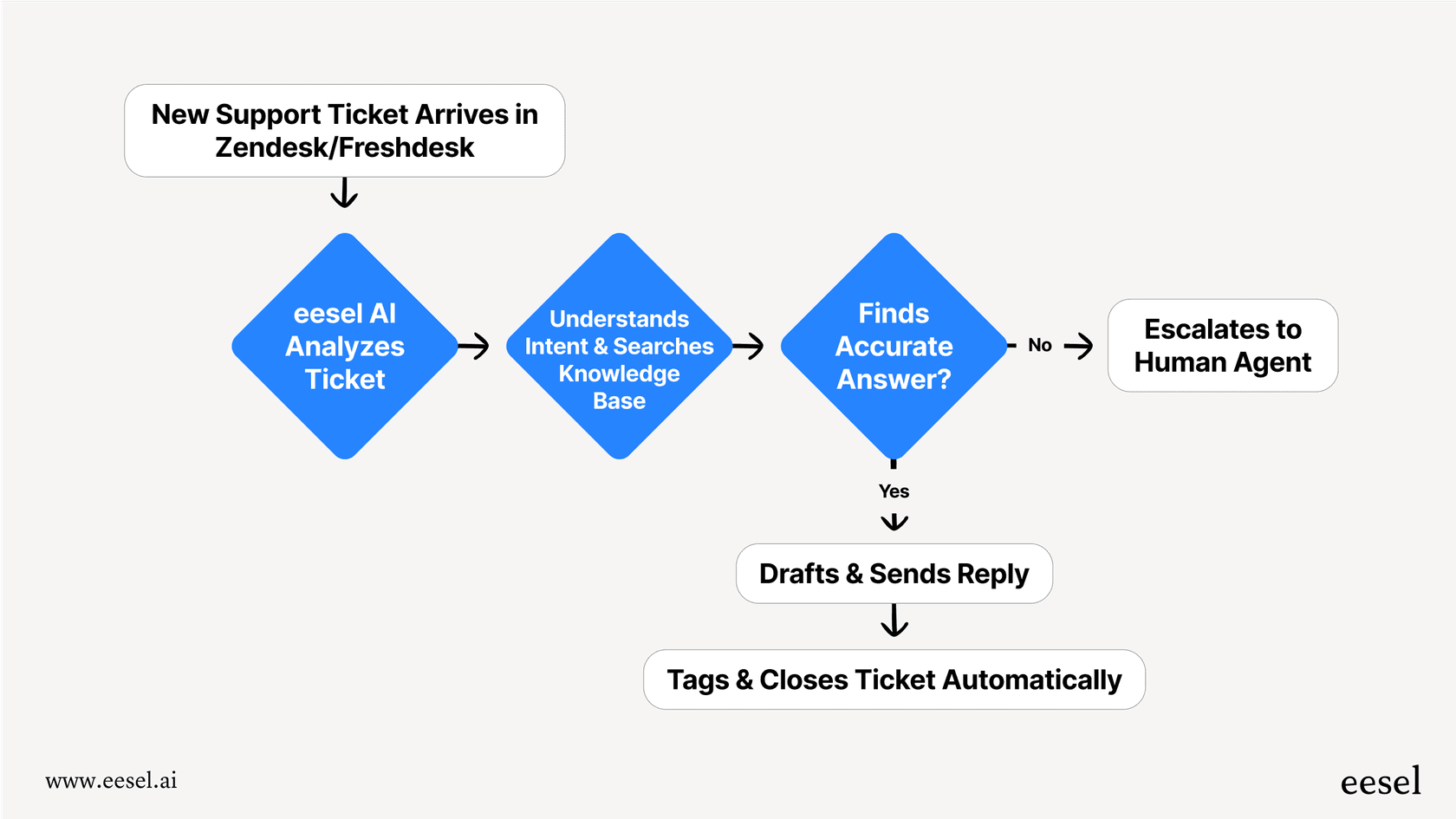

C'est exactement le vide que des outils comme eesel AI sont conçus pour combler. Pensez à eesel AI comme au reste de la voiture, la partie qui rend le moteur puissant utile pour les équipes de support.

Au lieu d'un projet de développement de plusieurs mois, vous pouvez résoudre ces problèmes immédiatement :

-

Connaissances unifiées : Avec des intégrations en un clic, vous pouvez connecter en toute sécurité toutes vos sources de connaissances en un clin d'œil. eesel AI s'entraîne même sur vos anciens tickets pour apprendre automatiquement la voix de votre marque et les solutions courantes.

-

Actions personnalisables : Notre créateur de flux de travail sans code vous permet de définir exactement comment vous voulez que l'IA se comporte. Vous pouvez créer des règles pour savoir quand escalader un ticket, à qui l'envoyer ou comment vérifier le statut d'une commande via un autre outil.

-

Mode simulation : C'est particulièrement utile. Avant de passer en production, vous pouvez exécuter votre configuration d'IA sur des milliers de vos anciens tickets. Cela vous donne une prévision claire de ses performances et de son taux de résolution, afin que vous puissiez lancer en toute confiance.

-

Mise en service en quelques minutes : L'idée est de vous rendre opérationnel en quelques minutes, en toute autonomie. Cela transforme un projet d'ingénierie massif en un simple processus de configuration.

Un moteur puissant qui a besoin d'un véhicule

Il ne fait aucun doute que l'API de GPT-5 Pro représente une avancée majeure dans les capacités de l'IA. C'est un moteur très puissant. Mais pour la plupart des entreprises, en particulier pour une tâche comme le support client, cette puissance brute est difficile à gérer seule en raison du coût élevé et du travail technique impliqué.

Pour vraiment tirer le meilleur parti de modèles comme celui-ci, vous avez besoin d'un système qui dompte cette complexité pour vous. C'est ce que font des plateformes comme eesel AI. Elles fournissent le véhicule, transformant la puissance brute de l'IA en un moteur d'automatisation du support fiable, abordable et entièrement contrôlable que vous pouvez mettre en service en quelques minutes.

Prêt à mettre l'IA la plus puissante du monde au service de votre équipe de support sans les tracas d'ingénierie ? Essayez eesel AI gratuitement.

Questions fréquemment posées

GPT-5 Pro est mis en avant pour sa puissance de « qualité recherche », offrant un raisonnement et une précision inégalés, ainsi qu'un taux d'hallucinations considérablement réduit. Il excelle dans les tâches nécessitant une pensée analytique approfondie, ce qui le rend adapté aux secteurs à enjeux élevés.

Pour les entreprises, la [tarification de l'API est conséquente](https://openai.com/pricing) : 15 $ par million de tokens d'entrée et 120 $ par million de tokens de sortie. C'est nettement plus élevé que d'autres modèles populaires comme GPT-4o.

Il est idéal pour la recherche approfondie, la modélisation financière, l'analyse de documents juridiques et la génération de code complexe où la précision est essentielle. Cependant, pour des interactions plus simples et rapides, son coût élevé et sa lenteur pourraient le rendre excessif.

Les principaux défis incluent la connexion à des bases de connaissances propriétaires, la définition d'actions spécifiques qu'il peut effectuer et le test sécurisé de son comportement en environnement réel. Ces défis nécessitent souvent un effort d'ingénierie important pour être surmontés.

Oui, les avis suggèrent que des [plateformes comme eesel AI peuvent aider](https://www.eesel.ai/fr/blog/how-to-use-ai-helpdesk-tools-to-transform-support). Ces outils fournissent un « véhicule » qui gère la complexité, intègre les connaissances, permet la création de flux de travail sans code et offre une tarification prévisible, rendant l'IA puissante plus accessible et abordable.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.

Les avis saluent ses scores quasi parfaits sur les benchmarks de mathématiques avancées et ses capacités de codage de pointe, résolvant des problèmes concrets de GitHub. Il commet également moins d'erreurs logiques dans les tests de raisonnement de niveau doctorat.