De toutes les récentes actualités sur l'IA, l'arrivée de GPT-5 Pro d'OpenAI a certainement fait des vagues. Il est présenté comme leur modèle de raisonnement le plus puissant à ce jour, un outil sérieux pour s'attaquer à des problèmes vraiment complexes. Mais que signifie concrètement l'utilisation de GPT-5 Pro via l'API pour votre entreprise, surtout si vous souhaitez améliorer votre support client ?

Si vous vous posez cette question, vous êtes au bon endroit. Nous allons aller au-delà de l'engouement médiatique pour vous donner un aperçu pratique de ce qu'est GPT-5 Pro, de ses fonctionnalités clés, de ses coûts étonnamment élevés et des véritables casse-têtes que représente la tentative de créer un outil de support directement avec l'API. Voyons ensemble quand il est judicieux de partir de zéro et quand il est plus malin d'acheter une solution toute faite.

Qu'est-ce que GPT-5 Pro via l'API ?

Mettons une chose au clair : GPT-5 Pro n'est pas simplement une autre version de ChatGPT. C'est le grand modèle de langage haut de gamme d'OpenAI, conçu spécifiquement pour les tâches complexes qui exigent de l'IA qu'elle « réfléchisse » à travers plusieurs étapes avant de donner une réponse.

Il est uniquement disponible via l'API, plus précisément via le point de terminaison « v1/responses », et c'est un modèle complètement différent (et plus puissant) que le « gpt-5 » standard que vous pourriez voir ailleurs. Ses spécifications en disent long sur son utilisation prévue : il dispose d'une immense fenêtre de contexte de 400 000 tokens, mais toute cette puissance de traitement signifie qu'il est lent à répondre. Par défaut, son « reasoning.effort » est réglé sur « high », il est donc toujours en mode de réflexion profonde.

Imaginez-le comme un moteur brut et puissant. C'est une technologie incroyable pour les développeurs qui créent quelque chose de totalement nouveau, mais ce n'est pas une solution prête à l'emploi pour un problème commercial spécifique comme l'automatisation du support client.

Fonctionnalités clés et nouveaux contrôles

La véritable magie de l'utilisation de GPT-5 Pro via l'API réside dans ses capacités avancées et les contrôles précis qui permettent aux développeurs d'ajuster son comportement. Ce sont les éléments de base que vous utiliseriez pour créer une application d'IA sophistiquée.

Raisonnement avancé et tâches multi-étapes

C'est là que GPT-5 Pro se distingue. Il excelle dans les tâches qui nécessitent de décomposer un problème, de planifier les étapes, puis de suivre des instructions complexes. Pour une équipe de support, cela pourrait consister à analyser un ticket technique délicat rempli de journaux d'erreurs, à élaborer une solution en plusieurs étapes, ou même à écrire un extrait de code pour un client. Il est conçu pour les problèmes désordonnés et nuancés que les modèles plus simples ne peuvent tout simplement pas gérer.

Nouveaux paramètres de l'API : verbosity et reasoning_effort

OpenAI a introduit deux nouveaux paramètres qui donnent aux développeurs beaucoup plus de contrôle.

-

« verbosity » : Ce paramètre (« low », « medium » ou « high ») vous permet de décider du niveau de détail de la réponse finale du modèle. Si vous avez besoin d'une réponse rapide et directe, vous pouvez le régler sur « low ». Si vous avez besoin d'une explication complète, étape par étape, « high » est la meilleure option.

-

« reasoning_effort » : Ce paramètre (« minimal », « low », « medium », « high ») indique au modèle la quantité de réflexion à effectuer avant même de commencer à écrire. Comme mentionné, GPT-5 Pro est par défaut sur « high », ce qui le rend si performant, mais aussi si lent.

Ces contrôles sont excellents, mais ils doivent être mis en œuvre et gérés par un développeur via du code. En revanche, des plateformes comme eesel AI vous offrent le même niveau de contrôle sur le ton et les actions de votre IA grâce à un éditeur de prompts simple et sans code. Cela permet aux responsables du support de façonner eux-mêmes la personnalité et le flux de travail de l'IA, sans avoir à toucher à une seule ligne de code.

Sorties structurées et utilisation d'outils

GPT-5 Pro est également très doué pour générer des données structurées comme du JSON et appeler des outils externes (ce que les développeurs appellent « appel de fonction »). C'est indispensable pour tout agent de support utile. Vous ne voulez pas seulement que votre IA parle ; vous avez besoin qu'elle agisse. Cela pourrait signifier récupérer des informations de commande en direct depuis une base de données Shopify, créer un ticket dans Jira, ou mettre à jour le profil d'un client dans votre CRM.

Alors que l'API vous donne les composants de base pour ces actions, une solution comme l'Agent IA d'eesel dispose de ces fonctionnalités prêtes à l'emploi. Elle vous offre un moyen simple de vous connecter à vos outils existants comme Zendesk et de créer des appels API personnalisés, évitant à votre équipe le travail de développement complexe et long nécessaire pour construire ces intégrations à partir de zéro.

Comprendre le coût réel

La puissance de GPT-5 Pro est impressionnante, mais elle a un prix qui est non seulement élevé, mais aussi difficile à prévoir. C'est un enjeu majeur pour n'importe quelle équipe, surtout dans un département soucieux des coûts comme le support client.

Le prix élevé du raisonnement avancé

Ne tournons pas autour du pot : GPT-5 Pro est cher. Un rapide coup d'œil à la tarification officielle d'OpenAI le confirme. Le coût pour les tokens de sortie est 12 fois plus élevé que celui du modèle « gpt-5 » standard.

| Modèle | Entrée (par million de tokens) | Sortie (par million de tokens) |

|---|---|---|

| gpt-5-pro | 15,00 $ | 120,00 $ |

| o3-pro | 20,00 $ | 80,00 $ |

| gpt-5 | 1,25 $ | 10,00 $ |

Et n'oubliez pas, ces prix sont pour un million de tokens. Un seul ticket de support complexe pourrait consommer des milliers de tokens, d'autant plus que toute la « réflexion » en coulisses compte également dans votre facture de tokens de sortie.

Performance, latence et coûts d'essai

Toute cette réflexion ne coûte pas seulement de l'argent ; elle coûte du temps. Dans certains tests préliminaires, le développeur Simon Willison a rapporté qu'une seule requête assez simple à GPT-5 Pro a pris plus de six minutes pour se terminer. Il a également constaté que lui demander de générer une image SVG d'un pélican sur un vélo lui a coûté 1,10 $.

Maintenant, imaginez cela dans un contexte de support. Si vous vouliez voir à quel point votre IA personnalisée pourrait gérer vos anciens chats de support, l'exécuter sur seulement 1 000 anciens tickets pourrait facilement vous coûter plus de 1 000 $ rien qu'en frais d'API, sans garantie que les résultats seront utiles. C'est un pari important et risqué juste pour un essai.

C'est là qu'une plateforme dédiée a un avantage évident. eesel AI dispose d'un puissant mode de simulation qui vous permet de tester votre IA sur des milliers de vos tickets passés réels dans un environnement sécurisé. Vous pouvez voir exactement comment elle aurait répondu, obtenir des prévisions précises sur le nombre de problèmes qu'elle pourrait résoudre, et ajuster son comportement avant qu'elle ne parle à un vrai client. Ceci est associé à la tarification transparente et prévisible d'eesel AI, qui est un forfait mensuel fixe, et non une facturation par ticket résolu. Votre facture n'explosera pas soudainement simplement parce que vous avez eu un mois chargé au support.

La réalité de la création d'une solution de support complète

Utiliser GPT-5 Pro via l'API n'est que la première étape d'un long et coûteux chemin. Transformer cet accès API en une solution de support entièrement fonctionnelle, fiable et intelligente est un énorme projet d'ingénierie.

Il vous faut plus qu'une simple clé API

Pour créer un agent de support qui fonctionne réellement bien, vous devez construire tout un système autour du modèle.

Connectivité des connaissances Tout d'abord, vous avez besoin d'un système pour fournir au modèle les bonnes informations depuis votre base de connaissances. Cela signifie construire et maintenir un système complexe (souvent appelé pipeline RAG) capable de puiser dans toutes vos différentes sources de connaissances.

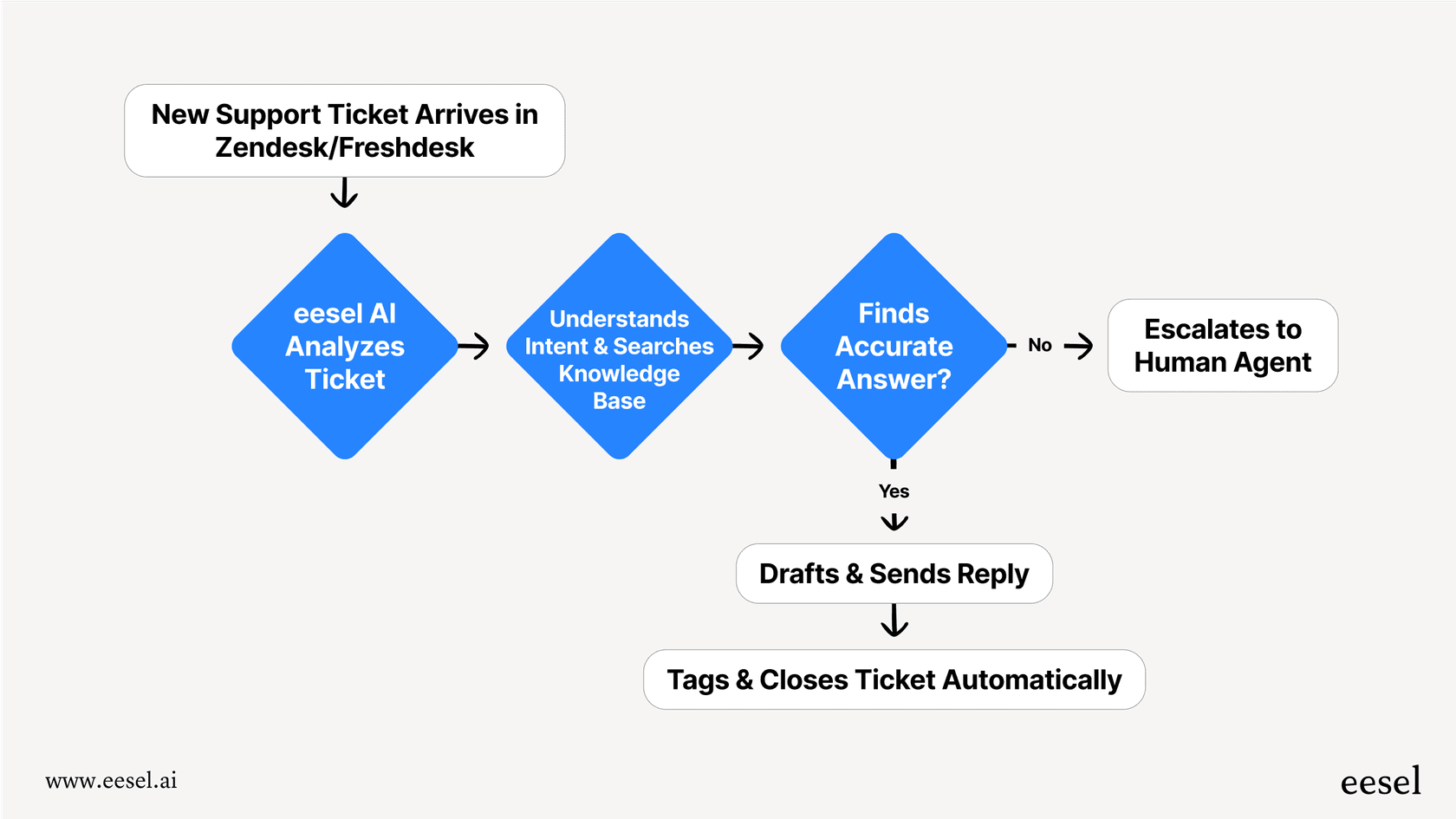

Un moteur de flux de travail Ensuite, vous devez construire la logique qui décide quand l'IA doit répondre, quand elle doit transmettre un ticket à un humain, comment elle doit étiqueter et catégoriser les problèmes, et quels outils externes elle doit utiliser.

Intégrations Puis vient le code personnalisé. Vous devrez écrire des connexions à votre service d'assistance, à vos wikis internes comme Confluence, à vos bases de données de produits, et à tous les autres systèmes sur lesquels votre entreprise s'appuie.

Analyses et rapports Enfin, vous aurez besoin d'un tableau de bord pour suivre les performances de l'IA, voir où elle rencontre des difficultés et déterminer si vous obtenez un retour sur investissement.

Construire tout cela à partir de zéro est un projet qui peut prendre des mois, voire des années, et nécessite une équipe dédiée d'ingénieurs IA coûteux.

L'avantage d'une plateforme : rapidité, contrôle et concentration

C'est là qu'une plateforme comme eesel AI change complètement la donne. Elle vous fournit toutes ces pièces nécessaires prêtes à l'emploi, transformant un projet d'ingénierie massif en un simple processus de configuration.

Avec eesel AI, vous n'avez rien à construire. Vous pouvez utiliser des intégrations en un clic pour connecter instantanément toutes vos connaissances, qu'elles se trouvent dans des tickets passés, votre centre d'aide ou des documents cachés dans Google Docs.

Elle inclut également un moteur de flux de travail entièrement personnalisable qui permet à votre équipe de support, et non à vos ingénieurs, de décider exactement quels tickets sont automatisés et quelles actions l'IA est autorisée à entreprendre.

L'utilisation d'une plateforme libère votre équipe pour qu'elle se concentre sur ce qu'elle fait de mieux : rendre les clients heureux. Vous bénéficiez de la puissance de l'IA la plus récente sans le casse-tête de la construction et de la maintenance de toute la plomberie compliquée qui la fait fonctionner.

GPT-5 Pro via l'API : créer pour le développement, acheter pour le déploiement

GPT-5 Pro via l'API est un outil incroyable pour les développeurs qui créent de toutes nouvelles applications à partir de zéro. Sa puissance de raisonnement ouvre une multitude de nouvelles possibilités.

Cependant, pour une tâche spécifique et à enjeux élevés comme le support client, le coût extrême, la lenteur des performances et l'énorme travail d'ingénierie requis pour construire une solution personnalisée n'ont tout simplement pas de sens pour la plupart des entreprises. Le chemin entre une clé API brute et un agent de support automatisé fiable est long, compliqué et coûteux.

Une plateforme de support IA dédiée vous offre la puissance de modèles comme GPT-5 Pro dans un ensemble plus rapide à déployer, plus économique et conçu spécifiquement pour la façon dont les équipes de support portent.

Prêt à utiliser l'IA de nouvelle génération sans la charge de travail d'ingénierie ? Essayez eesel AI gratuitement et découvrez à quelle vitesse vous pouvez automatiser votre support de première ligne.

Foire aux questions

GPT-5 Pro est [le modèle de raisonnement le plus avancé d'OpenAI](https://platform.openai.com/), disponible exclusivement via l'API, et distinct du « gpt-5 » standard. Il est conçu pour des tâches très complexes et multi-étapes nécessitant une réflexion approfondie, ce qui en fait un moteur brut puissant pour les développeurs.

Ses principaux avantages incluent des capacités de raisonnement avancées pour la résolution de problèmes complexes, la gestion de tâches multi-étapes et la génération de sorties structurées. Il prend également en charge une utilisation sophistiquée d'outils, permettant à l'IA d'[interagir avec des systèmes externes](https://benjamincrozat.com/gpt-5-api) pour des actions comme la récupération de détails de commande ou la création de tickets.

GPT-5 Pro est nettement plus cher que les modèles standards, les tokens de sortie coûtant jusqu'à 12 fois plus cher. Son traitement de « réflexion profonde » est également comptabilisé dans l'utilisation des tokens, ce qui entraîne des coûts élevés, souvent imprévisibles, et des problèmes de latence potentiels, même pour des requêtes simples.

La création d'une solution complète nécessite une ingénierie approfondie, y compris le développement de la connectivité des connaissances (RAG), d'un moteur de flux de travail, d'intégrations personnalisées et d'analyses. Cela peut être un projet de plusieurs mois, voire plusieurs années, nécessitant une équipe dédiée d'ingénieurs IA coûteux.

Bien que puissant, l'effort de raisonnement élevé par défaut de GPT-5 Pro entraîne une latence importante, certaines requêtes prenant plusieurs minutes à se terminer. Cette lenteur le rend généralement inadapté au [support client en temps réel](https://www.eesel.ai/fr/blog/how-to-enable-24-7-customer-support-with-ai-in-2025), où des réponses rapides sont cruciales.

Pour des applications spécifiques et à enjeux élevés comme le [support client](https://www.eesel.ai/fr/blog/best-customer-service-software-2025), une plateforme dédiée est souvent plus judicieuse. Les plateformes fournissent des intégrations pré-construites, des moteurs de flux de travail et des analyses, réduisant considérablement le temps de développement, le coût et la complexité par rapport à une création à partir de zéro avec l'API brute.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.

Le paramètre « verbosity » permet aux développeurs de contrôler le niveau de détail de la réponse de l'IA, allant de réponses rapides à des explications complètes. « Reasoning_effort » dicte la quantité de « réflexion » que le modèle effectue avant de générer une sortie, des réglages plus élevés permettant une analyse plus approfondie mais augmentant le temps de réponse.