Erinnern Sie sich, als OpenAI die ersten Sora-Demos veröffentlicht hat? Das Internet ist quasi zusammengebrochen. Fotorealistische Videos zu sehen, die aus nur wenigen Zeilen Text entstanden sind, fühlte sich an, als hätten wir ein paar Kapitel in einem Science-Fiction-Roman übersprungen. Nun, dieser Hype wird für Entwickler mit der Preview-Veröffentlichung der Sora 2 API langsam zur Realität. Es ist der Sprung von einer atemberaubenden Tech-Demo zu einem Werkzeug, mit dem die Leute tatsächlich anfangen können, etwas zu bauen.

Also, bringen wir es auf den Punkt. Dies ist unser ehrlicher Testbericht darüber, was Sie von der Sora 2 API erwarten können. Wir werden auf die Kernfunktionen eingehen, für wen sie tatsächlich gedacht ist, was sie Sie kosten wird und welche sehr realen Einschränkungen Sie kennen müssen, bevor Sie sich darauf einlassen. Denn obwohl generative Videos ein aufregender neuer Spielplatz sind, sollte man nicht vergessen, dass andere Arten von KI bereits heute sehr praktische Geschäftsprobleme lösen, und darauf werden wir auch eingehen.

Was ist OpenAI's Sora 2?

Kurz gesagt ist Sora 2 das neueste und beste Modell von OpenAI zur Erstellung von Video und Audio aus Text-Prompts oder sogar nur einem einzigen Bild. Es ist ein großer Sprung gegenüber der ersten Version und baut auf dieser atemberaubenden visuellen Qualität mit einigen wichtigen Verbesserungen auf.

Die offizielle Mitteilung von OpenAI besagt, dass die großen neuen Funktionen synchronisiertes Audio, eine bessere Physik und die Fähigkeit sind, mehrere konsistente Aufnahmen in einem Durchgang zu erstellen. Das erste Sora gab uns Stummfilme; Sora 2 erstellt Videos mit Dialogen, Soundeffekten und Hintergrundgeräuschen, die tatsächlich zu dem passen, was auf dem Bildschirm passiert. OpenAI strebt einen „Allzweck-Simulator der physischen Welt“ an, und dies ist ein großer Schritt in diese Richtung.

Nur um das klarzustellen: Dies ist das Videotool von OpenAI. Es hat keinerlei Verbindung zu anderen Tech-Produkten mit demselben Namen, wie dem WebRTC-Server Sora des japanischen Unternehmens Shiguredo. Und obwohl Sora 2 eine unglaublich leistungsstarke kreative Engine ist, ist sie derzeit nur über eine technische API verfügbar. Das bedeutet, dass Sie einige Programmierkenntnisse benötigen, um damit etwas anfangen zu können.

Kernfähigkeiten

Okay, was können Sie also tatsächlich mit der Sora 2 API machen? Es ist viel mehr, als nur einen Satz einzutippen und ein Video zu erhalten. Die API gibt Entwicklern eine überraschende Menge an Kontrolle über das Endprodukt.

Besserer physikalischer Realismus und Konsistenz

Eines der größten verräterischen Merkmale früher KI-Videos war, dass sich die Dinge einfach … falsch anfühlten. Objekte schwebten seltsam, die Physik machte Urlaub und Gegenstände verwandelten sich ohne ersichtlichen Grund in etwas anderes. Sora 2 arbeitet wirklich daran, dies zu beheben. In seinen eigenen Demos zeigt OpenAI einen Basketball, der einen Wurf verfehlt und realistisch vom Brett abprallt, anstatt einfach nur im Netz zu teleportieren.

Das ist eine große Sache für Entwickler. Es bedeutet, dass Sie glaubwürdigere Produktdemos, architektonische Rundgänge oder Trainingssimulationen erstellen können, in denen die Welt sich so verhält, wie sie sollte. Die verbesserte Objektpermanenz und Ursache-Wirkungs-Beziehung lassen die Videos einfach bodenständiger und professioneller wirken.

Synchronisiertes Audio und Dialogerzeugung

Das ist vielleicht das wichtigste Update. Die Sora 2 API kann eine komplette Klanglandschaft für Ihr Video generieren, von gesprochenen Dialogen und Soundeffekten bis hin zu Umgebungsgeräuschen. Wenn Ihr Prompt ein belebtes Café beschreibt, sehen Sie nicht nur die Menschen, Sie hören auch das Murmeln von Gesprächen, klirrende Tassen und das Zischen der Espressomaschine.

Ehrlich gesagt ist das eine massive Zeitersparnis. Für viele Projekte entfällt dadurch der separate Schritt der Audiobearbeitung komplett. Sie können einen kurzen Clip erstellen, der sofort bereit zum Teilen ist, mit Ton und allem, direkt aus der API.

Feinere Steuerung und besseres Befolgen von Prompts

Sora 2 ist nicht nur für einzelne Aufnahmen gedacht. Die API ermöglicht es Ihnen, detaillierte, mehrteilige Prompts zu schreiben, die Kamerabewegungen („beginne mit einer Weitwinkelaufnahme, dann fahre auf das Gesicht der Figur zu“), Aufnahmesequenzen und spezifische visuelle Stile festlegen. Ob Sie etwas Düsteres und Filmisches oder einen hellen, von Anime inspirierten Look wünschen, Sie können das Modell mit Ihren Worten steuern.

Was wirklich entscheidend ist, ist, dass es viel besser darin ist, die Dinge konsistent zu halten über diese Aufnahmen hinweg. Wenn Sie eine Figur in der ersten Aufnahme beschreiben, ist es weitaus wahrscheinlicher, dass sie in der zweiten Aufnahme gleich aussieht, bis hin zu ihrer Kleidung und Umgebung. Dies öffnet endlich die Tür zur Gestaltung kurzer Erzählungen und komplexerer Geschichten, die mit älteren Modellen praktisch unmöglich waren.

Bild-zu-Video und die „Cameo“-Funktion

Die API ist nicht nur für Text-zu-Video. Sie können ihr ein statisches Bild zuführen, um den Ball ins Rollen zu bringen und ein Foto oder eine Illustration zum Leben zu erwecken.

Noch interessanter ist die „Cameo“-Funktion. Diese ermöglicht es Ihnen, das Gesicht und die Stimme einer realen Person in eine generierte Szene einzufügen. OpenAI scheint hier vorsichtig vorzugehen und baut es auf einem zustimmungsbasierten Rahmen auf, den sie in ihrem Leitfaden zum verantwortungsvollen Start von Sora detailliert beschreiben. Sie müssen Ihre Identität verifizieren und können entscheiden, wer Ihren Cameo verwenden darf, was Ihnen die volle Kontrolle über Ihr digitales Selbst gibt. Es ist eine unglaublich persönliche Art, Inhalte zu erstellen, wirft aber auch ein Licht auf den schmalen Grat der Sicherheit, der mit dieser Technologie einhergeht.

Praktische Anwendungsfälle: Für wen ist die API gedacht?

Mit diesen Funktionen ist ziemlich klar, dass die Sora 2 API auf Branchen abzielt, die von visuellen Inhalten leben.

-

Filmemachen und Unterhaltung: Für Filmemacher könnte Sora 2 ein erstaunliches Werkzeug zur Vorvisualisierung sein. Sie können ganze Szenen storyboarden, Kamerawinkel testen und bewegte Konzeptkunst erstellen, bevor Sie überhaupt daran denken, eine echte Kamera laufen zu lassen.

-

Werbung und Marketing: Agenturen können jetzt Videoanzeigen-Ideen in Minuten statt in Tagen entwerfen. Sie fragen sich, wie ein Autowerbespot auf einer futuristischen Straße aussehen würde? Fordern Sie es einfach an. Dies hilft Teams, viel schneller Ideen für Social-Media-Kampagnen zu entwickeln und zu iterieren.

-

E-Learning und Bildung: Die Erstellung dynamischer Erklärvideos oder historischer Simulationen ist gerade viel einfacher geworden. Ein Lehrer könnte eine kurze Animation erstellen, um ein schwieriges wissenschaftliches Konzept zu erklären, ohne dafür Animationssoftware oder -kenntnisse zu benötigen.

Es ist jedoch wichtig, hier eine Grenze zu ziehen zwischen der Erstellung kreativer Inhalte und der Automatisierung von Geschäftsprozessen. Sora 2 ist fantastisch, um visuelle Inhalte zu erstellen, aber es ist nicht dafür gebaut, die internen Arbeitsabläufe Ihres Unternehmens zu verwalten. Für Dinge wie die Beantwortung von Kundensupport-Tickets, die Bearbeitung von IT-Anfragen oder die Unterstützung von Mitarbeitern bei der Suche nach Unternehmensinformationen benötigen Sie eine völlig andere Art von KI.

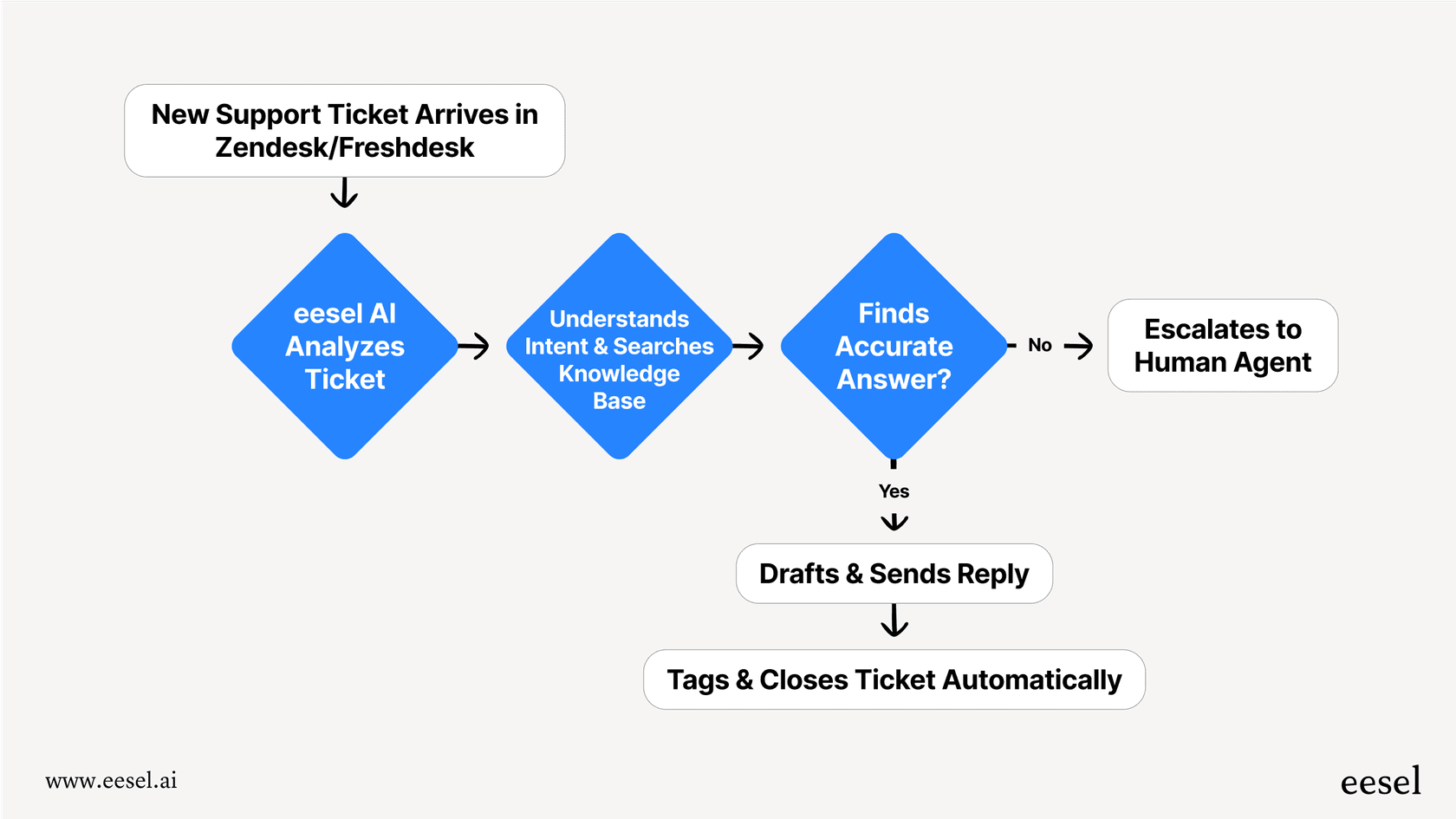

Ein Tool wie eesel AI ist genau dafür konzipiert. Es bietet einen KI-Agenten, der sich direkt mit Ihrem Helpdesk (wie Zendesk oder Freshdesk) verbindet und aus Ihren vergangenen Support-Tickets und Wissensdatenbankartikeln lernt. Es geht darum, sofortige, genaue, textbasierte Antworten zu liefern, um Ihren Support zu automatisieren, wobei der Fokus auf Effizienz und nicht auf Videoproduktion liegt.

Preise der Sora 2 API: Was wir aus Testberichten gelernt haben

Okay, reden wir über Geld. Diese Art von Leistung gibt es nicht umsonst. Die Preisgestaltung von OpenAI für die Sora 2 API hängt vom verwendeten Modell, der Auflösung und der Länge des von Ihnen erstellten Videos ab. Nach dem, was wir aus frühen Testberichten entnommen haben, sieht die Aufschlüsselung wie folgt aus:

| Modell | Auflösung | Kosten pro Sekunde | Beispiel: 10-Sekunden-Video |

|---|---|---|---|

| Sora 2 | 720p (1280x720 oder 720x1280) | 0,10 $ | 1,00 $ |

| Sora 2 Pro | 720p (1280x720 oder 720x1280) | 0,30 $ | 3,00 $ |

| Sora 2 Pro | Hohe Auflösung (1792x1024 oder 1024x1792) | 0,50 $ | 5,00 $ |

Dieses Pay-per-Second-Modell bedeutet, dass sich die Kosten schnell summieren können, insbesondere wenn Sie hochauflösende Videos erstellen oder viele verschiedene Prompts ausprobieren. Eine einzige Minute hochauflösendes Video vom Sora 2 Pro-Modell kostet Sie 30 $. Das macht es zu einem Werkzeug für hochwertige kreative Arbeit, bei der Sie die Kosten rechtfertigen können, nicht für alltägliche Geschäftsaufgaben mit hohem Volumen.

Das ist eine völlig andere Welt als die vorhersehbaren Preise, die man bei Automatisierungsplattformen sieht. Zum Beispiel ist die Preisgestaltung von eesel AI eine feste monatliche Gebühr für eine bestimmte Anzahl von KI-Konversationen. Es gibt keine versteckten Gebühren für „höherauflösende Antworten“, was bedeutet, dass ein Unternehmen seinen automatisierten Support skalieren kann, ohne am Ende des Monats eine böse Überraschung bei der Rechnung zu erleben.

Einschränkungen und Herausforderungen

Die Demos sind unglaublich, aber Praxistests der Sora 2 API haben einige praktische Einschränkungen und Kopfschmerzen aufgedeckt, die Entwickler kennen sollten.

Technische Mängel und Macken

Das Modell ist nicht perfekt. Jedenfalls noch nicht. Ein häufiges Problem, das in frühen Tests auftrat, ist seine Schwierigkeit, lesbaren Text zu generieren. Wenn Sie nach einem Schild im Hintergrund oder Wörtern auf einem T-Shirt fragen, kommt oft nur Kauderwelsch heraus.

Die Konsistenz der Charaktere kann bei längeren Videos ebenfalls immer noch ein Problem sein. Kleine Details wie eine Uhr oder ein Ohrring können zwischen den Aufnahmen einfach verschwinden. Darüber hinaus können die Generierungszeiten langsam sein. Ein 20-Sekunden-Clip kann 3 bis 5 Minuten zum Rendern benötigen, was einen kreativen Arbeitsablauf wirklich ausbremsen kann, wenn man versucht, schnell zu iterieren.

Beschränkter Zugang und Hürden für Entwickler

Sie können sich nicht einfach anmelden und heute mit der Sora 2 API herumspielen. Sie befindet sich derzeit in einer limitierten Vorschau, was bedeutet, dass Sie sich um Zugang bewerben und in die Warteschlange stellen müssen. Dies ist eine ziemlich große Hürde für Entwickler, die experimentieren oder jetzt einen Proof-of-Concept erstellen möchten.

Das ist weit entfernt von echten Self-Service-Plattformen. Mit einem Tool wie eesel AI können Sie sich anmelden und innerhalb weniger Minuten einen funktionierenden KI-Agenten mit Ihrem Helpdesk verbinden. Es gibt keine Warteliste und kein obligatorisches Verkaufsgespräch. Sie können einfach in Ihrer eigenen Zeit loslegen.

Sicherheit, geistiges Eigentum und ethische Tretminen

Die Nutzung der Sora 2 API ist mit viel Verantwortung verbunden. Das Potenzial zur Erstellung überzeugender Deepfakes, die Notwendigkeit, Minderjährige zu schützen, und die unklaren rechtlichen Fragen rund um die Generierung urheberrechtlich geschützter Charaktere sind alles sehr reale Probleme.

OpenAI hat eingebaute Sicherheitsfilter und diesen zustimmungsbasierten Rahmen für seine „Cameo“-Funktion, aber am Ende des Tages liegt es am Entwickler, sicherzustellen, dass seine App ethisch und legal genutzt wird. Das fügt eine Schicht der Governance und rechtlichen Arbeit hinzu, die schwierig zu navigieren sein kann. Für eine Geschäftsfunktion wie den Kundensupport ist dieses Risikoniveau einfach nicht akzeptabel. Eine Plattform wie eesel AI gibt Ihnen die volle Kontrolle, indem Sie ihr Wissen auf Ihre genehmigten Dokumente beschränken können. Sie können sogar eine Simulation mit Ihren vergangenen Tickets durchführen, bevor Sie live gehen, damit Sie sicher sein können, dass jede Antwort sicher, markenkonform und korrekt ist.

Ein leistungsstarkes Kreativwerkzeug, aber nicht für jede Aufgabe

Es steht außer Frage, dass die Sora 2 API ein großer Fortschritt für die generative KI ist. Für jeden in einem kreativen Bereich eröffnet sie Möglichkeiten, die vor einem Jahr noch reine Science-Fiction waren. Es ist ein aufregendes, leistungsstarkes Werkzeug, das die Art und Weise, wie visuelle Inhalte erstellt werden, absolut verändern wird.

Aber für viele Unternehmen machen die hohen Kosten, die technischen Hürden, der beschränkte Zugang und der kreative Fokus es zum falschen Werkzeug, um alltägliche operative Probleme zu lösen. Es ist ein spezialisiertes Instrument für eine ganz bestimmte Art von Arbeit. Unternehmen, die eine schnelle, zuverlässige und erschwingliche KI-Lösung zur Automatisierung von Arbeitsabläufen benötigen, sollten sich wahrscheinlich Plattformen ansehen, die genau für diese Herausforderungen konzipiert sind.

Wenn Sie sehen möchten, wie KI Ihren Support automatisieren, das Ticketvolumen reduzieren und in wenigen Minuten live sein kann, testen Sie eesel AI kostenlos.

Häufig gestellte Fragen

Die Hauptverbesserungen umfassen synchronisiertes Audio, besseren physikalischen Realismus und Konsistenz in generierten Videos sowie eine verbesserte Befolgung von Prompts für eine feinere Kontrolle über Aufnahmen und Stile. Es führt auch eine Bild-zu-Video-Funktion und die „Cameo“-Option ein.

Die Preisgestaltung für Sora 2 basiert auf einem Pay-per-Second-Modell, das je nach Auflösung und Modelltyp (Sora 2 vs. Sora 2 Pro) variiert. Das bedeutet, dass sich die Kosten schnell summieren können, insbesondere bei längeren, hochauflösenden Videos, was es für hochwertige kreative Arbeiten geeignet macht.

Ja, häufige Probleme sind Schwierigkeiten bei der Generierung von lesbarem Text, potenzielle Inkonsistenzen bei Charakterdetails in längeren Videos und langsame Renderzeiten. Ein 20-Sekunden-Clip kann 3 bis 5 Minuten zur Generierung benötigen.

Sie eignet sich am besten für kreative Branchen wie das Filmemachen (Vorvisualisierung), Werbung (Videoanzeigen-Entwürfe) und E-Learning (dynamische Erklärvideos). Sie brilliert bei der Erstellung visueller Inhalte anstatt bei der Automatisierung von Geschäftsprozessen.

Derzeit ist der Zugang auf ein Vorschauprogramm beschränkt. Entwickler müssen sich bewerben und genehmigt werden, was bedeutet, dass es eine Warteliste gibt und es nicht sofort für selbstgesteuertes Experimentieren verfügbar ist.

Ja, der Blog hebt Bedenken bezüglich Deepfakes, IP-Rechten und dem Schutz von Minderjährigen hervor. OpenAI integriert Sicherheitsfilter und einen zustimmungsbasierten Rahmen für Funktionen wie „Cameo“, um diese Probleme anzugehen.

Sora 2 ist für die Erstellung kreativer Inhalte und visuelles Storytelling konzipiert, während Tools wie eesel AI sich auf die Automatisierung von Geschäftsprozessen wie Kundensupport oder interne Wissensabfrage konzentrieren. Sie dienen grundlegend unterschiedlichen Zwecken und haben verschiedene Preismodelle.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.