Wenn Sie irgendetwas mit KI entwickeln, sei es ein Kundensupport-Bot oder ein internes Q&A-Tool, hatten Sie wahrscheinlich schon einmal diesen Gedanken: „Was ist, wenn jemand etwas … Schlimmes sagt?“

Das ist eine berechtigte Sorge. Ihre Plattform vor schädlichen oder unangemessenen Inhalten zu schützen, ist nicht nur ein nettes Extra, sondern unerlässlich, um Ihre Nutzer und Ihre Marke zu schützen.

Genau dafür ist die OpenAI Moderation API da. Sie ist ein praktisches Werkzeug, das Ihnen hilft, eine ganze Reihe von unerwünschten Inhalten in Texten und Bildern zu erkennen und herauszufiltern. In diesem Leitfaden gehen wir alles durch, was Sie darüber wissen müssen, von den Funktionen und Preisen bis hin zu den Einschränkungen in der Praxis. Wir werden uns auch ansehen, was es braucht, um von der reinen Kennzeichnung von Inhalten zu einem vollwertigen Moderationssystem zu gelangen, das wirklich funktioniert.

Was ist die OpenAI Moderation API?

Stellen Sie sich die OpenAI Moderation API als eine schnelle Sicherheitsüberprüfung von Inhalten vor. Sie senden ihr einen Text oder ein Bild, und sie teilt Ihnen mit, ob der Inhalt potenziell schädlich ist, indem sie ihn anhand der Nutzungsrichtlinien von OpenAI kennzeichnet.

Sie ist im Grunde Ihre erste Verteidigungslinie. Der Sinn dahinter ist, problematische Inhalte frühzeitig zu erkennen, damit Sie entscheiden können, was als Nächstes zu tun ist – sei es das Filtern einer Nachricht, das Sperren eines Nutzers oder die Weiterleitung an einen Menschen zur genaueren Überprüfung.

Und das vielleicht Beste daran? Sie ist völlig kostenlos. Das macht sie zu einem äußerst zugänglichen Ausgangspunkt für jeden Entwickler, der seiner Anwendung eine Sicherheitsebene hinzufügen möchte, ohne sich über Kosten Gedanken machen zu müssen.

Hauptmerkmale der OpenAI Moderation API

Die API ist seit ihrer Einführung viel besser geworden, und die neuesten Modelle sind leistungsfähiger und genauer als je zuvor. Hier sind einige der herausragenden Kernfunktionen.

Multimodale Klassifizierung für Text und Bilder

Mit dem neuen Modell „omni-moderation-latest“, das auf GPT-4o basiert, kann die OpenAI Moderation API nun sowohl Text als auch Bilder in einem einzigen Durchgang analysieren. Das ist ein großer Vorteil für Anwendungen, die mit gemischten Medien arbeiten, wie zum Beispiel Community-Foren oder Support-Chats, in denen Nutzer Screenshots hochladen.

Derzeit funktioniert diese Text- und Bildfunktion für drei Hauptkategorien:

-

Gewalt („violence“ und „violence/graphic“)

-

Selbstverletzung („self-harm“, „self-harm/intent“ und „self-harm/instruction“)

-

Sexuelle Inhalte („sexual“)

Die anderen Kategorien sind vorerst nur für Text verfügbar, aber es ist ein großer Schritt, um alle Bereiche abzudecken, unabhängig von der Art des Inhalts.

Umfassende Inhaltskategorien

Die API sucht nicht nur nach einer Art von schädlichem Inhalt; sie prüft ein ganzes Spektrum von Problemen. Die neueren Modelle haben sogar differenziertere Klassifizierungen hinzugefügt. Hier ist eine kurze Übersicht dessen, was sie erkennen kann:

| Kategorie | Beschreibung | Eingaben |

|---|---|---|

| „harassment“ | Sprache, die Belästigung ausdrückt, dazu anstiftet oder sie fördert. | Nur Text |

| „hate“ | Inhalte, die Hass aufgrund von Rasse, Geschlecht, ethnischer Zugehörigkeit, Religion usw. fördern. | Nur Text |

| „self-harm“ | Alles, was zu Selbstverletzung wie Suizid oder Ritzen ermutigt oder solche Handlungen zeigt. | Text & Bilder |

| „sexual“ | Inhalte, die sexuell erregend sein sollen oder sexuelle Dienstleistungen bewerben. | Text & Bilder |

| „violence“ | Inhalte, die Tod, Gewalt oder schwere körperliche Verletzungen zeigen. | Text & Bilder |

| „illicit“ | Inhalte, die Anleitungen für illegale Handlungen geben (z. B. „wie man Ladendiebstahl begeht“). | Nur Text |

Verbesserte Genauigkeit und kalibrierte Bewertungen

Das Modell „omni-moderation-latest“ ist auch viel genauer, insbesondere bei anderen Sprachen als Englisch. OpenAIs eigene Tests zeigten, dass es in einem mehrsprachigen Testdatensatz um 42 % besser abschnitt als die vorherige Version.

Ein weiterer netter Aspekt ist, dass die Bewertungen des Modells jetzt „kalibriert“ sind. Einfach ausgedrückt bedeutet das, dass der Konfidenzwert, den Sie erhalten (eine Zahl von 0 bis 1), eine realistischere Widerspiegelung der Wahrscheinlichkeit ist, dass der Inhalt tatsächlich gegen eine Richtlinie verstößt. Dadurch können Sie Ihre eigenen Filterschwellenwerte mit viel mehr Sicherheit festlegen.

Wenn Sie eine Anfrage stellen, gibt die API Ihnen ein JSON-Objekt mit drei wichtigen Feldern zurück:

-

„flagged“: Ein einfaches „true“ oder „false“, das Ihnen mitteilt, ob überhaupt etwas gekennzeichnet wurde.

-

„categories“: Eine Liste der spezifischen Kategorien, die als „true“ gekennzeichnet wurden.

-

„category_scores“: Die detaillierten Konfidenzwerte für jede einzelne Kategorie.

Wie man die OpenAI Moderation API verwendet

Obwohl die API selbst leistungsstark ist, erfordert es etwas technische Einrichtung und Planung, damit sie in Ihrer Anwendung gut funktioniert. Hier ist ein kurzer Überblick darüber, was dazu gehört.

Erste Schritte

Zuerst benötigen Sie ein OpenAI-Konto und einen API-Schlüssel, den Sie auf Ihrer Seite für Organisationseinstellungen erhalten. Die gute Nachricht ist, dass Sie im Gegensatz zu einigen anderen APIs sofortigen Zugriff auf den Moderations-Endpunkt haben. Kein Warten erforderlich.

Eine Moderationsanfrage stellen

Sobald Sie Ihren Schlüssel haben, müssen Sie nur eine POST-Anfrage an den Endpunkt „/v1/moderations“ senden. Sie benötigen wirklich nur zwei Dinge: den „input“ (den Text oder die Bild-URL, die Sie überprüfen möchten) und das „model“, das Sie verwenden möchten.

curl https://api.openai.com/v1/moderations \

-X POST \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-d '{

"input": "Ich will sie umbringen.",

"model": "omni-moderation-latest"

}'

Die API sendet ein JSON-Objekt mit den Ergebnissen zurück. Für eine schnelle Überprüfung können Sie einfach das Feld „flagged“ ansehen, um zu sehen, ob es „true“ oder „false“ ist.

graph TD A[Nutzer reicht Inhalt ein] --> B{OpenAI Moderation API aufrufen}; B --> C{Inhalt gekennzeichnet?}; C -- Ja --> D[Benutzerdefinierte Workflow-Logik]; D --> E[Nutzer sperren]; D --> F[An Menschen eskalieren]; D --> G[Warnung senden]; C -- Nein --> H[Inhalt genehmigt];

subgraph Herausforderungen direction LR I((Latenz)) J((Benutzerdefinierte Regeln)) K((Technischer Aufwand)) end D --> I; D --> J; D --> K;

Die Herausforderungen beim Aufbau eines vollständigen Moderations-Workflows

Der API-Aufruf ist einfach. Der schwierige Teil kommt danach. Die OpenAI Moderation API sagt Ihnen, ob ein Inhalt schädlich ist, aber nicht, was Sie dagegen tun sollen. Das stellt Ihr Team vor einige Hürden.

Sie müssen die Workflow-Logik selbst erstellen. Sie müssen den gesamten Code schreiben, der entscheidet, was passiert, wenn Inhalte gekennzeichnet werden. Soll der Nutzer gesperrt werden? Soll das Ticket an einen menschlichen Mitarbeiter eskaliert werden? Soll eine automatische Warnung gesendet werden? Jede einzelne dieser Aktionen muss individuell erstellt werden.

Latenz kann ein Problem sein. Der Aufruf einer weiteren API für jede Nachricht kann Ihre Anwendung verlangsamen. Um die Benutzererfahrung reibungslos zu halten, müssen Sie möglicherweise ein asynchrones System aufbauen, das die Moderationsprüfung im Hintergrund ausführt, was eine weitere Komplexitätsebene hinzufügt.

Benutzerdefinierte Regeln liegen in Ihrer Verantwortung. Die Kategorien der API sind festgelegt. Wenn Sie Inhalte nach Ihren eigenen Markenrichtlinien filtern müssen (z. B. das Vermeiden politischer Diskussionen, Rückerstattungsanfragen oder Erwähnungen von Wettbewerbern), müssen Sie dafür ein komplett separates System aufbauen. Dies bedeutet in der Regel einen weiteren LLM-Aufruf, was zusätzliche Kosten und technischen Aufwand mit sich bringt.

Preise der OpenAI Moderation API

Das ist der einfache Teil. Eines der besten Dinge an der OpenAI Moderation API ist der Preis: Sie ist kostenlos. Laut der offiziellen Preisseite von OpenAI kostet die Nutzung der „omni-moderation“-Modelle nichts.

Das macht sie zu einer selbstverständlichen Wahl für Projekte jeder Größe, von kleinen Start-ups bis hin zu großen Unternehmen. Obwohl einige Leute in Community-Foren denken, dass sie zusammen mit anderen kostenpflichtigen OpenAI-APIs verwendet werden soll, trifft das ohnehin auf fast jeden zu, der im OpenAI-Ökosystem entwickelt.

Jenseits der OpenAI Moderation API: Ein integrierter Moderations- und Automatisierungs-Workflow

Die kostenlose API ist ein fantastischer Ausgangspunkt, aber wenn Sie einen echten Kundensupport-Betrieb leiten, brauchen Sie mehr als nur eine Inhaltskennzeichnung. Sie benötigen ein System, das diese Kennzeichnung mit einer sofortigen, intelligenten Aktion verbindet. Hier macht eine dedizierte KI-Support-Plattform wirklich einen Unterschied.

Von der Erkennung zur Lösung in Minuten

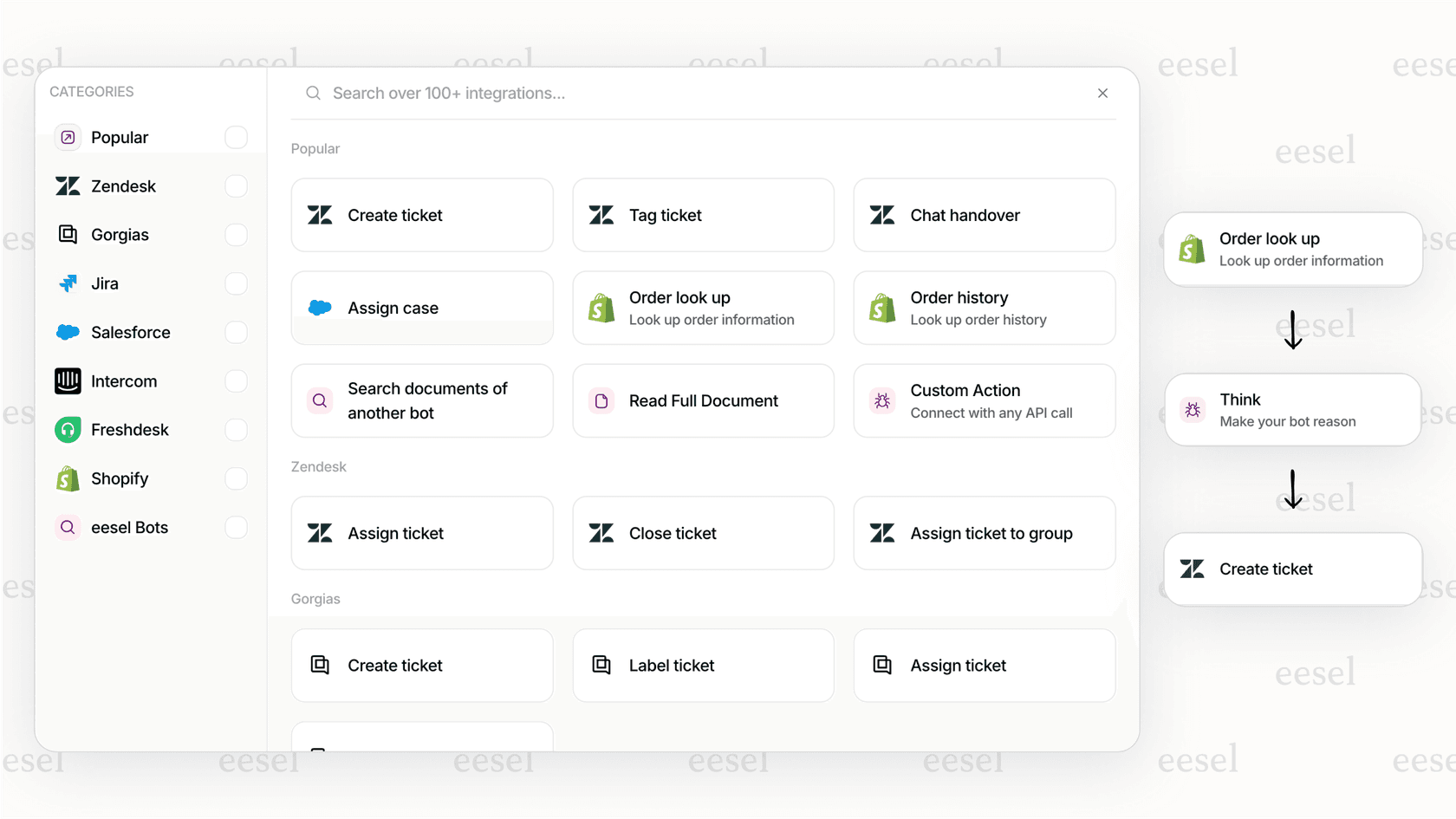

Bei einem DIY-Ansatz müssen Sie jeden einzelnen Schritt des Workflows selbst programmieren. Eine Plattform wie eesel AI verändert das Spiel mit vorgefertigter Logik und Ein-Klick-Helpdesk-Integrationen für Tools, die Sie bereits verwenden, wie Zendesk oder Freshdesk.

Anstatt nur ein Problem zu erkennen, können Sie sofort darauf reagieren. Sie könnten zum Beispiel einen eesel AI-Agenten einrichten, der eine Moderationskennzeichnung erkennt, seine eigene Antwort sofort stoppt und das Ticket automatisch mit dem Tag „dringende Überprüfung“ an einen Menschen eskaliert. Diesen gesamten Workflow können Sie in wenigen Minuten erstellen, ohne eine einzige Zeile Code zu schreiben.

Kombinieren Sie Inhaltssicherheit mit benutzerdefinierten Geschäftsregeln

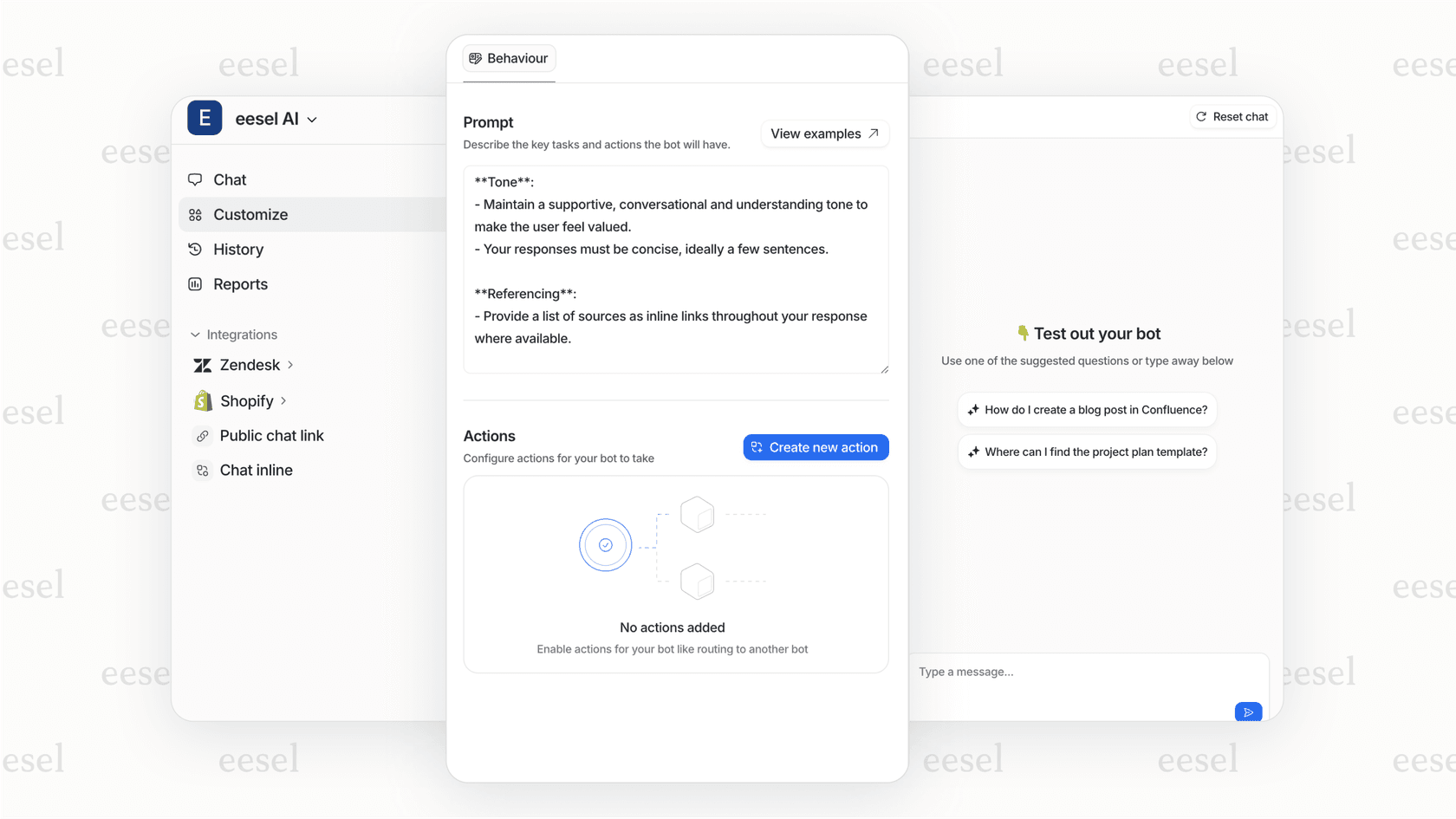

Die festen Kategorien der OpenAI Moderation API können Ihre markenspezifischen Regeln nicht handhaben. Eine integrierte Plattform löst dieses Problem, indem sie Ihnen eine vollständig anpassbare Workflow-Engine zur Verfügung stellt. Mit dem Prompt-Editor von eesel AI können Sie die Persönlichkeit Ihrer KI definieren und benutzerdefinierte Moderationsregeln hinzufügen, die weit über das Standard-Sicherheitsnetz hinausgehen.

Eine E-Commerce-Marke könnte beispielsweise die Standard-Moderations-API verwenden, um schädliche Inhalte zu blockieren, und gleichzeitig die benutzerdefinierten Anweisungen von eesel AI nutzen, um zu verhindern, dass die KI Versprechungen über Lieferzeiten macht oder über Wettbewerber spricht.

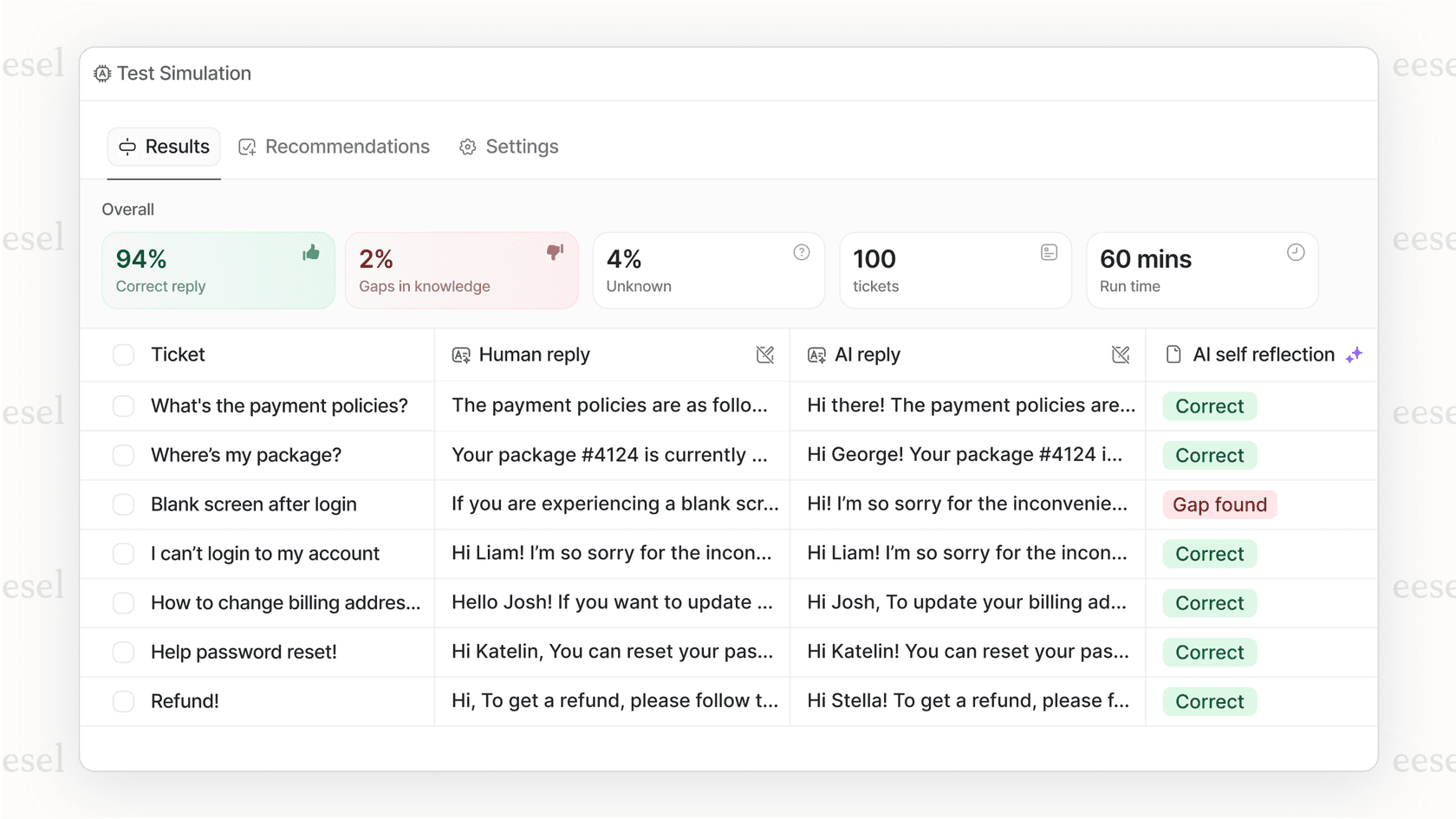

Simulieren und implementieren Sie Ihren Workflow mit Zuversicht

Die Einführung eines selbst erstellten Moderationssystems kann sich wie ein Glücksspiel anfühlen. Sind Ihre Schwellenwerte zu streng und führen zu Fehlalarmen? Oder sind sie zu locker und lassen schädliche Inhalte durch?

eesel AI nimmt Ihnen das Rätselraten mit einem leistungsstarken Simulationsmodus ab. Bevor Sie live gehen, können Sie Ihr gesamtes Automatisierungs- und Moderations-Setup anhand von Tausenden Ihrer vergangenen Support-Tickets testen. Dies gibt Ihnen ein klares Bild davon, wie sich Ihre KI in der Praxis verhalten wird, sodass Sie Ihre Regeln anpassen und mit der Gewissheit implementieren können, dass es wie erwartet funktioniert.

Abschließende Gedanken zur OpenAI Moderation API

Die OpenAI Moderation API ist ein fantastisches Werkzeug. Sie ist kostenlos, leistungsstark und eine hervorragende Möglichkeit, jeder Anwendung, die Sie entwickeln, eine grundlegende Inhaltssicherheit zu verleihen. Mit ihrem neuen multimodalen Modell ist sie nützlicher denn je und sollte definitiv in Ihrem Entwickler-Toolkit sein.

Aber das Kennzeichnen von Inhalten ist nur der erste Schritt. Die eigentliche Arbeit besteht darin, diese Kennzeichnung in einen reibungslosen, zuverlässigen und angepassten Geschäftsprozess umzuwandeln. Diese Workflows von Grund auf neu zu erstellen, ist eine große Aufgabe, die viel Entwicklungszeit, fortlaufende Wartung und sorgfältige Tests erfordert.

Für Teams, die schnell vorankommen müssen, ohne Kompromisse einzugehen, bietet eine integrierte Plattform wie eesel AI das Gesamtpaket. Sie bündelt die Leistung der OpenAI-Moderation mit einem No-Code-Workflow-Builder, tiefen Integrationen und soliden Testwerkzeugen. Damit gelangen Sie von der einfachen Erkennung zur vollständigen Automatisierung in Minuten, nicht in Monaten.

Erstellen Sie intelligentere und sicherere Support-Workflows mit eesel AI

Bereit, ein Support-System zu erstellen, das nicht nur sicher, sondern auch intelligent und effizient ist? Testen Sie eesel AI kostenlos und sehen Sie, wie einfach es ist, Ihre Support-Workflows in Minuten zu automatisieren.

Häufig gestellte Fragen

Ist die OpenAI Moderation API für jedes Projekt völlig kostenlos nutzbar?

Ja, laut der offiziellen Preisgestaltung von OpenAI sind die „omni-moderation“-Modelle völlig kostenlos nutzbar. Das macht die OpenAI Moderation API zu einem äußerst zugänglichen Werkzeug, um Anwendungen jeder Größe eine grundlegende Schicht an Inhaltssicherheit hinzuzufügen.

Welche Arten von schädlichen Inhalten kann die OpenAI Moderation API in Text und Bildern erkennen?

Das „omni-moderation-latest“-Modell kann Gewalt, Selbstverletzung und sexuelle Inhalte sowohl in Text als auch in Bildern erkennen. Andere Kategorien wie Belästigung, Hass und illegale Inhalte werden derzeit nur für Texteingaben unterstützt.

Kann die OpenAI Moderation API als alleinstehende Lösung für eine umfassende Inhaltsmoderation verwendet werden?

Obwohl die OpenAI Moderation API hervorragend zur Identifizierung schädlicher Inhalte geeignet ist, kennzeichnet sie hauptsächlich Probleme, ohne eine Workflow-Logik bereitzustellen. Für ein vollständiges Moderationssystem, das Antworten oder Eskalationen automatisiert, muss sie typischerweise mit zusätzlichen, individuell erstellten Lösungen oder einer dedizierten KI-Support-Plattform integriert werden.

Wie genau ist die OpenAI Moderation API, insbesondere bei nicht-englischen Inhalten?

Das „omni-moderation-latest“-Modell zeichnet sich durch eine verbesserte Genauigkeit aus, einschließlich einer 42%igen Verbesserung bei mehrsprachigen Testdatensätzen im Vergleich zu früheren Versionen. Seine kalibrierten Bewertungen bieten auch einen zuverlässigeren Anhaltspunkt für das Vertrauen bei Richtlinienverstößen in verschiedenen Sprachen.

Welche Ersteinrichtung ist erforderlich, um mit der Nutzung der OpenAI Moderation API zu beginnen?

Um loszulegen, benötigen Sie ein OpenAI-Konto und einen API-Schlüssel aus Ihren Organisationseinstellungen. Sobald Sie den Schlüssel haben, können Sie POST-Anfragen an den Endpunkt „/v1/moderations“ mit Ihrer Inhaltseingabe und dem gewünschten Modell senden.

Ermöglicht die OpenAI Moderation API benutzerdefinierte Moderationsregeln, die auf spezifische Geschäftsanforderungen zugeschnitten sind?

Die OpenAI Moderation API bietet vordefinierte Inhaltskategorien. Sie unterstützt nativ keine benutzerdefinierten, markenspezifischen Regeln (z. B. das Blockieren von Erwähnungen von Wettbewerbern oder spezifischen Produktrichtlinien). Die Integration mit einer Plattform, die eine anpassbare Workflow-Engine bietet, wie eesel AI, ist für solche maßgeschneiderten Anforderungen notwendig.