Wir alle kennen das. Sie haben eine Frage zu einem Produkt, also gehen Sie zum Hilfe-Center des Unternehmens, geben Ihr Problem ein und... erhalten eine lange Liste von Artikeln. Die Antwort ist wahrscheinlich in einem davon, aber jetzt müssen Sie die nächsten 20 Minuten damit verbringen, sich durch Tabs zu klicken und nach diesem einen bestimmten Absatz zu suchen. Das ist eine frustrierende Erfahrung für Kunden und eine massive Zeitverschwendung für Ihr eigenes Team, wenn es nur versucht, eine interne Vorgehensweise zu finden.

Ihre Standard-Supportdokumentation ist im Grunde eine digitale Bibliothek. Sie enthält alle Informationen, aber Sie müssen das richtige Buch finden und selbst zur richtigen Seite blättern. Aber was wäre, wenn Ihre Wissensdatenbank weniger wie eine Bibliothek und mehr wie ein Bibliothekar agieren könnte, der Ihnen einfach die Antwort gibt?

Genau das macht die KI-gestützte Suche. Sie verwandelt Ihr statisches Hilfe-Center in eine intelligente, dialogorientierte Ressource, die Antworten liefert, nicht nur Links. Dieser Leitfaden führt Sie durch die verschiedenen Möglichkeiten, wie Sie die KI-Suche in Ihre Supportdokumentation integrieren können, und hilft Ihnen, den richtigen Weg für Ihr Team zu wählen – von riesigen Eigenentwicklungen bis hin zu einfachen Tools, die in wenigen Minuten live gehen.

Was ist eine KI-Suche?

Kommen wir direkt zur Sache. Eine KI-Suche sucht nicht nur nach Schlüsselwörtern; sie versteht tatsächlich, was eine Frage bedeutet. Wenn ein Benutzer fragt: „Wie ändere ich die E-Mail-Adresse meines Kontos?“, weiß die KI, dass er nach einer schrittweisen Anleitung sucht und nicht nach irgendeinem Artikel, der zufällig „E-Mail“ oder „Konto“ erwähnt.

Die Technologie dahinter wird oft Retrieval-Augmented Generation (RAG) genannt. Das klingt kompliziert, aber die Idee ist ziemlich einfach und funktioniert in zwei Schritten:

-

Abrufen: Zuerst durchsucht die KI alle Ihre verbundenen Wissensquellen – Ihr Hilfe-Center, frühere Support-Tickets, interne Wikis, was auch immer – um die relevantesten Informationen für die Frage des Benutzers herauszufiltern.

-

Generieren: Dann verwendet sie ein großes Sprachmodell (dieselbe Art von Technologie, die hinter ChatGPT steckt), um diese Informationen zu einer einzigen, unkomplizierten Antwort zusammenzufügen, die normalerweise auf die Originaldokumente zurückverweist.

graph TD; A[Benutzer stellt eine Frage] --> B{KI-Suchsystem}; B --> C[Schritt 1: Abrufen]; C --> D[KI scannt verbundene Wissensquellen]; D --> E[Relevante Informationen werden extrahiert]; B --> F[Schritt 2: Generieren]; F --> G[LLM synthetisiert Informationen]; G --> H[Eine einzige, direkte Antwort wird erstellt]; H --> I[Benutzer erhält die Antwort];

Das Endergebnis? Ihre Benutzer erhalten eine sofortige, genaue Antwort anstelle einer Leseaufgabe. Dies sorgt für zufriedenere Kunden, weniger Support-Tickets und ein Support-Team, das sich endlich auf die kniffligeren Probleme konzentrieren kann, die eine menschliche Note erfordern.

Option 1: Der DIY-Ansatz

Für Unternehmen mit einem Entwicklerteam und einer gesunden Portion Appetit auf Komplexität bietet der Aufbau eines KI-Suchsystems von Grund auf die vollständige Kontrolle. Aber um es klar zu sagen: Das ist kein Wochenendprojekt. Sie bauen im Grunde eine sehr anspruchsvolle KI-Software von Grund auf neu.

Schlüsselkomponenten eines DIY-Systems

Wenn Sie sich für den DIY-Weg entscheiden, müssen Sie einige Schlüsselkomponenten zusammenstellen. Stellen Sie es sich wie den Bau eines Autos vor: Sie brauchen den Motor, die Karosserie und eine Möglichkeit, es tatsächlich zu lenken.

-

Datenaufnahme und -verarbeitung: Sie müssen Verbindungen aufbauen, um all Ihr Wissen aus Quellen wie Confluence, Google Docs oder sogar alten PDFs zu importieren. Sobald die Daten vorhanden sind, müssen sie in kleinere, verdauliche „Chunks“ zerlegt werden, damit die KI sie verstehen kann.

-

Vektor-Einbettungen: Hier geschieht die Magie der „semantischen“ Suche. Sie verwenden ein Modell (wie eines von OpenAI), um diese Text-Chunks in eine Reihe von Zahlen, sogenannte Vektoren, umzuwandeln. Diese Vektoren repräsentieren die Bedeutung und den Kontext des Textes, wodurch die KI konzeptionell ähnliche Ideen findet, anstatt nur Schlüsselwörter abzugleichen.

-

Vektordatenbank: Ihre Standarddatenbank wird hier nicht funktionieren. Sie benötigen eine spezialisierte Vektordatenbank wie Pinecone, die darauf ausgelegt ist, diese Zahlen schnell zu speichern und zu durchsuchen. Dies ist ein weiteres Stück Infrastruktur, das Sie verwalten und bezahlen müssen.

-

RAG-Pipeline: Dies ist das Gehirn der gesamten Operation. Sie müssen den Code schreiben, der den gesamten Fluss verwaltet: die Annahme einer Benutzerfrage, deren Umwandlung in einen Vektor, die Suche in der Datenbank, das Abrufen der richtigen Text-Chunks und die anschließende Übergabe an ein großes Sprachmodell (LLM), um die endgültige Antwort zu verfassen.

graph TD; subgraph Datenebene A[Wissensquellen: Confluence, GDocs, PDFs] --> B[Datenaufnahme & -verarbeitung]; B --> C[Text-Chunks]; end subgraph KI-Verarbeitungsebene C --> D[Erstellung von Vektor-Einbettungen z.B. OpenAI]; D --> E[Speicherung in Vektordatenbank z.B. Pinecone]; end subgraph Anwendungsebene F[Benutzeranfrage] --> G[RAG-Pipeline]; E --> G; G --> H[LLM generiert Antwort]; H --> I[Endgültige Antwort]; end

Die Vor- und Nachteile eines DIY-Ansatzes

Der Aufbau Ihrer eigenen KI-Suche kann ein mächtiger Schritt sein, aber Sie müssen mit offenen Augen an die Sache herangehen.

-

Vollständige Kontrolle: Jedes einzelne Teil kann von Ihnen angepasst werden, vom verwendeten KI-Modell bis hin zum Erscheinungsbild der Benutzeroberfläche.

-

Tiefe Integration: Sie können es perfekt an die einzigartigen, proprietären Systeme Ihres Unternehmens anpassen.

-

Es ist extrem komplex und teuer: Dies erfordert echtes Fachwissen in den Bereichen KI, maschinelles Lernen und Daten-Engineering. Die Kosten summieren sich schnell durch Entwicklergehälter, API-Gebühren für die Modelle und das Hosting der Vektordatenbank.

-

Es dauert sehr, sehr lange: Realistisch betrachtet handelt es sich um ein Projekt, das mehrere Monate, wenn nicht sogar ein Jahr oder länger dauern wird, bis ein solides System einsatzbereit ist.

-

Die Wartung ist ein Monster: Die Welt der KI verändert sich schnell. Ihr Team wird dafür verantwortlich sein, die Leistung ständig zu überwachen, das System anzupassen und jede Komponente auf dem neuesten Stand zu halten.

Option 2: Enterprise-KI-Suchplattformen

Wenn der Aufbau von Grund auf wie ein Albtraum klingt, ist der nächste logische Schritt für viele Teams einer der großen Cloud-Anbieter. Plattformen wie Azure AI Search und AWS Kendra bieten leistungsstarke, vorgefertigte Toolkits zur Erstellung von Suchsystemen. Der Haken? „Enterprise-Grade“ geht meist mit Komplexität auf Unternehmensebene einher.

Beispiel: Azure AI Search

Azure AI Search ist Microsofts großer, leistungsstarker Cloud-Dienst zum Erstellen von Sucherlebnissen. Er verfügt über alle erdenklichen Funktionen wie Vektorsuche und lässt sich in das restliche Azure-Ökosystem integrieren. Obwohl es leistungsstark ist, ist es ein Werkzeug für Entwickler, nicht für die Support-Manager, die es tatsächlich nutzen müssen.

Und die Preisgestaltung? Sie ist notorisch verwirrend. Sie basiert auf einem Stufenmodell, bei dem Sie für Serviceeinheiten, Speicher und verschiedene Operationen bezahlen. Das macht es fast unmöglich, Ihre monatliche Rechnung vorherzusagen, die je nach Nutzung stark schwanken kann.

Beispiel: AWS Kendra

AWS Kendra ist Amazons Antwort auf intelligente Suche. Es verwendet maschinelles Lernen, um natürliche Sprache zu verstehen, und verfügt über Konnektoren für viele gängige Datenquellen. Genau wie das Angebot von Azure ist es ein großartiges Toolkit, wenn Ihr Team bereits in der AWS-Welt lebt und atmet.

Die Preisgestaltung ist ähnlich nutzungsbasiert und schwer zu bestimmen. Sie bezahlen für eine Kendra-Edition und werden dann mit zusätzlichen Kosten für die Nutzung von Konnektoren und die Anzahl der gescannten Dokumente konfrontiert. Wenn Ihre Wissensdatenbank oder Ihr Suchverkehr wächst, können diese Kosten leicht außer Kontrolle geraten.

Die Realität bei der Nutzung von Enterprise-Plattformen

Obwohl diese Plattformen einen Teil der schweren Arbeit abnehmen, sind sie weit von einer einfachen Lösung für ein Support-Team entfernt.

-

Eine steile Lernkurve: Diese Plattformen sind für Ingenieure konzipiert. Um loszulegen, benötigen Sie jemanden, der die Feinheiten von Azure oder AWS versteht, einschließlich ihrer Sicherheitsmodelle und Bereitstellungspipelines.

-

Lange Implementierungszeiten: Sie geben Ihnen die Legosteine, aber Ihr Team muss immer noch die Burg bauen. Entwickler werden wahrscheinlich Wochen oder Monate damit verbringen, Datenquellen zu verbinden, das System zu konfigurieren und eine Benutzeroberfläche zu erstellen, die die Leute tatsächlich nutzen können.

-

Nicht für Self-Service gemacht: Sie können sich nicht einfach mit einer Kreditkarte anmelden und loslegen. Der Prozess umfasst in der Regel Verkaufsgespräche, obligatorische Demos und einen formellen Beschaffungszyklus. Dies sind keine Werkzeuge, die ein Support-Leiter selbst einrichten und verwalten kann.

Option 3: No-Code-KI-Suchplattformen

Was also, wenn Sie die Leistungsfähigkeit einer Enterprise-KI-Suche erhalten könnten, ohne sie selbst zu bauen oder ein Team von Cloud-Ingenieuren einzustellen? Hier kommt eine neue Welle von No-Code-Plattformen ins Spiel, die eine einfache, schnelle und überraschend effektive Möglichkeit bieten, die Arbeit zu erledigen.

In Minuten live gehen mit Ein-Klick-Integrationen

Der größte Unterschied liegt hier in der Einrichtung. Anstatt mit APIs und Cloud-Konsolen zu kämpfen, sind diese Plattformen so konzipiert, dass auch technisch nicht versierte Personen fast sofort loslegen können.

Ein Tool wie eesel AI ist beispielsweise für eine echte Self-Service-Erfahrung konzipiert. Sie können sich anmelden und Ihre Wissensdatenbanken mit nur wenigen Klicks verbinden. Es verfügt über Ein-Klick-Integrationen für beliebte Plattformen wie Zendesk, Confluence und Notion, was bedeutet, dass Sie eine funktionierende KI-Suche in Minuten statt in Monaten zum Laufen bringen können.

Wissensquellen sofort vereinheitlichen

Eines der größten Kopfzerbrechen für Support-Teams ist, dass wichtige Informationen überall verstreut sind. Sie haben vielleicht öffentliche Artikel in einem Hilfe-Center, interne Anleitungen in Confluence und jahrelange brillante Lösungen, die in alten Support-Tickets eingeschlossen sind.

DIY- und Enterprise-Lösungen erfordern oft, dass Sie für jede Datenquelle separate Pipelines erstellen, was ein riesiger Aufwand ist. Eine Lösung wie eesel AI ist darauf ausgelegt, all dieses isolierte Wissen vom ersten Tag an zusammenzuführen. Und hier ist ein wichtiger Punkt: Es liest nicht nur Ihre offizielle Dokumentation. Es kann direkt aus Ihren früheren Support-Tickets in Helpdesks wie Zendesk oder Freshdesk lernen. Das bedeutet, dass die KI die Stimme Ihrer Marke lernt, die häufigen Probleme versteht, die Kunden tatsächlich haben, und Lösungen findet, die bereits funktioniert haben.

Mit Zuversicht testen und bereitstellen

Die Einführung einer kundenorientierten KI kann ein wenig nervenaufreibend sein. Was, wenn sie anfängt, seltsame oder einfach nur falsche Antworten zu geben? Der „Bauen und hoffen“-Ansatz von DIY-Projekten und die Black-Box-Natur großer Enterprise-Plattformen können Sie ungeschützt zurücklassen.

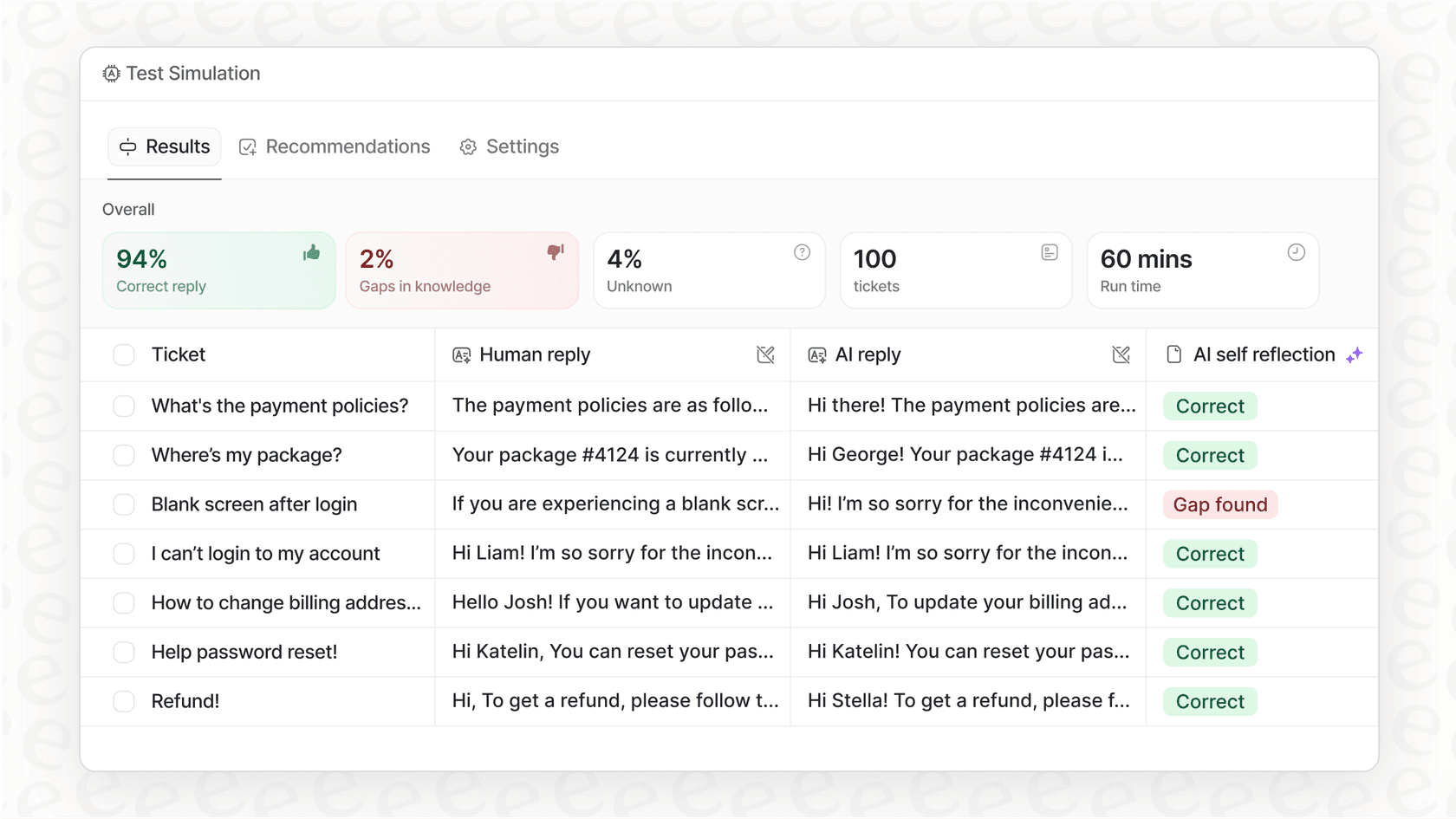

Hier glänzt eine dedizierte Plattform mit integrierten Sicherheitsnetzen wirklich. Zum Beispiel ist der Simulationsmodus von eesel AI unglaublich nützlich. Er ermöglicht es Ihnen, Ihre KI sicher an Tausenden Ihrer vergangenen Support-Tickets in einer privaten Sandbox zu testen. Die Simulation zeigt Ihnen genau, wie die KI geantwortet hätte, und gibt Ihnen reale Prognosen darüber, wie viele Tickets sie hätte lösen und wie viel Geld Sie hätten sparen können, bevor ein einziger Kunde sie jemals sieht. Das nimmt das Rätselraten aus dem Start, sodass Sie mit einem sicheren Gefühl live gehen können.

Den richtigen Ansatz für Ihr Team wählen

Der beste Weg, die KI-Suche in Ihre Supportdokumentation zu integrieren, hängt wirklich von den Ressourcen, dem Zeitplan und den Zielen Ihres Teams ab. Der DIY-Weg bietet ultimative Kontrolle, aber zu einem enormen Preis. Enterprise-Plattformen haben die Macht, erfordern aber ernsthaftes Entwickler-Know-how. No-Code-Lösungen hingegen liefern Geschwindigkeit und Einfachheit, ohne an Leistung einzubüßen.

Hier ist eine schnelle Übersicht, die Ihnen bei der Entscheidung helfen soll:

| Kriterien | DIY-Ansatz | Enterprise-Plattform (Azure/AWS) | No-Code-Lösung (wie eesel AI) |

|---|---|---|---|

| Time-to-Value | Monate bis Jahre | Wochen bis Monate | Minuten bis Stunden |

| Erforderliche technische Fähigkeiten | Experte (ML-Ingenieure, Entwickler) | Hoch (Cloud-Entwickler) | Gering (Kein Code erforderlich) |

| Anfangskosten | Hoch (Gehälter, Infrastruktur) | Mäßig bis Hoch (Dienste, Entwicklungszeit) | Gering (Erschwingliche SaaS-Pläne) |

| Laufende Wartung | Hoch | Mäßig | Gering (Vom Anbieter verwaltet) |

| Am besten geeignet für... | Große Technologieunternehmen mit dedizierten KI-Teams und einzigartigen Bedürfnissen. | Unternehmen, die stark in ein einziges Cloud-Ökosystem investiert sind und über verfügbare Entwicklerressourcen verfügen. | Teams, die eine leistungsstarke, zuverlässige Lösung benötigen, die schnell und ohne Entwicklerabhängigkeit bereitgestellt wird. |

Verbessern Sie Ihr Hilfe-Center mit KI-Suche

Das Hinzufügen einer KI-Suche zu Ihrer Supportdokumentation ist nicht länger ein riesiges, teures Projekt, das sich nur Technologiegiganten leisten können. Während der Eigenbau oder der Kampf mit Enterprise-Plattformen immer noch komplex und kostspielig ist, haben moderne No-Code-Lösungen diese Technologie für Teams jeder Größe zugänglich gemacht.

Indem Sie Ihren Benutzern direkte, genaue Antworten geben, können Sie ein viel besseres Kundenerlebnis schaffen, die Anzahl wiederkehrender Support-Tickets reduzieren und Ihr Team entlasten, damit es sich auf die wirklich wichtige Arbeit konzentrieren kann.

Für Teams, die den schnellsten und zuverlässigsten Weg suchen, dies zu erreichen, bietet eine Lösung wie eesel AI die Leistung eines High-End-Systems mit der Einfachheit eines modernen Software-Tools. Sie können Ihre Quellen verbinden und haben in wenigen Minuten eine funktionierende KI-Suche. Warum probieren Sie es nicht aus?

Häufig gestellte Fragen

Die schnellste und einfachste Methode ist die Verwendung einer No-Code-KI-Suchplattform wie eesel AI. Diese Tools bieten Ein-Klick-Integrationen für gängige Wissensdatenbanken, sodass Sie die KI-Suche in Minuten statt Monaten live schalten können, ohne Entwicklerressourcen zu benötigen.

No-Code-Plattformen sind darauf ausgelegt, sich mit verschiedenen Datenquellen zu verbinden (Zendesk, Confluence, Notion usw.) durch einfache Integrationen. Sie ziehen all Ihre isolierten Informationen, einschließlich früherer Support-Tickets, in eine einheitliche Wissensdatenbank, aus der die KI lernen und Antworten abrufen kann.

Seriöse No-Code-Lösungen enthalten oft Funktionen wie Simulationsmodi. Diese ermöglichen es Ihnen, Ihre KI an Tausenden von früheren Support-Tickets in einer Sandbox-Umgebung zu testen und Ihnen ihre Leistung und die prognostizierten Auswirkungen vor der Bereitstellung zu zeigen.

Für Kunden bedeutet es sofortige, genaue Antworten und ein insgesamt besseres Erlebnis. Für Ihr Support-Team reduziert es das Volumen wiederkehrender Tickets erheblich, sodass sie sich auf komplexe Probleme konzentrieren und wertvollere menschliche Interaktionen bieten können.

Bei No-Code-Lösungen ist die laufende Wartung minimal, da der Anbieter die zugrunde liegende KI-Infrastruktur und Updates verwaltet. Sie konzentrieren sich hauptsächlich auf die Überprüfung der KI-Leistung und stellen sicher, dass Ihre verbundenen Wissensquellen korrekt und aktuell bleiben.

DIY-Ansätze bringen hohe Anfangs- und laufende Kosten mit sich und erfordern eine Entwicklungszeit von Monaten bis Jahren. Enterprise-Plattformen reduzieren einen Teil der Last, erfordern aber immer noch erhebliches Entwickler-Know-how und Wochen bis Monate. No-Code-Lösungen bieten die niedrigsten Anfangskosten, eine schnellere Wertschöpfung (Minuten) und minimale laufende Wartung.

Share this article

Article by

Kenneth Pangan

Writer and marketer for over ten years, Kenneth Pangan splits his time between history, politics, and art with plenty of interruptions from his dogs demanding attention.