Sie haben wahrscheinlich schon gesehen, dass benutzerdefinierte GPTs überall auftauchen. Die Idee, einen maßgeschneiderten KI-Assistenten für den Kundensupport zu entwickeln, der Ihr Unternehmen wirklich kennt, klingt unglaublich. Es scheint die perfekte Lösung zu sein, um die endlosen, sich wiederholenden Fragen zu bewältigen und Ihren Agenten etwas Luft zum Atmen zu verschaffen.

Aber es gibt einen Haken: Es klafft eine riesige Lücke zwischen einem einfachen, selbstgemachten Chatbot und einem sicheren, zuverlässigen KI-Agenten, auf den sich Ihr Team wirklich verlassen kann. Wie kommt man von einem coolen Experiment zu einem echten Geschäftstool, ohne einen Haufen Entwickler einzustellen oder Monate in ein Projekt zu versenken?

Dieser Leitfaden führt Sie durch die Schritte, die wirklich notwendig sind, um ein benutzerdefiniertes GPT für den Kundenservice zu erstellen. Wir werden uns den Standardweg mit den Tools von OpenAI ansehen, die schwerwiegenden Einschränkungen für jedes Unternehmen aufzeigen und Ihnen dann einen viel besseren Ansatz vorstellen.

Was ist ein benutzerdefiniertes GPT für den Kundenservice?

Ein benutzerdefiniertes GPT für den Kundenservice ist im Grunde ein KI-Modell, wie das hinter ChatGPT, das Sie darauf trainiert haben, Ihre spezifischen Support-Aufgaben zu erledigen. Der springende Punkt ist, von generischen Antworten wegzukommen und einen Assistenten zu schaffen, der Ihre Produkte, Richtlinien und Kunden wirklich versteht.

Normalerweise geben Sie der KI drei wichtige Dinge an die Hand:

-

Spezifische Anweisungen: Hier legen Sie ihre Persönlichkeit und Regeln fest. Sie können ihr sagen, dass sie immer freundlich und einfühlsam sein soll oder dass sie niemals Rabattcodes herausgeben darf, es sei denn, ein Kunde erfüllt bestimmte Kriterien.

-

Benutzerdefiniertes Wissen: Sie füttern sie mit Ihren eigenen Informationen, wie z. B. Artikeln aus dem Hilfe-Center, FAQs und internen Leitfäden. Dadurch kann sie Fragen beantworten, die nur für Ihr Unternehmen relevant sind.

-

Definierte Fähigkeiten: Sie können ihr erlauben, Dinge zu tun, wie das Web nach neuen Informationen zu durchsuchen oder Bilder zu erstellen, aber ihre Hauptaufgabe ist es, zu chatten.

Wenn Sie diese drei Teile zusammensetzen, erhalten Sie einen Chatbot, der für Ihre Welt gemacht ist. Das Problem, wie wir gleich sehen werden, ist, dass die Standardmethode zur Erstellung für ein professionelles Support-Team einfach nicht ausreicht.

Der Standardansatz zur Erstellung eines benutzerdefinierten GPT und seine Grenzen

OpenAI hat ein Tool namens GPT Builder, mit dem jeder mit einem kostenpflichtigen Konto sein eigenes benutzerdefiniertes GPT erstellen kann. Es ist fantastisch für persönliche Projekte und zum Herumexperimentieren, stößt aber an erhebliche Grenzen, wenn man es für den professionellen Kundensupport einsetzen will.

So funktioniert es: Ein benutzerdefiniertes GPT mit OpenAI erstellen

Ein benutzerdefiniertes GPT in ChatGPT zu erstellen ist ziemlich einfach. Sie gehen zum Editor, klicken auf den Tab „Konfigurieren“ und füllen die Felder aus. Sie geben ihm einen Namen, eine Beschreibung und einige grundlegende Anweisungen, wie er sich verhalten soll.

Um ihm etwas über Ihr Unternehmen beizubringen, können Sie „Wissens“-Dateien hochladen, normalerweise PDFs oder Textdokumente mit Ihren FAQs oder Richtlinien. In nur wenigen Minuten können Sie einen einfachen Chatbot haben, der ein wenig über Ihr Unternehmen weiß. Das Problem ist, dass diese Einfachheit zu einem Werkzeug führt, das in seiner eigenen kleinen Welt gefangen ist und nicht zu einem integrierten Teil Ihres Unternehmens wird.

Einschränkung 1: Keine Helpdesk-Anbindung

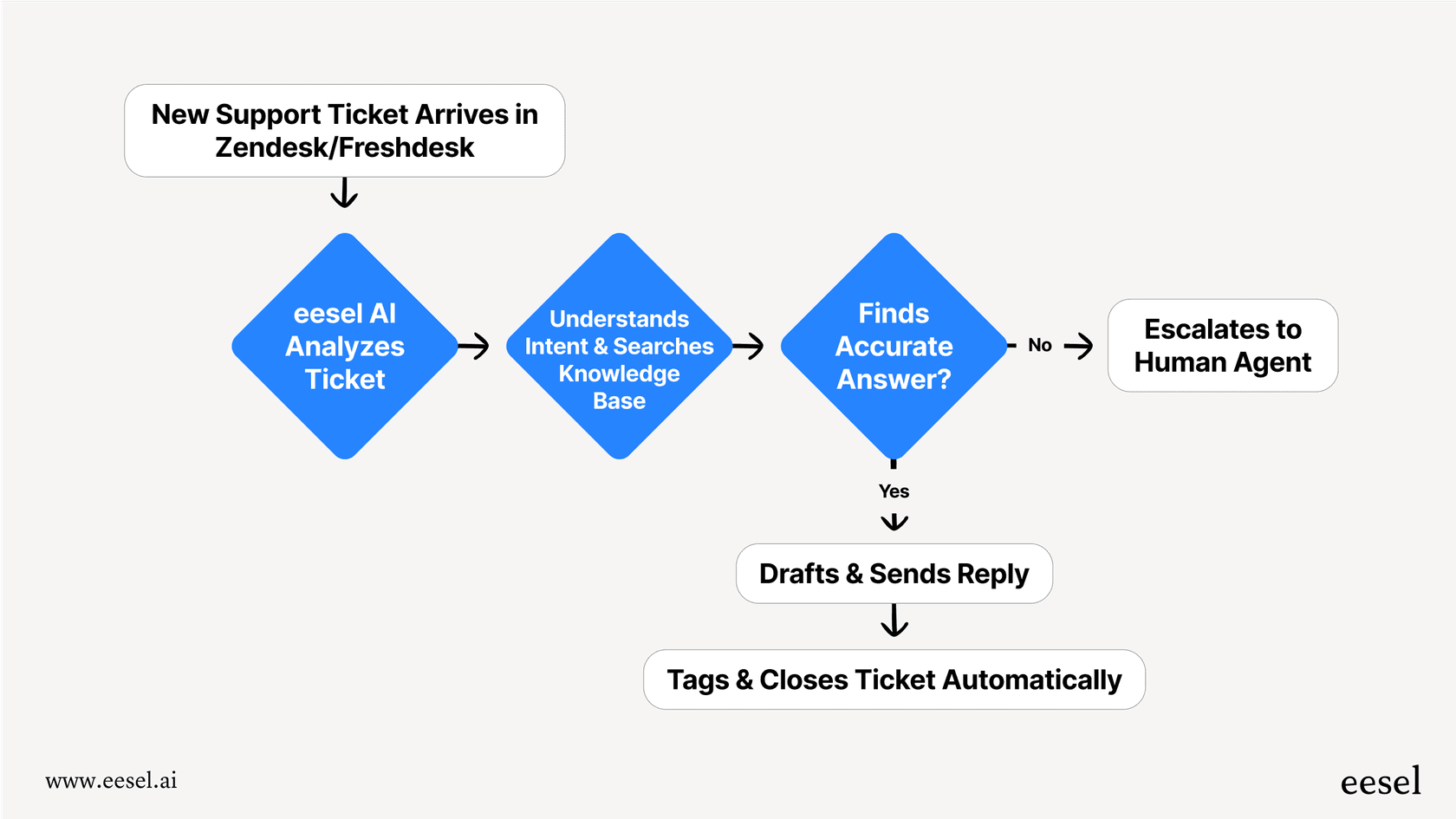

Dies ist für die meisten Support-Teams das K.-o.-Kriterium. Ein in OpenAIs Editor erstelltes benutzerdefiniertes GPT funktioniert nur innerhalb der ChatGPT-Oberfläche. Es kann keine Tickets in Ihrem bestehenden Helpdesk sehen, beantworten oder organisieren, egal ob Sie Zendesk, Freshdesk oder [Intercom] verwenden. Ihre Agenten müssten ständig Fragen von Ihrem Helpdesk in ChatGPT kopieren und die Antworten dann wieder zurückkopieren. Das ist ein umständlicher, langsamer Prozess, der den Zweck des KI-Einsatzes völlig zunichtemacht.

Die einzige Möglichkeit, dies zu umgehen, ist eine Funktion namens „Aktionen“, die einen Entwickler erfordert, um API-Aufrufe einzurichten. Das macht es zu einer langsamen, teuren und unpraktischen Option für Support-Teams, die einfach nur etwas brauchen, das funktioniert.

Ein besserer Ansatz: Eine Plattform wie eesel AI ist genau für dieses Problem konzipiert. Sie bietet Ein-Klick-Integrationen, sodass Sie einen KI-Agenten starten können, der direkt in den Tools arbeitet, die Sie bereits verwenden. Sie müssen weder den Helpdesk wechseln noch eine einzige Zeile Code schreiben.

__

Einschränkung 2: Datenschutz- und Sicherheitsrisiken

Die Verwendung von Kundendaten zur Erstellung eines benutzerdefinierten GPT wirft einige ernsthafte Datenschutzbedenken auf. Standardmäßig kann OpenAI Ihre Konversationen und hochgeladenen Dateien verwenden, um seine zukünftigen Modelle zu trainieren. Stellen Sie sich nur vor, Ihre privaten Kunden-Chats oder internen Dokumente werden Teil einer globalen KI.

Sie können dem widersprechen, aber der Prozess ist nicht für die strengen Compliance-Anforderungen eines Unternehmens ausgelegt, das sensible Kundeninformationen verarbeitet. Sie brauchen mehr als einen Schalter in den Einstellungen; Sie brauchen eine Garantie.

Ein besserer Ansatz: Für echte Sorgenfreiheit benötigen Sie eine Lösung, die für Unternehmen entwickelt wurde. eesel AI garantiert, dass Ihre Daten niemals zum Training anderer Modelle verwendet werden, ist SOC-2-konform und bietet EU-Datenresidenz, um Ihnen bei der Einhaltung der DSGVO-Anforderungen zu helfen.

Einschränkung 3: Keine Tests oder Leistungsmessung

Mit dem Standard-GPT-Builder fliegen Sie im Grunde blind. Es gibt keine Möglichkeit zu wissen, wie Ihr Bot mit echten Kundenfragen umgehen wird, bis Sie ihn live schalten. Es gibt keine Testumgebung oder Sandbox, um zu sehen, was funktioniert. Es gibt auch keine Analysen, sodass Sie keine wichtigen Metriken wie Lösungsrate oder Kosteneinsparungen verfolgen oder sogar sehen können, bei welchen Fragen die KI falsch liegt. Sie können nur auf das Beste hoffen.

Ein besserer Ansatz: eesel AI verfügt über einen leistungsstarken Simulationsmodus, mit dem Sie Ihre KI an Tausenden Ihrer vergangenen Tickets testen können. Dies gibt Ihnen eine genaue Prognose ihrer Leistung, bevor sie jemals mit einem Kunden interagiert. Sobald sie live ist, gibt Ihnen ein übersichtliches Reporting-Dashboard die Einblicke, die Sie benötigen, um sie kontinuierlich zu verbessern und ihren Wert nachzuweisen.

__

Kernkomponenten eines benutzerdefinierten GPT für den Kundenservice

Wenn Sie ein benutzerdefiniertes GPT erstellen möchten, das Ihrem Unternehmen wirklich hilft, müssen Sie über ein paar Anweisungen und Datei-Uploads hinausdenken. Hier sind die Dinge, die einen einfachen Chatbot von einem professionellen KI-Agenten unterscheiden.

Eine lebendige Wissensdatenbank

Eine wirklich hilfreiche KI kann sich nicht nur auf ein paar statische PDFs verlassen, die in dem Moment veraltet sind, in dem Sie sie hochladen. Sie benötigt einen sicheren, direkten Zugriff auf genau dieselben Informationen, die Ihre menschlichen Agenten jeden einzelnen Tag verwenden.

Das bedeutet, eine Verbindung zu Ihrem offiziellen Hilfe-Center, internen Wikis wie Confluence oder Google Docs und, was am wichtigsten ist, all dem „Stammeswissen“, das sich in Ihren vergangenen Support-Tickets verbirgt. Diese Tausenden von alten Konversationen sind eine Goldgrube an ungeschriebenen Regeln, cleveren Lösungen und der einzigartigen Stimme, die Ihr Kundenerlebnis besonders macht.

__

Plattformen wie eesel AI sind so konzipiert, dass sie sich vom ersten Tag an in all diese Quellen einklinken können. Sie kann sogar Ihre vergangenen Tickets analysieren, um die Stimme Ihrer Marke und gängige Lösungen zu lernen, ohne dass Sie ein einziges neues Dokument schreiben müssen.

Anpassbare Aktionen und Workflows

Eine gute KI gibt nicht nur Antworten; sie löst Probleme. Um das zu tun, muss sie in der Lage sein, innerhalb Ihrer aktuellen Workflows Maßnahmen zu ergreifen, genau wie es ein Mensch tun würde.

Das kann alles sein, vom automatischen Taggen eines Tickets mit der richtigen Kategorie, über das Weiterleiten eines dringenden Problems an die richtige Person, das Überprüfen eines Bestellstatus in Shopify bis hin zur reibungslosen Übergabe eines kniffligen Gesprächs an einen menschlichen Agenten. Eine KI, die nur reden kann, lässt eine Menge Effizienz auf der Strecke.

__

Anstatt Sie mit fragilen APIs hantieren zu lassen, bietet Ihnen eesel AI eine vollständig anpassbare Workflow-Engine. Sie können einen einfachen Prompt-Editor verwenden, um der KI genau zu sagen, welche Tickets sie bearbeiten soll und welche Aktionen sie durchführen kann, wodurch Sie die volle Kontrolle haben.

Nahtlose Bereitstellung

Ein KI-Tool ist nur dann nützlich, wenn die Leute leicht darauf zugreifen können. Wenn Ihr Team jedes Mal den Tab wechseln muss, um ein benutzerdefiniertes GPT zu verwenden, schafft das nur Reibung und verlangsamt alle.

Die KI sollte genau dort sein, wo die Konversationen bereits stattfinden:

-

Innerhalb Ihres Helpdesks: Hilft Agenten, in Sekundenschnelle hochwertige Antworten zu verfassen (AI Copilot).

-

Als Frontline-Agent: Löst Tickets selbstständig, rund um die Uhr (AI Agent).

-

Im Unternehmens-Chat: Beantwortet die internen Fragen Ihres Teams in Slack oder MS Teams.

-

Auf Ihrer Website: Begrüßt Besucher und beantwortet Fragen als Website-Chatbot.

__

eesel AI ist so konzipiert, dass es über all diese Kanäle bereitgestellt werden kann und sich in Ihr bestehendes Setup einfügt, anstatt Sie zu zwingen, Ihre Arbeitsweise zu ändern.

Preisvergleich und die wahren Kosten

Wenn Sie darüber nachdenken, wie Sie ein benutzerdefiniertes GPT für den Kundenservice erstellen können, müssen Sie über das anfängliche Preisschild hinausblicken. Es ist wichtig, die Gesamtkosten und den tatsächlichen Wert zu berücksichtigen, den Sie erhalten.

Die Kosten für die benutzerdefinierten GPTs von OpenAI

Um ein benutzerdefiniertes GPT zu erstellen, benötigen Sie ein kostenpflichtiges Abonnement wie ChatGPT Plus, das $20 pro Monat für jeden Benutzer kostet. Aber die wahren Kosten sind versteckt. Wenn Sie möchten, dass es für Ihr Unternehmen etwas Nützliches tut, wie z. B. eine Verbindung zu Ihrem Helpdesk herzustellen, müssen Sie für die API-Nutzung bezahlen. Diese Kosten basieren darauf, wie viele Daten Sie verwenden, und können unglaublich schwer vorherzusagen sein, besonders in einem geschäftigen Monat.

Hier ist ein kurzer Blick auf die API-Preise von OpenAI, die auf „Token“ (ähnlich wie Wortteile) basieren.

| Modell | Eingabepreis (pro 1 Mio. Token) | Ausgabepreis (pro 1 Mio. Token) |

|---|---|---|

| GPT-4o | $5.00 | $15.00 |

| GPT-4.1 | $2.00 | $8.00 |

Dieses Preismodell bedeutet, dass jedes einzelne Kundengespräch variable Kosten verursacht, was es nahezu unmöglich macht, ein Budget festzulegen.

Die eesel AI-Alternative: Klarer und vorhersagbarer Wert

Die Preisgestaltung von eesel AI ist für Unternehmen konzipiert, die wissen müssen, was sie ausgeben. Sie zahlen eine feste monatliche Gebühr, die auf der Anzahl der benötigten KI-Interaktionen basiert. Keine überraschenden Rechnungen und keine Gebühren, die Sie dafür bestrafen, mehr Tickets zu lösen.

Außerdem erhalten Sie mit einem Abonnement alles: den AI Agent, Copilot, Triage, Internal Chat und Chatbot. Es ist eine komplette Plattform zu einem klaren Preis, was viel mehr Wert bietet als das Jonglieren mit separaten Tools oder unvorhersehbaren API-Guthaben.

| Plan | Monatlicher Preis (jährliche Abrechnung) | KI-Interaktionen/Monat | Wichtigste Funktionen |

|---|---|---|---|

| Team | $239 | Bis zu 1.000 | Training mit Dokumenten, Copilot, Slack-Integration |

| Business | $639 | Bis zu 3.000 | Training mit vergangenen Tickets, KI-Aktionen, Simulation |

| Benutzerdefiniert | Vertrieb kontaktieren | Unbegrenzt | Erweiterte Aktionen, benutzerdefinierte Integrationen, Multi-Agenten-Setup |

Entwickeln Sie einen echten KI-Agenten, nicht nur einen Chatbot

Obwohl die Erstellung eines persönlichen benutzerdefinierten GPT im Builder von OpenAI ein lustiges Projekt ist, ist es nicht der richtige Weg, ein ernsthaftes Werkzeug für den Kundenservice zu entwickeln. Die riesigen Lücken bei Integration, Sicherheit, Tests und Berichterstattung machen es zu einer schlechten Wahl für den Geschäftsbetrieb, wo Zuverlässigkeit gefragt ist.

Um KI wirklich für Ihr Support-Team nutzbar zu machen, benötigen Sie eine Plattform, die von Anfang an darauf ausgelegt war, diese realen Probleme zu lösen. Das bedeutet, all Ihr Wissen zu verbinden, Arbeitsabläufe innerhalb der bereits vorhandenen Tools zu automatisieren und Ihnen die Daten zu geben, die Sie für eine sichere Bereitstellung und Messung benötigen.

Sind Sie bereit, ein benutzerdefiniertes GPT für den Kundenservice zu erstellen, das tatsächlich mit Ihren Tools funktioniert und mit Ihrem Unternehmen wächst? Starten Sie mit eesel AI in wenigen Minuten und sehen Sie, welchen Unterschied eine auf Unternehmen ausgerichtete Plattform macht.

Häufig gestellte Fragen

Der Standardansatz besteht darin, den GPT Builder von OpenAI innerhalb von ChatGPT zu verwenden. Sie konfigurieren ihn, indem Sie einen Namen, eine Beschreibung, grundlegende Anweisungen bereitstellen und „Wissens“-Dateien wie PDFs oder Textdokumente hochladen, um ihn auf Ihre Geschäftsinformationen zu trainieren.

Eine wesentliche Einschränkung besteht darin, dass mit dem Editor von OpenAI erstellte benutzerdefinierte GPTs nur innerhalb der ChatGPT-Oberfläche funktionieren. Sie können nicht direkt in bestehende Helpdesk-Systeme integriert werden oder Tickets verwalten, was manuelles Kopieren und Einfügen für Agenten erfordert, es sei denn, es werden komplexe, entwicklerintensive „Aktionen“ eingerichtet.

Standardmäßig kann OpenAI hochgeladene Dateien und Konversationen verwenden, um seine zukünftigen Modelle zu trainieren, was ein Datenschutzrisiko für sensible Kunden- oder interne Geschäftsdaten darstellt. Der Prozess ist in der Regel nicht darauf ausgelegt, die strengen Compliance- und Sicherheitsgarantien zu erfüllen, die von Unternehmen gefordert werden.

Leider bietet der Standard-GPT-Builder von OpenAI keine integrierte Testumgebung, keinen Sandbox-Modus oder ein Analyse-Dashboard. Das bedeutet, dass Sie keine Möglichkeit haben, seine Leistung zuverlässig zu testen oder Metriken wie Lösungsraten zu verfolgen, sobald er eingesetzt wird.

Eine unerlässliche Wissensdatenbank ist eine, die einen sicheren, direkten Zugriff auf alle relevanten Informationen bietet, einschließlich Artikeln aus dem Hilfe-Center, internen Wikis, Google Docs und, ganz entscheidend, dem „Stammeswissen“, das in Tausenden von vergangenen Support-Tickets verborgen ist. Sie muss dynamisch sein, nicht nur aus statischen Datei-Uploads bestehen.

Suchen Sie nach einer KI, die Aktionen ausführen kann, die über das bloße Beantworten hinausgehen, wie z. B. das automatische Taggen von Tickets, das Weiterleiten dringender Probleme, das Überprüfen von Bestellstatus und die nahtlose Übergabe komplexer Gespräche an menschliche Agenten. Sie sollte sich in Ihre bestehenden Workflows integrieren, ohne eine fragile API-Entwicklung zu erfordern.

Die benutzerdefinierten GPTs von OpenAI beinhalten ein Basisabonnement plus unvorhersehbare API-Nutzungskosten, die auf dem Datenvolumen (Token) basieren, was die Budgetierung erschwert. Im Gegensatz dazu bieten Plattformen wie eesel AI eine feste, vorhersagbare monatliche Gebühr für eine umfassende Suite von Funktionen, wodurch überraschende Kosten vermieden und ein klarerer Wert geboten wird.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.