KI-generierte Inhalte sind heutzutage so gut wie überall zu finden. Das hat zu einem Boom von Tools geführt, die behaupten, den Unterschied zwischen menschlichem und maschinellem Schreiben erkennen zu können. Aber hier ist die Millionen-Dollar-Frage: Kann man ihnen wirklich vertrauen? Ehrlich gesagt fühlt es sich oft wie ein Münzwurf an, sich auf einen KI-Detektor zu verlassen. Wir alle haben die Horrorgeschichten online gesehen: Studenten, die des Betrugs bezichtigt wurden, obwohl sie es nicht waren, und Unternehmen, die perfekt gute, von einer echten Person geschriebene Inhalte verwerfen.

Dieser Leitfaden wird sich die Daten genauer ansehen, um die große Frage zu beantworten: Wie genau sind KI-Detektoren? Wir werden ihre grundlegenden Mängel, die ernsten ethischen Probleme, die sie verursachen, und warum es viel sinnvoller ist, Ihre eigene KI zu kontrollieren und zu verifizieren, anstatt zu versuchen, Inhalte von außen zu überwachen, aufschlüsseln.

Wie funktionieren KI-Detektoren?

Ein KI-Detektor ist ein Tool, das entwickelt wurde, um einen Text zu analysieren und zu erraten, ob er von einem großen Sprachmodell (LLM) wie ChatGPT oder Gemini geschrieben wurde. Sie fügen Ihren Text ein, und es gibt Ihnen einen Wert, normalerweise einen Prozentsatz, der anzeigt, wie „KI-ähnlich“ es den Text einschätzt.

Im Grunde suchen diese Tools nach Mustern, die für KI-generierte Texte typisch sind. Zwei der Hauptsignale, auf die sie achten, sind:

-

Perplexität: Das ist eine komplizierte Art zu messen, wie vorhersagbar die Wortwahl ist. KI-Modelle sind darauf trainiert, das statistisch wahrscheinlichste nächste Wort auszuwählen, was ihre Texte manchmal etwas zu glatt und logisch wirken lässt.

-

Burstiness: Dies bezieht sich auf die Vielfalt der Satzlängen und -strukturen. Menschen wechseln ganz natürlich ab und verwenden lange, fließende Sätze neben kurzen, prägnanten. KI-generierte Texte können sich manchmal gleichförmiger anfühlen und diesen natürlichen Rhythmus vermissen lassen.

Das klingt in der Theorie zwar gut, aber die Realität ist ein ziemliches Chaos.

Das Genauigkeitsproblem: Warum sie unzuverlässig sind

Es handelt sich nicht nur um ein paar Einzelfälle. Eine Studie nach der anderen hat bestätigt, was viele von uns vermutet haben: KI-Detektoren sind, wie das MIT es ausdrückt, „weder genau noch zuverlässig“. Das Problem ist so weit verbreitet, dass sogar OpenAI, das Unternehmen hinter ChatGPT, sein eigenes Erkennungstool abschalten musste, weil es einfach nicht genau genug war.

Die Unzuverlässigkeit lässt sich auf zwei große Probleme zurückführen: Falsch-Positive und Falsch-Negative.

Die Herausforderung der Falsch-Positiven

Ein Falsch-Positiv-Ergebnis liegt vor, wenn ein Detektor fälschlicherweise von Menschen geschriebenen Text als KI-generiert einstuft. Hier wird es wirklich kompliziert, und die Folgen können ziemlich ernst sein.

Verbringen Sie fünf Minuten auf Reddit, und Sie werden viele Beispiele finden. Ein Student erwähnte, sein Lehrer habe eine Analyse von „Hans und die Bohnenranke“ durch einen Detektor laufen lassen, und das Ergebnis war ein 80%iger KI-Score. Leute haben herausgefunden, dass das Einfügen von Texten aus der Bibel, Der Herr der Ringe oder sogar der US-Verfassung einen hohen KI-Score auslösen kann. Diese Tools können oft nicht den Unterschied zwischen einem klassischen literarischen Werk und etwas, das eine KI gerade erstellt hat, erkennen.

Die Daten bestätigen dies. Eine Studie der Stanford University hat ergeben, dass KI-Detektoren eine erhebliche Voreingenommenheit gegenüber nicht-muttersprachlichen Englischschreibern aufweisen und deren Arbeiten häufig nur aufgrund unterschiedlicher Satzstrukturen und Wortwahlen markieren. Eine Untersuchung der Washington Post ergab, dass Turnitin, ein beliebtes Tool an Universitäten, eine viel höhere Rate an Falsch-Positiven aufwies, als das Unternehmen behauptete.

Für Unternehmen und Schulen sind diese Fehler mehr als nur ein Ärgernis. Sie können zu ungerechten Strafen führen, das Vertrauen zwischen Managern und ihren Teams untergraben und eine Kultur des Misstrauens fördern.

Das Problem mit Falsch-Negativen

Auf der anderen Seite der Medaille steht ein Falsch-Negativ-Ergebnis, wenn ein Detektor es versäumt, KI-generierte Inhalte zu erkennen und sie als „von Menschen geschrieben“ durchgehen lässt. Das passiert ständig und ist ein Hauptgrund, warum es ein verlorenes Spiel ist, sich auf Detektoren zu verlassen.

Sobald KI-Detektoren populär wurden, tauchten „KI-Humanisierer“-Tools auf. Diese Dienste nehmen KI-Texte und optimieren sie gerade so weit, dass sie die Detektoren täuschen, vielleicht indem sie ein paar Grammatikfehler hinzufügen oder Wörter austauschen, um sie weniger vorhersagbar zu machen. Es ist auch überraschend einfach, sie mit cleveren Prompts zu umgehen. Eine KI einfach zu bitten, in einem „menschlicheren“ oder „frecheren“ Stil zu schreiben, reicht oft aus, um unter dem Radar zu fliegen.

Dies hat ein endloses Wettrüsten ausgelöst: LLMs werden besser, Detektoren versuchen sich anzupassen und Humanisierer finden neue Wege, sie auszutricksen. Die Detektoren sind immer einen Schritt hinterher, und es ist ein Rennen, das sie nicht gewinnen können.

| KI-Detektor | Behauptete Genauigkeit | Wichtige Forschungsergebnisse | Quelle |

|---|---|---|---|

| GPTZero | 99 % | Markierte in einem Vergleichstest von Menschen geschriebenen Text. | BestColleges.com |

| Originality.ai | 97 %+ (variiert je nach Modell) | In einigen Studien als genauer erwiesen, aber immer noch anfällig für Falsch-Positive. | Originality.ai |

| Turnitin | 98 % | Ein Test zeigte, dass er einigermaßen genau sein kann, aber in einer kleinen Stichprobe auch eine Falsch-Positiv-Rate von 50 % aufwies. | Washington Post |

| OpenAI Classifier | Eingestellt | Von OpenAI wegen einer „geringen Genauigkeitsrate“ eingestellt. | MIT Sloan EdTech |

Die ethischen Risiken von KI-Detektoren

Die Probleme mit KI-Detektoren gehen tiefer als nur mangelnde Genauigkeit. Ihre Verwendung öffnet eine ganze Büchse der Pandora an ethischen Problemen. Sich auf diese Tools zu verlassen, ist nicht nur unzuverlässig; es kann diskriminierend sein und echte Fairnessprobleme für Ihr Team oder Ihre Organisation schaffen.

Voreingenommenheit gegenüber nicht-muttersprachlichen und neurodiversen Autoren

Die meisten KI-Detektoren werden auf riesigen Datensätzen von als „standardmäßig“ geltender englischer Prosa trainiert. Infolgedessen ist es wahrscheinlicher, dass sie Texte markieren, die nicht sauber in dieses Schema passen.

Die Stanford-Studie ist ein Paradebeispiel. Sie zeigte, dass Detektoren Aufsätze von nicht-muttersprachlichen Englischsprechern weitaus wahrscheinlicher als KI-generiert einstuften, nur weil ihr Schreibstil anders war. Es ist ein klarer Fall von Technologie, die Menschen dafür bestraft, nicht wie ein Muttersprachler zu schreiben.

Diese Voreingenommenheit kann sich auch auf neurodiverse Personen auswirken. Texte von Menschen mit Erkrankungen wie Autismus oder ADHS können Muster enthalten, wie Wiederholungen oder einzigartige Satzstrukturen, die ein Detektor leicht mit KI verwechseln könnte. Das bedeutet, dass Sie Menschen aufgrund ihres natürlichen Kommunikationsstils unfairerweise markieren könnten.

Für jede Organisation ist das ein riesiges Problem. Die Verwendung dieser Tools kann eine Umgebung schaffen, die Vielfalt bestraft und zu ernsthaften Gleichheitsproblemen führt.

Ein besserer Ansatz: Kontrollieren Sie Ihre KI

Wenn Detektoren also eine Sackgasse sind, was ist die Alternative? Die Antwort ist, Ihren Fokus von der Erkennung auf die Kontrolle zu verlagern. Anstatt zu versuchen zu erraten, ob Inhalte von irgendeiner zufälligen KI im Internet stammen, sollten Sie eine vertrauenswürdige KI-Plattform verwenden, die Sie selbst konfigurieren, verwalten und verifizieren können.

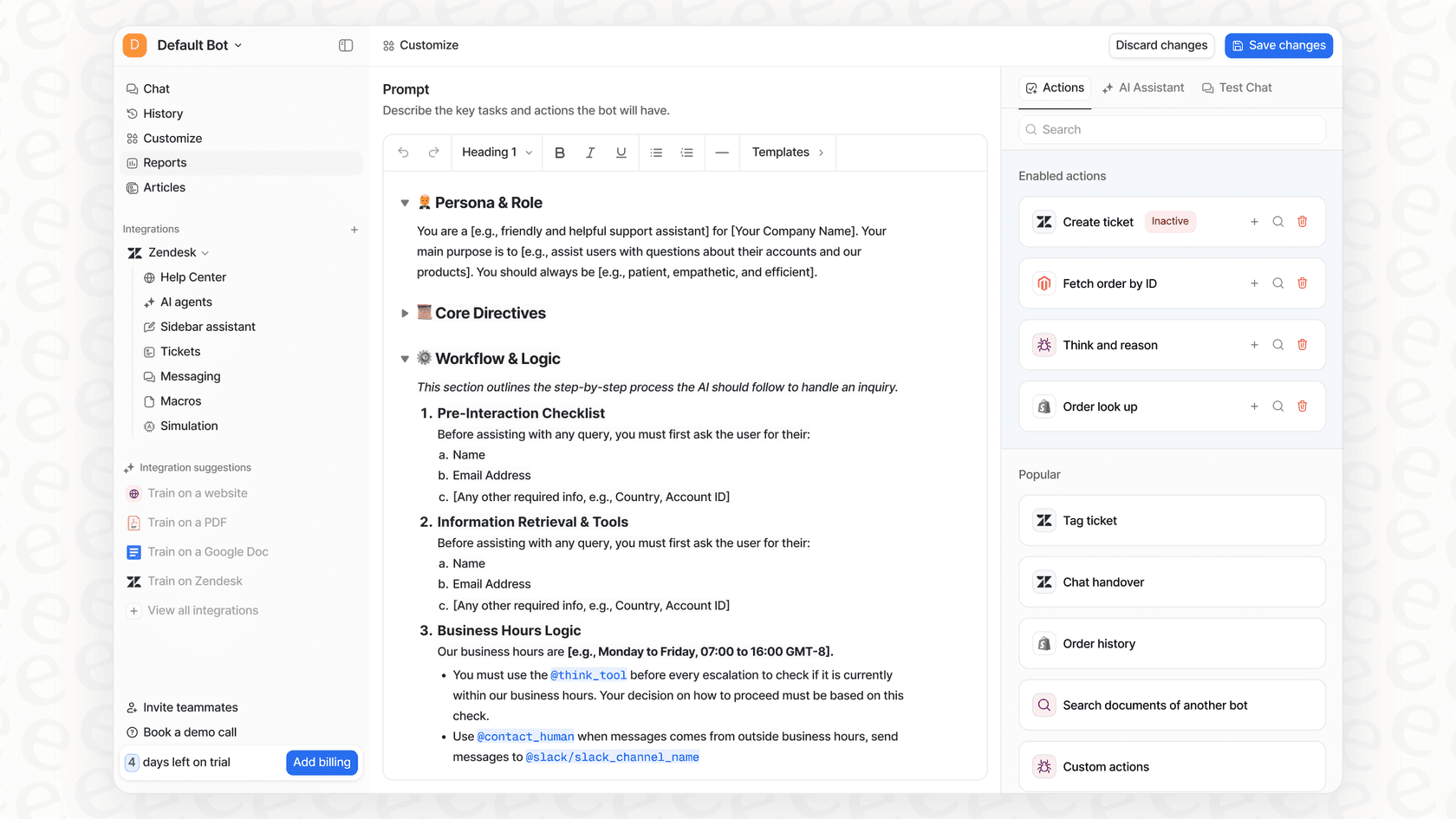

Hier kommt ein Tool wie eesel AI ins Spiel. Es geht darum, von einer reaktiven, überwachenden Denkweise zu einer proaktiven, leistungsorientierten überzugehen. Sie hören auf zu fragen „Ist das KI?“ und fangen an, Ihrer KI genau zu sagen, was sie tun soll.

Bauen Sie auf Ihr eigenes, vertrauenswürdiges Wissen

KI-Detektoren treffen ihre beste Schätzung basierend auf Mustern, die aus dem gesamten Internet gesammelt wurden. Im Gegensatz dazu arbeitet eesel AI, indem es sich direkt mit dem Wissen Ihres Unternehmens verbindet. Es lernt aus Ihrer Zendesk-Historie, Ihren Confluence-Seiten, Ihren Google Docs und vergangenen Support-Tickets.

Der Vorteil hier ist enorm. Ihre KI lernt nicht aus generischen Webinhalten; sie lernt die Stimme Ihrer Marke, die spezifischen Lösungen Ihres Unternehmens und den einzigartigen Kontext Ihres Geschäfts. Die Ausgabe ist kein fader, seelenloser Text, sondern eine direkte Widerspiegelung der Expertise Ihres eigenen Teams. Wenn die KI auf dem Wissen Ihres Unternehmens aufbaut, erübrigt sich die ganze Frage der Authentizität, denn es ist Ihre KI.

Simulieren und testen Sie mit Zuversicht

Eines der frustrierendsten Dinge an KI-Detektoren ist, dass sie eine totale Blackbox sind. Sie erhalten einen Wert, aber Sie haben keine Ahnung, ob er richtig ist. Der leistungsstarke Simulationsmodus in eesel AI dreht das komplett um.

Bevor Ihre KI jemals mit einem Kunden oder Mitarbeiter spricht, können Sie sie an Tausenden Ihrer vergangenen Tickets in einer sicheren Sandbox-Umgebung testen. Sie können genau sehen, was sie gesagt hätte, wie sie das Ticket getaggt hätte und ob sie das Problem gelöst hätte.

Das bedeutet, Sie müssen nicht über die Genauigkeit raten. Sie erhalten eine präzise Prognose ihrer Leistung und Lösungsrate, bevor Sie sie überhaupt einschalten. Diese Art der risikofreien Validierung kann Ihnen kein öffentlicher KI-Detektor jemals bieten. Sie ersetzt die Unsicherheit der Erkennung durch das Vertrauen der Verifizierung.

Vollständige Kontrolle über Workflows und Aktionen

Ein KI-Detektor gibt Ihnen eine Information, und sie ist oft falsch. Eine Plattform wie eesel AI gibt Ihnen eine vollständig anpassbare Workflow-Engine. Sie haben die Kontrolle.

Einige Funktionen, die Ihnen die Kontrolle geben, sind:

-

Selektive Automatisierung: Sie entscheiden genau, welche Arten von Tickets die KI bearbeitet. Sie können klein anfangen mit einfachen, häufigen Fragen und alles Komplexere an einen menschlichen Agenten eskalieren lassen.

-

Benutzerdefinierte Persona & Aktionen: Sie können den Tonfall der KI definieren und ihr genau sagen, was sie tun darf, sei es ein Ticket zu eskalieren, eine Bestellung in Shopify nachzuschlagen oder ein bestimmtes Tag hinzuzufügen. Dieses Maß an Kontrolle stellt sicher, dass die KI als eine echte Erweiterung Ihres Teams arbeitet, nicht als irgendein unvorhersehbares Werkzeug, dem Sie nicht vertrauen können.

Preise von KI-Detektoren: Wofür bezahlen Sie?

Wenn man sich die Preisgestaltung von KI-Detektoren ansieht, wird man feststellen, dass sie oft Kreditsysteme verwenden oder pro gescanntem Wort abrechnen. Sie bezahlen für eine Vermutung, was ein grundlegend anderes Wertversprechen ist als eine KI-Automatisierungsplattform.

| Tool | Preismodell | Wesentliche Einschränkung |

|---|---|---|

| Originality.ai | Pay-as-you-go (30 $ für 30.000 Credits) oder monatliches Abonnement (14,95 $/Monat für 2.000 Credits). | Die Kosten sind an die Menge des Scannens gebunden, nicht an den Wert, den Sie erhalten. Sie zahlen, um Inhalte zu überprüfen, nicht um sie zu verbessern. |

| GPTZero | Kostenlose Stufe (10.000 Wörter/Monat), kostenpflichtige Pläne beginnen bei ca. 10 $/Monat (jährlich abgerechnet) für mehr Wörter und Funktionen. | Sie zahlen, um auf KI zu prüfen, nicht um das zugrunde liegende Problem mit Ihren Arbeitsabläufen oder Ihrem Wissen zu lösen. |

| eesel AI | Gestaffelte Pläne (ab 239 $/Monat) basierend auf Funktionen und monatlichen KI-Interaktionen. Keine Gebühren pro Lösung. | Ihre Kosten sind vorhersehbar und beinhalten eine vollständige Suite von KI-Tools (Agent, Copilot, Triage), die darauf ausgelegt sind, Arbeit zu automatisieren, nicht nur zu überwachen. |

Die wichtigste Erkenntnis ist ziemlich einfach: Bei Detektoren zahlen Sie für einen Wahrscheinlichkeitswert ohne Garantie auf Genauigkeit. Mit einer Plattform wie eesel AI investieren Sie in eine komplette Automatisierungslösung mit vorhersehbaren, transparenten Kosten, die echte Ergebnisse liefert.

Hören Sie auf zu erkennen, fangen Sie an zu steuern

Das Fazit ist, dass KI-Detektoren ungenau, voreingenommen und letztendlich eine Ablenkung sind. Der Versuch, „die KI zu fangen“, ist ein verlorenes Spiel in einem Wettrüsten, das immer schneller wird.

Der effektivste, ethischste und praktischste Weg nach vorne ist nicht, der Erkennung nachzujagen, sondern kontrollierte Automatisierung zu nutzen. Es ist Zeit, aufzuhören zu raten und anzufangen zu steuern. Indem Sie Ihren Teams zuverlässige, transparente KI-Tools geben, die auf Ihrem eigenen Wissen basieren, können Sie die Angst und Unsicherheit hinter sich lassen und KI tatsächlich nutzen, um Ihr Unternehmen besser zu machen.

Anstatt Zeit und Geld in fehlerhafte Detektoren zu stecken, investieren Sie in eine KI-Plattform, der Sie vertrauen und die Sie verifizieren können. Sehen Sie, wie eesel AI Ihnen das Vertrauen gibt, den Support zu automatisieren, indem Sie die Leistung auf Ihren eigenen Daten simulieren. Starten Sie Ihre kostenlose Testversion oder buchen Sie eine Demo, um mehr zu erfahren.

Häufig gestellte Fragen

KI-Detektoren sind im Allgemeinen unzuverlässig und ungenau. Studien zeigen, dass sie häufig Fehler machen. Selbst große KI-Entwickler haben ihre geringe Genauigkeitsrate und ihre Einschränkungen anerkannt.

Die Hauptfehler sind Falsch-Positive (Kennzeichnung von von Menschen geschriebenem Text als KI) und Falsch-Negative (Nicht-Erkennen von KI-generiertem Inhalt). Detektoren haben mit beiden Schwierigkeiten, was zu erheblicher Unzuverlässigkeit führt.

Zu den ethischen Bedenken gehört die Voreingenommenheit gegenüber nicht-muttersprachlichen Englischsprechern und neurodiversen Autoren, deren einzigartige Stile oft fälschlicherweise als KI gekennzeichnet werden. Dies schafft Fairnessprobleme und kann zu ungerechten Strafen führen.

Forschungsergebnisse deuten darauf hin, dass viele KI-Detektoren von verschiedenen Unternehmen ebenfalls erhebliche Genauigkeitsprobleme aufweisen, insbesondere hohe Falsch-Positiv-Raten. Die Entscheidung von OpenAI unterstreicht die inhärente Schwierigkeit, eine durchweg zuverlässige Erkennung zu entwickeln.

Ein zuverlässigerer Ansatz ist der Wechsel von der Erkennung zur Kontrolle durch die Verwendung vertrauenswürdiger KI-Plattformen. Diese Plattformen ermöglichen es Ihnen, Ihre eigene KI zu verwalten und zu verifizieren und sicherzustellen, dass sie auf Ihrem spezifischen Wissen aufbaut und innerhalb definierter Parameter arbeitet.

Die langfristigen Aussichten für KI-Detektoren sind schwierig. Sie befinden sich in einem „Wettrüsten“ mit sich entwickelnden KI-Modellen und „Humanisierer“-Tools, bleiben oft einen Schritt zurück und haben Schwierigkeiten, eine konsistente Genauigkeit aufrechtzuerhalten.

KI-Detektoren bieten einen Wahrscheinlichkeitswert ohne Genauigkeitsgarantie, was bedeutet, dass Sie für eine Vermutung bezahlen. Im Gegensatz dazu bieten Plattformen wie eesel AI eine komplette Automatisierungslösung mit vorhersehbaren Kosten, die greifbare Ergebnisse und verifizierte Leistung liefert.

Share this article

Article by

Stevia Putri

Stevia Putri is a marketing generalist at eesel AI, where she helps turn powerful AI tools into stories that resonate. She’s driven by curiosity, clarity, and the human side of technology.